数据分析 参考资料

数据分析复习资料

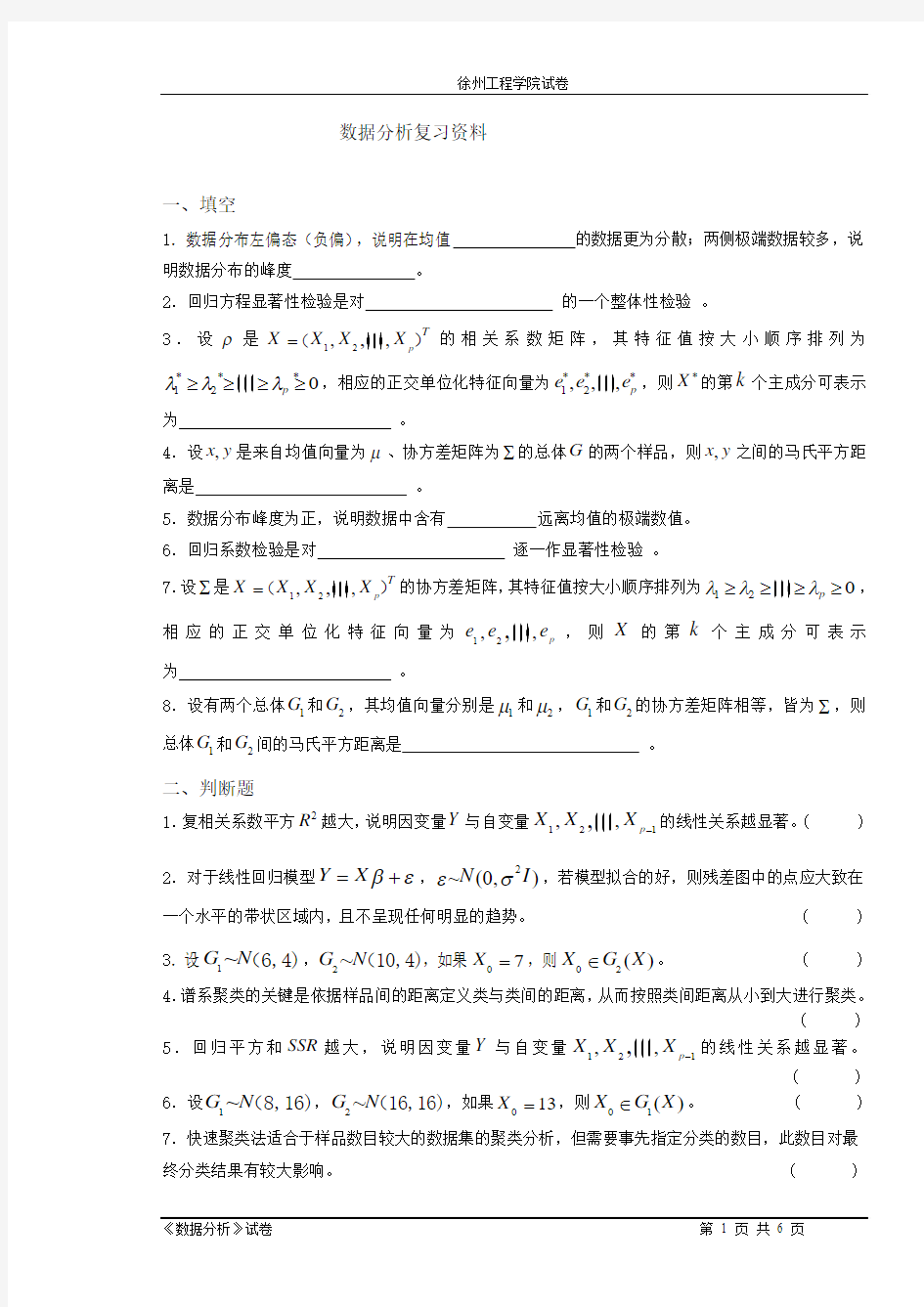

一、填空

1.数据分布左偏态(负偏),说明在均值 的数据更为分散;两侧极端数据较多,说

明数据分布的峰度 。

2.回归方程显著性检验是对 的一个整体性检验 。

3.设ρ是12,,,p T X X X X =()的相关系数矩阵,其特征值按大小顺序排列为

***120p λλλ≥≥≥≥,相应的正交单位化特征向量为***

12,,

,p e e e ,则*X 的第k 个主成分可表示为 。

4.设,x y 是来自均值向量为μ、协方差矩阵为∑的总体G 的两个样品,则,x y 之间的马氏平方距

离是 。

5.数据分布峰度为正,说明数据中含有 远离均值的极端数值。

6.回归系数检验是对 逐一作显著性检验 。

7.设∑是12,,,p T X X X X =()的协方差矩阵,其特征值按大小顺序排列为120p λλλ≥≥≥≥,相应的正交单位化特征向量为

12,,,p e e e ,则X 的第k 个主成分可表示

为 。 8.设有两个总体1G 和2G ,其均值向量分别是1μ和2μ,1G 和2G 的协方差矩阵相等,皆为∑,则

总体1G 和2G 间的马氏平方距离是 。

二、判断题

1.复相关系数平方2R 越大,说明因变量Y 与自变量121,,,p X X X -的线性关系越显著。( )

2.对于线性回归模型Y X βε=+,2

~(0,)N I εσ,若模型拟合的好,则残差图中的点应大致在一个水平的带状区域内,且不呈现任何明显的趋势。 ( )

3.设1~G N (6,4),2~G N (10,4),如果07X =,则02()X G X ∈。 ( )

4.谱系聚类的关键是依据样品间的距离定义类与类间的距离,从而按照类间距离从小到大进行聚类。

( )

5.回归平方和SSR 越大,说明因变量Y 与自变量121,,,p X X X -的线性关系越显著。

( )

6.设1~G N (8,16),2~G N (16,16),如果013X =,则01()X G X ∈。 ( )

7.快速聚类法适合于样品数目较大的数据集的聚类分析,但需要事先指定分类的数目,此数目对最

终分类结果有较大影响。 ( )

8.偏度1g 是刻画数据分布对称的指标,若10g <,此时均值大于中位数,均值右边的数

据更为分散。 (

) 9.对于线性回归模型Y X βε=+,β的最小二乘估计是1()T X X Y β∧-=和2

σ的估计是

21

()T Y I H Y n p σ∧=--。 ( )

10.在线性回归分析中总离 方和可分解为SST SSE SSR =+,其中SSR 越大反应了Y 与121,,,p X X X -的线性关系越明显。 ( )

11.用最短距离法进行谱系聚类时,若三个样品的距离矩阵是030420?? ? ? ???

,则先将样品二和三聚为一类。

三、测量某小学60名11岁学生的身高(单位:cm ),得测量数据(略)。调用SAS 软件PROC UNIVARIATE 过程对数据进行描述性分析,以下是输出结果。根据程序输出结果:

1.分析学生身高的数字特征:均值、中位数、三均值、上,下四分位数。

2.分析学生身高的分散性特征:方差、标准差、变异系数、极差、四分位极差。

3.运用偏度、峰度分析学生身高的分布形状。

输出结果: The UNIVARIATE Procedure

Variable: shengao

Moments

N 60 Sum Weights 60

Mean 139 Sum Observations 8340

Std Deviation 7.06387324 Variance 49.8983051

Skewness -0.5100771 Kurtosis -0.1261294

Uncorrected SS 1162204 Corrected SS 2944

Coeff Variation 5.08192319 Std Error Mean 0.91194211

Basic Statistical Measures

Location Variability

Mean 139.0000 Std Deviation 7.06387

Median 139.0000 Variance 49.89831

Mode 142.0000 Range 31.00000

Interquartile Range 9.50000

Quantiles (Definition 5)

Quantile Estimate

100% Max 151.0

99% 151.0

95% 149.0

90% 147.5

75% Q3 144.5

50% Median 139.0

25% Q1 135.0

10% 128.5

5% 126.5

1% 120.0

0% Min 120.0

四、某科学基金会的管理人员欲了解从事研究工作的中、高水平的数学家的年工资额Y 与他们的研究成果的质量指标1X 、从事研究工作的时间2X 以及能成功获得资助的指标3X 之间的关系。为此按一定的设计方案调查了24位此类型的数学家,得数据(略)。假设Y 与123,,X X X 之间满足线性回归关系0112233i i i i i y x x x ββββε=++++,1,2,,24i =,其中i ε独立同分布于2(0,)N σ。调用SAS 过程的PROC REG 过程进行线性回归分析。根据下面输出结果作出分析:1.求复相关系数的平方2

R 的值并解释其意义。

2.检验回归方程是否显著,并写出回归方程。3.分析各个线性回归系数的显著性检验结果(0.05α=)。并求1β的95%的置信区间(0.975(20) 2.086t =)。

4.假定某位数学家关于123,,X X X 的值为010203(,,)(5.1,20,7.2)x x x =,预测他的年工资额。

5.写出1()T X X -,MSE 输出结果: The REG Procedure

Dependent Variable: y

X'X Inverse, Parameter Estimates, and SSE

Variable Intercept x1 x2 x3 y

Intercept 1.30446 -0.10187 0.00044 -0.12158 17.84693

x1 -0.10187 0.03536 -0.00167 -0.00765 1.10313

x2 0.00044 -0.00167 0.00045 -0.00044 0.32152

x3 -0.12158 -0.00765 -0.00044 0.02900 1.28894

y 17.84693 1.10313 0.32152 1.28894 61.44300

Analysis of Variance

Sum of Mean

Source DF Squares Square F Value Pr > F

Model 3 627.81700 209.27233 68.12 <.0001

Error 20 61.44300 3.07215

Corrected Total 23 689.26000

Root MSE 1.75276 R-Square 0.9109

Dependent Mean 39.50000 Adj R-Sq 0.8975

Coeff Var 4.43735

Parameter Estimates

Parameter Standard

Variable DF Estimate Error t Value Pr > |t|

Intercept 1 17.84693 2.00188 8.92 <.0001

x1 1 1.10313 0.32957 3.35 0.0032

x2 1 0.32152 0.03711 8.66 <.0001

x3 1 1.28894 0.29848 4.32 0.0003

五、简答题

1.简述从统计数据分析的角度,判别分析的模型。

2. 简述快速聚类法的基本步骤。

3. 简述谱系聚类法的基本步骤。

4.将下列谱系聚类分析及画出聚类谱系图的SAS 命令补充完整。

PROC ( ) options;

( ) variables;

( ) variable;

RUN;

PROC ( ) options;

ID variable;

RUN;

5.简述因子分析与主成分分析的区别与联系

六、为全面了解我国西北某省的十家上市公司的获利能力和经营发展能力,特选取公司如下六个指标进行分析:1X :每股净收益;2X :净资产收益率;3X :主营业务收益率;4X :主营业务增长率;5X :净资产增长率;6X :总资产增长率。其中前三个变量反映了上市公司的获利能力,后三个变量反映了公司的经营发展能力。给出10家公司关于以上六个指标在过去三年取值的加权平均,观测数据(略)。调用SAS 过程PROC PRINCOMP 过程对其做主成分分析,以下是输出结果。根据程序运行的结果作出分析:

1.写出123456(,,,,,)T X X X X X X 的样本相关系数矩阵R 。

2.从R 出发做主成分分析,求各主成分的贡献率及前两个主成分的累计贡献率。

3.求出前两个主成分并解释其意义。4.按第一主成分得分对这10家公司(Id :1,2,…,10)的综合能力进行排序。

输出结果: The PRINCOMP Procedure

Correlation Matrix

x1 x2 x3 x4 x5 x6

x1 1.0000 0.8630 0.2876 0.6644 0.4842 0.4340

x2 0.8630 1.0000 0.6332 0.2600 0.1937 0.2050

x3 0.2876 0.6332 1.0000 -.2576 -.2466 0.0388

x4 0.6644 0.2600 -.2576 1.0000 0.5136 0.4273

x5 0.4842 0.1937 -.2466 0.5136 1.0000 0.8611

x6 0.4340 0.2050 0.0388 0.4273 0.8611 1.0000

Eigenvalues of the Correlation Matrix

Eigenvalue Difference Proportion Cumulative

1 3.0110797

2 1.20332547 0.5018 0.5018

2 1.80775425 0.9731251

3 0.3013 0.8031

3 0.83462912 0.55438892 0.1391 0.9422

4 0.28024020 0.22799377 0.0467 0.9890

5 0.05224643 0.03819614 0.0087 0.9977

6 0.01405029 0.0023 1.0000

Eigenvectors

Prin1 Prin2 Prin3 Prin4 Prin5 Prin6 x1 0.522844 0.213764 -.294754 -.196018 -.288537 -.687301 x2 0.396814 0.508698 -.103156 -.392312 -.066345 0.644060 x3 0.100256 0.655312 0.376261 0.489516 0.382587 -.181505 x4 0.416770 -.243670 -.569465 0.584037 0.227017 0.223608 x5 0.444032 -.376518 0.328673 -.370235 0.639571 -.083182 x6 0.433888 -.254864 0.573228 0.299781 -.552616 0.151465 Obs 1 2 3 4 5 6 7 8 9 10

Id 7 10 4 5 9 6 1 2 8 3 Prin1 2.47008 1.32340 1.29914 1.02640 0.54590 0.48099 -0.86398 -1.41227 -1.60456 -3.26510 七、设总体12(,)T X X X =的相关系数矩阵为1121

12ρ????=????????

,求X 的标准化变量的主成分以及各主成分的贡献率。

八、以下是六种语言的距离矩阵,试用最短距离法对这六种语言进行谱系聚类,写出聚类过程,并画出谱系图。

020210756064550666930D ????????=??????????

九、为研究心肌梗塞的危险因素,考察两组人群,第一组1G 是心肌梗塞组,取21名;

第二组2G 是正常组,取11名。考察2个血液指标1X ,2X ,测得指标1X 和2X 的取值,

通过指标1X 和2X 的取值计算得()1380T u =,()2260T u =,110252555S ??=????

,210101040S ??=????

,在协方差矩阵相等的假定下,建立距离判别准则,并对待判样品1:()2.5

85T ,2:()250T

做判别。

面板数据分析简要步骤与注意事项(面板单位根—面板协整—回归分析)

面板数据分析简要步骤与注意事项(面板单位根检验—面板协整—回归分析) 面板数据分析方法: 面板单位根检验—若为同阶—面板协整—回归分析 —若为不同阶—序列变化—同阶建模随机效应模型与固定效应模型的区别不体现为R2的大小,固定效应模型为误差项和解释变量是相关,而随机效应模型表现为误差项和解释变量不相关。先用hausman检验是fixed 还是random,面板数据R-squared值对于一般标准而言,超过0.3为非常优秀的模型。不是时间序列那种接近0.8为优秀。另外,建议回归前先做stationary。很想知道随机效应应该看哪个R方?很多资料说固定看within,随机看overall,我得出的overall非常小0.03,然后within是53%。fe和re输出差不多,不过hausman检验不能拒绝,所以只能是re。该如何选择呢? 步骤一:分析数据的平稳性(单位根检验) 按照正规程序,面板数据模型在回归前需检验数据的平稳性。李子奈曾指出,一些非平稳的经济时间序列往往表现出共同的变化趋势,而这些序列间本身不一定有直接的关联,此时,对这些数据进行回归,尽管有较高的R平方,但其结果是没有任何实际意义的。这种情况称为称为虚假回归或伪回归(spurious regression)。他认为平稳的真正含义是:一个时间序列剔除了不变的均值(可视为截距)和时间趋势以后,剩余的序列为零均值,同方差,即白噪声。因此单位根检验时有三种检验模式:既有趋势又有截距、只有截距、以上都无。 因此为了避免伪回归,确保估计结果的有效性,我们必须对各面板序列的平稳性进行检验。而检验数据平稳性最常用的办法就是单位根检验。首先,我们可以先对面板序列绘制时序图,以粗略观测时序图中由各个观测值描出代表变量的折线是否含有趋势项和(或)截距项,从而为进一步的单位根检验的检验模式做准备。单位根检验方法的文献综述:在非平稳的面板数据渐进过程中,Levin andLin(1993)很早就发现这些估计量的极限分布是高斯分布,这些结果也被应用在有异方差的面板数据中,并建立了对面板单位根进行检验的早期版本。后来经过Levin et al.(2002)的改进,提出了检验面板单位根的LLC法。Levin et al.(2002)指出,该方法允许不同截距和时间趋势,异方差和高阶序列相关,适合于中等维度(时间序列介于25~250之间,截面数介于10~250之间)的面板单位根检验。Im et al.(1997)还提出了检验面板单位根的IPS法,但Breitung(2000)发现IPS法对限定性趋势的设定极为敏感,并提出了面板单位根检验的Breitung法。Maddala and Wu(1999)又提出了ADF-Fisher和PP-Fisher面板单位根检验方法。 由上述综述可知,可以使用LLC、IPS、Breintung、ADF-Fisher和PP-Fisher5种方法进行面板单位根检验。 其中LLC-T、BR-T、IPS-W、ADF-FCS、PP-FCS、H-Z分别指Levin,Lin&Chu t*

科研常用的实验数据分析与处理方法

科研常用的实验数据分析与处理方法 对于每个科研工作者而言,对实验数据进行处理是在开始论文写作之前十分常见的工作之一。但是,常见的数据分析方法有哪些呢?常用的数据分析方法有:聚类分析、因子分析、相关分析、对应分析、回归分析、方差分析。 1、聚类分析(Cluster Analysis) 聚类分析指将物理或抽象对象的集合分组成为由类似的对象组成的多个类的分析过程。聚类是将数据分类到不同的类或者簇这样的一个过程,所以同一个簇中的对象有很大的相似性,而不同簇间的对象有很大的相异性。聚类分析是一种探索性的分析,在分类的过程中,人们不必事先给出一个分类的标准,聚类分析能够从样本数据出发,自动进行分类。聚类分析所使用方法的不同,常常会得到不同的结论。不同研究者对于同一组数据进行聚类分析,所得到的聚类数未必一致。 2、因子分析(Factor Analysis) 因子分析是指研究从变量群中提取共性因子的统计技术。因子分析就是从大量的数据中寻找内在的联系,减少决策的困难。因子分析的方法约有10多种,如重心法、影像分析法,最大似然解、最小平方法、阿尔发抽因法、拉奥典型抽因法等等。这些方法本质上大都属近似方法,是以相关系数矩阵为基础的,所不同的是相关系数矩阵对角线上的值,采用不同的共同性□2估值。在社会学研究中,因子分析常采用以主成分分析为基础的反覆法。

3、相关分析(Correlation Analysis) 相关分析(correlation analysis),相关分析是研究现象之间是否存在某种依存关系,并对具体有依存关系的现象探讨其相关方向以及相关程度。相关关系是一种非确定性的关系,例如,以X和Y 分别记一个人的身高和体重,或分别记每公顷施肥量与每公顷小麦产量,则X与Y显然有关系,而又没有确切到可由其中的一个去精确地决定另一个的程度,这就是相关关系。 4、对应分析(Correspondence Analysis) 对应分析(Correspondence analysis)也称关联分析、R-Q 型因子分析,通过分析由定性变量构成的交互汇总表来揭示变量间的联系。可以揭示同一变量的各个类别之间的差异,以及不同变量各个类别之间的对应关系。对应分析的基本思想是将一个联列表的行和列中各元素的比例结构以点的形式在较低维的空间中表示出来。 5、回归分析 研究一个随机变量Y对另一个(X)或一组(X1,X2,…,Xk)变量的相依关系的统计分析方法。回归分析(regression analysis)是确定两种或两种以上变数间相互依赖的定量关系的一种统计分析方法。运用十分广泛,回归分析按照涉及的自变量的多少,可分为一

大数据分析的六大工具介绍

大数据分析的六大工具介绍 2016年12月 一、概述 来自传感器、购买交易记录、网络日志等的大量数据,通常是万亿或EB的大小,如此庞大的数据,寻找一个合适处理工具非常必要,今天我们为大家分学在大数据处理分析过程中六大最好用的工具。 我们的数据来自各个方面,在面对庞大而复杂的大数据,选择一个合适的处理工具显得很有必要,工欲善其事,必须利其器,一个好的工具不仅可以使我们的工作事半功倍,也可以让我们在竞争日益激烈的云计算时代,挖掘大数据价值,及时调整战略方向。 大数据是一个含义广泛的术语,是指数据集,如此庞大而复杂的,他们需要专门设il?的硬件和软件工具进行处理。该数据集通常是万亿或EB的大小。这些数据集收集自各种各样的来源:传感器、气候信息、公开的信息、如杂志、报纸、文章。大数据产生的其他例子包括购买交易记录、网络日志、病历、事监控、视频和图像档案、及大型电子商务。大数据分析是在研究大量的数据的过程中寻找模式, 相关性和其他有用的信息,可以帮助企业更好地适应变化,并做出更明智的决策。 二.第一种工具:Hadoop Hadoop是一个能够对大量数据进行分布式处理的软件框架。但是Hadoop是 以一种可黑、高效、可伸缩的方式进行处理的。Hadoop是可靠的,因为它假设计算元素和存储会失败,因此它维护多个工作数据副本,确保能够针对失败的节点重新分布处理。Hadoop 是高效的,因为它以并行的方式工作,通过并行处理加快处理速度。Hadoop还是可伸缩的,能够处理PB级数据。此外,Hadoop依赖于社区服务器,因此它的成本比较低,任何人都可以使用。

Hadoop是一个能够让用户轻松架构和使用的分布式计算平台。用户可以轻松地 在Hadoop上开发和运行处理海量数据的应用程序。它主要有以下儿个优点: ,高可黑性。Hadoop按位存储和处理数据的能力值得人们信赖。,高扩展性。Hadoop是 在可用的计?算机集簇间分配数据并完成讣算任务 的,这些集簇可以方便地扩展到数以千计的节点中。 ,高效性。Hadoop能够在节点之间动态地移动数据,并保证各个节点的动 态平衡,因此处理速度非常快。 ,高容错性。Hadoop能够自动保存数据的多个副本,并且能够自动将失败 的任务重新分配。 ,Hadoop带有用Java语言编写的框架,因此运行在Linux生产平台上是非 常理想的。Hadoop上的应用程序也可以使用其他语言编写,比如C++。 第二种工具:HPCC HPCC, High Performance Computing and Communications(高性能计?算与通信)的缩写° 1993年,山美国科学、工程、技术联邦协调理事会向国会提交了“重大挑战项 U:高性能计算与通信”的报告,也就是被称为HPCC计划的报告,即美国总统科学战略项U ,其U的是通过加强研究与开发解决一批重要的科学与技术挑战 问题。HPCC是美国实施信息高速公路而上实施的计?划,该计划的实施将耗资百亿 美元,其主要U标要达到:开发可扩展的计算系统及相关软件,以支持太位级网络 传输性能,开发千兆比特网络技术,扩展研究和教育机构及网络连接能力。

16种常用数据分析方法

一、描述统计描述性统计是指运用制表和分类,图形以及计筠概括性数据来描述数据的集中趋势、离散趋势、偏度、峰度。 1、缺失值填充:常用方法:剔除法、均值法、最小邻居法、比率回归法、决策 树法。 2、正态性检验:很多统计方法都要求数值服从或近似服从正态分布,所以之前需要进行正态性检验。常用方法:非参数检验的K-量检验、P-P图、Q-Q图、W 检验、动差法。 二、假设检验 1、参数检验 参数检验是在已知总体分布的条件下(一股要求总体服从正态分布)对一些主要的参数(如均值、百分数、方差、相关系数等)进行的检验。 1)U验使用条件:当样本含量n较大时,样本值符合正态分布 2)T检验使用条件:当样本含量n较小时,样本值符合正态分布 A 单样本t检验:推断该样本来自的总体均数卩与已知的某一总体均数卩0 (常为理论值或标准值)有无差别; B 配对样本t 检验:当总体均数未知时,且两个样本可以配对,同对中的两者在可能会影响处理效果的各种条件方面扱为相似; C 两独立样本t 检验:无法找到在各方面极为相似的两样本作配对比较时使用。 2、非参数检验 非参数检验则不考虑总体分布是否已知,常常也不是针对总体参数,而是针对总体的某些一股性假设(如总体分布的位罝是否相同,总体分布是否正态)进行检验。 适用情况:顺序类型的数据资料,这类数据的分布形态一般是未知的。 A 虽然是连续数据,但总体分布形态未知或者非正态; B 体分布虽然正态,数据也是连续类型,但样本容量极小,如10 以下; 主要方法包括:卡方检验、秩和检验、二项检验、游程检验、K-量检验等。 三、信度分析检査测量的可信度,例如调查问卷的真实性。 分类: 1、外在信度:不同时间测量时量表的一致性程度,常用方法重测信度 2、内在信度;每个量表是否测量到单一的概念,同时组成两表的内在体项一致性如何,常用方法分半信度。 四、列联表分析用于分析离散变量或定型变量之间是否存在相关。对于二维表,可进行卡 方检验,对于三维表,可作Mentel-Hanszel 分层分析列联表分析还包括配对计数资料的卡方检验、行列均为顺序变量的相关检验。 五、相关分析 研究现象之间是否存在某种依存关系,对具体有依存关系的现象探讨相关方向及相关程度。 1、单相关:两个因素之间的相关关系叫单相关,即研究时只涉及一个自变量和一个因变量; 2、复相关:三个或三个以上因素的相关关系叫复相关,即研究时涉及两个或两个以

面板数据分析简要步骤与注意事项面板单位根面板协整回归分析

面板数据分析简要步骤与注意事项 面板单位根—面板协整—回归分析) 步骤一:分析数据的平稳性(单位根检验) 按照正规程序,面板数据模型在回归前需检验数据的平稳性。李子奈曾指出,一些非平稳的经济时间序列往往表现出共同的变化趋势,而这些序列间本身不一定有直接的关联,此时,对这些数据进行回归,尽管有较高的R平方,但其结果是没有任何实 际意义的。这种情况称为称为虚假回归或伪回归( spurious regression )。他认为平稳的真正含义是:一个时间序列剔除了不变的均值(可视为截距)和时间趋势以后,剩余的序列为零均值,同方差,即白噪声。因此单位根检验时有三种检验模式:既有趋势又有截距、只有截距、以上都无。 因此为了避免伪回归,确保估计结果的有效性,我们必须对各面板序列的平稳性进行检验。而检验数据平稳性最常用的办法就是单位根检验。首先,我们可以先对面板序列绘制时序图,以粗略观测时序图中由各个观测值描出代表变量的折线是否含有趋势项和(或)截距项,从而为进一步的单位根检验的检验模式做准备。单位根检验方法的文献综述:在非平稳的面板数据渐进过程中 ,Levin andLin(1993) 很早就发现这些估计量的极限分布是高斯分布 , 这些结果也被应用在有异方差的面板数据中,并建立了对面板单位根进行检验的早期版本。后来经过Levin et al. (2002) 的改进, 提出了检验面板单位根的LLC法。Levin et al. (2002)指出,该方法允许不同截距和时间趋势,异方差和高阶序列相关,适合于中等维度(时间序列介于25?250之间,截面数介于10?250之间)的面板单位根检验。Im et al. (1997) 还提出了检验面板单位根的 IPS 法, 但 Breitung(2000) 发现 IPS 法对限定性趋势的设定极为敏感 , 并提出了面板单位根检验的 Breitung 法。Maddala and Wu(1999)又提出了 ADF-Fisher 和 PP-Fisher 面板单位根检验方法。 由上述综述可知,可以使用 LLC、IPS、Breintung 、ADF-Fisher 和 PP-Fisher5 种方法进行面板单位根检验。其中LLC-T 、BR-T、IPS-W 、ADF-FCS、PP-FCS、H-Z 分 别指 Levin, Lin & Chu t* 统计量、 Breitung t 统计量、 lm Pesaran & Shin W 统 量、计 ADF- Fisher Chi-square 统计量、PP-Fisher Chi-square 统计量、Hadri Z 统计 量,并且 Levin, Lin & Chu t* 统计量、 Breitung t 统计量的原假设为存在普通的单位根过程, lm Pesaran & Shin W 统计量、 ADF- Fisher Chi-square 统计量、 PP-Fisher Chi-square 统计量的原假设为存在有效的单位根过程, Hadri Z 统计量的检验原假设为不存在普通的单位根过程。 有时,为了方便,只采用两种面板数据单位根检验方法,即相同根单位根检验 LLC(Levin-Lin-Chu )检验和不同根单位根检验 Fisher-ADF 检验(注:对普通序列(非面板序列)的单位根检验方法则常用 ADF检验),如果在两种检验中均拒绝存在单位根的原假设则我 们说此序列是平稳的,反之则不平稳。 如果我们以 T(trend )代表序列含趋势项,以 I (intercept )代表序列含截距项, T&I 代表两项都含,N (none)代表两项都不含,那么我们可以基于前面时序图得出的结论,在单位根检验中选择相应检验模式。 但基于时序图得出的结论毕竟是粗略的,严格来说,那些检验结构均需一一检验。具体操作可以参照李子奈的说法:ADF检验是通过三个模型来完成,首先从含有截距和趋势项的模型开始,再检验只含截距项的模型,最后检验二者都不含的模型。并且认

数据分析系统—用户操作手册

数据分析系统 操作手册 目录 一、前言 (2) 1.1、编写目的 (2) 1.2、读者对象 (2) 二、系统综述 (3) 2.1、系统架构 (3) 2.1.1系统浏览器兼容 (3) 三、功能说明 (4) 3.1、登录退出 (4) 3.1.1、登录 (4) 3.1.2、退出 (4) 3.1.3、用户信息 (5) 3.2、仪表盘 (5) 3.2.1、报表选择 (6) 3.2.2、布局方式 (7) 3.2.3、仪表盘管理 (8) 3.2.4、单个报表 (10) 3.3、应用中心 (13) 3.3.1、数据搜索 (13) 3.4、策略配置 (39)

3.4.1、数据采集 (39) 3.4.2、报表 (46) 3.4.3、数据类型 (53) 3.4.4、预设搜索 (58) 3.5、系统管理 (61) 3.5.1、代理注册设置 (61) 3.5.2、用户角色 (62) 3.5.3、系统用户 (65) 四、附件 (67) 一、前言 1.1、编写目的 本文档主要介绍日志分析系统的具体操作方法。通过阅读本文档,用户可以熟练的操作本系统,包括对服务器的监控、系统的设置、各类设备日志源的配置及采集,熟练使用日志查询、日志搜索功能,并掌握告警功能并能通过告警功能对及日志进行定位及分析。 1.2、读者对象 系统管理员:最终用户

项目负责人:即所有负责项目的管理人员 测试人员:测试相关人员 二、系统综述 2.1、系统架构 系统主界面为所有功能点的入口点,通过主菜单可快速定位操作项。系统主要分为四大模块,分别为 1):仪表盘 2):应用中心 3):策略配置 4):系统管理 2.1.1系统浏览器兼容 支持的浏览器 IE版本IE8至IE11等版本 Chrome 36及以上版本 Google chrome(谷歌 浏览器) Firefox 30及以以上版本 Mozilla Firefox (火 狐浏览器)

数据分析软件和工具

以下是我在近三年做各类计量和统计分析过程中感受最深的东西,或能对大家有所帮助。当然,它不是ABC的教程,也不是细致的数据分析方法介绍,它只是“总结”和“体会”。由于我所学所做均甚杂,我也不是学统计、数学出身的,故本文没有主线,只有碎片,且文中内容仅为个人观点,许多论断没有数学证明,望统计、计量大牛轻拍。 于我个人而言,所用的数据分析软件包括EXCEL、SPSS、STATA、EVIEWS。在分析前期可以使用EXCEL进行数据清洗、数据结构调整、复杂的新变量计算(包括逻辑计算);在后期呈现美观的图表时,它的制图制表功能更是无可取代的利器;但需要说明的是,EXCEL毕竟只是办公软件,它的作用大多局限在对数据本身进行的操作,而非复杂的统计和计量分析,而且,当样本量达到“万”以上级别时,EXCEL的运行速度有时会让人抓狂。 SPSS是擅长于处理截面数据的傻瓜统计软件。首先,它是专业的统计软件,对“万”甚至“十万”样本量级别的数据集都能应付自如;其次,它是统计软件而非专业的计量软件,因此它的强项在于数据清洗、描述统计、假设检验(T、F、卡方、方差齐性、正态性、信效度等检验)、多元统计分析(因子、聚类、判别、偏相关等)和一些常用的计量分析(初、中级计量教科书里提到的计量分析基本都能实现),对于复杂的、前沿的计量分析无能为力;第三,SPSS主要用于分析截面数据,在时序和面板数据处理方面功能了了;最后,SPSS兼容菜单化和编程化操作,是名副其实的傻瓜软件。 STATA与EVIEWS都是我偏好的计量软件。前者完全编程化操作,后者兼容菜单化和编程化操作;虽然两款软件都能做简单的描述统计,但是较之 SPSS差了许多;STATA与EVIEWS都是计量软件,高级的计量分析能够在这两个软件里得到实现;STATA的扩展性较好,我们可以上网找自己需要的命令文件(.ado文件),不断扩展其应用,但EVIEWS 就只能等着软件升级了;另外,对于时序数据的处理,EVIEWS较强。 综上,各款软件有自己的强项和弱项,用什么软件取决于数据本身的属性及分析方法。EXCEL适用于处理小样本数据,SPSS、 STATA、EVIEWS可以处理较大的样本;EXCEL、SPSS适合做数据清洗、新变量计算等分析前准备性工作,而STATA、EVIEWS在这方面较差;制图制表用EXCEL;对截面数据进行统计分析用SPSS,简单的计量分析SPSS、STATA、EVIEWS可以实现,高级的计量分析用 STATA、EVIEWS,时序分析用EVIEWS。 关于因果性 做统计或计量,我认为最难也最头疼的就是进行因果性判断。假如你有A、B两个变量的数据,你怎么知道哪个变量是因(自变量),哪个变量是果(因变量)? 早期,人们通过观察原因和结果之间的表面联系进行因果推论,比如恒常会合、时间顺序。但是,人们渐渐认识到多次的共同出现和共同缺失可能是因果关系,也可能是由共同的原因或其他因素造成的。从归纳法的角度来说,如果在有A的情形下出现B,没有A的情形下就没有B,那么A很可能是B的原因,但也可能是其他未能预料到的因素在起作用,所以,在进行因果判断时应对大量的事例进行比较,以便提高判断的可靠性。 有两种解决因果问题的方案:统计的解决方案和科学的解决方案。统计的解决方案主要指运用统计和计量回归的方法对微观数据进行分析,比较受干预样本与未接受干预样本在效果指标(因变量)上的差异。需要强调的是,利用截面数据进行统计分析,不论是进行均值比较、频数分析,还是方差分析、相关分析,其结果只是干预与影响效果之间因果关系成立的必要条件而非充分条件。类似的,利用截面数据进行计量回归,所能得到的最多也只是变量间的数量关系;计量模型中哪个变量为因变量哪个变量为自变量,完全出于分析者根据其他考虑进行的预设,与计量分析结果没有关系。总之,回归并不意味着因果关系的成立,因果关系的判定或推断必须依据经过实践检验的相关理论。虽然利用截面数据进行因果判断显得勉强,但如果研究者掌握了时间序列数据,因果判断仍有可为,其

面板数据分析步骤

转载:面板数据分析的思路和Eviews操作: 面板数据一般有三种:混合估计模型;随机效应模型和固定效应模型。首先,第一步是作固定效应和随机效应模型的选择,一般是用Hausman检验。 如果你选用的是所有的企业,反映的是总体的效应,则选择固定效应模型,如果你选用的是抽样估计,则要作Hausman检验。这个可以在Eviews 5.1里头做。 H0:应该建立随机效应模型。 H1:应该建立固定效应模型。 先使用随机效应回归,然后做Hausman检验,如果是小概率事件,拒绝原假设则应建立固定效应模型,反之,则应该采用随机效应模型进行估计。 第二步,固定效应模型分为三种:个体固定效应模型、时刻固定效应模型和个体时刻固定效应模型(这三个模型的含义我就不讲了,大家可以参考我列的参考书)。如果我们是对个体固定,则应选择个体固定效用模型。但是,我们还需作个体固定效应模型和混合估计模型的选择。所以,就要作F值检验。相对于混合估计模型来说,是否有必要建立个体固定效应模型可以通过F检验来完成。 H0:对于不同横截面模型截距项相同(建立混合估计模型)。SSEr H1:对于不同横截面模型的截距项不同(建立时刻固定效应模型)。SSEu

F统计量定义为:F=[( SSEr - SSEu)/(T+k-2)]/[ SSEu/(NT-T-k)] 其中,SSEr,SSEu分别表示约束模型(混合估计模型的)和非约束模型(个体固定效应模型的)的残差平方和(Sum squared resid)。非约束模型比约束模型多了T–1个被估参数。需要指出的是:当模型中含有k 个解释变量时,F统计量的分母自由度是NT-T- k。通过对F统计量我们将可选择准确、最佳的估计模型。 在作回归是也是四步:第一步,先作混合效应模型:在cross-section 一栏选择None ,Period也是None;Weights是cross-section Weights,然后把回归结果的Sum squared resid值复制出来,就是SSEr 第二步:作个体固定效用模型:在cross-section 一栏选择Fixed ,Period也是None;Weights是cross-section Weights,然后把回归结果的Sum squared resid值复制出来,就是SSEu 第三步:根据公式F=[( SSEr - SSEu)/(T+k-2)]/[ SSEu/(NT-T-k)]。计算出结果。其中,T为年数,不管我们的数据是unbalance还是balance 看observations就行了,也即Total pool (balanced) observations:的值,但是如果是balance我们也可以计算,也即是每一年的企业数的总和。比如说我们研究10年,每一年又500加企业,则NT=10×500=5000。K为解释变量,不含被解释变量。 第四步,根据计算出来的结果查F值分布表。看是否通过检验。检验准则:当F> Fα(T-1, NT-T-k) , α=0.01,0.05或0.1时,拒绝原假设,则结论是应该建立个体固定效应模型,反之,接受原假设,则不能建立个体固定效应模型。

常用的数理统计及数据处理方法

常用的数理统计及数据处理方法 水泥厂生产中的质量控制和分析都是以数据为基础的技术活动。如果没有数据的定量分析,就无法形成明确的质量概念。因此,必须通过对大量数据的整理和分析,才能发现事物的规律性和生产中存在的问题,进而作出正确的判断并提出解决的方法。 第一节数理统计的有关概念 一、个体、母体与子样 在统计分析中,构成研究对象的每一个最基本的单位称为个体。 研究对象的所有个体的集合即全部个体称为母体或总体,它可以无限大,也可以是有限的,如一道工序或一批产品、半成品、成品,可根据需要加以选择。 进行统计分析,通常是从母体中随机地选择一部分样品,称为子样(又称样本)。用它来代表母体进行观察、研究、检验、分析,取得数据后加以整理,得出结论。取样只要是随机和足够的数量,则所得结论能近似地反映母体的客观实际。抽取样本的过程被称作抽样;依据对样本的检测或观察结果去推断总体状况,就是所谓的统计推断,也叫判断。 例如,我们可将一个编号水泥看成是母体,每一包水泥看成是个体,通过随机取样(连续取样或从20个以上不同部位取样),所取出的12kg检验样品可称为子样,通过检验分析,即可判断该编号水泥(母体)的质量状况。 二、数据、计量值与计数值 1,数据 通过测试或调查母体所得的数字或符号记录,称为数据。在水泥生产中,无任对原材料、半成品、成品的检验,还是水泥的出厂销售,都要遇到很多报表和数据,特别是评定水泥质量好坏时,更要拿出检验数据来说明,所以可用与质量有关的数据来反映产品质量的特征。 根据数据本身的特征、测试对象和数据来源的不同,质量检验数据可分为计量值和计算值两类。 2,计量值 凡具有连续性或可以利用各种计量分析一起、量具测出的数据。如长度、质量、温度、化学成分、强度等,多属于计量值数据。计量值也可以是整数,也可以是小数,具有连续性。

系统和数据分析

第一课SAS 系统简介 一.SAS 系统 1什么是SAS 系统 SAS 系统是一个模块化的集成软件系统。所谓软件系统就是一组在一起作业的计算机程序。 SAS 系统是一种组合软件系统。基本部分是Base SAS 软件 2 SAS 系统的功能 SAS 系统是大型集成应用软件系统,具有完备的以下四大功能: ●数据访问 ●数据管理 ●数据分析 ●数据显示 它是美国软件研究所(SAS Institute Inc.)经多年的研制于1976年推出。目前已被许多 国家和地区的机构所采用。SAS 系统广泛应用于金融、医疗卫生、生产、运输、通信、政府、科研和教育等领域。它运用统计分析、时间序列分析、运筹决策等科学方法进行质量管理、财务管理、生产优化、风险管理、市场调查和预测等等业务,并可将各种数据以灵活多样的各种报表、图形和三维透视的形式直观地表现出来。在数据处理和统计分析领域,SAS 系统一直被誉为国际上的标准软件系统。 3 SAS 系统的主要模块 SAS 系统包含了众多的不同的模块,可完成不同的任务,主要模块有: ●●●●●●●● ●●●SAS/BASE(基础)——初步的统计分析 SAS/STAT(统计)——广泛的统计分析 SAS/QC(质量控制)——质量管理方面的专门分析计算 SAS/OR(规划)——运筹决策方面的专门分析计算 SAS/ETS(预测)——计量经济的时间序列方面的专门分析计算 SAS/IML(距阵运算)——提供了交互矩阵语言 SAS/GRAPH(图形)——提供了许多产生图形的过程并支持众多的图形设备 SAS/ACCESS(外部数据库接口)——提供了与大多数流行数据库管理系统的方便接口并自身也能进行数据管理 SAS/ASSIST(面向任务的通用菜单驱动界面)——方便用户以菜单方式进行操作SAS/FSP(数据处理交互式菜单系统) SAS/AF(面向对象编程的应用开发工具) 另外SAS系统还将许多常用的统计方法分别集成为两个模块LAB和INSIGHT,供用户

16种常用的大数据分析报告方法汇总情况

一、描述统计 描述性统计是指运用制表和分类,图形以及计筠概括性数据来描述数据的集中趋势、离散趋势、偏度、峰度。 1、缺失值填充:常用方法:剔除法、均值法、最小邻居法、比率回归法、决策树法。 2、正态性检验:很多统计方法都要求数值服从或近似服从正态分布,所以之前需要进行正态性检验。常用方法:非参数检验的K-量检验、P-P图、Q-Q图、W检验、动差法。 二、假设检验 1、参数检验 参数检验是在已知总体分布的条件下(一股要求总体服从正态分布)对一些主要的参数(如均值、百分数、方差、相关系数等)进行的检验。 1)U验使用条件:当样本含量n较大时,样本值符合正态分布 2)T检验使用条件:当样本含量n较小时,样本值符合正态分布 A 单样本t检验:推断该样本来自的总体均数μ与已知的某一总体均数μ0 (常为理论值或标准值)有无差别; B 配对样本t检验:当总体均数未知时,且两个样本可以配对,同对中的两者在可能会影响处理效果的各种条件方面扱为相似;

C 两独立样本t检验:无法找到在各方面极为相似的两样本作配对比较时使用。 2、非参数检验 非参数检验则不考虑总体分布是否已知,常常也不是针对总体参数,而是针对总体的某些一股性假设(如总体分布的位罝是否相同,总体分布是否正态)进行检验。适用情况:顺序类型的数据资料,这类数据的分布形态一般是未知的。 A 虽然是连续数据,但总体分布形态未知或者非正态; B 体分布虽然正态,数据也是连续类型,但样本容量极小,如10以下; 主要方法包括:卡方检验、秩和检验、二项检验、游程检验、K-量检验等。 三、信度分析 检査测量的可信度,例如调查问卷的真实性。 分类: 1、外在信度:不同时间测量时量表的一致性程度,常用方法重测信度 2、在信度;每个量表是否测量到单一的概念,同时组成两表的在体项一致性如何,常用方法分半信度。 四、列联表分析 用于分析离散变量或定型变量之间是否存在相关。

面板数据的分析步骤

面板数据的分析步骤 面板数据的分析方法或许我们已经了解许多了,但是到底有没有一个基本的步骤呢?那些步骤是必须的?这些都是我们在研究的过程中需要考虑的,而且又是很实在的问题。面板单位根检验如何进行?协整检验呢?什么情况下要进行模型的修正?面板模型回归形式的选择?如何更有效的进行回归?诸如此类的问题我们应该如何去分析并一一解决?以下是我近期对面板数据研究后做出的一个简要总结,和大家分享一下,也希望大家都进来讨论讨论。 步骤一:分析数据的平稳性(单位根检验) 按照正规程序,面板数据模型在回归前需检验数据的平稳性。李子奈曾指出,一些非平稳的经济时间序列往往表现出共同的变化趋势,而这些序列间本身不一定有直接的关联,此时,对这些数据进行回归,尽管有较高的R平方,但其结果是没有任何实际意义的。这种情况称为称为虚假回归或伪回归(spurious regression)。他认为平稳的真正含义是:一个时间序列剔除了不变的均值(可视为截距)和时间趋势以后,剩余的序列为零均值,同方差,即白噪声。因此单位根检验时有三种检验模式:既有趋势又有截距、只有截距、以上都无。 因此为了避免伪回归,确保估计结果的有效性,我们必须对各面板序列的平稳性进行检验。而检验数据平稳性最常用的办法就是单位根检验。首先,我们可以先对面板序列绘制时序图,以粗略观测时序图中由各个观测值描出代表变量的折线是否含有趋势项和(或)截距项,从而为进一步的单位根检验的检验模式做准备。 单位根检验方法的文献综述:在非平稳的面板数据渐进过程中,Levin andLin(1993) 很早就发现这些估计量的极限分布是高斯分布,这些结果也被应用在有异方差的面板数据中,并建立了对面板单位根进行检验的早期版本。后来经过Levin et al. (2002)的改进,提出了检验面板单位根的LLC 法。Levin et al. (2002) 指出,该方法允许不同截距和时间趋势,异方差和高阶序列相关,适合于中等维度(时间序列介于25~250 之间,截面数介于10~250 之间) 的面板单位根检验。Im et al. (1997) 还提出了检验面板单位根的IPS 法,但Breitung(2000) 发现IPS 法对限定性趋势的设定极为敏感,并提出了面板单位根检验的Breitung 法。Maddala and Wu(1999)又提出了ADF-Fisher和PP-Fisher面板单位根检验方法。 由上述综述可知,可以使用LLC、IPS、Breintung、ADF-Fisher 和PP-Fisher5种方法进行面板单位根检验。 其中LLC-T 、BR-T、IPS-W 、ADF-FCS、PP-FCS 、H-Z 分别指Levin, Lin & Chu t* 统计量、Breitung t 统计量、lm Pesaran & Shin W 统计量、ADF- Fisher Chi-square统计量、PP-Fisher Chi-square 统计量、Hadri Z统计量,并且Levin, Lin & Chu t* 统计量、Breitung t统计量的原假设为存在普通的单位根过程,lm Pesaran & Shin W 统计量、ADF- Fisher Chi-square统计量、PP-Fisher Chi-square统计量的原假设为存在有效的单位根过程,Hadri Z统计量的检验原假设为不存在普通的单位根过程。 有时,为了方便,只采用两种面板数据单位根检验方法,即相同根单位根检验LLC (Levin-Lin-Chu)检验和不同根单位根检验Fisher-ADF检验(注:对普通序列(非面板序列)的单位根检验方法则常用ADF检验),如果在两种检验中均拒绝存在单位根的原假设则我们

数据分析经典语录汇总

数据分析经典语录汇总 【数据分析三字经】①学习:先了解,后深入;先记录,后记忆;先理论,后实践;先模仿,后创新;②方法:先思路,后方法;先框架,后细化;先方法,后工具;先思考,后动手; ③分析:先业务,后数据;先假设,后验证;先总体,后局部;先总结,后建议; 做数据分析首先是熟悉业务及行业知识,其次是分析思路清晰,再次才是方法与工具,切勿为了方法而方法,为工具而工具。 【数据分析的3点要求】第一,熟悉业务,不熟业务,分析的结果将脱离实际,业无从指导;第二,多思考,只有经常发问为什么是这样的?为什么不是那样的?只有这样才有突破点;第三,多动手,不动手,靠脑袋想是不够的,不要怕错,大不了错了重来。 数据分析不仅是个工具,而且是门艺术,优秀的数据分析师不光要懂业务、懂管理,懂分析、还要懂创意、懂设计、懂生活,所以数据分析师也是个艺术家。 【数据分析流程】首先明确分析目的,然后搭建分析体系,确定各个分析内容,进行数据搜集、数据处理、数据分析、数据展现逐步完成,最后检验是否达到分析目的! 【数据挖掘流程】①业务理解:清晰定义业务问题;②数据理解:有什么数据,数据质量心中有数;③数据准备:数据抽样、转换、缺失值处理等;③建模:选择和应用不同的模型技术,调整模型参数;④评估:对前面步骤进行评估;⑤部署:把数据挖掘成果送到相应人手中,并进行日常监测和维护、更新。 【以终为始的分析原则】我做这个数据分析的目的是什么?然后,再根据这个目标倒推应该从哪几个角度、指标进行分析。

【数据分析5步走】1、锁定分析目标,梳理思路,叫纸上谈兵;2、把杂乱的数据整理出图表报表,用数据探业务,叫自问数答;3、锁定核心抓重点,设定最终算法,叫挟天子以令诸侯;4、梳理重点发现,准备剧本开拍,接受PK,叫才辨无双;5、效果梳理,总结经验,叫内视反听。 【数据分析框架的重要性】问题的高效解决开始于将待解决问题的结构化,然后进行系统的假设和验证。分析框架可以帮助我们:1、以完整的逻辑形式结构化问题;2、把问题分解成相关联的部分并显示它们之间的关系;3、理顺思路、系统描述情形/业务;4、然后洞察什么是造成我们正在解决的问题的原因。 数据分析如果一开始数据分析方向就错了,所有努力都是徒劳,后果不堪设想。亲们,数据分析前先明确目的,再根据分析目的确定分析框架与内容,以及所采用的数据分析方法。【常用数据分析方法】:趋势分析:查看一段时间某一数据或者某一组的变动趋势,得出某一个业务上升、下降、平稳、波动等趋势信息;对比分析:自己和自己比,找趋势、规律;自己和别人比,找差异、问题。结构分析:拆字诀,子类目、属性值、新老会员、各个运营节点,都可拆。 【数据分析注意点】1、要注意每种统计分析方法的适用范围;2、使用不同的数据分析方法对同一问题进行解释,来互相验证结论的真伪,多次尝试;3、结果要使用通俗易懂的语言或图表进行描述;4、需要耐心和细致,不能出现任何疏漏,别一个老鼠害一锅汤;5、高级数据分析不一定是最好的,简单有效才是最好的。 【如何用数据看透问题】1、确定指标,看数值;2、问题还不够明确?将指标层层分解;3、只看数值还不能确定问题?多周期看趋势;4、问题初步明确了,找不到原因或者发力点?将统计对象分类,拆解为不同角度来观察;5、参考行业对比数据,如果有的话...而每一步具体怎么走,全靠业务理解!

面板数据分析方法步骤

1.面板数据分析方法步骤 面板数据的分析方法或许我们已经了解许多了,但是到底有没有一个基本的步骤呢?那些步骤是必须的?这些都是我们在研究的过程中需要考虑的,而且又是很实在的问题。面板单位根检验如何进行?协整检验呢?什么情况下要进行模型的修正?面板模型回归形式的选择?如何更有效的进行回归?诸如此类的问题我们应该如何去分析并一一解决?以下是我近期对面板数据研究后做出的一个简要总结,和大家分享一下,也希望大家都进来讨论讨论。 步骤一:分析数据的平稳性(单位根检验) 按照正规程序,面板数据模型在回归前需检验数据的平稳性。李子奈曾指出,一些非平稳的经济时间序列往往表现出共同的变化趋势,而这些序列间本身不一定有直接的关联,此时,对这些数据进行回归,尽管有较高的R平方,但其结果是没有任何实际意义的。这种情况称为虚假回归或伪回归(spurious regression)。他认为平稳的真正含义是:一个时间序列剔除了不变的均值(可视为截距)和时间趋势以后,剩余的序列为零均值,同方差,即白噪声。因此单位根检验时有三种检验模式:既有趋势又有截距、只有截距、以上都无。 因此为了避免伪回归,确保估计结果的有效性,我们必须对各面板序列的平稳性进行检验。而检验数据平稳性最常用的办法就是单位根检验。首先,我们可以先对面板序列绘制时序图,以粗略观测时序图中由各个观测值描出代表变量的折线是否含有趋势项和(或)截距项,从而为进一步的单位根检验的检验模式做准备。 单位根检验方法的文献综述:在非平稳的面板数据渐进过程中,Levin andLin(1993) 很早就发现这些估计量的极限分布是高斯分布,这些结果也被应用在有异方差的面板数据中,并建立了对面板单位根进行检验的早期版本。后来经过Levin et al. (2002)的改进,提出了检验面板单位根的LLC 法。Levin et al. (2002) 指出,该方法允许不同截距和时间趋势,异方差和高阶序列相关,适合于中等维度(时间序列介于25~250 之间,截面数介于10~250 之间) 的面板单位根检验。Im et al. (1997) 还提出了检验面板单位根的IPS 法,但Breitung(2000) 发现IPS 法对限定性趋势的设定极为敏感,并提出了面板单位根检验的Breitung 法。Maddala and Wu(1999)又提出了ADF-Fisher和PP-Fisher面板单位根检验方法。 由上述综述可知,可以使用LLC、IPS、Breintung、ADF-Fisher 和PP-Fisher5种方法进行面板单位根检验。 其中LLC-T 、BR-T、IPS-W 、ADF-FCS、PP-FCS 、H-Z 分别指Levin, Lin & Chu t* 统计量、Breitung t 统计量、lm Pesaran & Shin W 统计量、

大数据可视化分析平台介绍

大数据可视化分析平台 一、背景与目标 基于邳州市电子政务建设得基础支撑环境,以基础信息资源库(人口库、法人库、宏观经济、地理库)为基础,建设融合业务展示系统,提供综合信息查询展示、信息简报呈现、数据分析、数据开放等资源服务应用。实现市府领导及相关委办得融合数据资源视角,实现数据信息资源融合服务与创新服务,通过系统达到及时了解本市发展得综合情况,及时掌握发展动态,为政策拟定提供依据。 充分运用云计算、大数据等信息技术,建设融合分析平台、展示平台,整合现有数据资源結合政务大数据得分析能力与业务编排展示能力,以人口、法人、地理人口与地理法人与地理实现基础展示与分析,融合公安、交通、工业、教育、旅游等重点行业得数据综合分析,为城市管理、产业升级、民生保障提供有效支撑。 二、政务大数据平台 1、数据采集与交换需求:通过对各个委办局得指定业务数据进行汇聚,将分散得数据进行物理集中与整合管理,为实现对数据得分析提供数据支撑。将为跨机构得各类业务系统之间得业务协同,提供统一与集中得数据交互共享服务。包括数据交换、共享与ETL等功能。 2、海量数据存储管理需求:大数据平台从各个委办局得业务系统里抽取得数据量巨大,数据类型繁杂,数据需要持久化得存储与访问。不论就是结构化数据、半结构化数据,还就是非结构化数据,经过数据存储引擎进行建模后,持久化保存在存储系统上。存储系统要具备髙可靠性、快速查询能力。 3、数据计算分析需求:包括海量数据得离线计算能力、髙效即席数

据查询需求与低时延得实时计算能力。随着数据量得不断增加, 需要数据平台具备线性扩展能力与强大得分析能力,支撑不断增长得数据量,满足未来政务各类业务工作得发展需要,确保业务系统得不间断且有效地工作。 4、数据关联集中需求:对集中存储在数据管理平台得数据,通过正确得技术手段将这些离散得数据进行数据关联,即:通过分析数据间得业务关系,建立关键数据之间得关联关系,将离散得数据串联起来形成能表达更多含义信息集合,以形成基础库、业务库、知识库等数据集。 5、应用开发需求:依靠集中数据集,快速开发创新应用,支撑实际分析业务需要。 6、大数据分析挖掘需求:通过对海量得政务业务大数据进行分析与挖掘,辅助政务决策,提供资源配置分析优化等辅助决策功能,促进民生得发展。

实证研究论文数据分析方法详解

修订日:2010.12.8实证论文数据分析方法详解 (周健敏整理) 名称变量类型在SPSS软件中的简称(自己设定的代号) 变革型领导自变量1 zbl1 交易型领导自变量2 zbl2 回避型领导自变量3 zbl3 认同和内部化调节变量 TJ 领导成员交换中介变量 ZJ 工作绩效因变量 YB 调节变量:如果自变量与因变量的关系是变量M的函数,称变量M为调节变量。也就是, 领 导风格(自变量)与工作绩效(因变量)的关系受到组织认同(调节变量)的影 响,或组织认同(调节变量)在领导风格(自变量)对工作绩效(因变量)影响 关系中起到调节作用。具体来说,对于组织认同高的员工,变革型领导对工作绩 效的影响力,要高于组织认同低的员工。 中介变量:如果自变量通过影响变量N 来实现对因变量的影响,则称N 为中介变量。也就 是,领导风格(自变量)对工作绩效(因变量)影响作用是通过领导成员交换(中 介变量)的中介而产生的。 研究思路及三个主要部分组成: (1)领导风格对于员工工作绩效的主效应(Main Effects)研究。 (2)组织认同对于不同领导风格与员工工作绩效之间关系的调节效应(Moderating Effects)研究。 (3)领导成员交换对于不同领导风格与员工工作绩效之间关系的中介效应(Mediator Effects)研究。

目录 1.《调查问卷表》中数据预先处理~~~~~~~~~~~~~~ 3 1.1 剔除无效问卷~~~~~~~~~~~~~~~~~~~~ 3 1.2 重新定义控制变量~~~~~~~~~~~~~~~~~~ 3 2. 把Excel数据导入到SPSS软件中的方法~~~~~~~~~~ 4 3. 确认所有的变量中有无“反向计分”项~~~~~~~~~~~4 3.1 无“反向计分”题~~~~~~~~~~~~~~~~~~ 5 3.2 有“反向计分”题~~~~~~~~~~~~~~~~~~ 5 4. 效度分析~~~~~~~~~~~~~~~~~~~~~~~~6 5. 信度分析~~~~~~~~~~~~~~~~~~~~~~~~8 6. 描述统计~~~~~~~~~~~~~~~~~~~~~~~~9 7. 各变量相关系数~~~~~~~~~~~~~~~~~~~~ 12 7.1 求均值~~~~~~~~~~~~~~~~~~~~~~~12 7.2 相关性~~~~~~~~~~~~~~~~~~~~~~~12 8. 回归分析~~~~~~~~~~~~~~~~~~~~~~~13 8.1 使用各均值来分别求Z值~~~~~~~~~~~~~~~13 8.2 自变量Z值与调节变量Z值的乘积~~~~~~~~~~~13 8.3 进行回归运算~~~~~~~~~~~~~~~~~~~~14 8.3.1 调节作用分析~~~~~~~~~~~~~~~~~~14 8.3.2 中介作用分析~~~~~~~~~~~~~~~~~~18 8.4 调节作用作图~~~~~~~~~~~~~~~~~~~~22