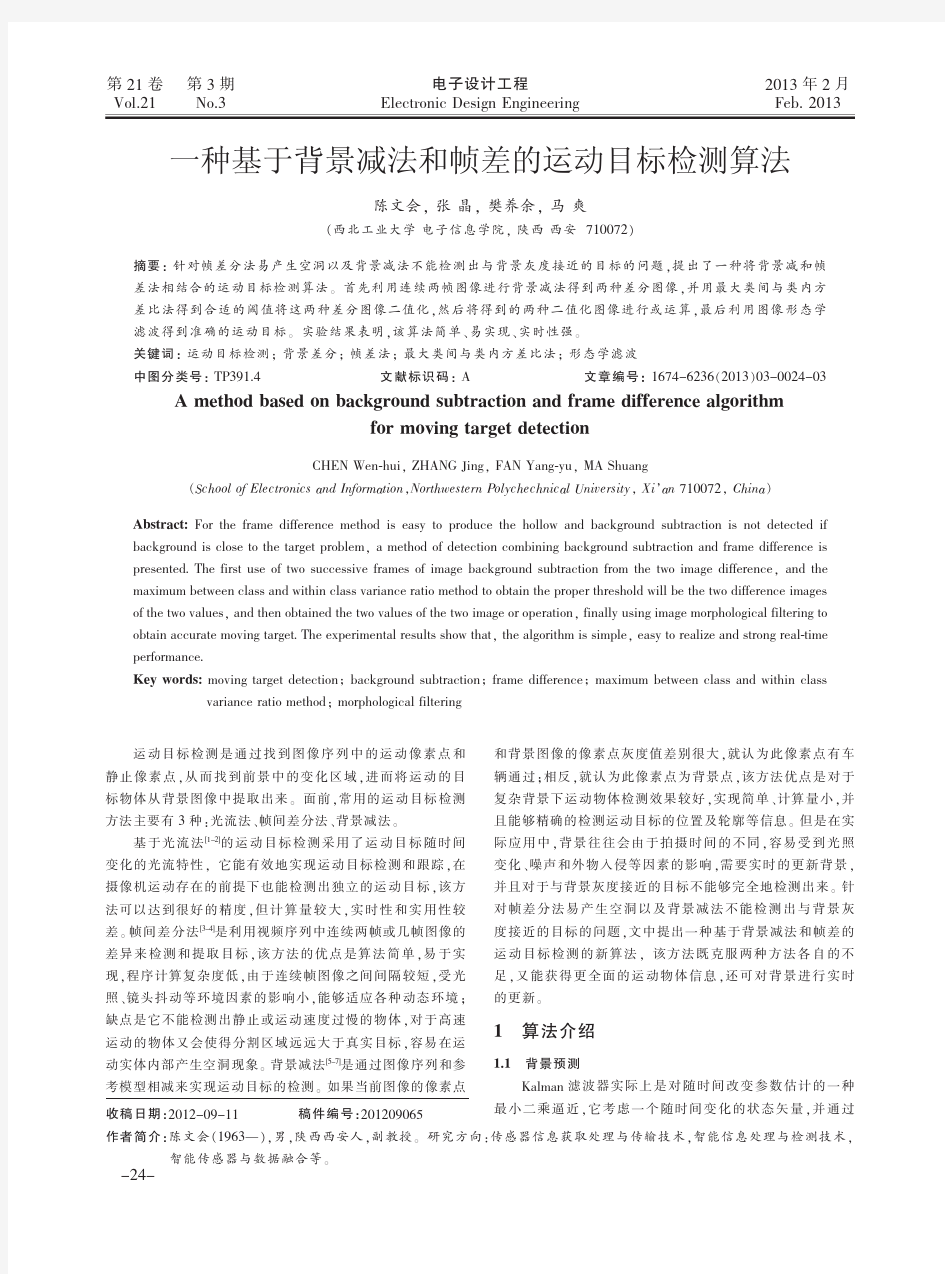

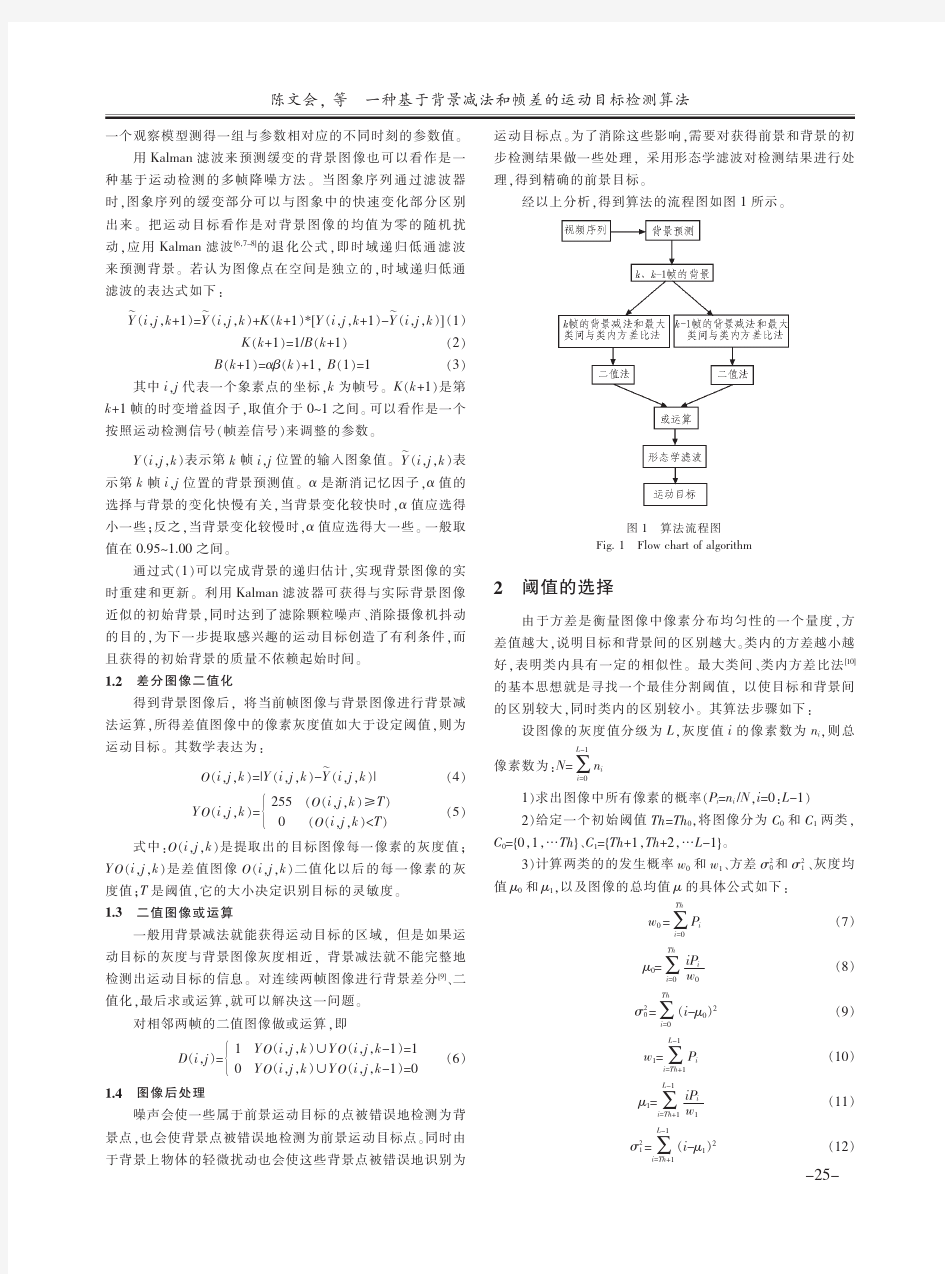

一种基于背景减法和帧差的运动目标检测算法

目标检测方法简要综述

龙源期刊网 https://www.360docs.net/doc/9c246177.html, 目标检测方法简要综述 作者:栗佩康袁芳芳李航涛 来源:《科技风》2020年第18期 摘要:目标检测是计算机视觉领域中的重要问题,是人脸识别、车辆检测、路网提取等领域的理论基础。随着深度学习的快速发展,与基于滑窗以手工提取特征做分类的传统目标检测算法相比,基于深度学习的目标检测算法无论在检测精度上还是在时间复杂度上都大大超过了传统算法,本文将简单介绍目标检测算法的发展历程。 关键词:目标检测;机器学习;深度神经网络 目标检测的目的可分为检测图像中感兴趣目标的位置和对感兴趣目标进行分类。目标检测比低阶的分类任务复杂,同时也是高阶图像分割任的重要基础;目标检测也是人脸识别、车辆检测、路网检测等应用领域的理论基础。 传统的目标检测算法是基于滑窗遍历进行区域选择,然后使用HOG、SIFT等特征对滑窗内的图像块进行特征提取,最后使用SVM、AdaBoost等分类器对已提取特征进行分类。手工构建特征较为复杂,检测精度提升有限,基于滑窗的算法计算复杂度较高,此类方法的发展停滞,本文不再展开。近年来,基于深度学习的目标检测算法成为主流,分为两阶段和单阶段两类:两阶段算法先在图像中选取候选区域,然后对候选区域进行目标分类与位置精修;单阶段算法是基于全局做回归分类,直接产生目标物体的位置及类别。单阶段算法更具实时性,但检测精度有损失,下面介绍这两类目标检测算法。 1 基于候选区域的两阶段目标检测方法 率先将深度学习引入目标检测的是Girshick[1]于2014年提出的区域卷积神经网络目标检测模型(R-CNN)。首先使用区域选择性搜索算法在图像上提取约2000个候选区域,然后使用卷积神经网络对各候选区域进行特征提取,接着使用SVM对候选区域进行分类并利用NMS 回归目标位置。与传统算法相比,R-CNN的检测精度有很大提升,但缺点是:由于全连接层的限制,输入CNN的图像为固定尺寸,且每个图像块输入CNN单独处理,无特征提取共享,重复计算;选择性搜索算法仍有冗余,耗费时间等。 基于R-CNN只能接受固定尺寸图像输入和无卷积特征共享,He[2]于2014年参考金字塔匹配理论在CNN中加入SPP-Net结构。该结构复用第五卷积层的特征响应图,将任意尺寸的候选区域转为固定长度的特征向量,最后一个卷积层后接入的为SPP层。该方法只对原图做一

运动目标检测光流法

摘要 运动目标检测方法是研究如何完成对视频图像序列中感兴趣的运动目标区域的“准确定位”问题。光流场指图像灰度模式的表面运动,它可以反映视频相邻帧之间的运动信息,因而可以用于运动目标的检测。MATLAB这种语言可移植性好、可扩展性强,再加上其中有丰富的图像处理函数,所以利用MATLAB 软件来用光流法对运动目标的检测中具有很大的优势。本设计主要可以借助matlab软件编写程序,运用Horn-Schunck算法对图像前后两帧进行处理,画出图像的光流场。而图像的光流场每个像素都有一个运动矢量,因此可以反映相邻帧之间的运动,分析图像的光流场就可以得出图像中的运动目标的运动情况。 关键字:光流法;Horn-Schunck算法;matlab

目录 1光流法的设计目的 (1) 2光流法的原理 (1) 2.1光流法的介绍 (1) 2.1.1光流与光流场的概念 (1) 2.1光流法检测运动目标的原理 (2) 2.1.1光流场计算的基本原理 (2) 2.2.2基于梯度的光流场算法 (2) 2.2.3Horn-Schunck算法 (3) 2.2.4光流法检测运动目标物体的基本原理概述 (5) 3光流法的程序具体实现 (6) 3.1源代码 (6) 3.1.1求解光流场函数 (6) 3.1.2求导函数 (9) 3.1.3高斯滤波函数 (9) 3.1.4平滑性约束条件函数 (10) 3.1.5画图函数 (10) 4仿真图及分析 (12) 结论 (13) 参考文献 (14)

1 光流法的设计目的 数字图像处理,就是用数字计算机及其他有关数字技术,对图像进行处理,以达到预期的目的。随着计算机的发展,图像处理技术在许多领域得到了广泛应用,数字图像处理已成为电子信息、通信、计算机、自动化、信号处理等专业的重要课程。 数字图像处理课程设计是在学习完数字图像处理的相关理论后,进行的综合性训练课程,其目的是:使学生进一步巩固数字图像处理的基本概念、理论、分析方法和实现方法;增强学生应用Matlab编写数字图像处理的应用程序及分析、解决实际问题的能力;尝试所学的内容解决实际工程问题,培养学生的工程实践能力。 运动目标检测是数字图像处理技术的一个主要部分,近些年来,随着多媒体技术的迅猛发展和计算机性能的不断提高,动态图像处理技术日益受到人们的青睞,并且取得了丰硕的成果,广泛应用于交通管理、军事目标跟踪、生物医学等领域。 因此,基于光流法,实现运动目标的检测是本文的研究对象。结合图书馆书籍、网上资料以及现有期刊杂志,初步建立起运动目标检测的整体思路和方法。 2 光流法的原理 2.1 光流法的介绍 2.1.1 光流与光流场的概念 光流是指空间运动物体在观测成像面上的像素运动的瞬时速度,它利用图像序列像素强度数据的时域变化和相关性来确定各自像素位置的“运动”,即反映图像灰度在时间上的变化与景物中物体结构及其运动的关系。将二维图像平面特定坐标点上的灰度瞬时变化率定义为光流矢量。视觉心理学认为人与被观察物体

三帧差分法

三帧差分法的问题 大家帮忙看看这个三帧差分法的代码哪里出了问题?参照论坛上的相邻帧差法,改造成三帧差分法。 clc; clear; targetavi='SampleVideo.avi'; %%原始视频 resultavi='result.avi'; %%检测结果视频%%%%%%%%%%%%%%%%%%%%%%读取视频 mov=aviread(targetavi); %mov=mmreader(targetavi); fnum=size(mov,2); %%%%%%%%%%%%%%%%%%%%%%建立结果视频 aviobj = avifile(resultavi); aviobj.Quality = 100; aviobj.Fps = 15; %https://www.360docs.net/doc/9c246177.html,pression='Indeo5'; https://www.360docs.net/doc/9c246177.html,pression='None'; %%%%%%%%%%%%%%%%%%%%%%帧间差分法 for i=2:fnum x=mov(i-1).cdata(:,:,:); y=mov(i).cdata(:,:,:); z=mov(i+1).cdata(:,:,:); m=rgb2gray(x); m=medfilt2(m); n=rgb2gray(y); n=medfilt2(n); o=rgb2gray(z); o=medfilt2(o); q=im2double(n); w=im2double(m); p=im2double(o); c=q-w;%%前两帧差分 b=p-q;%%后两帧差分 t=40; %%阈值,此值可以调节 t=t/256;%%转化为double型数据 k=find(abs(c)>=t);%%find函数作用是找到图c中的值大于t的点坐标

人体目标检测与跟踪算法研究

人体目标检测与跟踪算法研究 摘要:近些年以来,基于视频中人体目标的检测与跟踪技术研究越来越被重视。然而,由于受到目标自身特征多样性和目标所处环境的复杂性和不确定性的影响,现存算法的性能受到很大的限制。本文对目前所存在的问题进行了分析,并提出了三帧差分法和改进阈值分割法相结合的运动目标检测算法和多特征融合的改进运动目标跟踪算法。这两种算法不仅可以准确有效的检测出运动目标而且能够满足实时性的要求,有效的解决了因光照变化和目标遮挡等情况造成的运动目标跟踪准确度下降或跟踪目标丢失等问题。 关键词:三帧差分,Camshift,阈值分割 Research Based on Human Target Detectionand Tracking Algorithm Abstract: In recent years, human object detection and tracking become more and more important. However the complexity, uncertainty environment and the target’s own diversity limit the performance of existing algorithms. The main works of this paper is to study and analysis the main algorithm of the human object detection and tracking, and proposes a new moving target detection method based on three-frame difference method and threshold segmentation and improved Camshift tracking algorithm based on multi-feature fusion. These algorithm can satisfy the real-time, while accurately and efficiently detect moving targets, and also effectively solves the problem of tracking object lost or misplaced under illumination change or target occlusion. Keywords: three-frame difference, Camshift, threshold segmentation 一、绪论 (一)选题的背景和意义 人类和动物主要通过眼睛来感受和认知外部世界。人类通过视觉所获取的信息占了60%[1],因此,在开发和完善人工智能的过程中,赋予机器视觉的功能这一操作极不可缺少。完善上述功能需要以许多技术为基础,特别是运动目标的检测与跟踪技术。近些年以来,此技术受到了越来越多的关注[2]。目前,此技术也在各领域得到了充分的应用,涵盖的领域有智能交通、导航、智能视频监控、精确制导、人机交互和多媒体视频编码压缩技术等。

帧差法代码讲课稿

% By lyqmath @ Matlab中文论坛 clc; clear all; close all; avi = mmreader('samplevideo.avi'); for i = 1 : avi.NumberOfFrames img = read(avi, i); pixels(:, :, :, i) = img; figure(1); imshow(img, []); text(1, 15, sprintf('原视频:%d帧By lyqmath', i), 'FontWeight', 'Bold', 'Color', 'r'); end tracking(pixels); function d = tracking(video) if ischar(video) % 载入视频数据 for i = 1 : avi.NumberOfFrames img = read(avi, i); pixels(:, :, :, i) = img; end else pixels = video; end nFrames = size(pixels, 4); rows = size(pixels, 1); cols = size(pixels, 2); % 转换成灰度图像 for i = 1 : nFrames pixel(:, :, i) = (rgb2gray(pixels(:,:,:,i))); end for i = 2 : nFrames d(:, :, i) = (abs(pixel(:,:,i) - pixel(:,:,i-1))); bw(:, :, i) = im2bw(d(:, :, i), 0.2); % 寻找上下边界 cou=1; for h = 1:rows for w = 1:cols if bw(h, w, i) > 0.5 bottomEdge = h; if cou == 1 topEdge = bottomEdge; end cou = cou+1; break;

基于背景减法和帧差法的运动目标检测算法研究

分类号:密级 硕士学位论 文 论文题 目:基于背景减法和帧差法的运动目标检测算法研 究 研究方向图像处理 专业名称通信与信息系统 研究生姓名余启明 导师姓名、职称任克强教授 2013年6月5日 江西?赣州

运动目标检测是计算机视觉领域的一个重要课题,在航空航天、视频监控以及智能交通等领域有着广泛的应用前景。研究视频图像序列中运动目标检测算法具有重要的理论价值和实践意义。本文在分析几种常见运动目标检测算法的基础上,着重研究了背景减法和帧差法。本文所做的主要工作如下: (1)分析了运动目标检测的应用背景、研究现状和目标检测中要用到的一些视频图像处理理论。对视频序列中常用的光流法、帧差法和背景减法等运动目标检测算法进行研究,分别介绍了它们的基本原理和一些改进算法。特别是针对背景减法,分析了常见的几种背景减法的建模方法。 ⑵在分析现有背景建模方法的基础之上,发现采用传统混合高斯模型建模进行目标检测时,其学习速率不可根据背景的改变而改变,影响了背景的更新效率,本文提出了一种改进的运动目标检测算法。改进的算法把学习速率分成背景建模初期和背景形成以后这两个阶段,在这两个阶段里均采用自适应的学习速率,使得模型可以更即时地更新,从而能够及时更新背景,消除运动目标的残影,提高检测准确率。实验结果表明,本文算法可以更准确地检测出运动目标,较好地消除阴影,并具有较好的自适应性和稳健性。 ⑶在分析传统帧差法进行目标检测的基础之上,针对运动目标颜色与背景灰度值相似情况下出现检测的目标轮廓不完整的问题,本文进行了改进。先用改进的帧差法进行运动目标检测,再将Canny算子作用于此目标,以提取出边缘信息,最后将目标边缘与原目标取“或”操作。此方法能够较好地解决运动目标和背景颜色差别较小时,检测的运动目标轮廓不完整的问题,从而得到更加准确的运动目标。实验结果表明,本文提出的改进的基于边缘检测与帧差法的运动目标检测算法可用于比较复杂的环境,对目标色彩的局限性小,具有较好的实用性。 关键词:目标检测;背景减法;混合高斯模型;边缘检测;帧差法 Abstract The detection of moving targets is an important topic in the field of computer vision, and has a wide range of applications in the aerospace, video surveillance, intelligent transportation and other fields. Studying moving target detection algorithm of video image sequence has important theoretical value and practical significance. This paper focuses on the analysis of several common moving target detection algorithms which based on background subtraction and frame difference. The main work of this paper is as follows: (1)Analyzed the background of moving object detection, the current situation and video image processing theory of target detection. Studied three moving target detection algorithms, which are optical flow method, the frame difference method and background subtraction. The principles of these algorithms and improved algorithms are analyzed. At last, this paper studied the modeling methods of the background subtraction. (2)The fixed learning rate is adopted by traditional Gaussian mixture model, in other words,

目标检测算法

function MovingTargetDetectionByMMI() %Moving Target Detection %Based on Maximun Mutual Information % %EDIT BY PSL@CSU %QQ:547423688 %Email:anyuezhiji@https://www.360docs.net/doc/9c246177.html, %2012-06-01 %读文件 Im1=imread('001.jpg'); Im2=imread('002.jpg'); Im3=imread('003.jpg'); Im1=rgb2gray(Im1); Im2=rgb2gray(Im2); Im3=rgb2gray(Im3); tic; d12=GetDifferenceImg(Im2,Im1); d23=GetDifferenceImg(Im2,Im3); d=d12.*d23; se =; for i=1:4 d = imfilter(d,se); end for i=1:2 d = medfilt2(d,); end %%d=abs((d12-d23).^0.7); d=uint8(d/max(max(d))*255); level = graythresh(d); BW = im2bw(d,level); s=regionprops(BW,'BoundingBox'); figure(1)

subplot(2,2,1); imshow(uint8(d12/max(max(d12))*255)); title('参考帧与前一帧的差值') subplot(2,2,2); imshow(uint8(d23/max(max(d23))*255)); title('参考帧与后一帧的差值') subplot(2,2,3); imshow(BW); title('由前后帧得出的差值') subplot(2,2,4); imshow(Im2); %imshow(d); rectangle('Position',s(1).BoundingBox,'Curvature',,'LineWidth',2,'LineStyle','--','EdgeColor', 'r') title('参考帧与检测结果') %求相邻两帧重合部分差值主函数 function outImg=GetDifferenceImg(R,F) =dwt2(R,'db1'); =dwt2(F,'db1'); CA1=uint8(CA1); CA2=uint8(CA2); fprintf('\n------PSO start\n'); =PSO(CA1,CA2); while mi<1.2 =PSO(CA1,CA2); end fprintf('tx:%f ty:%f ang:%f mi:%f\n',pa(1),pa(2),pa(3),mi); fprintf('------PSO end\n\n'); %pa=; fprintf('------Powell start\n'); mi_old=0; while abs(mi-mi_old)>0.01

运动序列目标检测算法研究及 DSP 实现

运动序列目标检测算法研究及DSP实现 李文艳,王月琴,张笑微 (西南科技大学信息工程学院四川绵阳621010) 摘要:由于实际场景的多样性,目前常用的运动目标检测算法都还存在一定程度的缺陷,因此本文提出了一种将帧差法和背景减法相结合的方法,实现快速精确地检测和提取运动目标。实验结果表明,本方法是比较实用的,能较好满足实时视频监控系统的要求。最后将程序移植到基于DSP的平台上,进行相应的优化后基本满足了实时性的要求。 关键词:目标检测;帧差法;背景减法 中图分类号:TP751.1 文献标识码:A Algorism Research of Moving Object Detection and DSP Implementation LI Wen-yan,WANG Yue-qin,ZHANG Xiao-wei (Southwest University of Science and Technology Mianyang Sichuan China 621010) Abstract: Because of the environment’s variety, the methods that have been used for moving object detection need to be improved. An algorithm based on two consecutive frames subtraction and background subtraction is presented and it can detect and extract object quickly and accurately. The results show that the proposed method is a practical one. It can meet the need of the real time video surveillance and monitoring system. The coding is transplanted in DSP, and the project is executed successfully on CCS simulator. Keywords: Object detection; Frames subtraction; Background subtraction 引言 运动目标的检测在智能监控等领域中得到了广泛的应用。运动目标的检测就是从视频流中去除静止背景提取出运动的目标,运动目标的有效分割对跟踪等后期处理非常关键。 本文提出了将帧间差分和背景减法相结合的方法。首先选取一帧作为背景帧, 建立各像素点的高斯模型。再运用帧间差分法对相邻两帧图像进行差分处理, 区分出背景点和变化的区域。然后将变化区域与背景帧的对应区域进行模型拟合区分出显露区和运动物体。 1 运动目标检测算法总体流程 采用帧间差分与背景减法相结合的算法进行运动目标检测,包括运动目标的检测和将检测到的运动目标从背景中分割出来两部分,其系统框架流程图如图1所示。 图1 运动目标检测流程图 这种设计充分利用了被检测区域部分时间静止的特点,具有智能检测的功能,它只在检

运动目标检测方法总结报告

摘要 由于计算机技术的迅猛发展,使得基于内容的视频信息的存取、操作和检索不仅成为一种可能,更成为一种需要。同时,基于内容的视频编码标准MPEG-4和基于内容的视频描述标准MPEG-7正在发展和完善。因此提取和视频中具有语义的运动目标是一个急需解决的问题。运动目标提取和检测作为视频和图像处理领域的重要研究领域,有很强的研究和应用价值。运动检测就是将运动目标从含有背景的图像中分离出来,如果仅仅依靠一种检测算法,难以从复杂的自然图像序列中完整地检测出运动的目标。较高的检测精度和效率十分重要,因此融合多种检测方法的研究越来越受到重视。本文介绍了几种国内外文献中的经典的视频运动目标的检测和提取算法,并对各种方法进行了评价和总结。首先介绍了基本的运动目标检测的基本知识和理论,然后介绍了基本的几种目标检测方法及其各种改进方法。对今后的运动目标检测提取的相关研究提供一定的参考。 关键词:运动目标检测光流法帧差法背景建模方法

ABSTRACT Because of the rapid development of computer technology, it is possible to access, operate and retrieve the video information based on the content of the video. At the same time, based on the content of the video coding standard MPEG-4 and content-based video description standard MPEG-7 is developing and improving. Therefore, it is an urgent problem to be solved in the extraction and video. Moving object extraction and detection is a very important field of video and image processing, and has a strong research and application value. Motion detection is to separate moving objects from the image containing background, if only rely on a detection algorithm, it is difficult to from a complex natural image sequences to detect moving target. Higher detection accuracy and efficiency are very important, so the study of the fusion of multiple detection methods is becoming more and more important. In this paper, the detection and extraction algorithms of the classical video moving objects in the domestic and foreign literatures are introduced, and the methods are evaluated and summarized. Firstly, the basic knowledge and theory of basic moving target detection is introduced, and then the basic method of target detection is introduced. To provide a reference for the research on the extraction of moving target detection in the future. Keywords: Visual tracking Optical flow method Frame Difference Background modeling method

帧差法目标识别

本文展示了一种自动识别视频中移动目标的方法。论文中提取移动目标通过帧序列,这种方法不需要先验知识,比如:时间阈值调整。基于相邻帧的连续对称差分,我们能得到全分辨率显著图;然后利用最大熵方法计算阈值决定候选区域和获得兴趣点的种子;最后用修改的模糊生长方法获得最终的结果。本文中提出的算法是有效的、具有鲁棒性的。实验结果也证明它具有很好的效果。 移动目标检测在计算机视觉中有广泛应用,但是在研究过程中也有很多 挑战。通常目标检测方法被分为三类: (1)基于时间信息。例如:帧差法能很快检测出目标,但很难得到整个物体的轮廓,并且易受背景的影响。 (2)基于空间信息的。 (3)基于时间和空间信息的。有较好的效果,计算复杂度高。 本文提出了一种基于时间信息的方法。 (1)通过相邻帧对称差分获得显著图; (2)使用最大熵模型得到一个阈值去二值化时间显著图和获得候选区域。然后选择候选区域最显著的点作为兴趣种子点。 (3)对于每一兴趣种子点,在显著图上应用模糊生长方法直到没有点能被聚集和能获得移动物体的轮廓 A.移动显著图的产生 ①获得一段连续帧 ②相邻帧做差分得到移动目标。 ③对得到的差分显著图做开运算。作用:消除小的和亮的细节。 ④为了去除噪声和背景运动的影响,对差分得到的显著图做和再平均 。 B.兴趣种子选择 由于图像是连续变化的,一个固定的阈值不能很好的二值化显著图,本文采用最大熵方法得到一个变化的阈值去二值化显著图和提取候选兴趣区域。然后选择兴趣种子点。

C.移动目标检测 为了提取移动的目标,本论文应用模糊生长方法去使兴趣点的种子生长成一 片区域。如果像素值满足下列条件,对兴趣点的种子使用模糊生长算法。a和u表示如下图 实验 数据集:PETS2000, PETS2001 and Dataset2014 设备:The algorithm is implemented with C++ on a personal computer with Core i3 3.3 GHz CPU and 2G RAM. 评价标准: 假负率(False Negative Rate , FNR) :FNR = FN /(TP + FN) ,即被预测为负的正样本结果数/正样本实际数 假正率(False Positive Rate , FPR) :FPR = FP /(FP + TN) ,即被预测为正的负样本结果数 /负样本实际数 Specificity (负例的覆盖率,True Negative Rate) =正确预测到的负例个数/实际负例总数 PBC :Percentage of Bad Classifications 召回率(Re、recall):预测为真实正例除以所有真实正例样本的个数 准确率(Precision) :预测为真实正例除以所有被预测为正例样本的个数 F-measure:查准率和查全率的调和平均值, 更接近于P, R两个数较小的那个: F=2* P* R/(P + R) 实验结果如下图

图像显著性目标检测算法研究

图像显著性目标检测算法研究 随着移动电子设备的不断升级与应用,使用图像来记录或表达信息已成为一种常态。我们要想快速地在海量图像中提取出有价值的信息,那么需要模拟人类视觉系统在机器视觉系统进行计算机视觉热点问题的研究。 图像显著性目标检测对图像中最引人注意且最能表征图像内容的部分进行检测。在图像显著性目标检测任务中,传统的方法一般利用纹理、颜色等低层级视觉信息自下向上地进行数据驱动式检测。 对于含有单一目标或高对比度的自然场景图像,可以从多个角度去挖掘其显著性信息,如先验知识、误差重构等。然而,对于那些具有挑战性的自然场景图像,如复杂的背景、低对比度等,传统的方法通常会检测失败。 基于深度卷积神经网络的算法利用高层级语义信息结合上下文充分挖掘潜在的细节,相较于传统的方法已取得了更优越的显著性检测性能。本文对于图像显著性检测任务存在的主要问题提出了相应的解决方法。 本文的主要贡献如下:为充分挖掘图像多种显著性信息,并使其能够达到优势互补效果,本文提出了一种有效的模型,即融合先验信息和重构信息的显著性目标检测模型。重构过程包括密度重构策略与稀疏重构策略。 密度重构其优势在于能够更准确地定位存在于图像边缘的显著性物体。而稀疏重构更具鲁棒性,能够更有效地抑制复杂背景。 先验过程包含背景先验策略与中心先验策略,通过先验信息可更均匀地突出图像中的显著性目标。最后,把重构过程与先验过程生成的显著特征做非线性融合操作。 实验结果充分说明了该模型的高效性能与优越性能。针对图像中存在多个显

著性目标或者检测到的显著性目标存在边界模糊问题,本文提出了一种基于多层级连续特征细化的深度显著性目标检测模型。 该模型包括三个阶段:多层级连续特征提取、分层边界细化和显著性特征融合。首先,在多个层级上连续提取和编码高级语义特征,该过程充分挖掘了全局空间信息和不同层级的细节信息。 然后,通过反卷积操作对多层级特征做边界细化处理。分层边界细化后,把不同层级的显著特征做融合操作得到结果显著图。 在具有挑战性的多个基准数据集上使用综合评价指标进行性能测试,实验结果表明该方法具有优越的显著性检测性能。对于低对比度或者小目标等问题,本文提出一种新颖模型,即通道层级特征响应模型。 该模型包含三个部分:通道式粗特征提取,层级通道特征细化和层级特征图融合。该方法基于挤压激励残差网络,依据卷积特征通道之间的相关性进行建模。 首先,输入图像通过通道式粗特征提取过程生成空间信息丢失较多的粗糙特征图。然后,从高层级到低层级逐步细化通道特征,充分挖掘潜在的通道相关性细节信息。 接着,对多层级特征做融合操作得到结果显著图。在含有复杂场景的多个基准数据集上与其它先进算法进行比较,实验结果证明该算法具有较高的计算效率和卓越的显著性检测性能。

帧差法、光流法、背景减除法

帧差法、光流法、背景减除法 运动目标检测是指在序列图像中检测出变化区域并将运动目标从背景图像中提取出来。通常情况下,目标分类、跟踪和行为理解等后处理过程仅仅考虑图像中对应于运动目标的像素区域,因此运动目标的正确检测与分割对于后期处理非常重要然而,由于场景的动态变化,如天气、光照、阴影及杂乱背景干扰等的影响,使得运动目标的检测与分割变得相当困难。根据摄像头是否保持静止,运动检测分为静态背景和运运动目标检测是指在序列图像中检测出变化区域并将运动目标从背景图像中提取出来。通常情况下,目标分类、跟踪和行为理解等后处理过程仅仅考虑图像中对应于运动目标的像素区域,因此运动目标的正确检测与分割对于后期处理非常重要然而,由于场景的动态变化,如天气、光照、阴影及杂乱背景干扰等的影响,使得运动目标的检测与分割变得相当困难。根据摄像头是否保持静止,运动检测分为静态背景和运动背景两类。大多数视频监控系统是摄像头固定的,因此静态背景下运动目标检测算法受到广泛关注,常用的方法有帧差法、光流法、背景减除法等。 (l)帧差法 帧差法是最为常用的运动目标检测和分割方法之一,基本原理就是在图像序列相邻两帧或三帧间采用基于像素的时间差分通过闭值化来提取出图像中的运动区域。首先,将相邻帧图像对应像素值相减得到差分图像,然后对差分图像二值化,在环境亮度变化不大的情况下,如果对应像素值变化小于事先确定的阂值时,可以认为此处为背景像素:如果图像区域的像素值变化很大,可以认为这是由于图像中运动物体引起的,将这些区域标记为前景像素,利用标记的像素区域可以确定运动目标在图像中的位置。由于相邻两帧间的时间间隔非常短,用前一帧图像作为当前帧的背景模型具有较好的实时性,其背景不积累,且更新速度快、算法简单、计算量小。算法的不足在于对环境噪声较为敏感,闽值的选择相当关键,选择过低不足以抑制图像中的噪声,过高则忽略了图像中有用的变化。对于比较大的、颜色一致的运动目标,有可能在目标内部产生空洞,无法完整地提取运动目标。 (2)光流法 光流法的主要任务就是计算光流场,即在适当的平滑性约束条件下,根据图像序列的时空梯度估算运动场,通过分析运动场的变化对运动目标和场景进行检测与分割。通常有基于全局光流场和特征点光流场两种方法。最经典的全局光流场计算方法是L-K(Lueas&Kanada)法和H-S(Hom&Schunck)法,得到全局光流场后通过比较运动目标与背景之间的运动差异对运动目标进行光流分割,缺点是计算量大。特征点光流法通过特征匹配求特征点处的流速,具有计算量小、快速灵活的特点,但稀疏的光流场很难精确地提取运动目标的形状。总的来说,光流法不需要预先知道场景的任何信息,就能够检测到运动对象,可处理背景运动的情况,但噪声、多光源、阴影和遮挡等因素会对光流场分布的计算结果造成严重影响;而且光流法计算复杂,很难实现实时处理。 (3)背景减除法 背景减除法是一种有效的运动对象检测算法,基本思想是利用背景的参数模型来近似背景图像的像素值,将当前帧与背景图像进行差分比较实现对运动区域的检测,其中区别较大的像素区域被认为是运动区域,而区别较小的像素区域被认为是背景区域。背景减除法必须要有背景图像,并且背景图像必须是随着光照或外部环境的变化而实时更新的,因此背景减除法的关键是背景建模及其更新。针对如何建立对于不同场景的动态变化均具有自适应性的背景模型,减少动态场景变化对运动分割的影响,研究人员已提出了许多背景建模算法,但总的来讲可以概括为非回归递推和回归递推两类。非回归背景建模算法是动态的利用从某一时刻开始到当前一段时间内存储的新近观测数据作为样本来进行背景建模。非回归背景建模方法有最简单的帧间差分、中值滤波方法、Toyama等利用缓存的样本像素来估计背景模型

视觉目标检测算法说明

视觉目标检测算法说明 1.功能 通过安装在战车上的摄像头,检测视野范围内的敌方战车。 2.算法: 2.1目标检测与识别 1.颜色检测 采集大量敌方机器人的图片数据,并进行训练,得到对方机器人的颜色区间, 并以此为阈值对整幅图像进行颜色检测,找到疑似敌方机器人的区域,量化 成二值图。 2.滤除噪声点 对得到的二值图像进行开运算处理,滤除颜色检测结果中的噪声点。 3.连通区域检测 对图像中的疑似区域进行连通区域检测,计算出每个疑似区域的外部轮廓, 用矩形近似表示。 4.连通区域合并 根据连通区域之间的距离和颜色相似性,将距离接近且相似性高的连通区域 进行合并。 5.形状和大小过滤 对大量敌方机器人图片进行训练,得到对方机器人的形状信息(例如长宽比) 和大小信息(面积),并以此为依据将不符合的区域过滤掉。 经过以上五步的处理,可以初步得到敌方机器人的位置、大小和形状信息。 2.2目标运动跟踪 对上步中的检测结果进行运动跟踪。 1.状态估计 根据上一时刻地方机器人的运动状态(包括位置和速度),估算当前时刻机 器人的运动状态。 2.轨迹关联 根据位置和颜色信息,对当前时刻机器人的估计状态和检测结果进行关联。 3.状态更新 若上一步中关联成功,更新当前时刻的运动状态。 通过对检测结果进行运动跟踪,可以计算出当前时刻敌方机器人的运动速度和方 向。 2.3预估提前量

1.评估延迟时间 根据己方机器人实际的调试情况,通过多次试验和统计的方法,估算己方机器人从接收命令到炮弹(或子弹)击中目标区域的时间延时(包括图像处理 时间、落弹时间和炮弹飞行时间)。 2.计算提前量 根据延迟时间和敌方机器人的运动速度,计算炮弹发射的提前量,补偿到敌方机器人的运动状态中。 3.总结: 对于机器人战车中的敌方目标检问题,有很多种方法可以实现,视觉检测只是其中的一种方法,而基于颜色识别的目标检测也只是视觉算法中比较简单有效的一种。所以,本段代码只是抛砖引玉的一个样本,适用范围只针对于2014年RoboMasters夏令营的场地和战车,希望可以看到大家更加简单有效的算法。

运动目标检测原理

运动检测(移动侦测)原理 一、引言 随着技术的飞速发展,人们对闭路电视监控系统的要求越来越高,智能化在监控领域也得到越来越多的应用。在某些监控的场所对安全性要求比较高,需要对运动的物体进行及时的检测和跟踪,因此我们需要一些精确的图像检测技术来提供自动报警和目标检测。运动检测作为在安防智能化应用最早的领域,它的技术发展和应用前景都受到关注。 运动检测是指在指定区域能识别图像的变化,检测运动物体的存在并避免由光线变化带来的干扰。但是如何从实时的序列图像中将变化区域从背景图像中提取出来,还要考虑运动区域的有效分割对于目标分类、跟踪等后期处理是非常重要的,因为以后的处理过程仅仅考虑图像中对应于运动区域的像素。然而,由于背景图像的动态变化,如天气、光照、影子及混乱干扰等的影响,使得运动检测成为一项相当困难的工作。 二、运动检测(移动侦测)原理 早期的运动检测如MPEG1是对编码后产生的I帧进行比较分析,通过视频帧的比较来检测图像变化是一种可行的途径。原理如下:MPEG1视频流由三类编码帧组成,它们分别是:关键帧(I 帧),预测帧(P帧)和内插双向帧(B帧)。I帧按JPEG标准编码,独立于其他编码帧,它是MPEG1视频流中唯一可存取的帧,每12帧出现一次。截取连续的I帧,经过解码运算,以帧为单位连续存放在内存的缓冲区中,再利用函数在缓冲区中将连续的两帧转化为位图形式,存放在另外的内存空间以作比较之用,至

于比较的方法有多种。此方法是对编码后的数据进行处理,而目前的MPEG1/MPEG4编码都是有损压缩,对比原有的图像肯定存在误报和不准确的现象。 目前几种常用的方法: 1.背景减除(Background Subtraction ) 背景减除方法是目前运动检测中最常用的一种方法,它是利用当前图像与背景图像的差分来检测出运动区域的一种技术。它一般能够提供最完全的特征数据,但对于动态场景的变化,如光照和外来无关事件的干扰等特别敏感。最简单的背景模型是时间平均图像,大部分的研究人员目前都致力于开发不同的背景模型,以期减少动态场景变化对于运动分割的影响。 2.时间差分(Temporal Difference ) 时间差分(又称相邻帧差)方法是在连续的图像序列中两个或三个相邻帧间采用基于像素的时间差分并且阈值化来提取出图像中的运动区域。时间差分运动检测方法对于动态环境具有较强的自适应性,但一般不能完全提取出所有相关的特征像素点,在运动实体内部容易产生空洞现象。 3.光流(Optical Flow) 基于光流方法的运动检测采用了运动目标随时间变化的光流特性,如Meyer[2] 等通过计算位移向量光流场来初始化基于轮廓的跟踪算法,从而有效地提取和跟踪运动目标。该方法的优点是在摄像机运动存在的前提下也能检测出独立的运动目标。然而,

实践5 视频运动目标检测:帧差法的实现

实践5 视频运动目标检测:帧差法的实现 实验任务: 根据原理,获取并显示两幅图像的帧差灰度图和帧差二值图,如下图所示。 实现的算法是: (1)分别读取两张图像; (2)将2张图像分别转换为灰度图,转换函数可用:cvCvtColor/cvtColor; (3)将2张灰度图相减(求差值),得到帧差灰度图,相减函数可用:cvAbsDiff/absdiff;(4)利用阈值操作,将帧差灰度图转化为帧差二值图,阈值操作函数可用:cvThreshold/threshold;(如果假设目标设定为白色,背景设定为黑色,则需要使用逻辑“非”操作进行颜色转换,可使用cvNot/bitwise_not函数); (5)显示图像。 请将上述任务改成找茬游戏的自动找茬功能。 请改为三帧差分,并上交源代码。 函数解析: (1)cvCvtColor/cvtColor

C: void cvCvtColor( const CvArr* src, CvArr* dst, int code ); C++:void cvtColor(InputArray src, OutputArray dst, int code, int dstCn=0 ) src 输入的8-bit,16-bit或32-bit单倍精度浮点数影像。 dst 输出的8-bit,16-bit或32-bit单倍精度浮点数影像。 code色彩空间转换的模式,该code来实现不同类型的颜色空间转换。比如CV_BGR2GRAY表示转换为灰度图,CV_BGR2HSV将图片从RGB空间转换为HSV空间。常见的code模式有: CV_RGB2GRAY(彩色图像-灰度图像) CV_BGR2YCrCb CV_RGB2YCrCb CV_YCrCb2BGR CV_YCrCb2RGB CV_BGR2HSV CV_RGB2HSV CV_HSV2BGR CV_HSV2RGB (2)cvAbsDiff/absdiff OpenCV 中计算两个数组差的绝对值的函数。 void cvAbsDiff( const CvArr* src1, const CvArr* src2, CvArr* dst ); src1 第一个原数组(第一张图像) src2 第二个原数组(第二张图像) dst输出数组(输出的帧差图像) 函数cvAbsDiff 计算两个数组差的绝对值,其数学原理为: dst(I)c = abs(src1(I)c - src2(I)c). 所有数组必须有相同的数据类型相同的大小(或ROI大小)。 (3)cvThreshold/threshold 作用:函数cvThreshold 对单通道数组应用固定阈值操作。该函数的典型应用是对灰度图像进行阈值操作得到二值图像。