深度学习的现在和未来

深度学习的现在和未来:DeepLearning、无监督

学习、NLP

原文摘要:深度学习可以让那些拥有多个处理层的计算模型来学习具有多层次抽象的数据的表示。这些方法在许多方面都带来了显著的改善,包括最先进的语音识别、视觉对象识别、对象检测和许多其它领域,例如药物发现和基因组学等。深度学习能够发现大数据中的复杂结构。它是利用BP 算法来完成这个发现过程的。BP算法能够指导机器如何从前一层获取误差而改变本层的内部参数,这些内部参数可以用于计算表示。深度卷积网络在处理图像、视频、语音和音频方面带来了突破,而递归网络在处理序列数据,比如文本和语音方面表现出了闪亮的一面。

机器学习技术在现代社会的各个方面表现出了强大的功能:从Web搜索到社会网络内容过滤,再到电子商务网站上的商品推荐都有涉足。并且它越来越多地出现在消费品中,比如相机和智能手机。

机器学习系统被用来识别图片中的目标,将语音转换成文本,匹配新闻元素,根据用户兴趣提供职位或产品,选择相关的搜索结果。逐渐地,这些应用使用一种叫深度学习的技术。传统的机器学习技术在处理未加工过的数据时,体现出来的能力是有限的。几十年来,想要构建一个模式识别系统或者机器学习系统,需要一个精致的引擎和相当专业的知识来设计一个特征提取器,把原始数据(如图像的像素值)转换成一个适当的内部特征表示或特征向量,子学习系统,通常是一个分类器,对输入的样本进行检测或分类。特征表示学习是一套给机器灌入原始数据,然后能自动发现需要进行检测和分类的表达的方法。深度学习就是一种特征学习方法,把原始数据通过一些简单的但是非线性的模型转变成为更高层次的,更加抽象的表达。通过足够多的转换的组合,非常复杂的函数也可以被学习。对于分类任务,高层次的表达能够强化输入数据的区分能力方面,同时削弱不相关因素。比如,一副图像的原始格式是一个像素数组,那么在第一层

上的学习特征表达通常指的是在图像的特定位置和方向上有没有边的存在。第二层通常会根据那些边的某些排放而来检测图案,这时候会忽略掉一些边上的一些小的干扰。第三层或许会把那些图案进行组合,从而使其对应于熟悉目标的某部分。随后的一些层会将这些部分再组合,从而构成待检测目标。深度学习的核心方面是,上述各层的特征都不是利用人工工程来设计的,而是使用一种通用的学习过程从数据中学到的。

深度学习正在取得重大进展,解决了人工智能界的尽最大努力很多年仍没有进展的问题。它已经被证明,它能够擅长发现高维数据中的复杂结构,因此它能够被应用于科学、商业和政府等领域。除了在图像识别、语音识别等领域打破了纪录,它还在另外的领域击败了其他机器学习技术,包括预测潜在的药物分子的活性、分析粒子加速器数据、重建大脑回路、预测在非编码DNA突变对基因表达和疾病的影响。也许更令人惊讶的是,深度学习在自然语言理解的各项任务中产生了非常可喜的成果,特别是主题分类、情感分析、自动问答和语言翻译。我们认为,在不久的将来,深度学习将会取得更多的成功,因为它需要很少的手工工程,它可以很容易受益于可用计算能力和数据量的增加。目前正在为深度神经网络开发的新的学习算法和架构只会加速这一进程。

一、监督学习

机器学习中,不论是否是深层,最常见的形式是监督学习。试想一下,我们要建立一个系统,它能够对一个包含了一座房子、一辆汽车、一个人或一个宠物的图像进行分类。我们先收集大量的房子,汽车,人与宠物的图像的数据集,并对每个对象标上它的类别。在训练期间,机器会获取一副图片,然后产生一个输出,这个输出以向量形式的分数来表示,每个类别都有一个这样的向量。我们希望所需的类别在所有的类别中具有最高的得分,但是这在训练之前是不太可能发生的。通过计算一个目标函数可以获得输出分数和期望模式分数之间的误差(或距离)。然后机器会修改其内部可调参数,以减少这种误差。这些可调节的参数,通常被称为权值,它们是一些实数,可以被看作是一些“旋钮”,定义了机器的输入输出功能。在典型的深学习系统中,有可能有数以百万计的样本和权值,和带有

标签的样本,用来训练机器。为了正确地调整权值向量,该学习算法计算每个权值的梯度向量,表示了如果权值增加了一个很小的量,那么误差会增加或减少的量。权值向量然后在梯度矢量的相反方向上进行调整。我们的目标函数,所有训练样本的平均,可以被看作是一种在权值的高维空间上的多变地形。负的梯度矢量表示在该地形中下降方向最快,使其更接近于最小值,也就是平均输出误差低最低的地方。

在实际应用中,大部分从业者都使用一种称作随机梯度下降的算法(SGD)。它包含了提供一些输入向量样本,计算输出和误差,计算这些样本的平均梯度,然后相应的调整权值。通过提供小的样本集合来重复这个过程用以训练网络,直到目标函数停止增长。它被称为随机的是因为小的样本集对于全体样本的平均梯度来说会有噪声估计。这个简单过程通常会找到一组不错的权值,同其他精心设计的优化技术相比,它的速度让人惊奇。训练结束之后,系统会通过不同的数据样本——测试集来显示系统的性能。这用于测试机器的泛化能力——对于未训练过的新样本的识别能力。当前应用中的许多机器学习技术使用的是线性分类器来对人工提取的特征进行分类。一个2类线性分类器会计算特征向量的加权和。当加权和超过一个阈值之后,输入样本就会被分配到一个特定的类别中。从20世纪60年代开始,我们就知道了线性分类器只能够把样本分成非常简单的区域,也就是说通过一个超平面把空间分成两部分。

但像图像和语音识别等问题,它们需要的输入-输出函数要对输入样本中不相关因素的变化不要过于的敏感,如位置的变化,目标的方向或光照,或者语音中音调或语调的变化等,但是需要对于一些特定的微小变化非常敏感(例如,一只白色的狼和跟狼类似的白色狗——萨莫耶德犬之间的差异)。在像素这一级别上,两条萨莫耶德犬在不同的姿势和在不同的环境下的图像可以说差异是非常大的,然而,一只萨摩耶德犬和一只狼在相同的位置并在相似背景下的两个图像可能就非常类似。

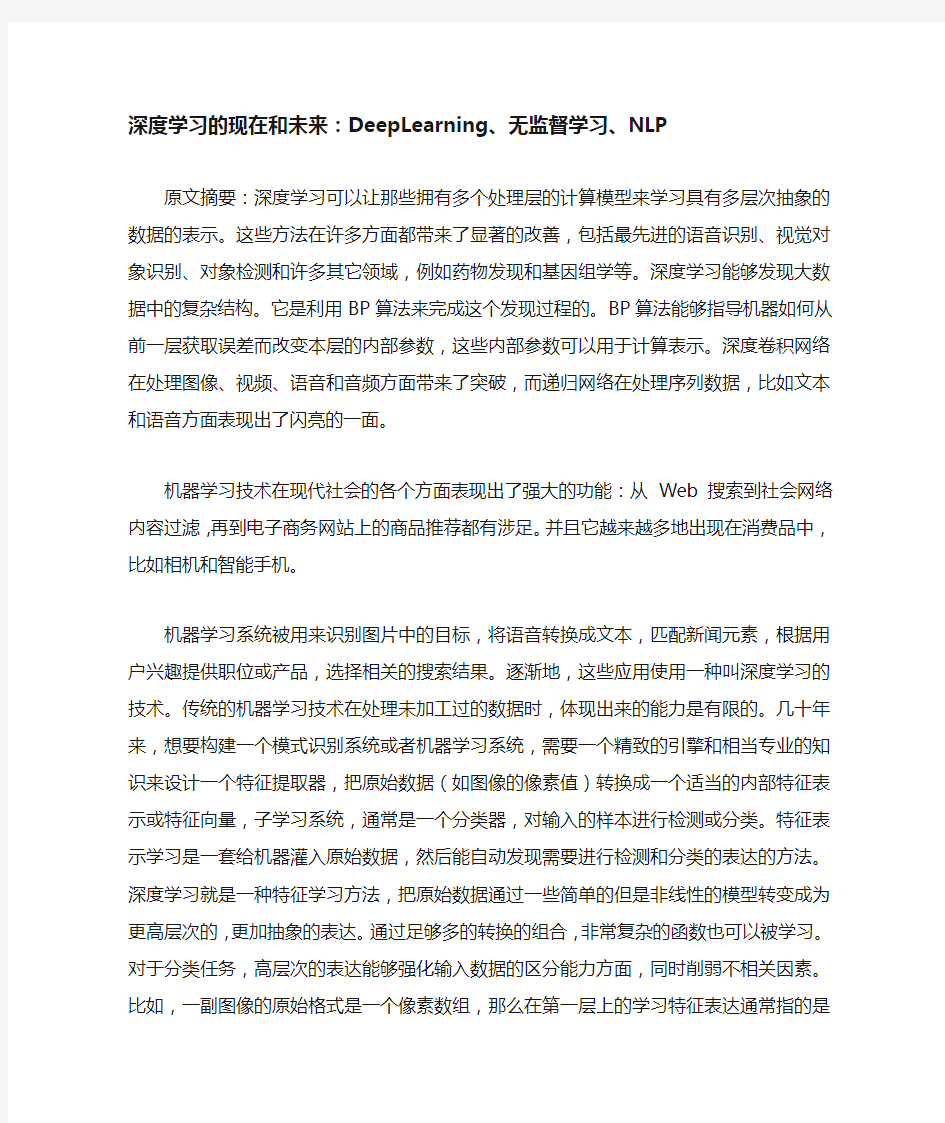

图1 多层神经网络和BP算法

1.多层神经网络(用连接点表示)可以对输入空间进行整合,使得数据(红色

和蓝色线表示的样本)线性可分。注意输入空间中的规则网格(左侧)是如何被隐藏层转换的(转换后的在右侧)。这个例子中只用了两个输入节点,两个隐藏节点和一个输出节点,但是用于目标识别或自然语言处理的网络通常包含数十个或者数百个这样的节点。获得C.Olah (链接地址)的许可后重新构建的这个图。

2.链式法则告诉我们两个小的变化(x和y的微小变化,以及y和z的微小变

化)是怎样组织到一起的。x的微小变化量Δx首先会通过乘以?y/?x(偏导数)转变成y的变化量Δy。类似的,Δy会给z带来改变Δz。通过链式法则可以将一个方程转化到另外的一个——也就是Δx通过乘以?y/?x和?z/?y(英文原文为?z/?x,系笔误——编辑注)得到Δz的过程。当x,y,z是向量的时候,可以同样处理(使用雅克比矩阵)。

3.具有两个隐层一个输出层的神经网络中计算前向传播的公式。每个都有一个

模块构成,用于反向传播梯度。在每一层上,我们首先计算每个节点的总输入z,z是前一层输出的加权和。然后利用一个非线性函数f(.)来计算节点

的输出。简单期间,我们忽略掉了阈值项。神经网络中常用的非线性函数包括了最近几年常用的校正线性单元(ReLU)f(z) = max(0,z),和更多传统sigmoid函数,比如双曲线正切函数f(z) = (exp(z) ? exp(?z))/(exp(z) + exp(?z)) 和logistic函数f(z) = 1/(1 + exp(?z))。

4.计算反向传播的公式。在隐层,我们计算每个输出单元产生的误差,这是由

上一层产生的误差的加权和。然后我们将输出层的误差通过乘以梯度f(z)转换到输入层。在输出层上,每个节点的误差会用成本函数的微分来计算。

如果节点l的成本函数是0.5*(yl-tl)^2, 那么节点的误差就是yl-tl,其中tl是期望值。一旦知道了?E/?zk的值,节点j的内星权向量wjk就可以通过yj ?E/?zk来进行调整。

一个线性分类器或者其他操作在原始像素上的浅层分类器不能够区分后两者,虽然能够将前者归为同一类。这就是为什么浅分类要求有良好的特征提取器用于解决选择性不变性困境——提取器会挑选出图像中能够区分目标的那些重要因素,但是这些因素对于分辨动物的位置就无能为力了。为了加强分类能力,可以使用泛化的非线性特性,如核方法,但这些泛化特征,比如通过高斯核得到的,并不能够使得学习器从学习样本中产生较好的泛化效果。传统的方法是手工设计良好的特征提取器,这需要大量的工程技术和专业领域知识。但是如果通过使用通用学习过程而得到良好的特征,那么这些都是可以避免的了。这就是深度学习的关键优势。

深度学习的体系结构是简单模块的多层栈,所有(或大部分)模块的目标是学习,还有许多计算非线性输入输出的映射。栈中的每个模块将其输入进行转换,以增加表达的可选择性和不变性。比如说,具有一个5到20层的非线性多层系统能够实现非常复杂的功能,比如输入数据对细节非常敏感——能够区分白狼和萨莫耶德犬,同时又具有强大的抗干扰能力,比如可以忽略掉不同的背景、姿势、光照和周围的物体等。

反向传播来训练多层神经网络

在最早期的模式识别任务中,研究者的目标一直是使用可以训练的多层网络来替代经过人工选择的特征,虽然使用多层神经网络很简单,但是得出来的解很糟糕。直到20世纪80年代,使用简单的随机梯度下降来训练

多层神经网络,这种糟糕的情况才有所改变。只要网络的输入和内部权值之间的函数相对平滑,使用梯度下降就凑效,梯度下降方法是在70年代到80年代期间由不同的研究团队独立发明的。

用来求解目标函数关于多层神经网络权值梯度的反向传播算法(BP)只是一个用来求导的链式法则的具体应用而已。反向传播算法的核心思想是:目标函数对于某层输入的导数(或者梯度)可以通过向后传播对该层输出(或者下一层输入)的导数求得(如图1)。反向传播算法可以被重复的用于传播梯度通过多层神经网络的每一层:从该多层神经网络的最顶层的输出(也就是改网络产生预测的那一层)一直到该多层神经网络的最底层(也就是被接受外部输入的那一层),一旦这些关于(目标函数对)每层输入的导数求解完,我们就可以求解每一层上面的(目标函数对)权值的梯度了。

很多深度学习的应用都是使用前馈式神经网络(如图1),该神经网络学习一个从固定大小输入(比如输入是一张图)到固定大小输出(例如,到不同类别的概率)的映射。从第一层到下一层,计算前一层神经元输入数据的权值的和,然后把这个和传给一个非线性激活函数。当前最流行的非线性激活函数是rectified linear unit(ReLU),函数形式:f(z)=max(z,0)。过去的几十年中,神经网络使用一些更加平滑的非线性函数,比如tanh(z)和1/(1+exp(-z)),但是ReLU通常会让一个多层神经网络学习的更快,也可以让一个深度网络直接有监督的训练(不需要无监督的pre-train)。

达到之前那种有pre-train的效果。通常情况下,输入层和输出层以外的神经单元被称为隐藏单元。隐藏层的作用可以看成是使用一个非线性的方式打乱输入数据,来让输入数据对应的类别在最后一层变得线性可分。在20世纪90年代晚期,神经网络和反向传播算法被大多数机器学习团队抛弃,同时也不受计算机视觉和语音识别团队的重视。人们普遍认为,学习有用的、多级层次结构的、使用较少先验知识进行特征提取的这些方法都不靠谱。确切的说是因为简单的梯度下降会让整个优化陷入到不好的局部最小解。

实践中,如果在大的网络中,不管使用什么样的初始化条件,局部最小解并不算什么大问题,系统总是得到效果差不多的解。最近的理论和实验表明,局部最小解还真不是啥大问题。相反,解空间中充满了大量的鞍点(梯度为0的点),同时鞍点周围大部分曲面都是往上的。所以这些算法就算是陷入了这些局部最小值,关系也不太大。

2006年前后,CIFAR(加拿大高级研究院)把一些研究者聚集在一起,人们对深度前馈式神经网络重新燃起了兴趣。研究者们提出了一种非监督的学习方法,这种方法可以创建一些网络层来检测特征而不使用带标签的数据,这些网络层可以用来重构或者对特征检测器的活动进行建模。通过预训练过程,深度网络的权值可以被初始化为有意思的值。然后一个输出层被添加到该网络的顶部,并且使用标准的反向传播算法进行微调。这个工作对手写体数字的识别以及行人预测任务产生了显著的效果,尤其是带标签的数据非常少的时候。

使用这种与训练方法做出来的第一个比较大的应用是关于语音识别的,并且是在GPU上做的,这样做是因为写代码很方便,并且在训练的时候可以得到10倍或者20倍的加速。2009年,这种方法被用来映射短时间的系数窗口,该系统窗口是提取自声波并被转换成一组概率数字。它在一组使用很少词汇的标准的语音识别基准测试程序上达到了惊人的效果,然后又迅速被发展到另外一个更大的数据集上,同时也取得惊人的效果。从2009年到到2012年底,较大的语音团队开发了这种深度网络的多个版本并且已经被用到了安卓手机上。对于小的数据集来说,无监督的预训练可以防止过拟合,同时可以带来更好的泛化性能当有标签的样本很小的时候。一旦深度学习技术重新恢复,这种预训练只有在数据集合较少的时候才需要。然后,还有一种深度前馈式神经网络,这种网络更易于训练并且比那种全连接的神经网络的泛化性能更好。这就是卷积神经网络(CNN)。当人们对神经网络不感兴趣的时候,卷积神经网络在实践中却取得了很多成功,如今它被计算机视觉团队广泛使用。

二、卷积神经网络

卷积神经网络被设计用来处理到多维数组数据的,比如一个有3个包含了像素值2-D图像组合成的一个具有3个颜色通道的彩色图像。很多数据形态都是这种多维数组的:1D用来表示信号和序列包括语言,2D用来表示图像或者声音,3D用来表示视频或者有声音的图像。卷积神经网络使用4个关键的想法来利用自然信号的属性:局部连接、权值共享、池化以及多网络层的使用。

图2 卷积神经网络内部

一个典型的卷积神经网络结构(如图2)是由一系列的过程组成的。最初的几个阶段是由卷积层和池化层组成,卷积层的单元被组织在特征图中,在特征图中,每一个单元通过一组叫做滤波器的权值被连接到上一层的特征图的一个局部块,然后这个局部加权和被传给一个非线性函数,比如ReLU。在一个特征图中的全部单元享用相同的过滤器,不同层的特征图使用不同的过滤器。使用这种结构处于两方面的原因。首先,在数组数据中,比如图像数据,一个值的附近的值经常是高度相关的,可以形成比较容易被探测到的有区分性的局部特征。其次,不同位置局部统计特征不太相关的,也就是说,在一个地方出现的某个特征,也可能出现在别的地方,所以不同位置的单元可以共享权值以及可以探测相同的样本。在数学上,这种由一个特征图执行的过滤操作是一个离线的卷积,卷积神经网络也是这么得名来的。

卷积层的作用是探测上一层特征的局部连接,然而池化层的作用是在语义上把相似的特征合并起来,这是因为形成一个主题的特征的相对位置不太

一样。一般地,池化单元计算特征图中的一个局部块的最大值,相邻的池化单元通过移动一行或者一列来从小块上读取数据,因为这样做就减少的表达的维度以及对数据的平移不变性。两三个这种的卷积、非线性变换以及池化被串起来,后面再加上一个更多卷积和全连接层。在卷积神经网络上进行反向传播算法和在一般的深度网络上是一样的,可以让所有的在过滤器中的权值得到训练。

深度神经网络利用的很多自然信号是层级组成的属性,在这种属性中高级的特征是通过对低级特征的组合来实现的。在图像中,局部边缘的组合形成基本图案,这些图案形成物体的局部,然后再形成物体。这种层级结构也存在于语音数据以及文本数据中,如电话中的声音,因素,音节,文档中的单词和句子。当输入数据在前一层中的位置有变化的时候,池化操作让这些特征表示对这些变化具有鲁棒性。

卷积神经网络中的卷积和池化层灵感直接来源于视觉神经科学中的简单细胞和复杂细胞。这种细胞的是以LNG-V1-V2-V4-IT这种层级结构形成视觉回路的。当给一个卷积神经网络和猴子一副相同的图片的时候,卷积神经网络展示了猴子下颞叶皮质中随机160个神经元的变化。卷积神经网络有神经认知的根源,他们的架构有点相似,但是在神经认知中是没有类似反向传播算法这种端到端的监督学习算法的。一个比较原始的1D卷积神经网络被称为时延神经网络,可以被用来识别语音以及简单的单词。

20世纪90年代以来,基于卷积神经网络出现了大量的应用。最开始是用时延神经网络来做语音识别以及文档阅读。这个文档阅读系统使用一个被训练好的卷积神经网络和一个概率模型,这个概率模型实现了语言方面的一些约束。20世纪90年代末,这个系统被用来美国超过10%的支票阅读上。后来,微软开发了基于卷积神经网络的字符识别系统以及手写体识别系统。20世纪90年代早期,卷积神经网络也被用来自然图形中的物体识别,比如脸、手以及人脸识别(face recognition )。

使用深度卷积网络进行图像理解

21世纪开始,卷积神经网络就被成功的大量用于检测、分割、物体识别以及图像的各个领域。这些应用都是使用了大量的有标签的数据,比如交通信号识别,生物信息分割,面部探测,文本、行人以及自然图形中的人的身体部分的探测。近年来,卷积神经网络的一个重大成功应用是人脸识别。

值得一提的是,图像可以在像素级别进行打标签,这样就可以应用在比如自动电话接听机器人、自动驾驶汽车等技术中。像Mobileye以及NVIDIA 公司正在把基于卷积神经网络的方法用于汽车中的视觉系统中。其它的应用涉及到自然语言的理解以及语音识别中。

图3 从图像到文字

尽管卷积神经网络应用的很成功,但是它被计算机视觉以及机器学习团队开始重视是在2012年的ImageNet竞赛。在该竞赛中,深度卷积神经网络被用在上百万张网络图片数据集,这个数据集包含了1000个不同的类。该结果达到了前所未有的好,几乎比当时最好的方法降低了一半的错误率。

这个成功来自有效地利用了GPU、ReLU、一个新的被称为dropout的正则技术,以及通过分解现有样本产生更多训练样本的技术。这个成功给计算机视觉带来一个革命。如今,卷积神经网络用于几乎全部的识别和探测任务中。最近一个更好的成果是,利用卷积神经网络结合回馈神经网络用来产生图像标题。

如今的卷积神经网络架构有10-20层采用ReLU激活函数、上百万个权值以及几十亿个连接。然而训练如此大的网络两年前就只需要几周了,现在硬件、软件以及算法并行的进步,又把训练时间压缩到了几小时。

基于卷积神经网络的视觉系统的性能已经引起了大型技术公司的注意,比如Google、Facebook、Microsoft、IBM,yahoo!、Twitter和Adobe等,一些快速增长的创业公司也同样如是。

卷积神经网络很容易在芯片或者现场可编程门阵列(FPGA)中高效实现,许多公司比如NVIDIA、Mobileye、Intel、Qualcomm以及Samsung,正在开发卷积神经网络芯片,以使智能机、相机、机器人以及自动驾驶汽车中的实时视觉系统成为可能。

分布式特征表示与语言处理

与不使用分布式特征表示(distributed representations )的经典学习算法相比,深度学习理论表明深度网络具有两个不同的巨大的优势。这些优势来源于网络中各节点的权值,并取决于具有合理结构的底层生成数据的分布。首先,学习分布式特征表示能够泛化适应新学习到的特征值的组合(比如,n元特征就有2n种可能的组合)。其次,深度网络中组合表示层带来了另一个指数级的优势潜能(指数级的深度)。

多层神经网络中的隐层利用网络中输入的数据进行特征学习,使之更加容易预测目标输出。下面是一个很好的示范例子,比如将本地文本的内容作为输入,训练多层神经网络来预测句子中下一个单词。内容中的每个单词表示为网络中的N分之一的向量,也就是说,每个组成部分中有一个值为

1其余的全为0。在第一层中,每个单词创建不同的激活状态,或单词向量(如图4)。在语言模型中,网络中其余层学习并转化输入的单词向量为输出单词向量来预测句子中下一个单词,可以通过预测词汇表中的单词作为文本句子中下一个单词出现的概率。网络学习了包含许多激活节点的、并且可以解释为词的独立特征的单词向量,正如第一次示范的文本学习分层表征文字符号的例子。这些语义特征在输入中并没有明确的表征。而是在利用“微规则”(…micro-rules?,本文中直译为:微规则)学习过程中被发掘,并作为一个分解输入与输出符号之间关系结构的好的方式。当句子是来自大量的真实文本并且个别的微规则不可靠的情况下,学习单词向量也一样能表现得很好。利用训练好的模型预测新的事例时,一些概念比较相似的词容易混淆,比如星期二(Tuesday)和星期三(Wednesday),瑞典(Sweden)和挪威(Norway)。这样的表示方式被称为分布式特征表示,因为他们的元素之间并不互相排斥,并且他们的构造信息对应于观测到的数据的变化。这些单词向量是通过学习得到的特征构造的,这些特征不是由专家决定的,而是由神经网络自动发掘的。从文本中学习得单词向量表示现在广泛应用于自然语言中。

图4 词向量学习可视化

特征表示问题争论的中心介于对基于逻辑启发和基于神经网络的认识。在逻辑启发的范式中,一个符号实体表示某一事物,因为其唯一的属性与其他符号实体相同或者不同。该符号实例没有内部结构,并且结构与使用是相关的,至于理解符号的语义,就必须与变化的推理规则合理对应。相反地,神经网络利用了大量活动载体、权值矩阵和标量非线性化,来实现能够支撑简单容易的、具有常识推理的快速“直觉”功能。

在介绍神经语言模型前,简述下标准方法,其是基于统计的语言模型,该模型没有使用分布式特征表示。而是基于统计简短符号序列出现的频率增长到N(N-grams,N元文法)。可能的N-grams的数字接近于V N,其中V是词汇表的大小,考虑到文本内容包含成千上万个单词,所以需要一个非常大的语料库。N-grams将每个单词看成一个原子单元,因此不能在语义相关的单词序列中一概而论,然而神经网络语言模型可以,是因为他们关

联每个词与真是特征值的向量,并且在向量空间中语义相关的词彼此靠近(图4)。

递归神经网络

首次引入反向传播算法时,最令人兴奋的便是使用递归神经网络(recurrent neural networks,下文简称RNNs)训练。对于涉及到序列输入的任务,比如语音和语言,利用RNNs能获得更好的效果。RNNs一次处理一个输入序列元素,同时维护网络中隐式单元中隐式的包含过去时刻序列元素的历史信息的“状态向量”。如果是深度多层网络不同神经元的输出,我们就会考虑这种在不同离散时间步长的隐式单元的输出,这将会使我们更加清晰怎么利用反向传播来训练RNNs(如图5,右)。

图5 递归神经网络

RNNs是非常强大的动态系统,但是训练它们被证实存在问题的,因为反向传播的梯度在每个时间间隔内是增长或下降的,所以经过一段时间后将导致结果的激增或者降为零。

由于先进的架构和训练方式,RNNs被发现可以很好的预测文本中下一个字符或者句子中下一个单词,并且可以应用于更加复杂的任务。例如在某时刻阅读英语句子中的单词后,将会训练一个英语的“编码器”网络,使得隐式单元的最终状态向量能够很好地表征句子所要表达的意思或思想。这种“思

想向量”(thought vector)可以作为联合训练一个法语“编码器”网络的初始化隐式状态(或者额外的输入),其输出为法语翻译首单词的概率分布。如果从分布中选择一个特殊的首单词作为编码网络的输入,将会输出翻译的句子中第二个单词的概率分布,并直到停止选择为止。总体而言,这一过程是根据英语句子的概率分布而产生的法语词汇序列。这种简单的机器翻译方法的表现甚至可以和最先进的(state-of-the-art)的方法相媲美,同时也引起了人们对于理解句子是否需要像使用推理规则操作内部符号表示质疑。这与日常推理中同时涉及到根据合理结论类推的观点是匹配的。

类比于将法语句子的意思翻译成英语句子,同样可以学习将图片内容“翻译”为英语句子(如图3)。这种编码器是可以在最后的隐层将像素转换为活动向量的深度卷积网络(ConvNet)。解码器与RNNs用于机器翻译和神经网络语言模型的类似。近来,已经掀起了一股深度学习的巨大兴趣热潮(参见文献[86]提到的例子)。

RNNs一旦展开(如图5),可以将之视为一个所有层共享同样权值的深度前馈神经网络。虽然它们的目的是学习长期的依赖性,但理论的和经验的证据表明很难学习并长期保存信息。

为了解决这个问题,一个增大网络存储的想法随之产生。采用了特殊隐式单元的LSTM(long short-termmemory networks)被首先提出,其自然行为便是长期的保存输入。一种称作记忆细胞的特殊单元类似累加器和门控神经元:它在下一个时间步长将拥有一个权值并联接到自身,拷贝自身状态的真实值和累积的外部信号,但这种自联接是由另一个单元学习并决定何时清除记忆内容的乘法门控制的。

LSTM网络随后被证明比传统的RNNs更加有效,尤其当每一个时间步长内有若干层时,整个语音识别系统能够完全一致的将声学转录为字符序列。目前LSTM网络或者相关的门控单元同样用于编码和解码网络,并且在机器翻译中表现良好。

过去几年中,几位学者提出了不同的提案用于增强RNNs的记忆模块。提案中包括神经图灵机,其中通过加入RNNs可读可写的“类似磁带”的存储来增强网络,而记忆网络中的常规网络通过联想记忆来增强。记忆网络在标准的问答基准测试中表现良好,记忆是用来记住稍后要求回答问题的事例。

除了简单的记忆化,神经图灵机和记忆网络正在被用于那些通常需要推理和符号操作的任务,还可以教神经图灵机“算法”。除此以外,他们可以从未排序的输入符号序列(其中每个符号都有与其在列表中对应的表明优先级的真实值)中,学习输出一个排序的符号序列。可以训练记忆网络用来追踪一个设定与文字冒险游戏和故事的世界的状态,回答一些需要复杂推理的问题。在一个测试例子中,网络能够正确回答15句版的《指环王》中诸如“Frodo现在在哪?”的问题。

深度学习的未来展望

无监督学习对于重新点燃深度学习的热潮起到了促进的作用,但是纯粹的有监督学习的成功盖过了无监督学习。在本篇综述中虽然这不是我们的重点,我们还是期望无监督学习在长期内越来越重要。无监督学习在人类和动物的学习中占据主导地位:我们通过观察能够发现世界的内在结构,而不是被告知每一个客观事物的名称。

人类视觉是一个智能的、基于特定方式的利用小或大分辨率的视网膜中央窝与周围环绕区域对光线采集成像的活跃的过程。我们期望未来在机器视觉方面会有更多的进步,这些进步来自那些端对端的训练系统,并结合ConvNets和RNNs,采用增强学习来决定走向。结合了深度学习和增强学习的系统正处在初期,但已经在分类任务中超过了被动视频系统,并在学习操作视频游戏中产生了令人印象深刻的效果。

在未来几年,自然语言理解将是深度学习做出巨大影响的另一个领域。我们预测那些利用了RNNs的系统将会更好地理解句子或者整个文档,当它们选择性地学习了某时刻部分加入的策略。

最终,在人工智能方面取得的重大进步将来自那些结合了复杂推理表示学习(representation learning )的系统。尽管深度学习和简单推理已经应用于语音和手写字识别很长一段时间了,我们仍需要通过操作大量向量的新范式来代替基于规则的字符表达式操作。

大气科学概论知识梳理大气基础知识

大气科学概论知识梳理(大气的基本知识)一、地球大气成分由三个部分组成Clean Air【没有水汽和悬浮物的空气称为干洁空气】①干洁大气(即干空气)Moisture 水汽(滴)② Impurity 悬浮在大气中的固液态杂质③ 二、低层大气的各种主要成分N2):氮气(①存在方式:以蛋白质的形式存在于有机体中。作用:是有机体的基本组成部分,也是合成氮肥的基本原料。):氧气(O2②是人类和动植物维持生命活动的极为重要的气体;积极参加大气中的许多化学过程;对有机物质的燃烧、腐败和分解起着重要的作用。):臭氧(O3③ 时空变化:最大值出现在春季,最小值出现在夏季。 空间变化:平:由赤道向两极增加。水 ,含量极少。~60km 垂直:55 ,达最大值,形成臭氧层;~25km 20 15km以上,含量增加特别显著;12 ~ 10km向上,逐渐增加;从 近地面,含量很少; 臭氧的作用: 对紫外线有着极其重要的调控制作用。a. 对高层大气有明显的增 b. 温作用。 CO2) 二氧化碳(④ 空间变化:水平:城市大于农村;

垂直:0~20km,含 量最高;20km 以上,含量显 著减少。 作用: a.绿色植物进行光合作用不可缺少的原料。 b.强烈吸收长波辐射(地面辐射、大气辐射),使地面保持较高的温度,产生“温室效应”。 三、水汽来源:主要来自江、河、湖、海、潮湿陆面的水分蒸发以及植物表面的蒸腾。① ②时空变化:时间:夏季多于冬季 空间:一般低纬多于高纬,下层多于上层。 ③作用: a.在天气气候变化中扮演了重要角色。 b.能强烈吸收地面放射的长波辐射并向地面和周围大气放出长波辐射,对大气起着“温室效应”。 四、大气中的杂质 在大气中悬浮着的各种固体和液体微粒(包括气溶胶粒子和大气污染物质两大部分)。 气溶胶的作用: ①吸收太阳辐射,使空气温度增高,但也削弱了到达地面的太阳辐射; ②缓冲地面辐射冷却,部分补偿地面因长波有效辐射而失去的热量; ③降低大气透明度,影响大气能见度; ④充当水汽凝结核,对云、雾及降水的形成有重要意义。 五、气温、 ①定义:表示大气冷热程度的物理量,反映一定条件下空气分子平均动能大小。 通常指距地面1.5m高处百叶箱中的空气温度。 ②单位:摄氏度(℃)温标;绝对温标,以K表示;华氏温标:℉,水的沸点为212℉ ③单位换算:

江南营_江南深度研学之旅(1)

诗梦江南,入画寻踪 ——长清区实验小学江南深度研学实践之旅 【课程简介】 一道水,一架桥,一支橹声,隽秀婉约的聚合了太多的历史文化。此次研学活动旨在让同学们了解祖国江南,同时感受一场从远古传说,到春秋的吴越文化,到南北朝的文人风骨,再到明清以及近代的大儒伟人的历史盛宴。活动中,同学们将一起寻访王羲之、蔡元培、鲁迅、周恩来等名人伟人故里,穿越历史,冶爱国之志,体悟文化魅力;一起走进园,欣赏宋代江南私家园林的秀美景观,探寻园林蕴含的文化涵;一起游历西湖,领略“淡妆浓抹总相宜”的如画美景;一起走进综合性人文科学博物馆博物馆、中国黄酒博物馆,全面了解历史文化。 【课程特色】 ●文化名镇江南风采 ●穿越时空触摸历史 【行程简表】

上午探访安昌古镇漫游小桥流水梦回江南水乡游历江南小镇,画笔描绘 第五天 下午乘坐高铁前往:车次G60东-西 15:22-19:48辅导员送站一次相聚一生情谊备注:因天气交通等原因,组委会保留调整活动顺序及个别项目的权力,保证活动总量不变。 【活动费用】 2900/人;包含火车(往返高铁)及活动期间所有的费用。 ?【人文积淀-理性思维】·第一天下午·钱塘江·六和塔 钱塘江潮被誉为“天下第一潮”,是世界一大自然奇观,它是天体引力和地球自转的离心作用,加上湾喇叭口的特殊地形所造成的特大涌潮。六和塔位于省市西湖之南,钱塘江畔 月轮山上,是中国现存最完好的砖木结构古塔之一。 小任务1:学生面对浩渺的钱塘江,接受审美教育,并结合手册提示,探究钱塘江大潮的在科学原理; 小任务2:学生走进六和塔,收集关于六和塔的传说故事,留下自己与六和塔最美的合照; ?【审美情趣-人文积淀】·第二天上午·西湖·省博物馆 西湖,是一首诗,一幅天然图画,一个美丽动人的故事,不论是多年居住在这里的人还是匆匆而过的旅人,无不为这天下无双的美景所倾倒。平湖秋月、断桥残雪、柳浪闻莺、花 港观鱼、雷峰夕照、双峰插云、南屏晚钟、三潭印月,西湖十景个擅其胜。省博物馆是省规 模最大的综合性人文科学博物馆,文物品类丰富,年代序列完整。 小任务1:集体创绘,全体学生齐动手,集体协作,面对美景,协作创作最美的西湖; 小任务2:走进博物馆,寻访国宝,找一找最能代表江南文化的文物,向小组同学分享并交流;

深度学习综述

深度学习综述 摘要:深度学习可以让那些拥有多个处理层的计算模型来学习具有多层次抽象的数据的表示。这些方法在许多方面都带来了显著的改善,包括最先进的语音识别、视觉对象识别、对象检测和许多其它领域,例如药物发现和基因组学等。深度学习能够发现大数据中的复杂结构。它是利用BP算法来完成这个发现过程的。BP算法能够指导机器如何从前一层获取误差而改变本层的内部参数,这些内部参数可以用于计算表示。深度卷积网络在处理图像、视频、语音和音频方面带来了突破,而递归网络在处理序列数据,比如文本和语音方面表现出了闪亮的一面。 Review of Deep learning Abstract: Deep learning allows computational models that are composed of multiple processing layers to learn representations of data with multiple levels of abstraction. These methods have dramatically improved the state-of-the-art in speech recognition, visual object recognition, object detection and many other domains such as drug discovery and genomics. Deep learning discovers intricate structure in large data sets by using the backpropagation algorithm to indicate how a machine should change its internal parameters that are used to compute the representation in each layer from the representation in the previous layer. Deep convolutional nets have brought about breakthroughs in processing images, video, speech and audio, whereas recurrent nets have shone light on sequential data such as text and speech. 1 引言 机器学习技术在现代社会的各个方面表现出了强大的功能:从Web搜索到社会网络内容过滤,再到电子商务网站上的商品推荐都有涉足。并且它越来越多地出现在消费品中,比如相机和智能手机。 机器学习系统被用来识别图片中的目标,将语音转换成文本,匹配新闻元素,根据用户兴趣提供职位或产品,选择相关的搜索结果。逐渐地,这些应用使用一种叫深度学习的技术。传统的机器学习技术在处理未加工过的数据时,体现出来的能力是有限的。几十年来,想要构建一个模式识别系统或者机器学习系统,需要一个精致的引擎和相当专业的知识来设计一个特征提取器,把原始数据(如图像的像素值)转换成一个适当的内部特征表示或特征向量,子学习系统,通常是一个分类器,对输入的样本进行检测或分类。特征表示学习是一套给机器灌入原始数据,然后能自动发现需要进行检测和分类的表达的方法。深度学习就是一种特征学习方法,把原始数据通过一些简单的但是非线性的模型转变成为更高层次的,更加抽象的表达。通过足够多的转换的组合,非常复杂的函数也可以被学习。对于分类任务,高层次的表达能够强化输入数据的区分能力方面,同时削弱不相关因素。比如,一副图像的原始格式是一个像素数组,那么在第一层上的学习特征表达通常指的是在图像的特定位置和方向上有没有边的存在。第二层通常会根据那些边的某些排放而来检测图案,这时候会忽略掉一些边上的一些小的干扰。第三层或许会把那些图案进行组合,从而使其对应于熟悉目标的某部分。随后的一些层会将这些部分再组合,从而构成待检测目标。深度学习的核心方面是,上述各层的特征都不是利用人工工程来设计的,而是使用一种通用的学习过程从数据中学到的。 深度学习正在取得重大进展,解决了人工智能界的尽最大努力很多年仍没有进展的问题。它已经被证明,它能够擅长发现高维数据中的复杂结构,因此它能够被应用于科学、商业和政府等领域。除了在图像识别、语音识别等领域打破了纪录,它还在另外的领域击败了其他机器学习技术,包括预测潜在的药物分子的活性、分析粒子加速器数据、重建大脑回路、

最新神经网络最新发展综述汇编

神经网络最新发展综述 学校:上海海事大学 专业:物流工程 姓名:周巧珍 学号:201530210155

神经网络最新发展综述 摘要:作为联接主义智能实现的典范,神经网络采用广泛互联的结构与有效的学习机制来模拟人脑信息处理的过程,是人工智能发展中的重要方法,也是当前类脑智能研究中的有效工具。目前,模拟人脑复杂的层次化认知特点的深度学习成为类脑智能中的一个重要研究方向。通过增加网络层数所构造的“深层神经网络”使机器能够获得“抽象概念”能力,在诸多领域都取得了巨大的成功,又掀起了神经网络研究的一个新高潮。本文分8个方面综述了其当前研究进展以及存在的问题,展望了未来神经网络的发展方向。 关键词: 类脑智能;神经网络;深度学习;大数据 Abstract: As a typical realization of connectionism intelligence, neural network, which tries to mimic the information processing patterns in the human brain by adopting broadly interconnected structures and effective learning mechanisms, is an important branch of artificial intelligence and also a useful tool in the research on brain-like intelligence at present. Currently, as a way to imitate the complex hierarchical cognition characteristic of human brain, deep learning brings an important trend for brain-like intelligence. With the increasing number of layers, deep neural network entitles machines the capability to capture “abstract concepts” and it has achieved great success in various fields, leading a new and advanced trend in neural network research. This paper summarizes the latest progress in eight applications and existing problems considering neural network and points out its possible future directions. Key words : artificial intelligence; neural network; deep learning; big data 1 引言 实现人工智能是人类长期以来一直追求的梦想。虽然计算机技术在过去几十年里取得了长足的发展,但是实现真正意义上的机器智能至今仍然困难重重。伴随着神经解剖学的发展,观测大脑微观结构的技术手段日益丰富,人类对大脑组织的形态、结构与活动的认识越来越深入,人脑信息处理的奥秘也正在被逐步揭示。如何借助神经科学、脑科学与认知科学的研究成果,研究大脑信息表征、转换机理和学习规则,建立模拟大脑信息处理过程的智能计算模型,最终使机器掌握人类的认知规律,是“类脑智能”的研究目标。 类脑智能是涉及计算科学、认知科学、神经科学与脑科学的交叉前沿方向。类脑智能的

大气物理学

大气物理学在线考试复习资料 一、单选题() 1.冬季沿海地区经常形成的逆温是( D ) A辐射逆温 B下沉逆温 C地形逆温 D平流逆温 4.台风属于( B )系统。 A大尺度 B中尺度 C小尺度 D微尺度 5.夏季的台风属于( B ) A暖高压B暖低压C冷高压D冷低压 7.白贝罗的风压定律是关于在北半球,背风而立,高压在( D )A上 B下 C左 D右 8.根据测量结果,碘化银成冰阈温大致为,浸润冻结为( B )A-20~-19℃ B-9~-8℃ C-16~-13℃ D-5~-3℃ 1.大雨滴对可见光的散射属于(C ) A 瑞利散射 B 米散射 C 几何光学散射 D 大粒子散射 2.云滴对可见光的散射属于( B) A瑞利散射 B 米散射 C 几何光学散射 D 大粒子散射

3.夏季对我国东部沿海地区影响很大的副热带高压属于( A)A暖高压 B冷高压 C暖低压 D冷低压 4.无机冰核以(D )代表。 A二氧化碳 B 氮气 C 丙烷 D 碘化银 5.在晴朗无云的夜间,容易形成的逆温是(A ) A 辐射逆温 B 下沉逆温 C 地形逆温 D 平流逆温 6.气体分子对可见光的散射属于(A ) A 瑞利散射 B米散射 C几何光学散射 D 大粒子散射 7.温带气旋属于(C )系统。 A 大尺度

B 中尺度 C 小尺度 D 微尺度 8.单位时间内通过某一平面的辐射能称为( D) A 辐亮度 B 辐射率 C 辐射通量密度 D 辐射通量 9.地转平衡条件下的水平风称为(A ) A 地转风 B 热成风 C 梯度风 D 旋衡风 10.雨滴的形成增长主要是( C) A湍流碰并 B 布朗碰并 C 重力碰并 D 气压梯度力碰并 10.根据测量结果,碘化银成冰阈温大致为,接触冻结为(B)(4分)A -20~-19℃B -9~-8℃C

用社会化方法计算社会-学者网

同时,网络社会的虚拟性、用户匿名性、信息海量性、事件发展复杂性为虚拟数字社会的管理带来极大的挑战。特别是我国现处在经济转轨时期,各种事件频发,加强虚拟社会管理成为我国政府和社会管理的当务之急。 基于上述分析,社会计算出现的背景可以归纳为两方面,一是以用户为中心的Web2.0的思想得到广泛推广,逐渐产生了从个体行为到群体智能的社会化思维模式;二是许多虚拟社会网络的出现逐步形成了一种新型的数字化社会形态。 概念框架 社会计算作为一个新兴的跨学科研究领域,目前还没有一个公认的定义。但也许我们可以从社会计算出现的背景去剖析它的概念。基于这个认识,社会计算实际上可以简单地概括为“用社会化方法计算社会”,具体包含两层意思,即“为社会计算”和“用社会化方法计算”。如图2所示。 “为社会计算”反映了社会计算研究与服务的对象是社会,包括虚拟网络和现实社会,以及从中抽象出来的人工社会。从这个角度来说,通过信息技术方法对社会数字轨迹进行分析,了解社会已经发生、正在发生、将要发生的事情,准确地了解社会的动态特征和运行规律,预测政策实施的可行性,为虚拟网络社会的科学管理和政府决策提供参考。 “社会化方法”是一种以草根用户为中心、 引言 随着互联网的迅猛发展,特别是Web2.0理念的逐渐深入,越来越多的虚拟社会网络出现了,如微博(Twitter 、新浪微博)、社交网(Facebook 、人人网)、社会标注系统(Delicious 、Flickr )、论坛(BBS )、维基(Wiki )等,这些虚拟社会网络聚集了大量用户。据2010年2月资料显示,全球最大的社会网络Facebook 注册的用户已达4亿多,成为排在中国和印度之后的全球人口第三大社会[1],如图1所示。虚拟社会网络已经成为一种新形态的数字社会[2]。 虚拟社会网络不但聚集了大量的用户,而且用户参与网络活动的深度和广度都得到了空前的提高。网络用户不再仅是信息浏览和接受者,也是互联网信息资源的提供和传播者。虚拟网络已成为继报纸、广播、电视之后的“第四媒体”。这种由大众创造的社会媒体(social media )详细地记录了用户的思想和行为轨迹,这使得利用计算技术观察和研究社会成为可能。 用社会化方法计算社会 关键词:社会计算 Web2.0 社会网络 概念框架 孟小峰 余 力 中国人民大学 图1 Facebook 成为全球第三大社会

(完整版)深度神经网络全面概述

深度神经网络全面概述从基本概念到实际模型和硬件基础 深度神经网络(DNN)所代表的人工智能技术被认为是这一次技术变革的基石(之一)。近日,由IEEE Fellow Joel Emer 领导的一个团队发布了一篇题为《深度神经网络的有效处理:教程和调研(Efficient Processing of Deep Neural Networks: A Tutorial and Survey)》的综述论文,从算法、模型、硬件和架构等多个角度对深度神经网络进行了较为全面的梳理和总结。鉴于该论文的篇幅较长,机器之心在此文中提炼了原论文的主干和部分重要内容。 目前,包括计算机视觉、语音识别和机器人在内的诸多人工智能应用已广泛使用了深度神经网络(deep neural networks,DNN)。DNN 在很多人工智能任务之中表现出了当前最佳的准确度,但同时也存在着计算复杂度高的问题。因此,那些能帮助DNN 高效处理并提升效率和吞吐量,同时又无损于表现准确度或不会增加硬件成本的技术是在人工智能系统之中广泛部署DNN 的关键。 论文地址:https://https://www.360docs.net/doc/da8532162.html,/pdf/1703.09039.pdf 本文旨在提供一个关于实现DNN 的有效处理(efficient processing)的目标的最新进展的全面性教程和调查。特别地,本文还给出了一个DNN 综述——讨论了支持DNN 的多种平台和架构,并强调了最新的有效处理的技术的关键趋势,这些技术或者只是通过改善硬件设计或者同时改善硬件设计和网络算法以降低DNN 计算成本。本文也会对帮助研究者和从业者快速上手DNN 设计的开发资源做一个总结,并凸显重要的基准指标和设计考量以评估数量快速增长的DNN 硬件设计,还包括学界和产业界共同推荐的算法联合设计。 读者将从本文中了解到以下概念:理解DNN 的关键设计考量;通过基准和对比指标评估不同的DNN 硬件实现;理解不同架构和平台之间的权衡;评估不同DNN 有效处理技术的设计有效性;理解最新的实现趋势和机遇。 一、导语 深度神经网络(DNN)目前是许多人工智能应用的基础[1]。由于DNN 在语音识别[2] 和图像识别[3] 上的突破性应用,使用DNN 的应用量有了爆炸性的增长。这些DNN 被部署到了从自动驾驶汽车[4]、癌症检测[5] 到复杂游戏[6] 等各种应用中。在这许多领域中,DNN 能够超越人类的准确率。而DNN 的出众表现源于它能使用统计学习方法从原始感官数据中提取高层特征,在大量的数据中获得输入空间的有效表征。这与之前使用手动提取特征或专家设计规则的方法不同。 然而DNN 获得出众准确率的代价是高计算复杂性成本。虽然通用计算引擎(尤其是GPU),已经成为许多DNN 处理的砥柱,但提供对DNN 计算更专门化的加速方法也越来越热门。本文的目标是提供对DNN、理解DNN 行为的各种工具、有效加速计算的各项技术的概述。 该论文的结构如下:

人工智能,机器学习和深度学习之间的差异是什么

人工智能,机器学习和深度学习之间的差异是什么? 人工智能的定义可以分为两部分,即“人工”和“智能”。“人工”比较好理解,争议性也不大。有时我们会要考虑什么是人力所能及制造的,或者人自身的智能程度有没有高到可以创造人工智能的地步,等等。但总的来说,“人工系统”就是通常意义下的人工系统。 人工智能+区块链的发展趋势及应用调研报告 如果你在科技领域,你经常会听到人工智能,机器学习,甚至是深度学习。怎样才可以在正确的时间正确的使用这些词?他们都是一样的意思吗?然而更多时候,人们总是混淆的使用它们。 人工智能,机器学习和深度学习都是属于一个领域的一个子集。但是人工智能是机器学习的首要范畴。机器学习是深度学习的首要范畴。 深度学习是机器学习的一个子集,机器学习是人工智能的一个子集 这个领域的兴起应该归功于深度学习。人工智能和机器学习这个领域近年来一直在解决一系列有趣的问题,比如从自动化的杂货店购买到自动驾驶汽车。

人工智能: 人工智能的定义可以分为两部分,即“人工”和“智能”。“人工”比较好理解,争议性也不大。有时我们会要考虑什么是人力所能及制造的,或者人自身的智能程度有没有高到可以创造人工智能的地步,等等。但总的来说,“人工系统”就是通常意义下的人工系统。 尼尔逊教授对人工智能下了这样一个定义:“人工智能是关于知识的学科――怎样表示知识以及怎样获得知识并使用知识的科学。”而另一个美国麻省理工学院的温斯顿教授认为:“人工智能就是研究如何使计算机去做过去只有人才能做的智能工作。”这些说法反映了人工智能学科的基本思想和基本内容。即人工智能是研究人类智能活动的规律,构造具有一定智能的人工系统,研究如何让计算机去完成以往需要人的智力才能胜任的工作,也就是研究如何应用计算机的软硬件来模拟人类某些智能行为的基本理论、方法和技术。 人工智能是研究使计算机来模拟人的某些思维过程和智能行为(如学习、推理、思考、规划等)的学科,主要包括计算机实现智能的原理、制造类似于人脑智能的计算机,使计算机能实现更高层次的应用。人工智能将涉及到计算机科学、心

武汉大学文学院各专业培养方案(2010级、2011级、2012级用)

武汉大学文学院简介 文学院中文学科发端于1893年建校之初的自强学堂。起初开设“华文”课,后改称“汉文”。国立武昌高等师范学校时期,于1917年设立国文史地部。1922年正式成立国文系,中文学科从此有了独立的行政建制。1927年改称中国文学系。1928年国立武汉大学成立时设置文学院,闻一多先生出任首任院长。1953年,兄弟学校中文系并入武汉大学组建了新的中国语言文学系。1997年改建文学院。1999年与其他学院合并为人文科学学院。2003年7月恢复文学院建制至今。 文学院暨中文学科创建以来,名流云集,代有传人。在1928 年以前的初创时期,著名学者王葆心、黄福、黄侃、廖立勋、郁达夫、杨振声等等,筚路蓝缕,开启先路,奠定了文学院的坚实基础。其中,黄侃先生与章太炎先生所创立的“章黄学派”饮誉海内外,对文学院的学风和学术发展产生了深远影响。1928年之后的数十年是文学院的发展壮大时期。杨树达、闻一多、刘博平、刘永济、刘异、游国恩、苏雪林、叶圣陶、沈从文、朱东润、高亨、冯沅君、袁昌英、陈西滢、徐天闵、朱光潜、陈登恪、席鲁思、黄焯、程千帆、刘绶松、胡国瑞、李健章、周大璞、李格非等先辈,鞠躬尽瘁,不断开拓,使文学院的中文学科迅速发展壮大、走向辉煌,跃居全国同类学科前列。尤其是五十年代,以“五老八中”为代表的学术中坚声名远播。改革开放以来,是文学院奋发图强、蓬勃向上的时期。这一时期,刘禹昌、吴林伯、王启兴、陆耀东、王文生、吴志达、何国瑞、蔡守湘、易竹贤、罗立乾、陈美兰、李希贤、夏渌、郑远汉、宗福邦、杨合鸣、龙泉明等学者,励精图治,奋起直追,为文学院再铸辉煌做出了重要贡献。 如今的文学院,下设中国文学系、汉语言文化系、大学语文部、古籍整理研究所、《长江学术》杂志社、《写作》杂志社等常设机构,还与“国家汉办”合作建立了“汉语国际推广教学资源研究与开发基地”,建有海外孔子学院。共有教职工88人,其中专任教师65人。教师中教授32人,博士生导师30人,副教授26人。学院拥有中国语言文学一级学科博士学位授予权和博士后流动站;拥有国家重点学科一个,国家重点培育学科一个,中国语言文学一级学科被评为湖北省重点学科,中国现当代文学和中国古代文学分别被评为湖北省优势学科和特色学科。人才培养方面,在国家规定的中国语言文学学科的8个学位点中,除中国少数民族语言文学之

研学方案

“研学旅行”实施方案 一、项目实施背景 从2013年发布《国民休闲旅游纲要》到2016年的《关于推进中小学生研学旅行的意见》,国家教育部等多部门发文要求大力推进研学旅行。研学旅行有利于促进学生培育和践行社会主义核心价值观,激发学生对党、对国家、对人民的热爱之情;有利于推动全面实施素质教育,创新人才培养模式,引导学生主动适应社会,促进书本知识和生活经验的深度融合;有利于加快提高人民生活质量,满足学生日益增长的旅游需求,从小培养学生文明旅游意识,养成文明旅游行为习惯。近年来,各地积极探索开展研学旅行,部分试点地区取得显著成效,在促进学生健康成长和全面发展等方面发挥了重要作用。二、定位与宗旨 目前大多数研学旅行还处在研究开发状态,良莠不齐,市场认可度不够,家长热度不高(尤其省内)。这是我们的机遇,也是挑战,我们的定位是要打造出一个学校认可、家长认可、学生认可的研学品牌,让学生在研学中学到东西。 三、具体实施 (一)方案A:纯旅游研学 本方案以若干旅游景点为研学地点,前期采取跟旅行社合作的方式(合作方式有待探讨),研学的核心(课件+“内容”)内容采取跟大学历史系或者旅游系的老师合作。 该方案的优点:该方案采用跟旅行社合作,研学路线可以借用

旅行社的优势,资源充分整合,老师和家长的路线选择多,可以极大丰富学生的课外知识,并且可以开展夏令营和冬令营活动。缺点是要综合考虑各个年龄段的学生,路线过多,会导致前期工作准备不够充足。 方案细节初步安排如下: 1、前期工作(3月20日-3月30日): (1)与某个旅行社达成合作关系(目前有合作意向的有康辉旅行社); (2)与某个大学的历史或者旅游系老师达成合作关系,负责研学核心内容的开发,包括路线的选择和内容的开发 (3)完成计划的策划和确定具体实施细节。 2、中期工作(4月1日-5月30日) (1)4月1日-4月15日与旅行社和老师确定最终的研学路线; (2)4月15日-5月30日一个半月的时间根据最终具体的研学路线,来做具体的研学课件和研学内容,研究出研学到底应该让学生学到什么,怎么保证学生能学到这些; (3)同时根据最终确定的研学方案做好定价方案,在这个过程中要充分进行调研,进学校、访家长,做到收费合理; (4)根据做好的方案做好线上推广,把做好的资料全部上传到线上,可以参考北京世纪明德。

深度文本匹配综述_庞亮

网络出版时间:2016-09-20 21:04:43 网络出版地址:https://www.360docs.net/doc/da8532162.html,/kcms/detail/11.1826.TP.20160920.2104.006.html 第39卷计算机学报Vol. 39 深度文本匹配综述 庞亮1),2)3)兰艳艳1)2) 徐君1)2) 郭嘉丰1)2) 万圣贤1),2)3) 程学旗1)2) 1)(中国科学院网络数据科学与技术重点实验室北京 100190) 2)(中国科学院计算技术研究所,北京 100190) 3)(中国科学院大学,北京100190) 摘要自然语言理解的许多任务,例如信息检索、自动问答、机器翻译、对话系统、复述问题等等,都可以抽象成文本匹配问题。过去研究文本匹配主要集中在人工定义特征之上的关系学习,模型的效果很依赖特征的设计。最近深度学习自动从原始数据学习特征的思想也影响着文本匹配领域,大量基于深度学习的文本匹配方法被提出,我们称这类模型为深度文本匹配模型。相比于传统方法,深度文本匹配模型能够从大量的样本中自动提取出词语之间的关系,并能结合短语匹配中的结构信息和文本匹配的层次化特性,更精细地描述文本匹配问题。根据特征提取的不同结构,深度文本匹配模型可以分为三类:基于单语义文档表达的深度学习模型、基于多语义文档表达的深度学习模型和直接建模匹配模式的深度学习模型。从文本交互的角度,这三类模型具有递进的关系,并且对于不同的应用,具有各自性能上的优缺点。本文在复述问题、自动问答和信息检索三个任务上的经典数据集上对深度文本匹配模型进行了实验,比较并详细分析了各类模型的优缺点。最后本文对深度文本模型未来发展的若干问题进行了讨论和分析。 关键词文本匹配;深度学习;自然语言处理;卷积神经网络;循环神经网络 中图法分类号TP18 论文引用格式: 庞亮,兰艳艳,徐君,郭嘉丰,万圣贤,程学旗,深度文本匹配综述,2016,V ol.39,在线出版号No. 128 Pang Liang,Lan Yanyan,Xu Jun,Guo Jiafeng,Wan Shengxian ,Cheng Xueqi,A Survey on Deep Text Matching,2016,V ol.39,Online Publishing No.128 A Survey on Deep Text Matching Pang Liang 1),2)3)Lan Yanyan 1)2) Xu Jun 1)2) Guo Jiafeng 1)2)Wan Shengxian 1),2)3) Cheng Xueqi 1)2) 1)(CAS Key Lab of Network Data Science and Technology, Beijing100190) 2)(Institute of Computing Technology, Chinese Academy of Sciences, Beijing100190) 3)(University of Chinese Academy of Sciences, Beijing 100190) Abstract Many problems in natural language processing, such as information retrieval, question answering, machine translation, dialog system, paraphrase identification and so on, can be treated as a problem of text ——————————————— 本课题得到国家重点基础研究发展计划(973)(No. 2014CB340401, 2013CB329606)、国家自然科学基金重点项目(No.61232010, 61472401, 61425016, 61203298)、中国科学院青年创新促进会(No. 20144310,2016102)资助.庞亮(通讯作者),男,1990年生,博士,学生,计算机学会(CCF)学生会员(59709G),主要研究领域为深度学习与文本挖掘.E-mail: pangliang@https://www.360docs.net/doc/da8532162.html,.兰艳艳,女,1982年生,博士,副研究员,计算机学会(CCF)会员(28478M),主要研究领域为统计机器学习、排序学习和信息检索.E-mail: lanyanyan@https://www.360docs.net/doc/da8532162.html,.徐君,男,1979年生,博士,研究员,计算机学会(CCF)会员, 主要研究领域为信息检索与数据挖掘.E-mail: junxu@https://www.360docs.net/doc/da8532162.html,.郭嘉丰,男,1980年生,博士,副研究员,计算机学会(CCF)会员, 主要研究领域为信息检索与数据挖掘.E-mail: guojiafeng@https://www.360docs.net/doc/da8532162.html,.万圣贤,男,1989年生,博士,学生,主要研究领域为深度学习与文本挖掘.E-mail: wanshengxian@https://www.360docs.net/doc/da8532162.html,.程学旗,男,1971年生,博士,研究员,计算机学会(CCF)会员, 主要研究领域为网络科学、互联网搜索与挖掘和信息安全等.E-mail: cxq@https://www.360docs.net/doc/da8532162.html,.

计算语言学与语义分析

汉语计算语言学与语义分析研究 编码——解码 表达——理解 自然语言生成——自然语言处理 只有真正熟悉了汉语的语素,词,词义以及相互之间的 关系,才能正确的理解出语义,并制定相关的语义解析 规则

一绪论 1、语义识别背景 语义识别是在语音识别(或其它模式识别)的基础上,对获取的客观字符文本数据,做进一步的分析挖掘,提取其中所包含 的用户主观意图 语义识别技术,目的是让计算机能够理解人类的语言。通俗的定义:即通过用户无规则的说话就能知道用户想做什么 语义识别技术涉及:海量数据处理、分词、语素、义素、语义特征建模、规则库等主要技术

音节和音节相连时,有的音节的调值会发生有规律的变化 有些音节的读音在一定条件下失去了原有声调的调值 句子不同的连停方式,也会对语义的理解产生影响语音中的重音强调不同,所含的语义也不同 语音影响语义 有些音节的读音在一定条件下失去了原有声调的调值 2、语音对语义识别的影响 汉字的读音影响机器语音识别,进而影响到语义识别

?2、语义识别的关键技术难点?(1)提供高准确率的语音识别系统?(2)系统分词算法的精确度?(3)计算机如何尽可能的消除歧义?(4)语义分析的特征建模 ?(5)服务于建模的规则库的建立

语法基本单位 语素最小的语法单位,是语言中最小的音 义结合体,既有声音,又有意义 “妹妹不吃白菜”就包 含 “妹”“妹”“不”“ 吃”“白”“菜”这六 个语素 词有意义的能独立运用的最小的语言语 法单位,词都是由语素构成的 妹—妹妹、白—菜—白 菜、不—吃—不吃 词组词和词按一定句法规则组合成的比词 大的语法单位 句子“长虹生产电视” 是由“长虹”和词组 “生产电视”组成的, 而“生产电视”又是由 词组“生产”和“电视” 组成的 句子语言中最大的语法单位,通常是由一 个词或者词组加上一个句调形成的 (1)你喜欢看电视吗? (2)能看高清电视了!

(整理)大气科学概论试卷

《大气科学概论》试卷 姓名评分 一、名词解释(5*4=20) 1、虚温—— 2、静力平衡—— 3、大气逆辐射—— 4、位温—— 5、梯度风—— 二、填空(12*2=24) 1、地球大气经历了原始大气、次生大气和三个演化阶段。 2、大气的垂直结构分为对流层、、中层、热层和外逸层。 3、据观测,对流层大气的的温度垂直递减率(γ)约为℃/100M。 4、大气中吸收红外辐射的成分主要是和液态水。 5、太阳和大气的辐射光谱都与波长和有关。 6、常见的大气温度极值有和极端极值两种。 7、未饱和湿空气上升达到饱和的高度称为。 8、在假绝热过程中,为保守量。 9、在层结曲线位于状态曲线的侧时,大气具有不稳定能量。 10、当与地转偏向力相平衡,大气沿等压线作匀速运动。 11、三圈经向环流是指、弗雷尔环流和极地环流。 12、北半球的四个气压带是极地高压带、副极地低压带、和 赤道辐合带。 三、选择(8*2=16) 1、大气圈中水的更新周期大约为() A 一周 B 一个月 C 一个季度 D 一年 2、观测表明,在1.5-2km高度上,水汽含量为地面的() A 1/2 B 1/3 C 1/4 D 1/5 3、大气的降水显弱酸性,酸雨的PH值则小于() A 6.6 B 6.5 C 5.6 D 5.5 4、大气中对太阳直接辐射的紫外线吸收最多的成分是() A O2 B O3 C H2O D CO2 5、气温日较差随季节变化最大的地区是() A 极地 B 高纬度 C 中纬度 D 低纬度 6、决定饱和湿空气稳定度的是() A γ B γd C γm D γAC 7、在纬度和气压梯度相同的情况下,气旋的风速相比于反气旋要()

江南营江南深度研学之旅1

江南营-江南深度研学之旅(1)

————————————————————————————————作者:————————————————————————————————日期:

诗梦江南,入画寻踪 ——长清区实验小学江南深度研学实践 之旅 【课程简介】 一道水,一架桥,一支橹声,隽秀婉约的杭州绍兴聚合了太多的历史文化。此次研学活动旨在让同学们了解祖国江南,同时感受一场从远古传说,到春秋的吴越文化,到南北朝的文人风骨,再到明清以及近代的大儒伟人的历史盛宴。活动中,同学们将一起寻访王羲之、蔡元培、鲁迅、周恩来等名人伟人故里,穿越历史,陶冶爱国之志,体悟文化魅力;一起走进沈园,欣赏宋代江南私家园林的秀美景观,探寻园林蕴含的文化内涵;一起游历西湖,领略“淡妆浓抹总相宜”的如画美景;一起走进综合性人文科学博物馆浙江博物馆、中国黄酒博物馆,全面了解浙江历史文化。 【课程特色】 ●文化名镇江南风采 ●穿越时空触摸历史 【行程简表】 时间课程安排课程主题课程链接 第一天上午乘坐高铁前往杭州:车次G63 济南-杭州东 07:23-11:53辅导员接站读万卷书行万里路下午参观钱塘江、六和塔看天下第一潮登镇潮六和塔追寻江畔的历史故事 晚上研学课程指导分组讨论课程,研学收获分享 实践-辅导员指导学生完成课程手 册 第二天上午 游历杭州西湖置身如画美景感受西湖柔情参观苏堤、孤山、曲院风荷 浙江博物馆参观历史展品考察浙江文化感受历史文化的沉淀 下午灵隐寺、飞来峰登山览胜景寺宇悟佛心登山参观庙宇,了解佛教文化 晚上研学课程指导分组讨论课程,研学收获分享实践-辅导员指导学生完成课程手册 第三天上午探访鲁迅故里探寻书中世界亲访三味书屋追寻鲁迅先生的足迹 下午 游览沈园漫步江南园林,探寻文化内涵 人文-体味江南风情/建筑-江南园林建 筑风格 参观黄酒博物馆参观历史文物体悟江南魅力历史-绍兴历史文化 晚上 大善塔 仓桥直街 漫步古城小道欣赏绍兴夜色实践-实地感受,见景抒情 第四天上午书圣故里历史街区历游文人旧地感受文化魅力人文-文人旧所、大家荟萃

大气科学概论

《大气科学概论》试卷(A) 姓名评分 一、名词解释(5*4=20) 1、虚温-- 2、静力平衡-- 3、大气逆辐射-- 4、位温-- 5、梯度风-- 二、填空(12*2=24) 1、地球大气经历了原始大气、次生大气和三个演化阶段。 2、大气的垂直结构分为对流层、、中层、热层和外逸层。 3、据观测,对流层大气的的温度垂直递减率(γ)约为℃/100M。 4、大气中吸收红外辐射的成分主要是和液态水。 5、太阳和大气的辐射光谱都与波长和有关。 6、常见的大气温度极值有和极端极值两种。 7、未饱和湿空气上升达到饱和的高度称为。 8、在假绝热过程中,为保守量。 9、在层结曲线位于状态曲线的侧时,大气具有不稳定能量。 10、当与地转偏向力相平衡,大气沿等压线作匀速运动。 11、三圈经向环流是指、弗雷尔环流和极地环流。 12、北半球的四个气压带是极地高压带、副极地低压带、和赤道辐合带。 三、选择(8*2=16) 1、大气圈中水的更新周期大约为() A 一周 B 一个月 C 一个季度 D 一年 2、观测表明,在1.5-2km高度上,水汽含量为地面的() A 1/2 B 1/3 C 1/4 D 1/5 3、大气的降水显弱酸性,酸雨的PH值则小于() A 6.6 B 6.5 C 5.6 D 5.5 4、大气中对太阳直接辐射的紫外线吸收最多的成分是() A O2 B O3 C H2O D CO2 5、气温日较差随季节变化最大的地区是() A 极地 B 高纬度 C 中纬度 D 低纬度 6、决定饱和湿空气稳定度的是() A γ B γd C γm D γAC 7、在纬度和气压梯度相同的情况下,气旋的风速相比于反气旋要() A 较大 B 较小 C 相同 D 不确定

研学

第一单元 课题人与自我?我自信,会成功 学习目标正确认识自我,能够说出自己的优点和不足;增强自我调控、承受挫折、适应环境的能力;了解树立自信心的方法,培养健全的人格和良好的心理素质;提高心理健康水平,增强自我教育能力,形成健康、自信的人生观。参考主题(1)我自信,会成功;(2)克服考试焦虑;(3)消除孤独感。 实践方式心理测试;收集资料;手工制作。 方法引导发表意见的技巧;如何对调查结果进行统计与分析。 学科整合与心理健康教育、品德与社会、语文等学科整合。关注心理健康,形成健康的生活态度;善于发现其他同学身上的优点并虚心学习;学习名人名言,领悟其深刻含义,并激励自己;进行小制作设计。 课时安排5课时 教学流程 第一课时 研究准备 我们一天天地长大,从妈妈怀里的婴儿,长成了少年。想想自己在成长过程中有哪些烦恼?你是怎么解决的? 同学们根据自己的兴趣自主确定设计研究方案,其方法一般是: 1、我的烦恼及解决的办法 2、我自信,会成功 3、消除孤独感 以上方案进行研究、讨论、尝试初步建立印象。 第二课时 我自信,会成功 一、研究实施 自信对我们走向成功非常重要。今天,就我们一起通过探究活动来寻找自信,增强自信! 二、方法与引导: 发表意见的技巧 1、态度诚恳、谦逊。多采用“我个人认为”、“我目前的想法是”等表达方式; 2、不能只发表否定性意见,对好的方面要充分肯定; 3、对事不对人,只针对事情发表意见; 4、通过举例等方式,引导他人发现存在的问题; 5、避免个人垄断话题,邀请不善于发表意见的组员参与讨论。 三、“我自信,会成功”研究方案 主题名称研究时间 研究目的1、正确认识自己,发现自己的优点与不足 2、

搜索引擎技术与发展综述

工程技术 Computer CD Software and Applications 2012年第14期 — 24 — 搜索引擎技术与发展综述 孙宏,李戴维,董旭阳,季泽旭 (中国电子科技集团第十五研究所信息技术应用系统部,北京 100083) 摘 要:随着信息技术的飞速发展和互联网的广泛普及,信息检索技术越来越受到重视。阐述了搜索引擎的产生与发展,并对搜索引擎的核心技术、评价指标和工作原理进行了深入研究。介绍了一些著名的搜索引擎。在此基础上,对搜索引擎的发展方向进行了预测。 关键词:信息技术;信息检索;搜索引擎 中图分类号:TP311.52 文献标识码:A 文章编号:1007-9599 (2012) 14-0024-03 一、引言 信息技术如今迅速发展,Internet 也得到了广泛的普及,网络上的信息量正在以指数趋势上升。其信息来源分布广泛,种类繁多。如果不能对信息进行有序化管理,用户将很难从如此海量的信息中提取出他们需要的信息。目前,搜索引擎已经成为人们获取信息的主要手段之一。搜索引擎就是在繁琐复杂的互联网信息中通过特定的检索策略,对信息进行搜索与分类,通过分析用户提交的请求,按照用户的要求和习惯进行组织,从而达到用户快速检索特定信息的目的。目前搜索引擎提供的搜索方式主要有整句、主题词、自由词等等,用以适应不同用户的需求。 二、搜索引擎的产生与发展 蒙特利尔大学的Alan Emtage 实现了最初的搜索引擎,称为Archie 引擎,Archie 引擎可以在特定的网络中进行相关的信息检索。由于其工作原理与现代搜索引擎非常接近,我们通常认为他 开创了现代搜索引擎领域。搜索引擎的发展大致经历过了三代: (1)第一代搜索引擎是1994年Michael Mauldin 将John Leavitt 的“网络爬虫”程序接入到其索引程序中的Lycos 。由于 结构和技术相对不成熟,它的搜索速度比较慢,更新速度也不能满足用户的检索要求。 (2)美国斯坦福大学的David Filo 和美籍华人杨致远合作开发成功了第二代搜索引擎,它创立了一些用户关心的目录,用户可以通过目录进行检索。 (3)Google 的正式推出标志着第三代搜索引擎的诞生。其集成了搜索、分类、多语言支持等功能,同时提供了摘要、排序、快照等功能,另外与强大的硬件系统配合,大大改变了互联网用户检索网络信息的方式。第三代搜索引擎主要结构如图-1所示。 查询接口的作用是用户进行交互,即提取用户的输入,并将检索结果返回。 检索器依据用户的需求,可以方便地索引库中查找相应的文档,按照相关度规则进行重排后返回。 索引器负责对文档建立索引,使文档以便于检索的方式重新组织。 分析器负责对收集器收集的信息进行分析和整理。 信息收集器的主要任务是对互联网上的各种信息进行收集,同时记录信息URL 地址(网络 爬虫完成这项工作)。 图1 搜索引擎结构图 三、搜索引擎的工作原理 搜索引擎不是搜索互联网,它搜索的是预先整理好的索引数据库;同样,搜索引擎也不能理解网页上的内容,它只能匹配网页上的文字。搜索引擎的工作流 程如图-2所示。 图2 搜索引擎的工作流程 搜索引擎的工作流程可主要分为四个步骤:通过网络爬虫(Spider )从互联网上根据相关算法(深度优先、广度优先)抓取网页,抓取网页后对网页中的信息进行加工,加工后将处理后的信息保存到索引数据库中。当用户在索引数据库中搜索查询相 关的信息资源时,搜索结果通过搜索引擎的处理后,对返回结果进行排序,展现给用户。即: (1)利用网络爬虫从互联网上抓取网页:利网络爬虫,按照某种搜索策略,沿着URL 链接爬到其他网页,重复这些过程,并把所有爬过的网页抓取回来。 (2)建立索引数据库:对爬取到的网页进行分析,提取相关关键信息,得到每一个网页针对页面中文字及链接中每一个关键词的重要性,屏蔽掉不重要的词语后,用信息建立网页索引数据库。 (3)处理用户的查询请求:系统接收到用户要查询的关键字后,调用检索器进行搜索,并将返回的结果进行相关度排序,最后按照优先度降序的方式存储在返回结果集合中。 (4)将查询结果返回给用户:搜索结果以网页的形式将结果集中的返回给用户。方便用户查看。 按照上面的步骤就可以简单的架构一个搜索引擎系统供用户使用。目前有很多开源的搜索引擎产品已经完成了上述相关内容,使用者只需要进行相应的配置就可以使用,大大的简化了搜索引擎的开发。目前,比较流行的开源搜索引擎有Nutch 、Solr 等等。 四、搜索引擎的核心技术 搜索引擎的核心技术包括索引技术和检索技术。 (一)索引技术 顺序查找,即通过线性匹配文本进行查找是一种不使用索引进行检索的例子。它无需对文档中的信息进行预处理。这种检索方式在文本较大时检索速度会变得非常慢,通常情况下不使用这种检索方式。