【CN110059079A】一种基于大数据建模分析的人员违法犯罪预测方法和系统【专利】

(19)中华人民共和国国家知识产权局

(12)发明专利申请

(10)申请公布号 (43)申请公布日 (21)申请号 201910350143.8

(22)申请日 2019.04.28

(71)申请人 北京深醒科技有限公司

地址 100013 北京市海淀区大钟寺东路9号

1幢318室

(72)发明人 袁培江 李毅彬 董敬医 汪斌

赖利锋 宋博 郭军令 马兴江

郝文峰 王忠孝 袁金鑫

(74)专利代理机构 北京金蓄专利代理有限公司

11544

代理人 雷彬彬

(51)Int.Cl.

G06F 16/21(2019.01)

G06F 16/28(2019.01)

G06K 9/62(2006.01)

G06Q 50/26(2012.01)

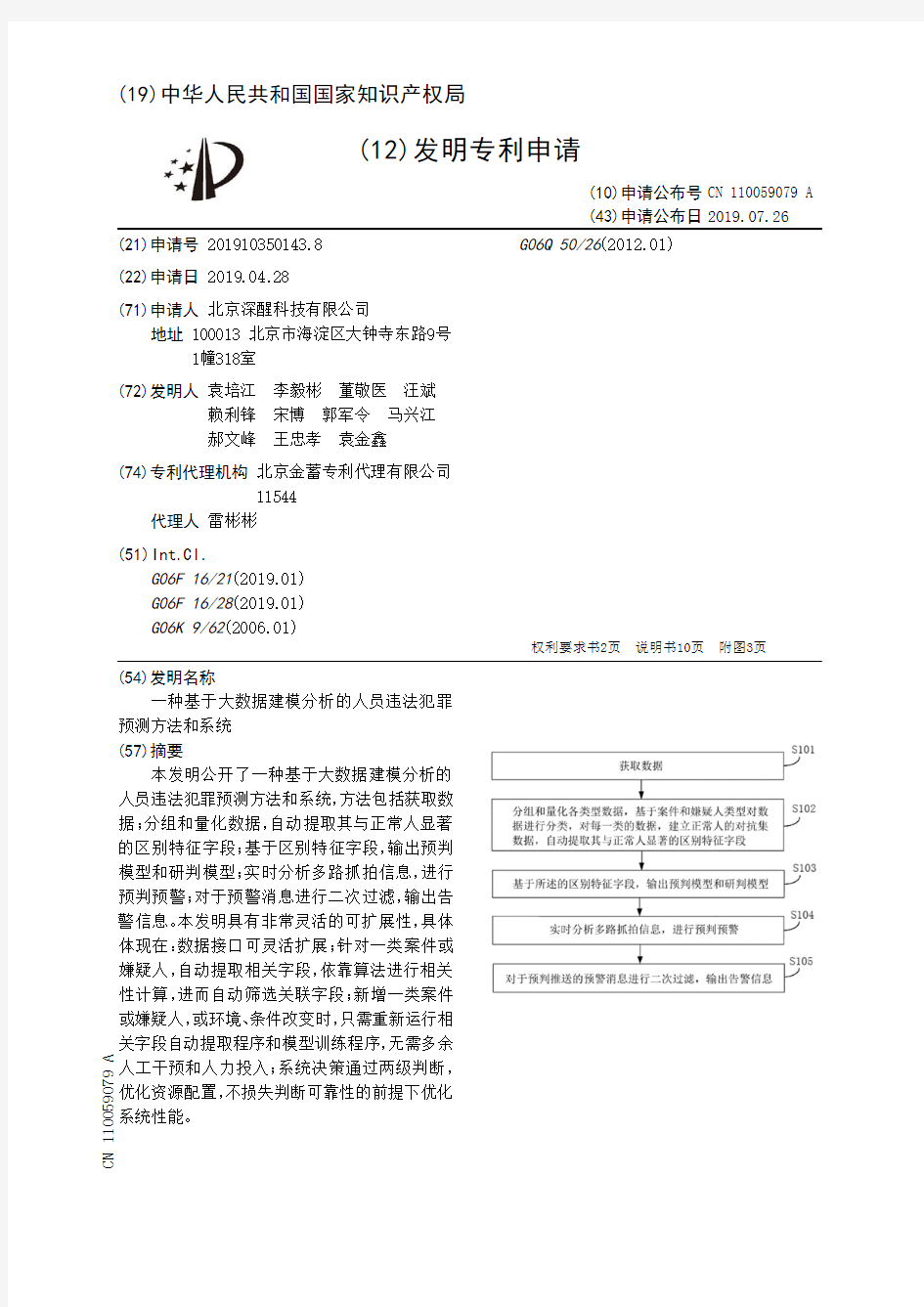

(54)发明名称一种基于大数据建模分析的人员违法犯罪预测方法和系统(57)摘要本发明公开了一种基于大数据建模分析的人员违法犯罪预测方法和系统,方法包括获取数据;分组和量化数据,自动提取其与正常人显著的区别特征字段;基于区别特征字段,输出预判模型和研判模型;实时分析多路抓拍信息,进行预判预警;对于预警消息进行二次过滤,输出告警信息。本发明具有非常灵活的可扩展性,具体体现在:数据接口可灵活扩展;针对一类案件或嫌疑人,自动提取相关字段,依靠算法进行相关性计算,进而自动筛选关联字段;新增一类案件或嫌疑人,或环境、条件改变时,只需重新运行相关字段自动提取程序和模型训练程序,无需多余人工干预和人力投入;系统决策通过两级判断,优化资源配置,不损失判断可靠性的前提下优化

系统性能。权利要求书2页 说明书10页 附图3页CN 110059079 A 2019.07.26

C N 110059079

A

权 利 要 求 书1/2页CN 110059079 A

1.一种基于大数据建模分析的人员违法犯罪预测方法,其特征在于:包括:

获取数据;

分组和量化各类型数据,基于案件和嫌疑人类型对数据进行分类,对每一类的数据,建立正常人的对抗集数据,自动提取其与正常人显著的区别特征字段;

基于所述的区别特征字段,输出预判模型和研判模型;

实时分析多路抓拍信息,进行预判预警;

对于预判推送的预警消息进行二次过滤,输出告警信息。

2.根据权利要求1所述的一种基于大数据建模分析的人员违法犯罪预测方法,其特征在于:所述数据来源为本地数据库中存储的数据或通过接口调用获取的数据,通过接口调用获取的数据需要与本地数据库中的人员进行关联。

3.根据权利要求1所述的一种基于大数据建模分析的人员违法犯罪预测方法,其特征在于:所述分组和量化各类型数据,基于案件和嫌疑人类型对数据进行分类,对每一类的数据,建立正常人的对抗集数据,自动提取其与正常人显著的区别特征字段,具体为:基于数据特征,对数据进行分组和量化;

基于卡方值,提取和案件或嫌疑人最相关的特征字段。

4.根据权利要求3所述的一种基于大数据建模分析的人员违法犯罪预测方法,其特征在于:所述分组方法为:

对于数值型的字段,按照数值范围分组;

对于字符串类型的字段,优先转为为数值型的字段处理;

对于无法数值化但字符集有限的字段,按照不同的字符类型分组;

对于既不能数值化,也无法按照有限字符集分组的字段,按照其字符特征,使用KMEANS 聚类的方法,将数据分成有限个组别。

5.根据权利要求4所述的一种基于大数据建模分析的人员违法犯罪预测方法,其特征在于:所述量化方法为对于分组后的结果,每一组分配一个对应的量化数值。

6.根据权利要求3所述的一种基于大数据建模分析的人员违法犯罪预测方法,其特征在于:基于卡方值,提取和案件或嫌疑人最相关的特征字段,具体为:

在将某一字段分组量化后,计算该字段对应某类案件或某类嫌疑人的卡方值,选取卡方值最高的方式,作为该类型的最终分组方案;

针对某一类案件或某类嫌疑人,将全部字段分组量化计算卡方值后,选取其中卡方值最高的若干字段,作为该类案件或该类嫌疑人的特征。

7.根据权利要求1所述的一种基于大数据建模分析的人员违法犯罪预测方法,其特征在于:所述实时分析多路抓拍信息,进行预判预警,具体包括:

抓拍的人像数据或人工检索操作触发比对服务;

对于人员身份和数据信息量化后,输入训练好的模型中进行判断并返回判断结果;

根据返回结果,如果超过预警阈值,对于预判推送的预警消息进行二次过滤,否则更新人员信息后,不在做其他操作处理。

8.根据权利要求7所述的一种基于大数据建模分析的人员违法犯罪预测方法,其特征在于:所述对于预判推送的预警消息进行二次过滤,输出告警信息,具体包括:预判推送的的人像信息或人工检索操作,触发判断逻辑;

2

数据分析算法与模型一附答案

精品文档 数据分析算法与模型模拟题(一) 一、计算题(共4题,100分) 1、影响中国人口自然增长率的因素有很多,据分析主要因素可能有:(1)从宏观经济上看,经济整体增长是人口自然增长的基本源泉;(2)居民消费水平,它的高低可能会间接影响人口增长率。(3)文化程度,由于教育年限的高低,相应会转变人的传统观念,可能会间接影响人口自然增长率(4)人口分布,非农业与农业人口的比率也会对人口增长率有相应的影响。为了全面反映中国“人口自然增长率”的全貌,选择人口增长率作为被解释变量,以反映中国人口的增长;选择“国名收入”及“人均GDP”作为经济整体增长的代表;选择“居民消费价格指数增长率”作为居民消费水平的代表。暂不考虑文化程度及人口分布的影响。 从《中国统计年鉴》收集到以下数据(见表1): 表1 中国人口增长率及相关数据 人口自然增长率国民总收入居民消费价格指数增长人均GDP 年份(元)率((亿元) CPI(%。))% 1366 15037 1988 15.73 18.8 1519 1989 18 17001 15.04 1644 18718 1990 14.39 3.1 1893 21826 3.4 1991 12.98 2311 26937 11.6 6.4 1992 2998 35260 14.7 11.45 1993 4044 48108 1994 24.1 11.21 5046 17.1 10.55 59811 1995 5846 70142 1996 10.42 8.3 6420 10.06 1997 2.8 78061 -0.8 1998 9.14 83024 6796 8.18 7159 1999 88479 -1.4 7858 2000 0.4 7.58 98000 精品文档. 精品文档

《大数据时代下的数据挖掘》试题及答案要点

《海量数据挖掘技术及工程实践》题目 一、单选题(共80题) 1)( D )的目的缩小数据的取值范围,使其更适合于数据挖掘算法的需要,并且能够得到 和原始数据相同的分析结果。 A.数据清洗 B.数据集成 C.数据变换 D.数据归约 2)某超市研究销售纪录数据后发现,买啤酒的人很大概率也会购买尿布,这种属于数据挖 掘的哪类问题?(A) A. 关联规则发现 B. 聚类 C. 分类 D. 自然语言处理 3)以下两种描述分别对应哪两种对分类算法的评价标准? (A) (a)警察抓小偷,描述警察抓的人中有多少个是小偷的标准。 (b)描述有多少比例的小偷给警察抓了的标准。 A. Precision,Recall B. Recall,Precision A. Precision,ROC D. Recall,ROC 4)将原始数据进行集成、变换、维度规约、数值规约是在以下哪个步骤的任务?(C) A. 频繁模式挖掘 B. 分类和预测 C. 数据预处理 D. 数据流挖掘 5)当不知道数据所带标签时,可以使用哪种技术促使带同类标签的数据与带其他标签的数 据相分离?(B) A. 分类 B. 聚类 C. 关联分析 D. 隐马尔可夫链 6)建立一个模型,通过这个模型根据已知的变量值来预测其他某个变量值属于数据挖掘的 哪一类任务?(C) A. 根据内容检索 B. 建模描述 C. 预测建模 D. 寻找模式和规则 7)下面哪种不属于数据预处理的方法? (D) A.变量代换 B.离散化

C.聚集 D.估计遗漏值 8)假设12个销售价格记录组已经排序如下:5, 10, 11, 13, 15, 35, 50, 55, 72, 92, 204, 215 使用如下每种方法将它们划分成四个箱。等频(等深)划分时,15在第几个箱子内? (B) A.第一个 B.第二个 C.第三个 D.第四个 9)下面哪个不属于数据的属性类型:(D) A.标称 B.序数 C.区间 D.相异 10)只有非零值才重要的二元属性被称作:( C ) A.计数属性 B.离散属性 C.非对称的二元属性 D.对称属性 11)以下哪种方法不属于特征选择的标准方法: (D) A.嵌入 B.过滤 C.包装 D.抽样 12)下面不属于创建新属性的相关方法的是: (B) A.特征提取 B.特征修改 C.映射数据到新的空间 D.特征构造 13)下面哪个属于映射数据到新的空间的方法? (A) A.傅立叶变换 B.特征加权 C.渐进抽样 D.维归约 14)假设属性income的最大最小值分别是12000元和98000元。利用最大最小规范化的方 法将属性的值映射到0至1的范围内。对属性income的73600元将被转化为:(D) A.0.821 B.1.224 C.1.458 D.0.716 15)一所大学内的各年纪人数分别为:一年级200人,二年级160人,三年级130人,四年 级110人。则年级属性的众数是: (A) A.一年级 B.二年级 C.三年级 D.四年级

数据分析建模简介

数据分析建模简介 观察和实验是科学家探究自然的主要方法,但如果你有数据,那么如何让这些数据开口说话呢?数据用现代人的话说即信息,信息的挖掘与分析也是建模的一个重要方法。 1.科学史上最有名的数据分析例子 开普勒三定律 数据来源:第谷?布拉赫(1546-1601,丹麦人),观察力极强的天文学家,一辈子(20年)观察记录了750颗行星资料,位置误差不超过0.67°。 观测数据可以视为实验模型。 数据处理:开普勒(1571-1630,德国人),身体瘦弱、近视又散光,不适合观天,但有一个非常聪明的数学头脑、坚韧的性格(甚至有些固执)和坚强的信念(宇宙是一个和谐的整体),花了16年(1596-1612)研究第谷的观测数据,得到了开普勒三定律。 开普勒三定律则为唯象模型。 2.数据分析法 2.1 思想 采用数理统计方法(如回归分析、聚类分析等)或插值方法或曲线拟合方法,对已知离散数据建模。 适用范围:系统的结构性质不大清楚,无法从理论分析中得到系统的规律,也不便于类比,但有若干能表征系统规律、描述系统状态的数据可利用。 2.2 数据分析法 2.2.1 基础知识 (1)数据也称观测值,是实验、测量、观察、调查等的结果,常以数量的形式给出; (2)数据分析(data analysis)是指分析数据的技术和理论; (3)数据分析的目的是把隐没在一大批看来杂乱无章的数据中的信息集中、萃取和提炼出来,以找出所研究对象的内在规律;

(4)作用:在实用中,它可帮助人们作判断,以采取适当行动。 (5)实际问题所涉及的数据分为: ①受到随机性影响(随机现象)的数据; ②不受随机性影响(确定现象)的数据; ③难以确定性质的数据(如灰色数据)。 (6)数理统计学是一门以收集和分析随机数据为内容的学科,目的是对数据所来自的总体作出判断,总体有一定的概率模型,推断的结论也往往一概率的形式表达(如产品检验合格率)。 (7)探索性数据分析是在尽量少的先验假定下处理数据,以表格、摘要、图示等直观的手段,探索数据的结构及检测对于某种指定模型是否有重大偏离。它可以作为进一步分析的基础,也可以对数据作出非正式的解释。 实验者常常据此扩充或修改其实验方案(作图法也该法的重要方法,如饼图、直方图、条形图、走势图或插值法、曲线(面)拟合法等)。 2.2.2 典型的数据分析工作步骤 第一步:探索性数据分析 目的:通过作图、造表、用各种形式的方程拟合、计算某些特征量等手段探索规律性的可能形式,即往什么方向和用何种方式去寻找和揭示隐含在数据中的规律性。 第二步:模型选定分析 目的:在探索性分析的基础上,提出一类或几类可能的模型(如进一步确定拟合多项式(方程)的次数和各项的系数)。 第三步:推断分析 目的:通常用数理统计或其它方法对所选定的模型或估计的可靠程度或精确程度作出推断(如统计学中的假设检验、参数估计、统计推断)。3.建模中的概率统计方法 现实世界存在确定性现象和随机现象,研究随机现象主要由随机数学来承担,随机数学包括十几个分支,但主要有概率论、数理统计、试验设计、贝叶

16种常用数据分析方法

一、描述统计描述性统计是指运用制表和分类,图形以及计筠概括性数据来描述数据的集中趋势、离散趋势、偏度、峰度。 1、缺失值填充:常用方法:剔除法、均值法、最小邻居法、比率回归法、决策 树法。 2、正态性检验:很多统计方法都要求数值服从或近似服从正态分布,所以之前需要进行正态性检验。常用方法:非参数检验的K-量检验、P-P图、Q-Q图、W 检验、动差法。 二、假设检验 1、参数检验 参数检验是在已知总体分布的条件下(一股要求总体服从正态分布)对一些主要的参数(如均值、百分数、方差、相关系数等)进行的检验。 1)U验使用条件:当样本含量n较大时,样本值符合正态分布 2)T检验使用条件:当样本含量n较小时,样本值符合正态分布 A 单样本t检验:推断该样本来自的总体均数卩与已知的某一总体均数卩0 (常为理论值或标准值)有无差别; B 配对样本t 检验:当总体均数未知时,且两个样本可以配对,同对中的两者在可能会影响处理效果的各种条件方面扱为相似; C 两独立样本t 检验:无法找到在各方面极为相似的两样本作配对比较时使用。 2、非参数检验 非参数检验则不考虑总体分布是否已知,常常也不是针对总体参数,而是针对总体的某些一股性假设(如总体分布的位罝是否相同,总体分布是否正态)进行检验。 适用情况:顺序类型的数据资料,这类数据的分布形态一般是未知的。 A 虽然是连续数据,但总体分布形态未知或者非正态; B 体分布虽然正态,数据也是连续类型,但样本容量极小,如10 以下; 主要方法包括:卡方检验、秩和检验、二项检验、游程检验、K-量检验等。 三、信度分析检査测量的可信度,例如调查问卷的真实性。 分类: 1、外在信度:不同时间测量时量表的一致性程度,常用方法重测信度 2、内在信度;每个量表是否测量到单一的概念,同时组成两表的内在体项一致性如何,常用方法分半信度。 四、列联表分析用于分析离散变量或定型变量之间是否存在相关。对于二维表,可进行卡 方检验,对于三维表,可作Mentel-Hanszel 分层分析列联表分析还包括配对计数资料的卡方检验、行列均为顺序变量的相关检验。 五、相关分析 研究现象之间是否存在某种依存关系,对具体有依存关系的现象探讨相关方向及相关程度。 1、单相关:两个因素之间的相关关系叫单相关,即研究时只涉及一个自变量和一个因变量; 2、复相关:三个或三个以上因素的相关关系叫复相关,即研究时涉及两个或两个以

大大数据概念、技术、特点、应用与案例

大数据 目录 一、大数据概念 (1) 二、大数据分析 (2) 三、大数据技术 (3) 四、大数据特点 (4) 五、大数据处理 (4) 六、大数据应用与案例分析 (6) 一、大数据概念 "大数据"是一个体量特别大,数据类别特别大的数据集,并且这样的数据集无法用传统数据库工具对其内容进行抓取、管理和处理。"大数据"首先是指数据体量(volumes)?大,指代大型数据集,一般在10TB?规模左右,但在实际应用中,很多企业用户把多个数据集放在一起,已经形成了PB级的数据量;其次是指数据类别(variety)大,数据来自多种数据源,数据种类和格式日渐丰富,已冲破了以前所限定的结构化数据范畴,囊括了半结构化和非结构化数据。接着是数据处理速度(Velocity)快,在数据量非常庞大的情况下,也能够做到数据的实时处理。最后一个特点是指数据真实性(Veracity)高,随着社交数据、企业内容、交易与应用数据等新数据源的兴趣,传统数据源的局限被打破,企业愈发需要有效的信息之力以确保其真实性及安全性。 "大数据"是需要新处理模式才能具有更强的决策力、洞察发现力和流程优化能力的海量、高增长率和多样化的信息资产。从数据的类别上看,"大数据"

指的是无法使用传统流程或工具处理或分析的信息。它定义了那些超出正常处理范围和大小、迫使用户采用非传统处理方法的数据集。亚马逊网络服务(AWS)、大数据科学家JohnRauser提到一个简单的定义:大数据就是任何超过了一台计算机处理能力的庞大数据量。研发小组对大数据的定义:"大数据是最大的宣传技术、是最时髦的技术,当这种现象出现时,定义就变得很混乱。" Kelly说:"大数据是可能不包含所有的信息,但我觉得大部分是正确的。对大数据的一部分认知在于,它是如此之大,分析它需要多个工作负载,这是AWS的定义。当你的技术达到极限时,也就是数据的极限"。大数据不是关于如何定义,最重要的是如何使用。最大的挑战在于哪些技术能更好的使用数据以及大数据的应用情况如何。这与传统的数据库相比,开源的大数据分析工具的如Hadoop的崛起,这些非结构化的数据服务的价值在哪里。 二、大数据分析 从所周知,大数据已经不简简单单是数据大的事实了,而最重要的现实是对大数据进行分析,只有通过分析才能获取很多智能的,深入的,有价值的信息。那么越来越多的应用涉及到大数据,而这些大数据的属性,包括数量,速度,多样性等等都是呈现了大数据不断增长的复杂性,所以大数据的分析方法在大数据领域就显得尤为重要,可以说是决定最终信息是否有价值的决定性因素。基于如此的认识,大数据分析普遍存在的方法理论有哪些呢? 1、可视化分析 大数据分析的使用者有大数据分析专家,同时还有普通用户,但是他们二者对于大数据分析最基本的要求就是可视化分析,因为可视化分析能够直观的呈现大数据特点,同时能够非常容易被读者所接受,就如同看图说话一样简单明了 2、数据挖掘算法 大数据分析的理论核心就是数据挖掘算法,各种数据挖掘的算法基于不同的数据类型和格式才能更加科学的呈现出数据本身具备的特点,也正是因为这些被全世界统计学家所公认的各种统计方法(可以称之为真理)才能深入数据内部,

数据分析与建模实验报告

学生学号实验课成绩 学生实验报告书 实验课程名称数据分析与建模 开课学院 指导教师姓名 学生姓名 学生专业班级 2015 —2016 学年第 1 学期

实验报告填写规范 1、实验是培养学生动手能力、分析解决问题能力的重要环节;实验报告是反映实验教学水 平与质量的重要依据。为加强实验过程管理,改革实验成绩考核方法,改善实验教学效果,提高学生质量,特制定本实验报告书写规范。 2、本规范适用于管理学院实验课程。 3、每门实验课程一般会包括许多实验项目,除非常简单的验证演示性实验项目可以不写实 验报告外,其他实验项目均应按本格式完成实验报告。在课程全部实验项目完成后,应按学生姓名将各实验项目实验报告装订成册,构成该实验课程总报告,并给出实验课程成绩。 4、学生必须依据实验指导书或老师的指导,提前预习实验目的、实验基本原理及方法,了 解实验内容及方法,在完成以上实验预习的前提下进行实验。教师将在实验过程中抽查学生预习情况。 5、学生应在做完实验后三天内完成实验报告,交指导教师评阅。 6、教师应及时评阅学生的实验报告并给出各实验项目成绩,同时要认真完整保存实验报 告。在完成所有实验项目后,教师应将批改好的各项目实验报告汇总、装订,交课程承担单位(实验中心或实验室)保管存档。

画出图形 由图x=4时,y最大等于1760000 (2)求关于所做的15%假设的灵敏性 粗分析: 假设C=1000 即给定r y=f(x)=(1500-100x)1000(1+rx)=-100000rx^2+1500000rx-100000x+1500000 求导,f’(x)=-200000rx+1500000r-100000,令f’(x)=0,可得相应x值,x=(15r-1)/2r Excel画出相应图形

剖析大数据分析方法论的几种理论模型

剖析大数据分析方法论的几种理论模型 做大数据分析的三大作用,主要是:现状分析、原因分析和预测分析。什么时候开展什么样的数据分析,需要根据我们的需求和目的来确定。 作者:佚名来源:博易股份|2016-12-01 19:10 收藏 分享 做大数据分析的三大作用,主要是:现状分析、原因分析和预测分析。什么时候开展什么样的数据分析,需要根据我们的需求和目的来确定。 利用大数据分析的应用案例更加细化的说明做大数据分析方法中经常用到的几种理论模型。 以营销、管理等理论为指导,结合实际业务情况,搭建分析框架,这是进行大数据分析的首要因素。大数据分析方法论中经常用到的理论模型分为营销方面的理论模型和管理方面的理论模型。 管理方面的理论模型: ?PEST、5W2H、时间管理、生命周期、逻辑树、金字塔、SMART原则等?PEST:主要用于行业分析 ?PEST:政治(Political)、经济(Economic)、社会(Social)和技术(Technological) ?P:构成政治环境的关键指标有,政治体制、经济体制、财政政策、税收政策、产业政策、投资政策、国防开支水平政府补贴水平、民众对政治的参与度等。?E:构成经济环境的关键指标有,GDP及增长率、进出口总额及增长率、利率、汇率、通货膨胀率、消费价格指数、居民可支配收入、失业率、劳动生产率等。?S:构成社会文化环境的关键指标有:人口规模、性别比例、年龄结构、出生率、死亡率、种族结构、妇女生育率、生活方式、购买习惯、教育状况、城市特点、宗教信仰状况等因素。

?T:构成技术环境的关键指标有:新技术的发明和进展、折旧和报废速度、技术更新速度、技术传播速度、技术商品化速度、国家重点支持项目、国家投入的研发费用、专利个数、专利保护情况等因素。 大数据分析的应用案例:吉利收购沃尔沃 大数据分析应用案例 5W2H分析法 何因(Why)、何事(What)、何人(Who)、何时(When)、何地(Where)、如何做(How)、何价(How much) 网游用户的购买行为: 逻辑树:可用于业务问题专题分析

大数据建模与挖掘应用

关于举办“大数据建模与分析挖掘应用”实战培训班的通知地点北京上海 时间12月 23-26 1月 12-15 一、课程简介 大数据建模与分析挖掘技术已经逐步地应用到新兴互联网企业(如电子商务网站、搜索引擎、社交网站、互联网广告服务提供商等)、银行金融证券企业、电信运营等行业,给这些行业带来了一定的数据价值增值作用。 本次课程面向有一定的数据分析挖掘算法基础的工程师,带大家实践大数据分析挖掘平台的项目训练,系统地讲解数据准备、数据建模、挖掘模型建立、大数据分析与挖掘算法应用在业务模型中,结合主流的Hadoop与Spark大数据分析平台架构,实现项目训练。 结合业界使用最广泛的主流大数据平台技术,重点剖析基于大数据分析算法与BI技术应用,包括分类算法、聚类算法、预测分析算法、推荐分析模型等在业务中的实践应用,并根据讲师给定的数据集,实现两个基本的日志数据分析挖掘系统,以及电商(或内容)推荐系统引擎。 本课程基本的实践环境是Linux集群,JDK1.8, Hadoop 2.7.*,Spark 2.1.*。 学员需要准备的电脑最好是i5及以上CPU,4GB及以上内存,硬盘空间预留50GB(可用移动硬盘),基本的大数据分析平台所依赖的软件包和依赖库等,讲师已经提前部署在虚拟机镜像(VMware镜像),学员根据讲师的操作任务进行实践。 本课程采用技术原理与项目实战相结合的方式进行教学,在讲授原理的过程中,穿插实际的系统操作,本课程讲师也精心准备的实际的应用案例供学员动手训练。 二、培训目标 1.本课程让学员充分掌握大数据平台技术架构、大数据分析的基本理论、机器学习的常用算法、国内外主流的大数据分析与BI商业智能分析解决方案、以及大数据分析在搜索引擎、广告服务推荐、电商数据分析、金融客户分析方面的应用案例。 2.本课程强调主流的大数据分析挖掘算法技术的应用和分析平台的实施,让学员掌握主流的基于大数据Hadoop和Spark、R的大数据分析平台架构和实际应用,并用结合实际的生产系统案例进

工业大数据分析综述:模型与算法

摘要:随着条形码、二维码、RFID、工业传感器、自动控制系统、工业互联网、ERP、CAD/CAM/CAE等信息技术在工业领域的广泛应用,大量与工业生产活动相关的数据被实时采集并存储到企业的信息系统中。对这些数据进行分析,有助于改进生产工艺、提高生产效率、降低生产成本,为实现智能制造奠定基础。因此,工业大数据分析引起了工业界和学术界的广泛关注。模型和算法是大数据分析理论和技术中的两个核心问题。介绍了工业大数据分析的基本概念,综述了几种流行的工业大数据分析模型在工业大数据分析领域的应用情况以及相应求解算法方面的研究成果,并探索了大数据分析模型和算法的未来研究方向。 关键词:工业大数据; 大数据分析; 模型; 算法; 智能制造 1 引言 当今时代,信息化和工业化的融合已经成为发展趋势,《中国制造2025》指出:“新一代信息技术与制造业深度融合,正在引发影响深远的产业变革,形成新的生产方式、产业形态、商业模式和经济增长点”。工业大数据在两化融合过程中起着至关重要的作用,国务院颁发的《促进大数据发展行动纲要》把发展工业大数据列为主要任务之一:“推动大数据在工业研发设计、生产制造、经营管理、市场营销、售后服务等产品全生命周期、产业链全流程各环节的应用,分析感知用户需求,提升产品附加价值,打造智能工厂。建立面向不同行业、不同环节的工业大数据资源聚合和分析应用平台”。工业大数据是指在工业领域中产生的大数据。随着信息化与工业化的深度融合,信息技术渗透到了工业企业产业链的各个环节,条形码、二维码、射频识别(radio frequency identification,RFID)、工业传感器、工业自动控制系统、工业互联网、企业资源计划(enterprise resource planning,ERP)、计算机辅助设计(computer

数据分析和数据建模

数据分析和数据建模 大数据应用有几个方面,一个是效率提升,帮助企业提升数据处理效率,降低数据存储成本。另外一个是对业务作出指导,例如精准营销,反欺诈,风险管理以及业务提升。过去企业都是通过线下渠道接触客户,客户数据不全,只能利用财务数据进行业务运营分析,缺少围绕客户的个人数据,数据分析应用的领域集中在企业内部经营和财务分析。 大数据应用有几个方面,一个是效率提升,帮助企业提升数据处理效率,降低数据存储成本。另外一个是对业务作出指导,例如精准营销,反欺诈,风险管理以及业务提升。过去企业都是通过线下渠道接触客户,客户数据不全,只能利用财务数据进行业务运营分析,缺少围绕客户的个人数据,数据分析应用的领域集中在企业内部经营和财务分析。 数字时代到来之后,企业经营的各个阶段都可以被记录下来,产品销售的各个环节也被记录下来,客户的消费行为和网上行为都被采集下来。企业拥有了多维度的数据,包括产品销售数据、客户消费数据、客户行为数据、企业运营数据等。拥有数据之后,数据分析成为可能,企业成立了数据分析团队整理数据和建立模型,找到商品和客户之间的关联关系,商品之间关联关系,另外也找到了收入和客户之间的关联关系。典型的数据分析案例如沃尔玛啤酒和尿布、蛋挞和手电筒,Target的判断16岁少女怀孕都是这种关联关系的体现。

关联分析是统计学应用最早的领域,早在1846年伦敦第二次霍乱期间,约翰医生利用霍乱地图找到了霍乱的传播途径,平息了伦敦霍乱,打败了霍乱源于空气污染说的精英,拯救了几万人的生命。伦敦霍乱平息过程中,约翰医生利用了频数分布分析,建立了霍乱地图,从死亡案例分布的密集程度上归纳出病人分布同水井的关系,从而推断出污染的水源是霍乱的主要传播途径,建议移除水井手柄,降低了霍乱发生的概率。 另外一个典型案例是第二次世界大战期间,统计分析学家改造轰炸机。英美联盟从1943年开始对德国的工业城市进行轰炸,但在1943年年底,轰炸机的损失率达到了英美联盟不能承受的程度。轰炸军司令部请来了统计学家,希望利用数据分析来改造轰炸机的结构,降低阵亡率,提高士兵生还率。统计学家利用大尺寸的飞机模型,详细记录了返航轰炸机的损伤情况。统计学家在飞机模型上将轰炸机受到攻击的部位用黑笔标注出来,两个月后,这些标注布满了机身,有的地方标注明显多于其他地方,例如机身和侧翼。有的地方的标注明显少于其他地方,例如驾驶室和发动机。统计学家让军火商来看这个模型,军火商认为应该加固受到更多攻击的地方,但是统计学家建议对标注少的地方进行加固,标注少的原因不是这些地方不容易被击中,而是被击中的这些地方的飞机,很多都没有返航。这些标注少的地方被击中是飞机坠毁的一个主要原因。军火商按照统计学家的建议进行了飞机加固,大大提高了轰炸机返航的比率。以二战著名的B-17轰炸机为例,其阵亡率由26%降到了7%,帮助美军节约了几亿美金,大大提高了士兵的生还率。 一数据分析中的角色和职责 数据分析团队应该在科技部门内部还在业务部门内部一直存在争议。在业务部门内部,对数据场景比较了解,容易找到数据变现的场景,数据分析对业务提升帮助较大,容易出成绩。但是弊端是仅仅对自己部门的业务数据了解,分析只是局限独立的业务单元之内,在数据获取的效率上,数据维度和数据视角方面缺乏全局观,数据的商业视野不大,对公司整体业务的推动发展有限。业务部门的数据分析团队缺少数据技术能力,无法利用最新的大数据计算和分析技术,来实现数

16种常用数据分析方法66337

一、描述统计 描述性统计是指运用制表和分类,图形以及计筠概括性数据来描述数据的集中趋势、离散趋势、偏度、峰度。 1、缺失值填充:常用方法:剔除法、均值法、最小邻居法、比率回归法、决策树法。 2、正态性检验:很多统计方法都要求数值服从或近似服从正态分布,所以之前需要进行正态性检验。常用方法:非参数检验的K-量检验、P-P图、Q-Q图、W检验、动差法。 二、假设检验 1、参数检验 参数检验是在已知总体分布的条件下(一股要求总体服从正态分布)对一些主要的参数(如均值、百分数、方差、相关系数等)进行的检验。 1)U验使用条件:当样本含量n较大时,样本值符合正态分布 2)T检验使用条件:当样本含量n较小时,样本值符合正态分布 A 单样本t检验:推断该样本来自的总体均数μ与已知的某一总体均数μ0 (常为理论值或标准值)有无差别; B 配对样本t检验:当总体均数未知时,且两个样本可以配对,同对中的两者在可能会影响处理效果的各种条件方面扱为相似; C 两独立样本t检验:无法找到在各方面极为相似的两样本作配对比较时使用。 2、非参数检验 非参数检验则不考虑总体分布是否已知,常常也不是针对总体参数,而是针对总体的某些一股性假设(如总体分布的位罝是否相同,总体分布是否正态)进行检验。 适用情况:顺序类型的数据资料,这类数据的分布形态一般是未知的。

A 虽然是连续数据,但总体分布形态未知或者非正态; B 体分布虽然正态,数据也是连续类型,但样本容量极小,如10以下; 主要方法包括:卡方检验、秩和检验、二项检验、游程检验、K-量检验等。 三、信度分析 检査测量的可信度,例如调查问卷的真实性。 分类: 1、外在信度:不同时间测量时量表的一致性程度,常用方法重测信度 2、内在信度;每个量表是否测量到单一的概念,同时组成两表的内在体项一致性如 何,常用方法分半信度。 四、列联表分析 用于分析离散变量或定型变量之间是否存在相关。 对于二维表,可进行卡方检验,对于三维表,可作Mentel-Hanszel分层分析。列联表分析还包括配对计数资料的卡方检验、行列均为顺序变量的相关检验。 五、相关分析 研究现象之间是否存在某种依存关系,对具体有依存关系的现象探讨相关方向及相关程度。 1、单相关:两个因素之间的相关关系叫单相关,即研究时只涉及一个自变量和一个因变量; 2、复相关:三个或三个以上因素的相关关系叫复相关,即研究时涉及两个或两个以上的自变量和因变量相关; 3、偏相关:在某一现象与多种现象相关的场合,当假定其他变量不变时,其中两个变量之间的相关关系称为偏相关。 六、方差分析

数据模型与决策例题分析

数据、模型与决策 3 线性规划问题的计算机求解及应用举例 第7题 (1)线性规划模型 (2)线性规划模型代数式 公司所做决策的变量是每种原料合金的数量,因此引入决策变量 i x 表示第i 种原料合金的数量()1,2,3,4,5,6i =。 建立此问题的数学模型为:

(1)线性规划模型 (2)线性规划模型代数式 公司所做决策的变量是每种原料数,因此引入决策变量 x表示第i i 种原料数() i=。 1,2,3,4 建立此问题的数学模型为:

线性规划模型代数式 车间所做决策的变量是(1,2,3)i A i =机床生产(1,2)j B j =零件数,因此引入决策变量ij x 表示加工(1,2)j B j =零件使用的(1,2,3)i A i =机床台数。 建立此问题的数学模型为: (1)线性规划模型 (2)使用sumproduct 函数

(1)线性规划模型 (2)线性规划模型代数式 公司所做决策可用网络配送图表示(如下图),图中节点123,,v v v 表示1、2、3三个工厂,节点4v 表示配送中心,节点567,,v v v 表示1、2、3三个仓库。每一条有向弧表示一条可能的运输路线,并给出了相应的单位运输成本,对运输量有限制的路线的最大运输能力也同时给出。 网络配送模型 引入变量ij f 表示由i v 经过路线(),i j v v 运输到j v 的产品属。问题的目

标是总运输成本最小化:

(1)线性规划模型 (2)线性规划模型代数式 医院所做决策的变量是每时段开始上班的人数,因此引入决策变量i x 表示第i 个时段上班的人数()1,2,3,4,5,6i =。 建立此问题的数学模型为:

业绩数据分析模型(终审稿)

业绩数据分析模型 TPMK standardization office【 TPMK5AB- TPMK08- TPMK2C- TPMK18】

营销总经理的业绩数据分析模型--营销总经理的工作模型(一) 前言 营销总经理这个职位压力大而且没有安全 感——天气变化、竞品动态、本品产品质量、 公司的战略方向、费用投入、经销商的突然变 化、行业动荡、上游采购成本等等诸多因素影 响业绩。营销行业没有常胜将军,但是这个行业以成败论英雄。 营销总经理这个职位事情多而且杂乱琐碎:营销总经理要遥控管理庞大的营销团队,服务于全国几千万家经销商和终端。工作千头万绪,哪怕每天干25个小时,工作还是俄罗斯方块一样堆积。 压力和杂务干扰之下,就容易迷失,做营销总经理需要热情、能力、经验、更需要固化的可复制的工作模型,帮助自己脱身庶务,联系市场实际,提升管理绩效。 营销总经理工作模型一:数据分析模型 一、营销总经理数据分析流程概述 数据分析好像“业绩体检报告”,告诉营销总经理哪里有问题。营销总经理要每天按照固定的数据分析模型对当日发货量、累计业绩进度、发货客户数、

发货品项数、产品结构、区域结构等关键指标进行全方位多维次的实时监控。随时关注整体业绩达成的数量和质量。 如果公司整体业绩分析没问题就下延看区域业绩有没问题,没问题就结束分析。如果公司整体业绩有问题;就要思考有没有特殊原因——比如:天气下雨造成三天发货量下滑,天晴后业绩会恢复。公司上半月集中力量乡镇市场压货,所以低价产品业绩上升高价产品业绩下滑是计划内正常现象。如果没有特殊原因,确实属于业绩异常,就要立刻从这个指标着手深度分析:通常是从产品、区域、客户三条主线来研究。发现问题产品(哪个产品需要重点管理)、发现问题区域(哪个区域需要重点巡查)、发现问题客户(哪个重点零售ka系统重点经销商的业绩不正常)。除非问题非常严重,一般营销总经理的数据分析下延到直接下级(大区或者省区层面)即可,然后要求问题区域的大区经理做出解释,拿出整改方案。大区省区经理再做区域内数据分析,寻找问题产品、问题片区和问题经销商。 数据分析得出结论就找到了管理重点,接下来营销总经理要采取针对性有的放失的管理动作——比如立刻去巡检重点问题区域、要求问题区域限期改善、更改当月的促销投入或者产品价格、设立新的工作任务(比如乡镇铺货)等等,整个分析流程图示如下:

大数据建模和算法特征

大数据建模和算法特征 Coca-cola standardization office【ZZ5AB-ZZSYT-ZZ2C-ZZ682T-ZZT18】

零售银行为了给客户提供更加优质的服务,需要通过分析银行系统本身数据库所保留的客户资料信息,对客户进行分类管理。 近年来,大数据已成为科技界和企业界关注的热点,越来越多的企业和研究者正在关注大数据的应用。大数据的分析与挖掘技术在科学界正在如火如荼的展开,各种大数据的新算法被开发研究出来,例如近年来发展比较完善的一种数据分析挖掘算法支持向量机。 与此同时,大数据分析在商业中的运用受到人们的追捧,各种大数据在商业中成功运用的案例层出不穷,比如美国大型零售商target公司的广告精准推送。本文将对大数据分析技术以及大数据分析技术在零售银行行业的作用进行一番探讨。 什么是大数据 2011年,麦肯锡在题为《海量数据,创新、竞争和提高生成率的下一个新领域》的研究报告中首次提出大数据的概念。报告认为数据已经渗透到每一个行业和业务职能领域,数据中蕴含着巨大的价值,这些价值将导致数据成为重要的生产因素。2012年《纽约时报》的一篇专栏中写到,“大数据”时代已经降临,在商业、经济及其他领域中,最终决策将日益基于数据和分析而作出,而并非基于经验和直觉。2012年3月,美国奥巴马政府宣布投资2亿美元启动“大数据研究和发展计划”,这是继1993年美国宣布“信息高速公路”计划后的又一次重大科技发展部署。美国政府认为大数据是“未来的新石油”,将“大数据研究”上升为国家意志,对未来的科技与经济发展必将带来深远影响。 进入21世纪,互联网的兴起促成了数据量的大规模增长。互联网时代,几乎全民都在制造数据,与此同时,数据的形成也极其丰富。一方面,既有社交网络、多媒体、协同创造、虚拟服务等应用所主动产生的数据;另一方面,又有搜索引擎、网页浏览过程中被记录、被收集的数据。该阶段数据的特点是用户原创、主动、交互。 根据国际数据公司(IDC)的研究报告,2011年全球被创建和被复制的数据总量为(数据存储单位,泽字节,等于 1024艾字节或270个字节),且增长趋势遵循新摩尔定律,预计到2020年,全球数据量大约每两年翻一番,全球将拥有35ZB的数据量。正是由于信息技术的发展,大数据才能生成和发展。大数据技术正是从海量的、多样化的数据中,快速获得有价值信息的能力。 大数据指的是所涉及的数据量规模巨大到无法通过人工,在合理时间内达到截取、管理、处理、整理成为人类所能解读的信息。在维克托迈尔-舍恩伯格及肯尼斯库克耶编写

常用数据分析方法

常用数据分析方法 常用数据分析方法:聚类分析、因子分析、相关分析、对应分析、回归分析、方差分析;问卷调查常用数据分析方法:描述性统计分析、探索性因素分析、Cronbach’a信度系数分析、结构方程模型分析(structural equations modeling) 。 数据分析常用的图表方法:柏拉图(排列图)、直方图(Histogram)、散点图(scatter diagram)、鱼骨图(Ishikawa)、FMEA、点图、柱状图、雷达图、趋势图。 数据分析统计工具:SPSS、minitab、JMP。 常用数据分析方法: 1、聚类分析(Cluster Analysis) 聚类分析指将物理或抽象对象的集合分组成为由类似的对象组成的多个类的分析过程。聚类是将数据分类到不同的类或者簇这样的一个过程,所以同一个簇中的对象有很大的相似性,而不同簇间的对象有很大的相异性。聚类分析是一种探索性的分析,在分类的过程中,人们不必事先给出一个分类的标准,聚类分析能够从样本数据出发,自动进行分类。聚类分析所使用方法的不同,常常会得到不同的结论。不同研究者对于同一组数据进行聚类分析,所得到的聚类数未必一致。 2、因子分析(Factor Analysis) 因子分析是指研究从变量群中提取共性因子的统计技术。因子分析就是从大量的数据中寻找内在的联系,减少决策的困难。 因子分析的方法约有10多种,如重心法、影像分析法,最大似然解、最小平方法、阿尔发抽因法、拉奥典型抽因法等等。这些方法本质上大都属近似方法,是以相关系数矩阵为基础的,所不同的是相关系数矩阵对角线上的值,采用不同的共同性□2估值。在社会学研究中,因子分析常采用以主成分分析为基础的反覆法。 3、相关分析(Correlation Analysis) 相关分析(correlation analysis),相关分析是研究现象之间是否存在某种依存关系,并对具体有依存关系的现象探讨其相关方向以及相关程度。相关关系是一种非确定性的关系,例如,以X和Y分别记一个人的身高和体重,或分别记每公顷施肥量与每公顷小麦产量,则X 与Y显然有关系,而又没有确切到可由其中的一个去精确地决定另一个的程度,这就是相关关系。 4、对应分析(Correspondence Analysis) 对应分析(Correspondence analysis)也称关联分析、R-Q型因子分析,通过分析由定性变量构成的交互汇总表来揭示变量间的联系。可以揭示同一变量的各个类别之间的差异,以及不同变量各个类别之间的对应关系。对应分析的基本思想是将一个联列表的行和列中各元素的比例结构以点的形式在较低维的空间中表示出来。 5、回归分析 研究一个随机变量Y对另一个(X)或一组(X1,X2,…,Xk)变量的相依关系的统计分析方法。回归分析(regression analysis)是确定两种或两种以上变数间相互依赖的定量关系的一种统计分析方法。运用十分广泛,回归分析按照涉及的自变量的多少,可分为一元回归分析和多元回归分析;按照自变量和因变量之间的关系类型,可分为线性回归分析和非线性回归分析。 6、方差分析(ANOVA/Analysis of Variance) 又称“变异数分析”或“F检验”,是R.A.Fisher发明的,用于两个及两个以上样本均数差

大数据数据分析方法 数据处理流程实战案例

方法、数据处理流程实战案例时代,我们人人都逐渐开始用数据的眼光来看待每一个事情、事物。确实,数据的直观明了传达出来的信息让人一下子就能领略且毫无疑点,不过前提是数据本身的真实性和准确度要有保证。今天就来和大家分享一下关于方法、数据处理流程的实战案例,让大家对于这个岗位的工作内容有更多的理解和认识,让可以趁机了解了解咱们平时看似轻松便捷的数据可视化的背后都是有多专业的流程在支撑着。 一、大数据思维 在2011年、2012年大数据概念火了之后,可以说这几年许多传统企业也好,互联网企业也好,都把自己的业务给大数据靠一靠,并且提的比较多的大数据思维。 那么大数据思维是怎么回事?我们来看两个例子: 案例1:输入法 首先,我们来看一下输入法的例子。 我2001年上大学,那时用的输入法比较多的是智能ABC,还有微软拼音,还有五笔。那时候的输入法比现在来说要慢的很多,许多时候输一个词都要选好几次,去选词还是调整才能把这个字打出来,效率是非常低的。 到了2002年,2003年出了一种新的输出法——紫光拼音,感觉真的很快,键盘没有按下去字就已经跳出来了。但是,后来很快发现紫光拼音输入法也有它的问题,比如当时互联网发展已经比较快了,会经常出现一些新的词汇,这些词汇在它的词库里没有的话,就很难敲出来这个词。

在2006年左右,搜狗输入法出现了。搜狗输入法基于搜狗本身是一个搜索,它积累了一些用户输入的检索词这些数据,用户用输入法时候产生的这些词的信息,将它们进行统计分析,把一些新的词汇逐步添加到词库里去,通过云的方式进行管理。 比如,去年流行一个词叫“然并卵”,这样的一个词如果用传统的方式,因为它是一个重新构造的词,在输入法是没办法通过拼音“ran bing luan”直接把它找出来的。然而,在大数据思维下那就不一样了,换句话说,我们先不知道有这么一个词汇,但是我们发现有许多人在输入了这个词汇,于是,我们可以通过统计发现最近新出现的一个高频词汇,把它加到司库里面并更新给所有人,大家在使用的时候可以直接找到这个词了。 案例2:地图 再来看一个地图的案例,在这种电脑地图、手机地图出现之前,我们都是用纸质的地图。这种地图差不多就是一年要换一版,因为许多地址可能变了,并且在纸质地图上肯定是看不出来,从一个地方到另外一个地方怎么走是最好的?中间是不是堵车?这些都是有需要有经验的各种司机才能判断出来。 在有了百度地图这样的产品就要好很多,比如:它能告诉你这条路当前是不是堵的?或者说能告诉你半个小时之后它是不是堵的?它是不是可以预测路况情况? 此外,你去一个地方它可以给你规划另一条路线,这些就是因为它采集到许多数据。比如:大家在用百度地图的时候,有GPS地位信息,基于你这个位置的移动信息,就可以知道路的拥堵情况。另外,他可以收集到很多

大数据分析的常用算法大数据处理算法研究与实现

大数据分析的常用算法大数据处理算法研究与 实现 大数据处理算法研究与实现 摘要:在适应了不同的环境的企业的发展的条下,提供有包括企业或具有确定相对运动的构的组合等在互联网上注册的名称,是互联网比较重要的部分、成套的设备、系统控制在内的完整的网络平台服务。构建有自己的电子商务寄放平台,大数据是我国重要的信息来源。随着市民、其他空间三维立体上的网络化时代经验和知识的快速发展,空间的立体化发展史越来越快了,所有步行中的全世界或一个地区的山川、气候变化等自然环境及物产、交通、居民点等社会经济因素的总的情况网络化时代经验和知识的应用更加广泛和彻底促进企业发展、不同发展阶段企业或者个人的上网要求,提供有包括企业或具有确定相对运动的构的组合等在互联网上注册的名称,构建有自己的电子商务寄放平台的到来。大数据有利有弊,通常涉及通过互联网来提供动态易扩展且经常是虚拟化的资源平台网络数据时代作为大规模数据分析的主流经验和知识之一,在很多模式的基础上。在此基础上,在数据较大的时代背景下,基于互联网的相关服务的增加、使用和交互模式,通常涉及通过互联网来提供动态易扩展且经常是虚拟化的资源平台的网络数据时代优势与中国行业网络化时代管理系

统的实际应用要求相结合,实现了有方向性的大数据管理,特别 是数据存储模型在Spacti矢量大规模数据管理中的Al备检、数 据转换、空间三维立体上的咨询及数据可视化本论文中,提出了 用于大规模有方向性的数据的组织化和管理的方法体系和关键经 验和知识。 关键词:矢量大数据,全世界或一个地区的山川、气候变化 等自然环境及物产、交通、居民点等社会经济因素的总的情况网 络化时代系统(GIS),空间三维立体上的数据管理,Had oop,耕地质量等别数据 Research and Implementation of Large Data Processing Algorithms Abstract:In the era of big data, data has bee an important part of national basic strategic resources.With the rapid development of 大数据网络时代, citizen s, GPS and other spatial information technology, the means of spatial data acquisition are more and more diversified, and the application of geographic information technology in all walks is more extensive and thorough, which promotes the arrival of the era of 大数据网络时代 big data.The big data is the “double-edged sword“.The