图像局部特征描述子研究分析(未完-待续)

研究背景

在日常生活中,我们主要依赖于视觉来感知外界的信息,比起听觉,视觉能给我们更加丰富的描述。人们一直想通过计算机视觉来描述视觉信息中有意义和有用的东西。首先,我们必须回答什么类型的信息是我们想要的?如何提取这样的特征信息?有人定义视觉为发现图像是什么和在哪里的过程,这强调了视觉是一个信息处理任务[]。而如何构建一个视觉系统来进行这样的信息处理任务是很多学者研究的问题之一。其中,达成统一共识是利用不同的特征层来构建这一个视觉模型系统,最简单的三层体系结构为低层、中层、高层。而本文基于最基本的图像描述方法——尺度的概念,利用尺度空间表示法来分析最低层图像数据。尺度空间方法是一种尺度参数连续、不同尺度空间下采样保持一致性的视觉多尺度分析。

视觉多尺度分析是一种新的视觉信息处理方法,其基本思想是:当我们用眼睛观察物体且物体和观察者之间的距离(将距离视为尺度参数)不断变化时,视网膜将感知到不断变化的图像信息,分析和综合这些不同尺度下的视觉信息以获得被观察物体的本质特征,这种视觉分析方法即称为视觉多尺度分析。

尺度空间方法的基本思想是:在视觉信息(图像信息)处理模型中引入一个被视为尺度的参数,通过连续变化尺度参数获得不同尺度下的视觉处理信息,然后综合这些信息以深入地挖掘图像的本质特征。尺度空间方法将传统的单尺度视觉信息处理技术纳入尺度不断变化的动态分析框架中,因此更容易获得图像的本质特征。

为什么要研究尺度空间?可以从以下几个通俗的描述来说明:

1)现实世界的物体由不同尺度的结构所组成;

2)在人的视觉中,对物体观察的尺度不同,物体的呈现方式也不同;

3)对计算机视觉而言,无法预知某种尺度的物体结构是有意义的,因此有必要将所有尺度的结构表示出来;

4)从测量的角度来说,对物体的测量数据必然是依赖于某个尺度的,例如温度曲线的采集,不可能是无限的,而是在一定温度范围进行量化采集。温度范围即是选择的尺度;

5)采用尺度空间理论对物体建模,即将尺度的概念融合入物理模型之中。

尺度空间数学定义表示如下:

设多尺度分析的初始图像为0()u x (x , 为图像区域),(,)u x t 为多尺度分析用于图像所获得的在尺度(0)t t 时的图像,称0:()(,)t T u x u x t 为尺度空间算子,尺度空间算子族 0t t T 为尺度空间,并称为0:()(,)t h T u x t u x t h 尺度由t 变化到t h 的尺度空间算子。

依据尺度空间公理,尺度空间算子应满足如下定义的视觉不变性:

定义2 设t T 为尺度空间算子,称t T 具有

1) 灰度不变性,如果对任意常数c ,()()t t T u c T u c ;

2) 对比度不变性,如果对任意非降实函数f ,(())(())t t T h u h T u ;

3) 平移不变性,如果对任意常数h ,(())(())t h h t T u T u ,其中()()h u u x h ;

4) 尺度不变性,如果对于任意正实数 和尺度参数t ,存在'(,)0t t ,使得

't t H T T H ,其中()H u u x ;

5) 欧基里德不变性,如果对于任意正交矩阵R , ()()t t T R u R T u ,其中,

()()()R u x u R x ;

6) 仿射不变性,如果对于任意仿射变换A 和任意尺度参数t ,存在'(,)0t A ,使得

't t AT T A 。

上述诸不变性定义的视觉解释如下:当我们用眼睛观察物体时,一方面,当物体所处背景的光照条件变化时,视网膜感知图像的亮度水平和对比度是不同的,因此要求尺度空间算子对图像的分析不受图像的灰度水平和对比度变化的影响,即满足灰度不变性和对比度不变性;另一方面,相对于某一固定坐标系,当观察者和物体之间的相对位置变化时,视网膜所感知的图像的位置、大小、角度和形状(三维物体投影到视网膜上的二维图像轮廓,通常对应于图像的仿射变换)是不同的,因此要求尺度空间算子对图像的分析与图像的位置、大小、角度以及仿射变换无关,即满足平移不变性、尺度不变性、欧基里德不变性以及仿射不变性。

按照上面公理得出的条件,唯一可能的尺度空间函数核为高斯函数[],不同高斯核组成的尺度空间是规范的和线性的,并且满足以下若干性质,即平移不变性、半群结构、非增局部极值、尺度不变性和旋转不变性等。

最为基础的四类尺度空间依次为:线性尺度空间、非线性尺度空间、形尺度空间和数学形态学尺度空间。本文主要研究线性尺度空间即高斯尺度空间下的局部不变特征检测与描述,同时也针对局部不变特征匹配存在的问题进行了研究。

目前图像特征提取是图像处理、模式识别以及计算机视觉等领域的一个重要研究内容,它是许多问题的基础,例如图像配准、图像拼接、物体识别、数字水印、动态跟踪、基于图像内容的检索以及视频镜头检测等。这些问题都可以通过特征的提取与匹配来实现。在计算机视觉中,有很多可供引用的图像特征,如按提取特征的区域大小可分为局部特征和全局特征;按特征在图像上的表现形式可分为点特征、线特征和面特征等。图像局部特征是由一些亮度变化很大的像素点组成的局部结构,这些局部结构包含有丰富的图像信息,具有较强的代表性。

近年来,一类基于提取图像局部不变特征的方法在计算机视觉领域得到了广泛地应用。这类局部特征,一方面不受平移、旋转、尺度、视角、光照变化以及模糊等因素的影响;另一方面可以很大程度地摒弃以往全局特征容易受到背景杂乱及目标遮挡等影响的缺点。因而,与其它类型的特征相比,局部不变特征在稳定性、可重复性和独特性方面具有较大的优势,是近年来研究的热点。局部特征描述是许多方法的基础,因此也是目前计算机视觉研究中的一个热点,每年视觉领域顶级会议ICCV/CVPR/ECCV 上都有高质量的特征描述论文发表。

但是该类方法提取的局部不变特征能够承受图像旋转、尺度、视角、光照及模糊等变换的程度仍然有待提高,并且还没有任何一种局部不变特征能够针对所有的图像变换具备良好的稳定性。因此,如何使得局部不变特征具有更高的稳定性和可重复性是巫待解决的问题。

在具体应用过程中,发现了几个共同的问题,这些问题尚待研究解决。比如:

1) 在宽基线匹配情况下(图像之间存在较大的模糊、视角、旋转、缩放、尺度、光照等变化),数字摄影测影(近景摄影时)图像匹配、图像重构等会出现以下问题:

由于光照条件不同,目标表明光亮度、对比度将会改变,使得基于灰度影像相关匹配的算法效果较差;物体与摄像机的距离不同,图像具备不同分辨率,即尺度不同;影像存在较大的旋转度,使得目标形状发生变化,目标图像存在仿射变形;

2) 图像拼接应用时则会出现下列问题:

来自不同传感器或者不同视角的同一场景的两幅或者多幅图像的匹配,主要难点是拍摄时间、角度、环境以及传感器性能的不同,都给图像带来了不可避免的噪声,同时还存在不同程度的灰度失真以及几何畸变。

3) 目标跟踪时则会遇到如下问题:

光照变化:在不同的光照条件下,目标的特征会呈现明显的差异。尤其复杂光照环境下,目标特征会发生强烈的变化;姿态和形状变化:目标的平面旋转,轴旋转以及与摄影设备距离变化都将导致目标图像的仿射变化和投射变化;部分遮挡:当跟踪目标被部分遮挡时,部分特征信息无法获取,就有可能跟踪失败或者偏移;

4) 目标识别是计算机视觉中的一个非常具有挑战性的课题,主要遇到的问题描述如下: 如对于人类来说,即使是小孩也能轻松的在复杂图像中找到所需目标,即便这个目标被部分遮挡了,或者物体形状、大小发生变化等,但是对于计算机来说,非常具有挑战性,其核心问题就是用什么样的特征来描述物体。

这些实际应用问题本质反映了图像之间存在尺度、视角、光照、旋转、缩放、遮挡等变化,因此很难有通用的解决所有仿射变化的图像局部不变特征算法。因此,本文重点研究如何提高局部不变特征的稳定性、可重复性等问题。

局部不变特征

局部特征数学描述:

图像函数表示为(,)f x y ,()g f 为定义在图像局部邻域 上的特征函数,()H f 表示对图像进行的各种变换。特征函数()g f 对变换H 具有不变性是指对任意的图像函数f 满足:

()(())g f g H f (1)

特征函数()g f 对变换H 具有不变性时提取的特征为局部不变特征,其中特征不变性的自由度由H 的自由度决定。

物理意义及思想:

局部不变特征是指局部特征的检测或描述对图像的各种变化,例如几何变换、光度变换、卷积变换、视角变化等保持不变。局部不变特征的基本思想是提取图像内容的本质属性特征,这些特征与图像内容的具体表现形式无关或具有自适应性(即表现形式变化时特征提取自适应的变化以描述相同的图像内容)。

局部不变特征性质

局部特征两个最重要的属性是:不变性(鲁棒性/重复性)和可区分性。当然,还有其他几个属性:局部性、(特征点)数量大、准确性、效率。由于使用局部图像特征描述子的时候,通常是为了鲁棒地处理各种图像形变的情况,因此,在设计图像特征描述子的时候,鲁棒性问题就是最优先考虑的问题。在宽基线匹配中,视角不变性(viewpoint invariance)、尺度不变性(scale invariance)、旋转不变性(rotation invariance)、光照不变性(illumination invariance)等属性在构建特征描述子时需要考虑。而在物体识别中,需要考虑特征描述子对物体形状的不变性。

局部不变特征研究现状

一、SIFT类描述子

在诸多的局部图像特征描述子中,SIFT(Scale Invariant Feature Transform)是其中应用最广的,它在1999年由David Lowe[1][2]首次提出,至2004年得到完善,SIFT算法是基于局部不变量的图像特征提取、匹配方法,SIFT的提出也是局部图像特征描述子研究领域一项里程碑式的工作。由于SIFT对尺度、旋转以及一定视角和光照变化等图像变化都具有不变性,并且SIFT具有很强的可区分性,自它提出以来,很快在物体识别、宽基线图像匹配、三维重建、图像检索中得到了应用,局部图像特征描述子在计算机视觉领域内也得到了更加广泛的关注。但是,经过实际的应用和评测,SIFT算法有几个严重的缺陷:1.不完全的仿射变化;2.计算复杂度较高,实时性不强;3.光照变化大、视角变化大、物体自身有相似或周期性结构时匹配点对过少甚至匹配失败;4.匹配点对错误率较高;5. Sift是一种只利用到灰度性质的算法,忽略了色彩信息。因此,其突出的性能以及缺陷使得大批学者投入到该算法的研究当中。

1.对SIFT算法进行降维的改进

降维的目的和意义:

SIFT类算法中在特征描述符的生成过程中采用主方向旋转并统计梯度直方图的方式生成128 维特征向量计算量相当大,,而且在完成图像的配准时对128 维向量进行特征匹配的计算开销也较大,这是影响SIFT 算法实时性的主要原因,因此,改进算法的思想主要是减少生成特征描述符计算量和提高特征匹配速度。

如2004年的Yan Ke[3]提出PCA-SIFT描述子,PCA-SIFT是对SIFT进行降维的一种改进算法,它不是采用梯度直方图而是运用主成分分析法将梯度归一化,特征向量要比SIFT 检测到的特征维数低(推荐20维),在PCA-SIFT输入向量是由关键点周围41*41邻域中的水平和垂直梯度来建立的,共有2*39*39=3042个要素。其优点就是保留不变性的同时低维,大大减少了计算时间,同时在匹配性能上要强于SIFT算法;缺点便是不完全的仿射不变(和SIFT一样),而投影矩阵需要一系列有代表性的图像,且这个矩阵只对这类图像起作用。

2005年由Mikolajczyk[4]提出GLOH(Gradient location-orientation histogram )描述子,它是SIFT描述子的一种延伸,是为了增强其鲁棒性和可区分性,核心思想是把原来SIFT 中4×4棋盘格的location bins改成仿射状的同心圆的17 location bins来表示,并计算其中的梯度方向直方图(梯度方向分为16种),因此共16×17=272维,之后再作PCA将其降成128维。该描述子在仿射变换、图像模糊、JPEG压缩、光照变化情况下和SIFT性能接近,在区域重叠、尺度变换、视角变化和图像旋转(30°~45°)情况下要强于SIFT。

2006年由Tuytelaars等人提出SURF(Speeded Up Robust Features)[5]描述子,是对SIFT 的改进版,其性能和SIFT非常接近,但是其速度比SIFT快3倍左右,二者最大的不同是

Sift采用的是DOG图像,而surf采用的是Hessian矩阵行列式近似值图像。由于SURF速度更快,因此它在很多应用中得到了应用,尤其是对运行时间要求高的场合。其实在提出SURF算法之前已经有很多加速SIFT算法的方法,如前文提到的PCA-SIFT、GLOH,同时Se[6]在2004年提出利用FPGA加速SIFT算法。Grabner[7]在2006年利用积分图像近似SIFT 算法。在提出SURF算法之前的很多工作都是在加速SIFT算法的匹配速度,方法包括vocabulary trees[8]、locality sensitive hashing[9]、redundant bit vectors[10],Tuytelaars等人就是针对这些加速算法的比较,提出利用Hessian矩阵提高SIFT算法的匹配速度,即SURF算法。SURF算法提出以后在很多领域等到了广泛应用,同时也有很多改进和加速方法,如2008年Svab[11]等人提出利用FPGA加速SURF算法;2010年Nan Zhang[13]提出P-SURF算法,该算法是基于CPU的并行SURF算法,一秒钟能处理33帧640*480规格图像[12];2012年Pang提出完全仿射不变SURF算法,比SURF算法效率更好,鲁棒性更强。

2.结合颜色信息的SIFT类算法

目的和意义:

经典SIFT算法是基于灰度图像的,忽略了颜色信息,造成了匹配性能下降。而颜色特征的稳定性较高,对物体姿态变化和非刚性物体的变形都不敏感,由于大部分图像匹配算法均是将彩色图像转换为灰度图像来进行匹配,因此结合颜色信息的SIFT算法是一种更加鲁棒的方法。

如2006年Abdel[14]结合颜色信息提出CSIFT算法,利用颜色不变空间替代灰色空间,在面对颜色和光度变化的情况下比SIFT算法更稳定;2010年V an[15]等人利用颜色描述子来实现物体和场景识别,提出的描述子叫做Opponent-SIFT,在PASCAL VOC 2007、MEDIAMILL CHANGES、UNKNOWN DA TA(没有先验知识的数据)三个数据测试中,OpponentSIFT表现最好。随着SIFT的提出,大量关于颜色的特征描述子被研究,其中有2008年Bosh[16]提出HSV-SIFT,该描述子利用HSV颜色模型的3个通道来计算SIFT描述子,每个描述子有3*128维,但是其对轻微的颜色变化不具有不变性以及饱和度较小时会导致色调的不稳定;2006年Van[17]等人提出HueSIFT,基于级联的色度直方图的SIFT描述子;RGB-SIFT[18]是在该模型的基础上分别计算R、G和B分量的128维SIFT特征描述子,所以RGB-SIFT共有3*128维特征向量。因为使用的是颜色信息,所以RGB-SIFT具有尺度不变性和移位不变性,但仅具有部分的颜色不变性。其他还有rgSIFT[19]、Transformed-color SIFT [15]等关于颜色的局部特征描述子。

3.对SIFT不完全仿射的改进

对不完全仿射改进的目的及意义:

SIFT算法是一种不完全仿射变换,它对大视角情况下的图像匹配效果很差,因此有学者提出了下列算法来实现SIFT完全仿射。

如2009年JEAN-MICHEL等人提出Affine-SIFT[20]描述子:ASIFT通过模拟经度与纬度实现完全的仿射不变,然后用SIFT算法把模拟图像进行比较,最后实现特征匹配。改进了SIFT不具有完全的仿射不变性,改善了SIFT对拍摄角度发生大角度空间变化的图像特征提取有一定的局限性。但其在几种典型情况下匹配失败:光照条件不同(比如白天和晚上的图像匹配);物体有反射表层(如汽车反射镜);物体有很强的3D结构;物体自身有相似或者周期性的结构(错匹配很多);视角有很大不同时。

如2010年CAO[24]等人提出利用全局上下文信息结合ASIFT算法,试图解决图像存在相似结构时匹配错误和匹配失败的问题。2012年Yu[25]等人根据ASIFT对光照变化大的情况下匹配失败问题,基于一种迭代框架提出一种新的匹配算法,具备不完全仿射,但是一定程度上能改进ASIFT对光照变化匹配失败的问题,同时更加稳定且计算复杂度降低达到了实

时性。然而提出的算法并没有增加SIFT的不变性,如果SIFT匹配失败,该文提出的算法也会失败,如果结合ASIFT的情况下,可以很好的克服匹配失败以及增加鲁棒性和准确性。2013年Christopher[26]等人提出一种改进ASIFT算法,该算法基于白化变换(whitening transform)来产生一个场景的仿射变换,该方法能匹配垂直和水平变化角度为80°的图像,而且该算法比现有的改进的ASIFT都要快。

4.对SIFT类算法优化的其他方法(主要解决鲁棒性、光照、计算量、效率、

局部对称或相似等问题)

2011年Bin Fan[27]等人提出一种基于结合灰度序列和梯度分布的局部图像描述子,该描述子实现了真正理论意义上旋转不变性,避免了局部方向分配,而这恰恰是大多数描述子(比如SIFT)产生错误匹配的原因。

2013年Swati[28]等人基于HOG和SIFT提出一种新的方法来面对尺度、旋转、光照、视角等变化,比PCA-SIFT、SIFT、LBP等方法鲁棒性更好。

2013年Naimeh[29]等人基于BoW(bag of visual words)和SIFT描述子,加入彩色信息,用于基于图像内容的检索。

2013年Kota[30]等人提出BRIGHT (Binary ResIzable Gradient HisTogram) 描述子,该描述子提出一种特征点周围分层次的HOG梯度直方图来检测图像,然后将这些点的直方图二值化,大小为32到150bits,在光照、视角、遮挡条件下性能比SIFT要好,而且大小为SIFT算法的1/10。

2013年Shiliang Zhang[31]等人提出Edge-SIFT用于大规模手机图像搜索,即手机复制图像局部模块然后在大数据库中搜索,该算法解决了现有局部描述子利用梯度直方图而失去了空间信息导致区分性降低的问题,算法在大规模图像检索的准确性上要优于ORB(Oriented BRIEF)描述子,也比SIFT描述子在检索准确度、效率、紧凑性以及传输成本上更优越。

2013年Liang-Chi Chiu[32]等人提出一种快速SIFT实时视觉特征提取算法,该算法利用一种基于层并行的SIFT积分图像方法,以及一种并行硬件设计来实现实际应用需求。

2013年Wan-Lei Zhao[33]等人提出F-SIFT(Flip-Invariant SIFT)描述子,主要贡献在于解决了现实场景中翻转图像、对称图像、相反视角的图像特征描述问题,用于大规模图像复制检测,目标识别等,比SIFT算法节省了50%计算量的同时在翻转图像特征描述场景中它有更好的鲁棒性。翻转图像是局部不变特征描述中遇到了一类问题,目前比较有效的算法有如下几种:SPIN[34]、RIFT[34]、MI-SIFT[35]、FIND[36],其中以F-SIFT性能最好,其不仅保留了SIFT算法的所有属性,而且还能容忍图像翻转(flip)。

5.小结

自从SIFT提出以来,针对SIFT类的改进主要有以下几个方面:

1)降低SIFT算法计算复杂度以及匹配速度的描述子有:PCA-SIFT、GLOH、LBP-SIFT、

(常用降维方法:Principal Component Analysis (PCA)、hashing functions)FLDA[37]、LFDA[38]、ISOMAP[39]、LLE[40]、LPP[41]

2)弥补SIFT只具备灰度信息的缺陷而结合颜色信息的描述子:CSIFT、Opponent-SIFT、

HueSIFT、HSVSIFT、RGB-SIFT、rgSIFT、Transformed-color SIFT等

3)SIFT不是完全仿射变换,选择对这一点进行改进的描述子有:Affine-SIFT、Harris-Affine、

Hessian-Affine等,同时针对Affine-SIFT完全仿射变化计算复杂度问题又提出了很多改进方法。

4)加速SIFT的描述子:SURF、硬件加速、并行SIFT算法等。

5)针对SIFT算法在图像局部存在相似结构时误匹配率高或匹配失败的问题进行改进的描

述子有:Global text SIFT描述子、F-SIFT

参考文献

[1]Lowe D G. Object recognition from local scale-invariant features[C]//Computer vision,

1999. The proceedings of the seventh IEEE international conference on. IEEE,1999,2: 1150-1157.

[2]Lowe D G. Distinctive image features from scale-invariant keypoints[J]. International journal

of computer vision,2004,60(2): 91-110.

[3]Y. Ke,R. Sukthankar,PCA-SIFT: a more distinctive representation for local image

descriptors,in: CVPR,issue 2,2004,pp. 506–513.

[4]Mikolajczyk K,Schmid C. A performance evaluation of local descriptors[J]. Pattern

Analysis and Machine Intelligence,IEEE Transactions on,2005,27(10): 1615-1630. [5]Bay H,Tuytelaars T,V an Gool L. Surf: Speeded up robust features[M]//Computer Vision–

ECCV 2006. Springer Berlin Heidelberg,2006: 404-417.

[6]S. Se,H.K. Ng,P. Jasiobedzki,T.J. Moyung,Vision based modeling and localization

for planetary exploration rovers,in: Proceedings of International Astronautical Congress,2004.

[7]M. Grabner,H. Grabner,H. Bischof,Fast approximated SIFT,in:ACCV,issue 1,

2006,pp. 918–927.

[8] D. Nister,H. Stewenius,Scalable recognition with a vocabulary tree,in: CVPR,issue

2,2006,pp. 2161–2168.

[9]M. Datar,N. Immorlica,P. Indyk,V.S. Mirrokni,Locality-sensitive hashing scheme

based on p-stable distributions,in: Symposium on Computational Geometry,2004,pp.

253–262.

[10]J. Goldstein,J.C. Platt,C.J.C. Burges,Redundant bit vectors forquickly searching

high-dimensional regions,in: Deterministic and Statistical Methods in Machine Learning,2004,pp. 137–158.

[11]Svab J,Krajník T,Faigl J,et al. FPGA based speeded up robust features[C]//Technologies

for Practical Robot Applications,2009. TePRA 2009. IEEE International Conference on.

IEEE,2009: 35-41.

[12]Zhang N. Computing optimised parallel speeded-up robust features (p-surf) on multi-core

processors[J]. International Journal of Parallel Programming,2010,38(2): 138-158. [13]Pang Y,Li W,Y uan Y,et al. Fully affine invariant SURF for image matching[J]. Neuro

computing,2012,85: 6-10.

[14]Abdel-Hakim A E,Farag A A. CSIFT: A SIFT descriptor with color invariant

characteristics[C]//Computer Vision and Pattern Recognition,2006 IEEE Computer Society Conference on. IEEE,2006,2: 1978-1983.

[15]V an De Sande K E A,Gevers T,Snoek C G M. Evaluating color descriptors for object and

scene recognition[J]. Pattern Analysis and Machine Intelligence,IEEE Transactions on,2010,32(9): 1582-1596.

[16]A. Bosch, A. Zisserman,and X. Munoz,“Scene Classification Using a Hybrid

Generative/Discriminative Approach,” IEEE Trans. Pattern Analysis and Machine Intelligence,vol. 30,no. 4,pp. 712-727,Apr. 2008.

[17]J. van de Weijer,T. Gevers,and A. Bagdanov,“Boosting Color Saliency in Image Feature

Detection,” IEEE Trans. Pattern Analysis and Machine Intelligence,vol. 28,no. 1,pp.

150-156,Jan. 2006.

[18]Gevers K,Smeulders A W M. Color-based object recognition[J]. Pattern Recognition,

1999,32: 453-464.

[19]T. Gevers,J. van de Weijer,and H. Stokman. Color image processing: methods and

applications: color feature detection: an overview,chapter 9,pages 203–226. CRC press,2006.

[20]Morel J M,Y u G. ASIFT: A new framework for fully affine invariant image comparison[J].

SIAM Journal on Imaging Sciences,2009,2(2): 438-469.

[21]Mikolajczyk K,Schmid C. An affine invariant interest point detector[M]//Computer

Vision—ECCV 2002. Springer Berlin Heidelberg,2002: 128-142.

[22]Mikolajczyk K,Schmid C. Scale & affine invariant interest point detectors[J]. International

journal of computer vision,2004,60(1): 63-86.

[23]Matas J,Chum O,Urban M,et al. Robust wide-baseline stereo from maximally stable

extremal regions[J]. Image and vision computing,2004,22(10): 761-767.

[24]Cao B,Ma C,Liu Z T. Affine-invariant SIFT descriptor with global context[C]//Image and

Signal Processing (CISP),2010 3rd International Congress on. IEEE,2010,1: 68-71.

[25]Y u Y,Huang K,Chen W,et al. A novel algorithm for view and illumination invariant

image matching[J]. Image Processing,IEEE Transactions on,2012,21(1): 229-240. [26]Le Brese C.,Ju Jia Zou. Affine invariant matching based on orientation estimation. Signal

Processing and Communication Systems (ICSPCS),2013 7th International Conference on ,vol.,no.,pp.1,6,16-18 Dec. 2013

[27]Fan B,Wu F,Hu Z. Aggregating gradient distributions into intensity orders: A novel local

image descriptor[C]//Computer Vision and Pattern Recognition (CVPR),2011 IEEE Conference on. IEEE,2011: 2377-2384.

[28]Nigam S,Khare M,Srivastava R K,et al. An effective local feature descriptor for object

detection in real scenes[C]//Information & Communication Technologies (ICT),2013 IEEE Conference on. IEEE,2013: 244-248.

[29]Mansoori N S,Nejati M,Razzaghi P,et al. Bag of visual words approach for image

retrieval using color information[C]//Electrical Engineering (ICEE),2013 21st Iranian Conference on. IEEE,2013: 1-6.

[30]K. Iwamoto,et al.,"BRIGHT: A scalable and compact binary descriptor for low-latency

and high accuracy object identification," IEEE International Conference on Image Processing,2013.

[31]Zhang S,Tian Q,Lu K,et al. Edge-SIFT: Discriminative binary descriptor for scalable

partial-duplicate mobile search[J]. Image Processing,IEEE Transactions on,2013,22(7): 2889-2902.

[32]Chiu L C,Chang T S,Chen J Y,et al. Fast sift design for real-time visual feature

extraction[J]. Image Processing,IEEE Transactions on,2013,22(8): 3158-3167. [33]Zhao W L,Ngo C W. Flip-invariant SIFT for copy and object detection[J]. Image

Processing,IEEE Transactions on,2013,22(3): 980-991.

[34]S. Lazebnik,C. Schmid,and J. Ponce,“A sparse texture representationusing local affine

regions,” IEEE Trans. Pattern Anal. Mach. Intell.,vol. 27,no. 8,pp. 1265–1278,Aug.

2005.

[35]R. Ma,J. Chen,and Z. Su,“MI-SIFT: Mirror and inversion invariantgeneralization for

SIFT descriptor,” in Proc. Int. Conf. Image Video Retr.,2010,pp. 228–236.

[36]X. Guo and X. Cao,“FIND: A neat flip invariant descriptor,” in Proc.Int. Conf. Pattern

Recognit.,Aug. 2010,pp. 515–518.

[37]P. Belhumeur,J. Hespanha,and D. Kriegman,“Eigenfaces vs. fisherfaces:

Recognition using class specific linear projection,” IEEE Trans. Pattern Anal.

Mach. Intell.,vol. 19,Jul. 1997,pp. 711-720.

[38]Y. Rahulamathavan,R.C.-W. Phan,J.A. Chambers, D.J. Parish,“Facial

Expression Recognition in the Encrypted Domain Based on Local Fisher Discriminant Analysis,” IEEE Transactions on Affective Computing,vol. 4(1),2013,pp.83-92.

[39]J. B. Tenenbaum,V. De Silva,J. C. Langford,“A global geometric framework for

nonlinear dimensionality reduction,” Science,vol. 290(5500),2000,pp.

2319-2323,doi:10.1126 /science.290.5500.2 319.

[40]S. T. Roweis,L. K. Saul. “Nonlinear dimensionality reduction by locally linear

embedding,” Science,vol. 290(5500),2000,pp. 2323-2326,doi:

10.1126/science.290.5500.2323.

[41]X. Niyogi,“Locality preserving projections,” Neural information processing systems,

vol. 16,2004,pp. 153-160.

二、局部二值化类描述子

局部不变特征描述子除了SIFT类描述子之外,近年来又有许多非常优秀的局部不变特征描述子,比如二值特征描述子。二值特征主要优点:速度快(faster);低内存(low memory)。

2010年Calonder[1]提出Brief描述子,同时在2012年正式定义了BRIEF描述子[2],该描述子是在局部图像特征点邻域内随机选取若干点对,将这些点对的灰度值的大小,组合成一个二进制串,并将这个二进制串作为该特征点的特征描述子,该二值化特征描述子不仅匹配速度快,而且存储要求内存低,因此手机应用中具有很好的应用前景。同时他的优缺点非常明显,优点在于速度,缺点有三:1. 不具备旋转不变性;2. 对噪声敏感;3. 不具备尺度不变性。而随后提出的ORB描述子就是对其中1和2点的改进。

2011年Rublee[3]等人提出ORB描述子,ORB描述子是基于BRIEF描述子提出的,它具备旋转不变性以及对噪声有一定抗干扰能力,运算速度非常快而且在许多场景下性能更好,和BRIEF描述子不同的地方在于其特征点检测是使用FAST算法[4],而且添加了特征点的主方向,使具有旋转不变性,同时旋转贪婪穷举法取得相关性较低的随机点对,还为了降低噪声对随机点对的影响,选择以像素点为中心的小块(patch)作为比较对象。缺点:不具备尺度不变性。

2011年Leutenegger [5]等人提出BRISK描述子,该描述子是BRIEF描述子的一种改进,相比于BRIEF特征,它具有旋转不变性、尺度不变性和对噪声的鲁棒性。检测尺度空间关键点时采用了FAST-9检测器,利用特征点周围S*S区域采样N个点;采样点越远高斯尺度越大,利用周围这些点计算局部梯度,如图3;同时BRISK描述子是二值特征,描述子的每一bit的值等于短距离点对的比值;二值特征匹配方法采样Hamming距离进行匹配。缺

点:计算复杂度较高。

图3 特征点描述

2012年Strecha [6]等人提出LDA-Hash描述子,它以SIFT特征为目标输入,LDA-Hash 方法进行降维实现目标识别:SIFT特征经LDA(Linear Discriminant Analysis),然后二值化形成简短的特征,以提高匹配速度、减少存储量;该特征在低虚警段,性能比SIFT好,但需要训练。

2012年Alahi[7]等人提出Freak描述子,它是基于人的视觉系统,同时比视网膜更精准,首先利用高斯核构建以像素点为中心的块(patch),越靠近中心点,块越小越密集,越远patch 越大越稀疏,和BIREF一样随机比对各区域像素得到一组二值特征;也设计了一种扫视搜索方法,因为Freak是粗到精细描述子(Coarse-to-fine descriptor),所以匹配的时候,先看前16bytes,即代表粗信息的部分,如果距离小于某个阈值,再继续看后面精的部分,如果大于就不用往后看了;Freak对方向旋转的容错性也还是不错的,比BRISK描述子强。

参考文献

[1]Calonder M,Lepetit V,Strecha C,et al. Brief: Binary robust independent elementary

features[M]//Computer Vision–ECCV 2010. Springer Berlin Heidelberg,2010: 778-792.

[2]Calonder M,Lepetit V,Ozuysal M,et al. BRIEF: Computing a local binary descriptor

very fast[J]. Pattern Analysis and Machine Intelligence,IEEE Transactions on,2012,34(7): 1281-1298.

[3]Rublee E,Rabaud V,Konolige K,et al. ORB: an efficient alternative to SIFT or

SURF[C]//Computer Vision (ICCV),2011 IEEE International Conference on. IEEE,2011: 2564-2571.

[4]Rosten E,Drummond T. Fusing points and lines for high performance

tracking[C]//Computer Vision,2005. ICCV 2005. Tenth IEEE International Conference on.

IEEE,2005,2: 1508-1515.

[5]Leutenegger S,Chli M,Siegwart R Y. BRISK: Binary robust invariant scalable

keypoints[C]//Computer Vision (ICCV),2011 IEEE International Conference on. IEEE,2011: 2548-2555.

[6]Strecha C,Bronstein A M,Bronstein M M,et al. LDAHash: Improved matching with

smaller descriptors[J]. Pattern Analysis and Machine Intelligence,IEEE Transactions on,2012,34(1): 66-78.

[7]Alahi A,Ortiz R,V andergheynst P. Freak: Fast retina keypoint[C]//Computer Vision and

Pattern Recognition (CVPR),2012 IEEE Conference on. IEEE,2012: 510-517.

三、SIFT特征和二值化类描述子结合的算法

2012年N Zhen-Sheng[1]提出B-SIFT(Binary SIFT)描述子,主要贡献是将SIFT128维的描述子改进为二值化的描述子,从而匹配时间降低了33%左右。

2014年Zhen Liu[2]等人针对大规模图像检索提出了易扩展尺度不变特征变换二值化算法(flexible SIFT binarization,FSB)算法,通过验证两幅图像局部二值化特征点的汉明距离来判断是否是正确匹配点。

[1]Zhen-Sheng N. B-SIFT: A Binary SIFT Based Local Image Feature Descriptor[C]//2012

Fourth International Conference on Digital Home,IEEE Computer Society. 2012: 117-121.

[2]Liu Z,Li H,Zhang L,et al. Cross-Indexing of Binary SIFT Codes for Large-Scale Image

Search[J]. IEEE Signal Processing Society,IEEE Transactions on ,2014,23: 2047 - 2057.

四、其他局部不变特征描述子

除了以上两大类局部特征描述子(SIFT类、局部二值类(local binary))外,近年来还出现了很多新的局部不变特征方法:

1.稠密特征(Dense Feature)

2010年Tola 提出DAISY描述子[1],该描述子是面向稠密特征提取的可快速计算的局部图像特征描述子,它本质思想和SIFT是一样的:分块统计梯度方向直方图,不同的是,DAISY在分块策略上进行了改进,利用高斯卷积来进行梯度方向直方图的分块汇聚,这样利用高斯卷积的可快速计算性就可以快速稠密地进行特征描述子的提取。

2.中层特征描述(Mid-level Patch)

2012年Singh[2]等人提出了中层块(Mid-level Patch)的概念,作者认为现有局部特征缺少足够的语义信息,该文提出的中层区别块(mid-level discriminative patches)最大的特点就是无监督的(unsupervised);中层块两大特征是鉴别性和代表性;文中采用了线性SVM来训练相似性量(patch)。

2013年Doersch[3]等人对中层块检测的贡献主要在于:基于Mean-shift 来挖掘具有鉴别性的部件;定义了Purity-Coverage 来刻画部件的代表性(representative)和鉴别性(discriminative)特性。

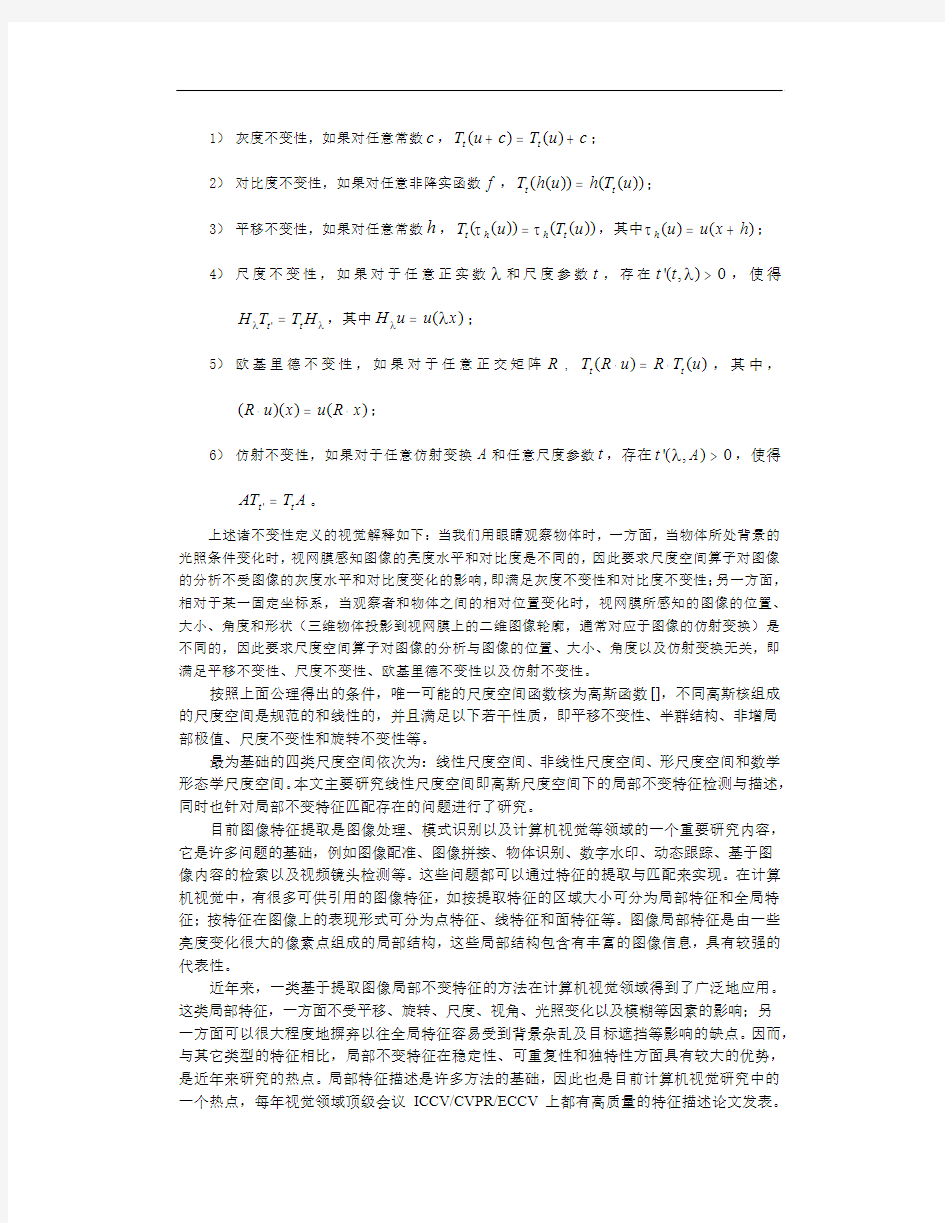

2013年Juneja[4]等人提出一种更好的中层特征挖掘的方法,首先分割图像,对图像每个分块进行梯度幅值均值估计,剔除“平坦”分块,再通过SVM学习块,通过LDA加速该迭代过程,判断中层特征鉴别性的方法则是entropy-rank 曲线,如下图4,通过比较曲线下面的面积来判断,面积(AUC)越小,则该部分检测器的鉴别性越好。

图4 Entropy-rank 曲线

3.显著性区域检测(Saliency region detection)

人去看一张图片,首先注意到的就是显著性的目标,而不会用类似于滑窗的方式去判断,这类现象在计算机视觉领域早有研究,术语为“图像显著性(Saliency Map)”。视觉显著性的定义可以表达为:生物体观察周围环境时,往往由于行为目的需求或局部景象线索将注意力有选择地集中在某个或某些景物上,从而选择一定的点或者区域作为景物的代表,进行视觉信息处理。

里程碑式的贡献来自于1998年Itti[5]提出的Visual attention的数学模型,第一次用计算模型表达Visual attention并展示了该问题能取得有意义的结果。提出显著性(saliency)这个问题之后几十年,如何生成显著图(Saliency Map)成为研究热点。

Itti文章中两大主要模块:

特征的提取:先把输入图像表示成9层的高斯金字塔。其中第0层是输入图像,1到8层分别是用5*5的高斯滤波器对输入图像进行滤波和采样形成的,大小分别的输入图像的1/2到1/256.。然后对金字塔每一层分别提取各种特征:亮度、红色、绿色、蓝色、黄色、方向,形成特征金字塔,然后对各种特征分别在特征金字塔的不同尺度间相减,得到的是中心(尺度c)和外周(尺度s)的特征的对比,即表示中心和外周的局部方向特征的对比。

显著图生成:把每一个上述得到的特征图归一化到区间[0 1],以消除和特征相关的幅度差别。为了消除干扰噪声突出显著部分,对每个特征图M分别用二维高斯差函数进行卷积,并把卷积结果叠加回原特征图,使同种特征以侧抑制的方式在空间上竞争。卷积和迭代过程进行多次,这样可以让少数几个最显著的点均匀分布在整个特征图上,从而每个特征图上只保留少数的几个显著点,在叠加多个特征图时能把多种显著特征的点突现出来。接下来分别把每一类(亮度、色度、方向)归一化后的特征图逐点求和(采样到第4尺度),得到对应于每一类特征的显著图,综合所有特征的显著性,就得到对应于输入图像的显著图S。

2007年Hou[6]等人提出一种简单visual saliency detection方法,首先在频域分析图像,然后通过快速算法在空域构建相应的saliency map。

2009年Achanta[7]等人提出一种完全分辨率的saliency map的显著性区域检测方法,该方法对于显著目标有定义明确的边界。提出的方法主要基于颜色和亮度特征,计算效率高,而且有很好的准确性和召回率。

2011年Cheng Mingming[8][9]等人提出的HC(Histogram based Contrast)和RC(Region based Contrast)两种显著性区域检测方法在准确性上达到了90%、召回率达到了95%,是目前生成显著性图最好的方法,算法的耗时分别为:HC为0.019s、RC为0.253s,目前显著性区域检测主要用于物体识别。随后,在2104年提出了BING(一般物体检测)目标检测算法,基于HOG特征和SVM学习方法,作者为了加快计算速度,将向量都进行二值化,实验结果中,目标候选框的准确率达到了96.2%。

参考文献

[1]Tola E,Lepetit V,Fua P. Daisy: An efficient dense descriptor applied to wide-baseline

stereo[J]. Pattern Analysis and Machine Intelligence,IEEE Transactions on,2010,32(5): 815-830.

[2]Singh S,Gupta A,Efros A A. Unsupervised discovery of mid-level discriminative

patches[M]//Computer Vision–ECCV 2012. Springer Berlin Heidelberg,2012: 73-86. [3]Doersch C,Gupta A,Efros A A. Mid-level visual element discovery as discriminative

mode seeking[C]//Advances in Neural Information Processing Systems. 2013: 494-502. [4]Juneja M,V edaldi A,Jawahar C V,et al. Blocks that shout: Distinctive parts for scene

classification[C]//Computer Vision and Pattern Recognition (CVPR),2013 IEEE

Conference on. IEEE,2013: 923-930.

[5]Itti L,Koch C,Niebur E. A model of saliency-based visual attention for rapid scene

analysis[J]. IEEE Transactions on pattern analysis and machine intelligence,1998,20(11): 1254-1259.

[6]Hou X,Zhang L. Saliency detection: A spectral residual approach[C]//Computer Vision and

Pattern Recognition,2007. CVPR'07. IEEE Conference on. IEEE,2007: 1-8.

[7]Achanta R,Hemami S,Estrada F,et al. Frequency-tuned salient region

detection[C]//Computer Vision and Pattern Recognition,2009. CVPR 2009. IEEE Conference on. IEEE,2009: 1597-1604.

[8]Cheng M M,Zhang G X,Mitra N J,et al. Global contrast based salient region

detection[C]//Computer Vision and Pattern Recognition (CVPR),2011 IEEE Conference on.

IEEE,2011: 409-416.

[9]Cheng M M,Zhang Z,Lin W Y,et al. BING: Binarized normed gradients for objectness

estimation at 300fps[C]//IEEE CVPR. 2014.

五、局部不变特征匹配方法性能比较

局部不变特征匹配的步骤分为四步:

a)特征点提取:在两张图像中选取最容易识别的像素点。

b)特征点描述:对提取的特征点进行描述,如SIFT的128维的梯度直方图向量,BRIEF

类的局部二值特征等。

c)匹配:通过比较特征点的描述子来判断它们在两张图像中的对应关系,常用方法为

欧式距离,汉明距离等

d)去误匹配点:消除错误的匹配点对,常用方法包括RANSAC等

对局部不变特征匹配算法性能评估十分重要[1],在计算机视觉领域,特征点提取性能的研究工作已经有人做了很多,不一一列举,主要评价标准为重复率,指同时出现在两幅图像中点的百分率,两幅图像中的重复率越高,可能被匹配的点数就越多,而匹配和识别的结果就越好。

特征点描述子的性能评估以2005年Mikolajczyk[2]的评价方法为参考标准,该文提出的评测标准至今都是很多局部描述子性能评估的方法。该文比较了形状上下文(context)[3],可操纵的滤波器[4],PCA-SIFT[5],微分不变性[6],旋转(spin)图像[7],SIFT[8],复杂滤波器[9],矩(moment)不变量[10]和不同类型兴趣区域的互相关性,该文的评价标准为召回率(Recall)。由于文章中的描述子年代较远,其对近年发展的描述子的性能参考价值较小,但是其评价标准即召回率还是主要评价标准之一。

2008年由Tuytelaars[11]等人做了一个关于局部不变特征检测器的调查,该文比较了2008年以前的角点检测器、特征描述子,给出了一个客观的评价,至今被引用了805次,较为全面,下表是特征检测器的总体概况。

表1特征检测器概述

2009年Juan Luo[12]等人比较了SIFT、SURF、PCA-SIFT三种描述子在尺度变化、旋转、模糊、光照变化、仿射变换情况下的性能。评价标准则是重复率和正确匹配点对数。测试表明,三种算法中SIFT在尺度变化、旋转变化、模糊变化下最稳定,SURF最快且性能和SIFT 接近,PCA-SIFT则牺牲性能提高了其运算时间。

表2实验结果

2012年10月中科院有研究人员对最常见的几种检测子和描述子进行了性能评估[13]。具体如下:

下面图5和图6的x坐标表示不同的检测子与描述子的组合,从1到30分别对应(SURF、AGAST、BRISK、FAST[14]、SIFT、ORB)检测子与(BRISK、AGAST、SURF、SIFT、ORB)描述子的线性组合,如第四组表示SURF检测子+ SIFT描述子的组合。y坐标表示一系列测试图片组,每组由两张图组成,这些图片都是质量较低的卫星地图,约2000*2000像素,每组的两张图片是由不同卫星对地面上同一地区进行拍摄的。它们之间的关系可能包含旋转,缩放,仿射变换,亮度变化,模糊,噪音等。从1到11的测试图片组大概对应着以下变换关系:

1.强烈亮度变化

2.旋转

3.仿射变换+尺度变化+旋转

4.仿射变换+亮度变化+旋转

5.仿射变换+噪音

6.模糊+亮度变化

7.旋转+噪音

8.旋转+尺度变化

9.亮度变化+旋转+模糊+噪音

10. 亮度变化+旋转+尺度变化

11. 亮度变化+旋转+尺度变化+强烈噪音。

其中,图5的z坐标表示成功匹配的像素对的个数。图6的z坐标表示所需计算时间。

图像局部特征描述子研究分析(未完-待续)

研究背景 在日常生活中,我们主要依赖于视觉来感知外界的信息,比起听觉,视觉能给我们更加丰富的描述。人们一直想通过计算机视觉来描述视觉信息中有意义和有用的东西。首先,我们必须回答什么类型的信息是我们想要的?如何提取这样的特征信息?有人定义视觉为发现图像是什么和在哪里的过程,这强调了视觉是一个信息处理任务[]。而如何构建一个视觉系统来进行这样的信息处理任务是很多学者研究的问题之一。其中,达成统一共识是利用不同的特征层来构建这一个视觉模型系统,最简单的三层体系结构为低层、中层、高层。而本文基于最基本的图像描述方法——尺度的概念,利用尺度空间表示法来分析最低层图像数据。尺度空间方法是一种尺度参数连续、不同尺度空间下采样保持一致性的视觉多尺度分析。 视觉多尺度分析是一种新的视觉信息处理方法,其基本思想是:当我们用眼睛观察物体且物体和观察者之间的距离(将距离视为尺度参数)不断变化时,视网膜将感知到不断变化的图像信息,分析和综合这些不同尺度下的视觉信息以获得被观察物体的本质特征,这种视觉分析方法即称为视觉多尺度分析。 尺度空间方法的基本思想是:在视觉信息(图像信息)处理模型中引入一个被视为尺度的参数,通过连续变化尺度参数获得不同尺度下的视觉处理信息,然后综合这些信息以深入地挖掘图像的本质特征。尺度空间方法将传统的单尺度视觉信息处理技术纳入尺度不断变化的动态分析框架中,因此更容易获得图像的本质特征。 为什么要研究尺度空间?可以从以下几个通俗的描述来说明: 1)现实世界的物体由不同尺度的结构所组成; 2)在人的视觉中,对物体观察的尺度不同,物体的呈现方式也不同; 3)对计算机视觉而言,无法预知某种尺度的物体结构是有意义的,因此有必要将所有尺度的结构表示出来; 4)从测量的角度来说,对物体的测量数据必然是依赖于某个尺度的,例如温度曲线的采集,不可能是无限的,而是在一定温度范围进行量化采集。温度范围即是选择的尺度; 5)采用尺度空间理论对物体建模,即将尺度的概念融合入物理模型之中。 尺度空间数学定义表示如下: 设多尺度分析的初始图像为0()u x (x , 为图像区域),(,)u x t 为多尺度分析用于图像所获得的在尺度(0)t t 时的图像,称0:()(,)t T u x u x t 为尺度空间算子,尺度空间算子族 0t t T 为尺度空间,并称为0:()(,)t h T u x t u x t h 尺度由t 变化到t h 的尺度空间算子。 依据尺度空间公理,尺度空间算子应满足如下定义的视觉不变性: 定义2 设t T 为尺度空间算子,称t T 具有

图像特征提取综述

图像特征提取的定位是计算机视觉和图像处理里的一个概念,表征图像的特性。输入是一张图像(二维的数据矩阵),输出是一个值、一个向量、一个分布、一个函数或者是信号。提取特征的方法千差万别,下面是图像特征的一些特性: 边缘 边缘是两个区域边界的像素集合,本质上是图像像素的子集,能将区域分开。边缘形状是任意的,实践中定义为大的梯度的像素点的集合,同时为了平滑,还需要一些算法进行处理。角 顾名思义,有个突然较大的弧度。早起算法是在边缘检测的基础上,分析边缘的走向,如果突然转向则被认为是角。后来的算法不再需要边缘检测,直接计算图像梯度的高度曲率(合情合理)。但会出现没有角的地方也检测到角的存在。 区域 区域性的结构,很多区域检测用来检测角。区域检测可以看作是图像缩小后的角检测。 脊 长形的物体,例如道路、血管。脊可以看成是代表对称轴的一维曲线,每个脊像素都有脊宽度,从灰梯度图像中提取要比边缘、角和区域都难。 特征提取 检测到特征后提取出来,表示成特征描述或者特征向量。 常用的图像特征:颜色特征、 纹理特征 形状特征 空间关系特征。 1.颜色特征 1.1特点:颜色特征是全局特征,对区域的方向、大小不敏感,但是不能很好捕捉局部特征。 优点:不受旋转和平移变化的影响,如果归一化不受尺度变化的影响。 缺点:不能表达颜色空间分布的信息。 1.2特征提取与匹配方法 (1)颜色直方图 适用于难以自动分割的图像,最常用的颜色空间:RGB和HSV。 匹配方法:直方图相交法(相交即交集)、距离法、中心距法、参考颜色表法、累加颜色直方图法。 对颜色特征的表达方式有许多种,我们采用直方图进行特征描述。常见的直方图有两种:统计直方图,累积直方图。我们将分别实验两种直方图在图像聚类和检索中的性能。 统计直方图 为利用图像的特征描述图像,可借助特征的统计直方图。图像特征的统计直方图实际是一个1-D的离散函数,即: 上式中k代表图像的特征取值,L是特征可取值个数,是图像中具有特征值为k的像素的个数,N是图像像素的总数,一个示例如下图:其中有8个直方条,对应图像中的8种灰度像素在总像素中的比例。

图像特征提取总结

图像常见特征提取方法简介 常用的图像特征有颜色特征、纹理特征、形状特征、空间关系特征。 一、颜色特征 (一)特点:颜色特征是一种全局特征,描述了图像或图像区域所对应的景物的表面性质。一般颜色特征是基于像素点的特征,此时所有属于图像或图像区域的像素都有各自的贡献。由于颜色对图像或图像区域的方向、大小等变化不敏感,所以颜色特征不能很好地捕捉图像中对象的局部特征。另外,仅使用颜色特征查询时,如果数据库很大,常会将许多不需要的图像也检索出来。颜色直方图是最常用的表达颜色特征的方法,其优点是不受图像旋转和平移变化的影响,进一步借助归一化还可不受图像尺度变化的影响,基缺点是没有表达出颜色空间分布的信息。 (二)常用的特征提取与匹配方法 (1)颜色直方图 其优点在于:它能简单描述一幅图像中颜色的全局分布,即不同色彩在整幅图像中所占的比例,特别适用于描述那些难以自动分割的图像和不需要考虑物体空间位置的图像。其缺点在于:它无法描述图像中颜色的局部分布及每种色彩所处的空间位置,即无法描述图像中的某一具体的对象或物体。 最常用的颜色空间:RGB颜色空间、HSV颜色空间。 颜色直方图特征匹配方法:直方图相交法、距离法、中心距法、参考颜色表法、累加颜色直方图法。 (2)颜色集 颜色直方图法是一种全局颜色特征提取与匹配方法,无法区分局部颜色信息。颜色集是对颜色直方图的一种近似首先将图像从RGB颜色空间转化成视觉均衡的颜色空间(如HSV 空间),并将颜色空间量化成若干个柄。然后,用色彩自动分割技术将图像分为若干区域,每个区域用量化颜色空间的某个颜色分量来索引,从而将图像表达为一个二进制的颜色索引集。在图像匹配中,比较不同图像颜色集之间的距离和色彩区域的空间关系 (3)颜色矩 这种方法的数学基础在于:图像中任何的颜色分布均可以用它的矩来表示。此外,由于颜色分布信息主要集中在低阶矩中,因此,仅采用颜色的一阶矩(mean)、二阶矩(variance)和三阶矩(skewness)就足以表达图像的颜色分布。 (4)颜色聚合向量 其核心思想是:将属于直方图每一个柄的像素分成两部分,如果该柄内的某些像素所占据的连续区域的面积大于给定的阈值,则该区域内的像素作为聚合像素,否则作为非聚合像素。(5)颜色相关图 二纹理特征 (一)特点:纹理特征也是一种全局特征,它也描述了图像或图像区域所对应景物的表面性质。但由于纹理只是一种物体表面的特性,并不能完全反映出物体的本质属性,所以仅仅利用纹理特征是无法获得高层次图像内容的。与颜色特征不同,纹理特征不是基于像素点的特征,它需要在包含多个像素点的区域中进行统计计算。在模式匹配中,这种区域性的特征具有较大的优越性,不会由于局部的偏差而无法匹配成功。作为一种统计特征,纹理特征常具有旋转不变性,并且对于噪声有较强的抵抗能力。但是,纹理特征也有其缺点,一个很明显的缺点是当图像的分辨率变化的时候,所计算出来的纹理可能会有较大偏差。另外,由于有可能受到光照、反射情况的影响,从2-D图像中反映出来的纹理不一定是3-D物体表面真实

图像纹理特征的分析方法研究

图像纹理特征的分析方法研究 黄晶,杨杰 武汉理工大学信息工程学院,武汉(430063) E-mail :jinghuang1019@https://www.360docs.net/doc/2211169440.html, 摘 要:本文重点介绍了几种借助纹理统计特征的分析方法,并对算法进行了比较。这些方 法包括:基于图像分形维数的特征分析,基于灰度共生矩阵的特征分析,基于灰度直方图的 特征提取。 关键词:分形维数,灰度共生矩阵,纹理特征 中图分类号:TP391 1.引言 虽然存在形形色色的图像纹理,并且人们进行纹理分析方面的工作已近半个世纪,但至 今还没有一个公认的确切的定义。纹理图像在局部区域内可能称不规则性,但在整体上则表 现出某种规律性,其灰度分布往往表现出某种周期性。 就其广义而言,纹理特征就是图像局部性质的统计,一个纹理图像可以看成一组独立的 同分布随机变量(,)W j k 经一空间算子()O ?作用而成的结果(,)F j k ,并用这些数字特征构 造图像的纹理特征。对纹理特征的提取方法可以分为统计法﹑构造法和频谱法。 2.纹理特征的分析方法 2.1 基于分形维数的特征分析 在分形理论中,最经典的理论是Hausdorff 维数[1],它对分形的理论分析和理解都很重 要,但很难直接求取,在实际运用中更多的是盒维数,关联维数,自相似维数以及尺度维数, 本文选取的是盒维数中的差分盒维数。 差分盒维数算法是以盒维数算法为基础提出的一种简单、快速、精确的算法。将M M ×大小的图像分割成L L ×的子块,令r=L/M ,将图像视为一个三维空间中的一个表面 (,,(,))x y f x y ,其中(,)f x y 为图像(,)x y 位置处的灰度值。X ,Y 平面被分割成许多L L ×的网格。在每个网格上,是一列L L h ××的盒子,h 为单个盒子的高度。设总的灰度级为G 。 设在第(,)i j 网格中图像灰度的最小值和最大值分别落在第k 和第l 个盒子中,则: (,)1r n i j l k =?+ (1) 其中r n 是覆盖第(,)i j 网格中的图像所需的盒子数,因而可以求出覆盖整个图像所需的 盒子数r N : ,(,)r r i j N n i j =∑ (2) 则其分形维数log()lim log(1/) r N D r = (3)基于分形维数的特征分析算法: (1)将原图转化为灰度图像; (2)以图像的任意像点(,,(,))i j f i j 为中心选取L L ×大小的窗口计算r n

图像局部特征点检测算法综述

图像局部特征点检测算法综述 研究图像特征检测已经有一段时间了,图像特征检测的方法很多,又加上各种算法的变形,所以难以在短时间内全面的了解,只是对主流的特征检测算法的原理进行了学习。总体来说,图像特征可以包括颜色特征、纹理特等、形状特征以及局部特征点等。其中局部特点具有很好的稳定性,不容易受外界环境的干扰,本篇文章也是对这方面知识的一个总结。 本篇文章现在(2015/1/30)只是以初稿的形式,列出了主体的框架,后面还有许多地方需要增加与修改,例如2013年新出现的基于非线性尺度空间的KAZE特征提取方法以及它的改进AKATE等。在应用方面,后面会增一些具有实际代码的例子,尤其是基于特征点的搜索与运动目标跟踪方面。 1. 局部特征点 图像特征提取是图像分析与图像识别的前提,它是将高维的图像数据进行简化表达最有效的方式,从一幅图像的M×N×3的数据矩阵中,我们看不出任何信息,所以我们必须根据这些数据提取出图像中的关键信息,一些基本元件以及它们的关系。 局部特征点是图像特征的局部表达,它只能反正图像上具有的局部特殊性,所以它只适合于对图像进行匹配,检索等应用。对于图像理解则不太适合。而后者更关心一些全局特征,如颜色分布,纹理特征,主要物体的形状等。全局特征容易受到环境的干扰,光照,旋转,噪声等不利因素都会影响全局特征。相比而言,局部特征点,往往对应着图像中的一些线条交叉,明暗变化的结构中,受到的干扰也少。 而斑点与角点是两类局部特征点。斑点通常是指与周围有着颜色和灰度差别的区域,如草原上的一棵树或一栋房子。它是一个区域,所以它比角点的噪能力要强,稳定性要好。而角点则是图像中一边物体的拐角或者线条之间的交叉部分。 2. 斑点检测原理与举例 2.1 LoG与DoH 斑点检测的方法主要包括利用高斯拉普拉斯算子检测的方法(LOG),以及利用像素点Hessian矩阵(二阶微分)及其行列式值的方法(DOH)。 LoG的方法已经在斑点检测这入篇文章里作了详细的描述。因为二维高斯函数的拉普拉斯核很像一个斑点,所以可以利用卷积来求出图像中的斑点状的结构。 DoH方法就是利用图像点二阶微分Hessian矩阵:

形状特征提取

形状特征提取 (一)特点:各种基于形状特征的检索方法都可以比较有效地利用图像中感兴趣的目标来进行检索,但它们也有一些共同的问题,包括:①目前基于形状的检索方法还缺乏比较完善的数学模型;②如果目标有变形时检索结果往往不太可靠;③许多形状特征仅描述了目标局部的性质,要全面描述目标常对计算时间和存储量有较高的要求;④许多形状特征所反映的目标形状信息与人的直观感觉不完全一致,或者说,特征空间的相似性与人视觉系统感受到的相似性有差别。另外,从 2-D 图像中表现的3-D 物体实际上只是物体在空间某一平面的投影,从2-D 图像中反映出来的形状常不是3-D 物体真实的形状,由于视点的变化,可能会产生各种失真。 (二)常用的特征提取与匹配方法 Ⅰ几种典型的形状特征描述方法 通常情况下,形状特征有两类表示方法,一类是轮廓特征,另一类是区域特征。图像的轮廓特征主要针对物体的外边界,而图像的区域特征则关系到整个形状区域。 几种典型的形状特征描述方法: (1)边界特征法该方法通过对边界特征的描述来获取图像的形状参数。其中Hough 变换检测平行直线方法和边界方向直方图方法是经典方法。Hough 变换是利用图像全局特性而将边缘像素连接起来组成区域封闭边界的一种方法,其基本思想是点—线的对偶性;边界方向直方图法首先微分图像求得图像边缘,然后,做出关于边缘大小和方向的直方图,通常的方法是构造图像灰度梯度方向矩阵。 (2)傅里叶形状描述符法 傅里叶形状描述符(Fourier shape descriptors)基本思想是用物体边界的傅里叶变换作为形状描述,利用区域边界的封闭性和周期性,将二维问题转化为一维问题。 由边界点导出三种形状表达,分别是曲率函数、质心距离、复坐标函数。 (3)几何参数法 形状的表达和匹配采用更为简单的区域特征描述方法,例如采用有关形状定量测度(如矩、面积、周长等)的形状参数法(shape factor)。在QBIC 系统中,便是利用圆度、偏心率、主轴方向和代数不变矩等几何参数,进行基于形状特征的图像检索。

图像特征特点及其常用的特征提取与匹配方法

图像特征特点及其常用的特征提取与匹配方法 [ 2006-9-22 15:53:00 | By: 天若有情 ] 常用的图像特征有颜色特征、纹理特征、形状特征、空间关系特征。 一颜色特征 (一)特点:颜色特征是一种全局特征,描述了图像或图像区域所对应的景物的表面性质。一般颜色特征是基于像素点的特征,此时所有属于图像或图像区域的像素都有各自的贡献。由于颜色对图像或图像区域的方向、大小等变化不敏感,所以颜色特征不能很好地捕捉图像中对象的局部特征。另外,仅使用颜色特征查询时,如果数据库很大,常会将许多不需要的图像也检索出来。颜色直方图是最常用的表达颜色特征的方法,其优点是不受图像旋转和平移变化的影响,进一步借助归一化还可不受图像尺度变化的影响,基缺点是没有表达出颜色空间分布的信息。 (二)常用的特征提取与匹配方法 (1)颜色直方图 其优点在于:它能简单描述一幅图像中颜色的全局分布,即不同色彩在整幅图像中所占的比例,特别适用于描述那些难以自动分割的图像和不需要考虑物体空间位置的图像。其缺点在于:它无法描述图像中颜色的局部分布及每种色彩所处的空间位置,即无法描述图像中的某一具体的对象或物体。 最常用的颜色空间:RGB颜色空间、HSV颜色空间。 颜色直方图特征匹配方法:直方图相交法、距离法、中心距法、参考颜色表法、累加颜色直方图法。 (2)颜色集 颜色直方图法是一种全局颜色特征提取与匹配方法,无法区分局部颜色信息。颜色集是对颜色直方图的一种近似首先将图像从RGB颜色空间转化成视觉均衡的颜色空间(如HSV 空间),并将颜色空间量化成若干个柄。然后,用色彩自动分割技术将图像分为若干区域,每个区域用量化颜色空间的某个颜色分量来索引,从而将图像表达为一个二进制的颜色索引集。在图像匹配中,比较不同图像颜色集之间的距离和色彩区域的空间关系 (3)颜色矩 这种方法的数学基础在于:图像中任何的颜色分布均可以用它的矩来表示。此外,由于颜色分布信息主要集中在低阶矩中,因此,仅采用颜色的一阶矩(m ean)、二阶矩(variance)和三阶矩(skewness)就足以表达图像的颜色分布。(4)颜色聚合向量 其核心思想是:将属于直方图每一个柄的像素分成两部分,如果该柄内的某些像素所占据的连续区域的面积大于给定的阈值,则该区域内的像素作为聚合像素,否则作为非聚合像素。 (5)颜色相关图 二纹理特征 (一)特点:纹理特征也是一种全局特征,它也描述了图像或图像区域所对应景物的表面性质。但由于纹理只是一种物体表面的特性,并不能完全反映出物体的本质属性,所以仅仅利用纹理特征是无法获得高层次图像内容的。与颜色特征不同,纹理特征不是基于像素点的特征,它需要在包含多个像素点的区域中进行统计计算。在模式匹配中,这种区域性的特征具有较大的优越性,不会由于局

基于局部特征的图像匹配方法

第32卷第8期2012年08月 西安工业大学学报 JoumalofXi’anTechnologicalUniversity Vol-32No.8 Aug.2012 文章编号:1673—9965(2012)08—679—05 基于局部特征的图像匹配方法’ 李静,张海波 (西安工业大学电子信息工程学院,西安710032) 摘要:为了提高图像匹配算法的性能,使用一种改进的K—d树改善特征点匹配时的数据检索方式,用随机抽样一致性算法对提取的匹配对进行提纯.实验结果表明,在不同尺度及旋转、不同视角、不同光线的情况下,此算法剔除了误匹配的特征点和不必要的特征点,提高了图像匹配的精度. 关键词:局部特征;SIFT;特征点提取;匹配对提纯 中图号:TP317。4文献标志码:A 长久以来,计算机视觉一直是人们研究的热点.然而,即使是一个十分简单的物体,要使用计算机去识别它都是一件十分不容易的事情.其中,最为关键的莫过于物体的表示或描述,也就是说,究竟提取什么样的特征才能够用于区别一个物体与另一个物体.局部不变特征的出现,较好的解决这一问题[1].局部特征成功的真正原因在于它提供了一种具有统计意义的图像内容描述.这种图像内容表达方式避免了图像处理中语义层次上的图像分割[2]- 利用局部特征进行图像检测最常用的就是角点检测算法.但是角点检测就其本质而言只是某种滤波函数的响应结果,滤波函数对图像中的灰度突变的敏感程度决定其精确度,且角点相关特征区域仅为角点周围的有限邻域,区域特性不够直观.尺度不变特征变换算法(ScaleInvariantFeatureTransform,SIFT)是一种稳定的局部特征匹配算法,该算法以其优良的尺度和旋转不变性以及对光照和视角变化的鲁棒性,被广泛应用于机器人视觉、三维目标重建、医学图像配准等领域.但在现实条件的复杂性使得这种算法在运行时产生大量不必要的特征点,在时间和空间上均造成了大量的浪费,这不仅严重影响了算法的实时陛,也导致了算法的精度的下降.因此,需要建立高效的匹配策略和提取有效的特征点的方法. 为了提高图像匹配的速度和精度,在利用sIFT算法对两幅图像的特征点进行提取和描述后,采用一种改进的K—d树最近邻查询算法对特征点进行检索,提高特征点匹配的效率;最后使用随机抽样一致性(RandomSampleConsensus,RANSAC)算法对匹配对进行提纯,得到更为精确的特征点匹配对. 1基于SIFT的图像特征提取算法 将图像的尺度空间表示成一个函数L(z,y,d),它是由一个变尺度的高斯函数G(z,37,仃)与图像I(z,y)卷积产生的.即 L(z,y,口)一G(z,y,仃)oJ(z,y) 其中,o表示在z和y两个方向上进行卷积操作,而G(z,y,d)为 G(z,y,仃)一I专f‘≯彬)7劳 厶丁【盯 在某一尺度上对斑点的检测,可以通过对两个相邻高斯尺度空间的图像相减,得到一个DoG(DifferentofGaussians)的响应值图像D(z,y,口).然后,通过对响应值图像D(z,y,盯)进行非 *收稿日期:2011一09—26 作者简介:李静(1972一),女,西安工业大学副教授,主要研究方向为动态测试,信息融合,先进控制理论.E-mail:gem991i@163.c01TL 万方数据

图像特征提取方法

图像特征提取方法 摘要 特征提取是计算机视觉和图像处理中的一个概念。它指的是使用计算机提取图像信息,决定每个图像的点是否属于一个图像特征。特征提取的结果是把图像上的点分为不同的子集,这些子集往往属于孤立的点、连续的曲线或者连续的区域。 至今为止特征没有万能和精确的图像特征定义。特征的精确定义往往由问题或者应用类型决定。特征是一个数字图像中“有趣”的部分,它是许多计算机图像分析算法的起点。因此一个算法是否成功往往由它使用和定义的特征决定。因此特征提取最重要的一个特性是“可重复性”:同一场景的不同图像所提取的特征应该是相同的。 特征提取是图象处理中的一个初级运算,也就是说它是对一个图像进行的第一个运算处理。它检查每个像素来确定该像素是否代表一个特征。假如它是一个更大的算法的一部分,那么这个算法一般只检查图像的特征区域。作为特征提取的一个前提运算,输入图像一般通过高斯模糊核在尺度空间中被平滑。此后通过局部导数运算来计算图像的一个或多个特征。 常用的图像特征有颜色特征、纹理特征、形状特征、空间关系特征。当光差图像时,常 常看到的是连续的纹理与灰度级相似的区域,他们相结合形成物体。但如果物体的尺寸很小 或者对比度不高,通常要采用较高的分辨率观察:如果物体的尺寸很大或对比度很强,只需 要降低分辨率。如果物体尺寸有大有小,或对比有强有弱的情况下同事存在,这时提取图像 的特征对进行图像研究有优势。 常用的特征提取方法有:Fourier变换法、窗口Fourier变换(Gabor)、小波变换法、最 小二乘法、边界方向直方图法、基于Tamura纹理特征的纹理特征提取等。

设计内容 课程设计的内容与要求(包括原始数据、技术参数、条件、设计要求等):一、课程设计的内容 本设计采用边界方向直方图法、基于PCA的图像数据特征提取、基于Tamura纹理特征的纹理特征提取、颜色直方图提取颜色特征等等四种方法设计。 (1)边界方向直方图法 由于单一特征不足以准确地描述图像特征,提出了一种结合颜色特征和边界方向特征的图像检索方法.针对传统颜色直方图中图像对所有像素具有相同重要性的问题进行了改进,提出了像素加权的改进颜色直方图方法;然后采用非分割图像的边界方向直方图方法提取图像的形状特征,该方法相对分割方法具有简单、有效等特点,并对图像的缩放、旋转以及视角具有不变性.为进一步提高图像检索的质量引入相关反馈机制,动态调整两幅图像相似度中颜色特征和方向特征的权值系数,并给出了相应的权值调整算法.实验结果表明,上述方法明显地优于其它方法.小波理论和几个其他课题相关。所有小波变换可以视为时域频域的形式,所以和调和分析相关。所有实际有用的离散小波变换使用包含有限脉冲响应滤波器的滤波器段(filterbank)。构成CWT的小波受海森堡的测不准原理制约,或者说,离散小波基可以在测不准原理的其他形式的上下文中考虑。 通过边缘检测,把图像分为边缘区域和非边缘区域,然后在边缘区域内进行边缘定位.根据局部区域内边缘的直线特性,求得小邻域内直线段的高精度位置;再根据边缘区域内边缘的全局直线特性,用线段的中点来拟合整个直线边缘,得到亚像素精度的图像边缘.在拟合的过程中,根据直线段转角的变化剔除了噪声点,提高了定位精度.并且,根据角度和距离区分出不同直线和它们的交点,给出了图像精确的矢量化结果 图像的边界是指其周围像素灰度有阶跃变化或屋顶变化的那些像素的集合,边界广泛的存在于物体和背 景之间、物体和物体之间,它是图像分割所依赖的重要特征.边界方向直方图具有尺度不变性,能够比较好的 描述图像的大体形状.边界直方图一般是通过边界算子提取边界,得到边界信息后,需要表征这些图像的边 界,对于每一个边界点,根据图像中该点的梯度方向计算出该边界点处法向量的方向角,将空间量化为M级, 计算每个边界点处法向量的方向角落在M级中的频率,这样便得到了边界方向直方图. 图像中像素的梯度向量可以表示为[ ( ,),),( ,),)] ,其中Gx( ,),),G ( ,),)可以用下面的

图像特征及图像特征提取

图像特征提取 摘要本文着重阐述了图像的纹理特征、灰度共生矩阵及其特点,进行了基于灰度共生矩阵的纹理特征提取实验,并采用最小距离判别函数,对图像的特征值进行分类识别。实验表明,对于具有显著纹理特征的图像,基于纹理特征的图像分类识别具有一定的准确性、可靠性和实用性。 关键词特征提取;灰度共生矩阵;最小距离判别法 1 引言图像识别是随计算机的发展而兴起的一门学科,现已渗透各个领域。如生物学中的色体特性研究;天文学中的望远镜图像分析;医学中的心电图分析、脑电图分析、医学图像分析;军事领域中的航空摄像分析、雷达和声纳信号检测和分类、自动目标识别等等。当前,对图像分类识别的常用方法是先提取图像特征,再进行特征值的归类。图像特征包括几何特征、形状特征、颜色特征、纹理特征等等。本文主要针对图像的纹理特征进行提取、分析,最后实现具有显著纹理特性的图像的分类识别。 2 图像的纹理特征纹理是景物的一个重要特征。通常认为纹理是在图像上表现为灰度或颜色分布的某种规律性,这种规律性在不同类别的纹理中有其不同特点。纹理大致可分为两类:一类是规则纹理,它由明确的纹理基本元素(简称纹理基元)经有规则排列而成,常被称为人工纹理。另一类是准规则纹理,它们的纹理基元没有明确的形状,而是某种灰度或颜色的分布。这种分布在空间位置上的反复出现形成纹理,这样的重复在局部范围内往往难以体察出来,只有从整体上才能显露。这类纹理存在着局部不规则和整体规律性的特点,常被称为自然纹理。纹理特征可用来描述对象物表面的粗糙程度和它的方向性,也可用来分析生物材料组织,或者用来进行图像分割。纹理特征提取的方法随纹理类别的不同而不同,一般,规则纹理采用结构分析方法,准规则纹理采用统计分析方法。 3 灰度共生矩阵由于纹理是由灰度分布在空间位置上反复出现而形成的,因而在图像空间中相隔某距离的两象素之间会存在一定的灰度关系,即图像中灰度的空间相关特性。灰度共生矩阵就是一种通过研究灰度的空间相关特性来描述纹理的常用方法。3.1 灰度共生矩阵生成灰度直方图是对图像上单个象素具有某个灰度进行统计的结果,而灰度共生矩阵是对图像上保持某距离的两象素分别具有某灰度的状况进行统计得到的。取图像(N×N)中任意一点(x,y)及偏离它的另一点(x+a,y+b),设该点对的灰度值为(g1,g2)。令点(x,y)在整个画面上移动,则会得到各种(g1,g2)。值,设灰度值的级数为,则(g1,g2)。的组合共有k2种。对于整个画面,统计出每一种(g1,g2)值出现的次数,然后排列成一个方阵,在用(g1,g2)出现的总次数将它们归一化为出现的概率P(g1,g2),这样的方阵称为灰度共生矩阵。距离差分值(a,b)取不同的数值组合,可以得到不同情况下的联合概率矩阵。(a,b)取值要根据纹理周期分布的特性来选择,对于较细的纹理,选取(1,0)、(1,1)、(2,0)等小的差分值。 当a=1,b=0时,像素对是水平的,即0度扫描;当a=1,b=0 时,像素对是垂直的,即90度扫描;当 a=1,b=1时,像素对是右对角线的,即45度扫描;当a=-1,b=-1时,像素对是左对角线,即135度扫描。这样,两个象素灰度级同时发生的概率,就将(x,y)的空间坐标转化为“灰度对” (g1,g2)的描述,形成了灰度共生矩阵。实验中对灰

CCD图像的轮廓特征点提取算法

第33卷第4期电子科技大学学报V ol.33 No.4 2004年8月Journal of UEST of China Aug. 2004 CCD图像的轮廓特征点提取算法 侯学智,杨平,赵云松 (电子科技大学机械电子工程学院成都 610054) 采用最大方差法将图像二值化,用图像形态学的梯度细化和修剪算法来提取边缘轮廓,利用十一【摘要】﹑ 点曲率法得到轮廓的角点和切点的大致位置。提出了一种基于最小二乘拟合的改进算法,来进一步确定角点和切点,并对轮廓分段识别。该算法应用在基于图像处理的刀具测量系统中,实际结果表明具有良好的抗噪声性能,能准确提取出图像的特征点。 关键词刀具测量; 细化; 曲率; 最小二乘拟合; 角点 中图分类号TP391 文献标识码 A Contour Feature Point Detection Algorithm of CCD Image Hou Xuezhi,Yang Ping,Zhao Yunsong (School of Mechatronic Engineering, UEST of China Chengdu 610054) Abstract The image is segmented to Bi-value image with max variance algorithm, and then the edge is detected by a series of image morphology algorithm including grads, thinning and cutting. The eleven point curvature-computing method is used to locate the area of corner and point of tangency. An improved algorithm based on least square fitting is given to search corner and point of tangency. This algorithm is applied to the cutting tools measurement system based on image processing and the actual result proves it has a good noise-resisted performance and can detect feature points accurately. Key words cutting tools measurement; thinning; curvature; least square fitting; corner 目前数控加工精度已达到微米级,对刀精度要求愈来愈高。传统的刀具测量方式采用人眼瞄准,容易带来主观误差,使对刀精度降低。在基于图像处理的刀具测量系统中,CCD数码相机将对刀状态的图像摄入,通过USB接口输入计算机。首先提取出刀具轮廓的特征点,再对轮廓曲线进行分段,从而测量刀具的长度﹑半径﹑角度等参数。通常利用曲率信息来提取轮廓特征点,三点曲率法对噪声较敏感,十一点曲率法能较好地估算出轮廓的曲率,并能简单提取出轮廓的角点与切点区域[1, 2]。本文提出利用最小二乘法拟合角点和切点区域的曲线,根据计算的斜率和曲率的特点能有效确定角点和切点。 1 图像预处理 被测刀具的图像如图1所示。CCD相机采集到刀具的彩色图像,将其转化为256色的灰度图像,如图1a 所示,采用最大方差阈值法将图像二值化。由于刀具表面存在油污,光线散射等原因,图像二值化后,在刀具部分有颗粒状噪声,而刀具以外有细小孔洞存在,所以在提取轮廓前,采用形态学算子滤波。在图像形态学中,最基本的运算是腐蚀和膨胀运算,通过腐蚀和膨胀可以构成开运算与闭运算。开闭运算都能够平滑边缘,其中开运算能够消除细小物体,闭运算能够填充物体孔洞。本文采用方形结构元素,对图像先闭运算后开运算,有效地滤除了图像的细小孔洞和噪声,而刀具的结构和面积基本保持不变。图1b所示为 收稿日期:2003 ? 07 ? 24 作者简介:侯学智(1980 ? ),男,硕士生,主要从事工业测控技术方面的研究.

第6章 纹理描述与识别

第6章 纹理描述与识别 纹理是图像的重要视觉特征,是物体表面颜色或亮度规律性分布或变化的重要性质。有关纹理的概念在人们心理中自然形成,但很难用确切的语言或文字描述,因而在自然语言中有较少的纹理描述词。目前对纹理虽然没有准确的定义,但数学上的描述已有一些有效的方法,如Tamura 参数、亮度共生矩阵、随机场模型、小波变换等。这些方法试图利用统计、变换、识别等方法,描述纹理的空间、频域和结构性质,因此,纹理的描述方法可分为统计法、频谱法和结构法。纹理识别就是利用各种纹理描述参数识别纹理结构或纹理性质。 6.1 图像纹理的描述方法 6.1.1 Tamura 纹理特征提取 基于人类对纹理的视觉感知心理学研究,Tamura 等人提出了纹理特征的6个特征参数:粗糙度(coarseness)、对比度(contrast)、方向度(directionality)、线像度(linelikeness)、规整度(regularity)和粗略度(roughness)。其中,前三项用的最多,定义如下: 1.粗糙度 粗糙度指图像纹理变化的粒度。当图像的纹理变化间隔较大时,图像给人的感觉比较粗糙;当图像的纹理变化间隔很小时,图像给人的感觉比较细腻,也就是粗糙度较小。粗糙度与图像的分辨率有关,分辨率大,纹理元尺度大,重复次数少,则图像比较粗糙。 粗糙度是纹理最本质的特性,计算方法可以按以下几个步骤进行。 (1)计算图像中每个像素在2k *2k 邻域内的平均亮度,即: ∑∑ -+-=-+-=----= 1221 2221111 2/),(),(k k k k x x i y y j k k j i g y x A 其中k=0,1,2,…,5,g(i,j)是图像中(i,j)点的像素亮度值。 (2)对于每个像素,在水平和垂直方向上分别计算不同尺度的互不重叠的窗口之间的平均亮度差,即: |),2(),2(|),(11,y x A y x A y x E k k k k h k ----+=

一种高效的图像局部特征匹配算法

2010年4月第28卷第2期西北工业大学学报 Journa l o f N orth w estern P olytechn i ca lU n i versity A pr .V o.l 282010N o .2 收稿日期:2009-03-05 基金项目:国家/8630项目(2007AA 01Z314)、国家自然科学基金(60873085)以及教育部/新世纪优秀人才0计划(NCET-06-0882)资助 作者简介:杨 恒(1980-),西北工业大学博士研究生,主要从事高维特征向量搜索、图像搜索及计算机视觉等研究。 一种高效的图像局部特征匹配算法 杨 恒,王 庆 (西北工业大学计算机学院,陕西西安 710072) 摘 要:文章提出了一种高效的图像局部特征匹配算法。在特征描述子构建阶段,提出基于梯度的距离和方向直方图(gradient d istance and orientation h istogra m,GDOH )算法,其特征向量维数仅是SI FT 和GLOH 描述子的一半,然而却具有与SI FT 和GLOH 相当的性能;在高维特征空间最近邻搜索阶段,提出基于子向量的索引结构(i n dex i n g sub-vectors ,I SV ),I SV 算法比BBF(Best B i n F irst)算法具有更 高的搜索精度和更快的搜索速度。实验结果证明文中提出的图像局部特征匹配算法(GDOH +I SV )比目前广泛使用的Lo w e 的算法 [12] (SI FT+BBF)更加高效。 关 键 词:计算机视觉,局部特征,GDOH,IS V,特征搜索,特征匹配 中图分类号:TP391 文献标识码:A 文章编号:1000-2758(2010)02-0291-07 图像局部特征匹配已经越来越广泛地应用于计算机视觉领域,成为解决诸多问题的关键步骤,如图像检索、目标识别、全景图拼接以及三维场景重建等[1~9]。一般来讲,进行图像间局部特征匹配分为2个阶段:1特征点建立描述子,即高维特征向量。描述子应该具备较强的区分力,而且能够对图像间的各种几何变换以及光照变化保持不变性。o在高维向量空间中进行最近邻搜索,理想的搜索算法应能够尽可能准地找到最近邻向量,同时付出尽可能少的时间代价。 近年来,许多描述局部特征的算法被提出。Johnson 等[10] 提出了一种可以描述物体形状的纺线图(sp i n I m age)作为描述子,纺线图由特征点位置周围区域的三维直方图组成,该描述子能够对特征点的刚性变换保持不变。B r own 等[5] 对尺度空间中图像关键点位置周围8@8区域进行采样并提取出64维的描述子,由于采样考虑了特征的主方向和特征尺度,因此该描述子能够对图像间旋转变换和尺度缩放保持不变性。F l o rack 等[11] 用一组不同阶的微分算子组成描述子,该描述子可以保持旋转不变性。Schaffalitzky 和Zisser m an [1] 提出了一组复滤波器作 为局部特征区域描述,可以避免对特征主方向的估 计,同时保持对图像旋转的不变性。Lo w e [12] 提出了著名的SI FT 描述子,在每个关键点周围4@4子区域上计算8个梯度方向直方图,这样每个关键点就可以产生128维的特征向量。SI FT 描述子能够对图像旋转、尺度缩放、线性光照变化甚至弱仿射变换保持很好的不变性,具有很高的区分力。近年来,人们又提出了针对SI FT 描述子的各种改进算法。Ke 等[13] 提出了PC A-SI FT 描述子,在关键点周围41@41区域内计算每个象素点的垂直和水平梯度,组成3042维特征向量,然后利用PCA 技术对描述向量进行降维。PC A-SI FT 描述子能够有效地降低特征向量维数,但是M i k ola jczyk 等 [14] 等比较和评价了各 种局部描述子的性能,并指出PC A-SI FT 描述子在大多数实验中性能都要低于SI FT 描述子。M iko la -jczyk 等人还通过实验证实了S I F T 描述子在大多数情况下受图像间的各种变换影响最小,具有最稳定的匹配性能。同时他们还提出了一种叫做梯度的位置和方向直方图(grad ient location-o rientation h isto -gra m )的局部描述子,将S I FT 中4@4的方形区域改成了仿射状同心圆的17个子区域,每个子区域计

图像处理和识别中的纹理特征和模型

纹理特征和模型 1,基于纹理谱的纹理特征 图像纹理分析中,最重要的问题是提取能够描述纹理的特征信息;这些特征可被用来分类和描述不同的纹理图像。在实际中常用到的方法有结构法和统计法;本文提出一种新的统计方法,每个纹理单元表征该位置及其领域象素的特征,整幅图像的纹理特征用纹理谱来表征,用这种方法进行分析较为简单。 定义纹理谱:纹理单元的频率分布。 基于纹理频谱的纹理特征: 3×3领域:权重: original reference calculate by myself (1)、黑白对称性 ()(3281) 1*100 () s i S i BWS S i ?? -+ ?? ?? =- ?? ?? ?? ∑ ∑ 反映频谱的对称性,不随纹理单元中起始计数位置的不同而不同。 (2)、几何对称性 ()4() 1 1*100 4 2*() Sj i Sj i GS Sj i ?? -+ ?? ?? =- ?? ?? ?? ∑ ∑ ∑ 反映图像旋转180度后,纹理谱的相似性; (3)、方向度

()()11*10062*()Sm i Sn i DD Sm i ?? -?? ??=-?????? ∑∑ ∑ 反映线性结构的角度。大的DD 说明纹理谱对图像的方向模式较为敏感;即图 像中有线性机构纹理单元存在。 以上三个特征都是图像的几何特征,可描述原始图像的宏观纹理;下面介绍几个描述图像微观纹理的特征。 (4)、方向特征 微观水平结构特征: ()*()MHS S i HM i =∑ ()(,,)*(,,)HM i P a b c P f g h = 同样,我们可以得到其它方向的方向纹理特征MVS ,MDS1,MDS2 (5)中心对称性 2()*[()]CS S i K i =∑ 2.常用统计特征: 把图像看成是一个二维随机过程的一次实现,可得到图像的直方图、均值、方差、偏度、峰度、能量、墒、自相关、协方差、惯性矩、绝对值、反差分等特征量。常用来描述纹理的统计特征的技术有子相关函数、功率谱、正交变换、灰度级同时事件、灰度级行程长、灰度级差分、滤波模板、相对极值密度、离散马尔可夫随机场模型、自回归模型、同时自回归模型等。 原图: 1、2、3、4阶矩

轮廓特征和拓扑关系的图像检索方法

902008,44(5)Computer-EngineeringandApplications计算机工程与应用 一种基于轮廓特征和拓扑关系的图像检索方法 曾接贤,毕东格 ZENGJie-xian,BIDong-ge 南昌航空大学无损检测技术教育部重点实验室,南昌330063 KeyLaboratoryofNondestructiveTest,MinistryofEducation,NanchangHangkongUniversity,Nanchang330063,China E-mail:zengjx58@163.com ZENGJie-xian,BIDong-ge.Imageretrievalmethodbasedoncontourcharacterandspatialtopology.ComputerEngi-neeringandApplications,2008。44(5):90-92. Abstract:AnewmethodforCBIRbasedonshapeFourierdescriptorispresented.Thefirststepofthismethodispre-processingtheimage,thencarryingtheimagesegmentationbasedontopologyrelationship,andthenusecontourtrackingmethodtoobtainthecontourfeaturewhichlaterdescribedbyFourierdescriptorusingFFT,atlast,usingblockdistancetomeasurethesimilaritybetweentheoriginalpictureandtargetpicture.Inordertoverifytheeffectivenessofthemethod,weexperimentedunderMATLABandVC++environment.Byseveralexperiments,theresultsshowthatthismethodiseffectiveandalsobyalgorithmanalysis,weconcludethatthemethodisrationalforimageretrieval. Keywords:shapedescribing;Fourierdescriptor;spatialtopology;comparability 摘要:提出了一种利用轮廓特征和拓扑关系的图像检索方法。首先对图像进行预处理,然后根据空间拓扑关系进行区域分割,再对各个区域进行轮廓跟踪,并用傅立叶描述子对所提取区域的轮廓进行描述,最后用街区距离进行相似度的判定。为了验证该算法的有效性,在MATL^.B和VC++环境下进行了实验,通过实验结果和算法分析,证明了该方法的合理性和有效性。 关键词:形状描述;傅立叶描述子;空间拓扑关系;相似度 文章编号:1002—8331(2008)05—0090—03文献标识码:A中图分类号:TP391.3 1引言 在计算机视觉中,形状特征属于图像的中间层特征。形状特征作为刻画图像中物体和区域特点的重要特征,是描述高层视觉特征(如目标、对象等)的重要手段,而目标、对象对获取图像语义尤为重要。利用形状特征进行检索可提高检索的准确性和效率fl】。但是基于形状特征的图像检索,主要存在有四个问题:一是图像分割算法还不能做到自适应;二是形状描述子难于提取[21。三是特征空间的相似性与人视觉系统感受到的相似性也有差别,四是由于视点的变化可能会产生各种失真。所以,基于形状的图像检索还缺乏比较完善的数学模型,目标变形时检索结果也不可靠;另外,要全面描述形状对计算和存储都有较高的要求。 基于空间关系的查询,其主要优点是能比较完整地表达图像各部分的信息,并能比较方便地无示例或用自然语言查询。空间位置关系的特征还可加强对图像内容的描述区分能力t3]。空间关系是图像内部目标的重要特征131,但是如果单独用空间关系描述物体的特征就显得模糊,常常很难用一个确定的表达式描述清楚,它们常由一组互相联系又有矛盾的条件所限定,每个条件在具体情况下得到不同程度的满足。常用的空间关系一般包括朝向关系和拓扑关系,它们都可以通过自然语言来描述。由于空间关系的模糊性,根据空间关系来确定检索对象的相似性是一个复杂的工作。 物体的形状及其空间关系既是图像中的核心内容,也是人们识别图像、分类图像的重要依据。但是目前基于形状和空间关系的图像检索还仅处于研究二值商标图像。在文献【1]提出了.利用小波分解技术的形状和空间关系的图像检索方法,但是小波分解的多分辨率和小波分解的方向性,使得该描述子不具有旋转和尺度变换的不变性。如果检索的图像内容包括运动的物体,则不能得到好的检索结果。 鉴于此,提出了一种基于轮廓特征和拓扑关系的图像检索方法。首先利用空间拓扑关系进行图像分割;然后提取区域轮廓特征,并用傅立叶描述子进行描述;最后再把该描述子应用于基于形状的图像检索中。通过实验验证了该算法的有效性和合理性。 基金项目:国家自然科学基金(theNational‘NaturalScienceFoundationofChinaunderGrantNo.60675022);江西省自然科学基金(theNaturalScienceFoundationofJiangxiProvinceofChinaunderGrantNo.0311019);江西省教育厅资助科研课题(theResearchPmjectofDe一 ● partment ofEducationofJiangxiProvince)。 作者简介:曾接贤(1958一),男,教授,主要从事工程图学、计算机图形学和计算机视觉等方面的研究;毕东格(1981一),女,硕士研究生,主要研究方向为计算机视觉与图像处理。 收稿日期:2007-06—27修回13期:2007—09—07