贝叶斯网络

贝叶斯网络

2007-12-27 15:13

贝叶斯网络

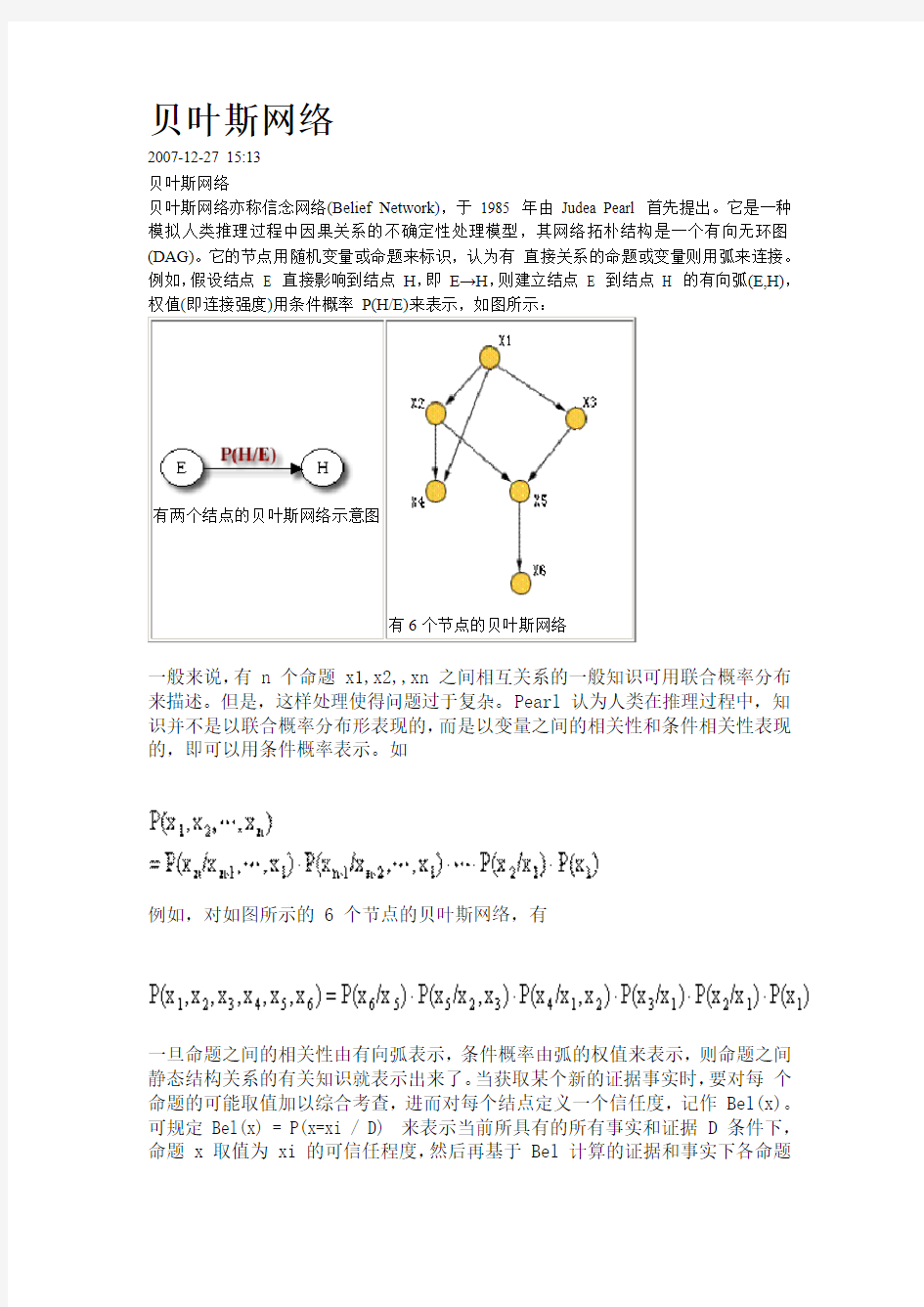

贝叶斯网络亦称信念网络(Belief Network),于1985 年由Judea Pearl 首先提出。它是一种模拟人类推理过程中因果关系的不确定性处理模型,其网络拓朴结构是一个有向无环图(DAG)。它的节点用随机变量或命题来标识,认为有直接关系的命题或变量则用弧来连接。例如,假设结点E 直接影响到结点H,即E→H,则建立结点E 到结点H 的有向弧(E,H),权值(即连接强度)用条件概率P(H/E)来表示,如图所示:

一般来说,有 n 个命题 x1,x2,,xn 之间相互关系的一般知识可用联合概率分布来描述。但是,这样处理使得问题过于复杂。Pearl 认为人类在推理过程中,知识并不是以联合概率分布形表现的,而是以变量之间的相关性和条件相关性表现的,即可以用条件概率表示。如

例如,对如图所示的 6 个节点的贝叶斯网络,有

一旦命题之间的相关性由有向弧表示,条件概率由弧的权值来表示,则命题之间静态结构关系的有关知识就表示出来了。当获取某个新的证据事实时,要对每个命题的可能取值加以综合考查,进而对每个结点定义一个信任度,记作 Bel(x)。可规定 Bel(x) = P(x=xi / D) 来表示当前所具有的所有事实和证据 D 条件下,命题 x 取值为 xi 的可信任程度,然后再基于 Bel 计算的证据和事实下各命题

的可信任程度。

团队作战目标选择

在 Robocode 中,特别在团队作战中。战场上同时存在很多机器人,在你附近的机器人有可能是队友,也有可能是敌人。如何从这些复杂的信息中选择目标机器人,是团队作战的一大问题,当然我们可以人工做一些简单的判断,但是战场的信息是变化的,人工假定的条件并不是都能成立,所以让机器人能自我选择,自我推理出最优目标才是可行之首。而贝叶斯网络在处理概率问题上面有很大的优势。首先,贝叶斯网络在联合概率方面有一个紧凑的表示法,这样比较容易根据一些事例搜索到可能的目标。另一方面,目标选择很容易通过贝叶斯网络建立起模型,而这种模型能依据每个输入变量直接影响到目标选择。

贝叶斯网络是一个具有概率分布的有向弧段(DAG)。它是由节点和有向弧段组成的。节点代表事件或变量,弧段代表节点之间的因果关系或概率关系,而弧段是有向的,不构成回路。下图所示为一个简单的贝叶斯网络模型。它有 5 个节

点和 5 个弧段组成。图中没有输入的 A1 节

点称为根节点,一段弧的起始节点称为其末节点的母节点,而后者称为前者的子节点。

简单的贝叶斯网络模型

贝叶斯网络能够利用简明的图形方式定性地表示事件之间复杂的因果关系或概率关系,在给定某些先验信息后,还可以定量地表示这些关系。网络的拓扑结构通常是根据具体的研究对象和问题来确定的。目前贝叶斯网络的研究热点之一就是如何通过学习自动确定和优化网络的拓扑结构。

变量

由上面贝叶斯网络模型要想得到理想的目标机器人,我们就必须知道需要哪些输入变量。如果想得到最好的结果,就要求我们在 Robocode 中每一个可知的数据块都要模拟为变量。但是如果这样做,在贝叶斯网络结束计算时,我们会得到一个很庞大的完整概率表,而维护如此庞大的概率表将会花费我们很多的系统资源和计算时间。所以在开始之前我们必须要选择最重要的变量输入。这样从比赛中得到的关于敌人的一些有用信息有可能不会出现在贝叶斯网络之内,比如速

度和方向。下面我们列出对选择系统最重要的 6 个变量数据,并用一个 6 维数组保存这些变量值。

1.自身机器人的能量:

机器人的能量是多少。它预计选择的目标敌人的能量和自己的能量相差数。

public double getScore (Enemy e)

{

int a1, a2, a3, a4 = 0, a5 = 0; //初始化每个变量

Vektor mig = new TVektor (robot); //得到自身机器人类

a1 = getEnergyIndex (robot.getEnergy ()); //初始化自身能量变量

mig为自身的机器人类,在上部的反向传播算法部分有说明,getEnergyIndex()为能量的状态值,在下面的状态部分有这个函数的详细说明。

2.敌人的能量:

当我们选择了两个目标时,如果此时我们的能量比较低,我们可以从已知的敌人中选择能量低的机器人作战,这样我们更有赢得胜利的机率。

a2 = getEnergyIndex (e.getEnergy ());

3.敌人的距离:

距离能让我们预防从远处向我们靠近的目标敌人。而且当我们穿过整个战场去攻击敌人,敌我距离也能让我们预防一些潜在的危险。在有效的范围内作出反应。

a3 = getDistanceIndex (mig.substract (new TVektor (e)).getLength ());

4.敌人和它的队友的距离:

在团队战斗中,由于目标机器人过多,我们选择的敌人身边可能有离得很近的对方队友。如果此时我们只是针对选择的敌人作出反应而不考虑其队友将对我们十分不利。所以考虑到敌人与它的队友的距离就变得很重要了。

Enemy[]en = worldmodel.getEnemies (); //得到地图中所有收集到的敌人

mig = new TVektor (e);

double aafstand = Double.MAX_VALUE;

//分析容器类中每个敌人的距离

for (int i = 0; i < en.length; i++) {

double aff = mig.substract (new TVektor (en[i])).getLength ();

if (aff < aafstand && aff > 2)

a4 = getDistanceIndex (aff);

}

5.有多少队友选择了给出的目标:

让队友去攻击同一敌人是一个不错的主意,这样可集中火力消灭敌人。但是,有可能有队友已经选择了目标机器人,如果这时让所有的机器人都去攻击同一个目标对已方是很不利的。所以只有知道有多少队友已经选择了敌人,才能让自己得

到最大的利益。

Teammate[]ttt = worldmodel.getTeammates (); //队友列表

for (int i = 0; i < ttt.length; i++)

//判断队友是否选择目标敌人

if (e.getName ().equals (ttt[i].getEnemy ()))

a5++;

a5 = a5 > 2 ? 2 : a5;

6.胜利或失败:

当机器人战死,我们必须知道是否成功使用了当前的变量设置。此处胜利用 0 表示,失败用 1 表示.

贝叶斯网络设计

由于队友(Friend)变量基本是类似的,所以我们用 Friends_targets 替代其实几个队友变量,即把 Friend{1-4} 移除,这样我们可以大大减少网络的开销。如下图 Fridends-target 代表了所有其他的队友:

减少贝叶斯网络大小

我们用一个 6 维数组保存这些变量,最后把当前战斗情况下的变量加权保存到磁盘文件当中,在使用中通过读取操作从文件中读取。下面是读取变量加权的过程,保存过程与其类似:

private void load () {

int[] a;

dataFile = robot.getDataFile ("-bayesian.dat");

if (dataFile.exists ()) {

while ((a = readLineIn ()) != null) {

data[a[0]][a[1]][a[2]][a[3]][a[4]][a[5]] = a[6];

}

}

else {

int a1, a2, a3, a4, a5, a6;

for (a1 = 0; a1 < data.length; a1++)

for (a2 = 0; a2 < data[a1].length; a2++)

for (a3 = 0; a3 < data[a1][a2].length; a3++)

for (a4 = 0; a4 < data[a1][a2][a3].length; a4++)

for (a5 = 0; a5 < data[a1][a2][a3][a4].length; a5++)

for (a6 = 0; a6 < data[a1][a2][a3][a4][a5].length; a6++)

data[a1][a2][a3][a4][a5][a6]++;

}

}

状态

贝叶斯网络是它是由节点和有向弧段组成的,所以在贝叶斯网络中只有节点是不够的,我们还要知道每个节点的弧段,也即每个可能的输入都要有一个状态。但

是在 Robocode 中给每个变量都设置状态是不可能的,比如我们要给距离这个double 类型的变量构造相应的状态数。每个数字对应一个状态数,这将会生成一个庞大的状态数集数据表,如此巨大的数据表很有可能耗费系统资源。为了解决这个问题,我们把输入变量的范围分成区间,即把连续的问题分成线性问题求解。这样我们就可以基于每个变量区间来构造状态。这些区间变量可被看成是离散化的连续变量。

所以状态问题就转变为区间变量的划分问题,好的区间变量能为网络提供好的目标选择结果。根据上面变量的说明,我们主要是划分好能量、距离以及队友三个变量区间。

能量变量可能的区间范围如下:[0-20]、[21-50]、[51-120]、[121 无穷大]这个方法能区分"常规"机器人中三分之一的能量变量。如果在比赛开始,这个方法还能发现能量为 120 的敌人队长。

private static int getEnergyIndex (double d) {

if (d < 20) return 0;

else if (d < 50) return 1;

else if (d < 120) return 2;

else return 3;

}

此处我们分别用 0,1,2,3 分别表示不同能量区间下的状态。

对于距离变量可能的范围为:[0-100]、[101-300]、[301-700]、[701-1200]、[1201 无穷大]。这能让机器人区分其他机器人是很近,刚刚在雷达范围内还是在雷达之外。这个变量对雷达的扫描范围很重要,因为只有能扫描到的机器人才能更好的选择。

private static int getDistanceIndex (double d) {

if (d < 100) return 0;

else if (d < 300) return 1;

else if (d < 700) return 2;

else if (d < 1200) return 3;

else return 4;

}

现在我们看看 Friend 变量的状态如何指定?从直观上来看,队友包括如下的一些状态:没有目标(No target)、死亡(Dead)、同一目标(Same target)、另一目标(Another target)。但是在真正使用当中,我们并不需要知道队友是死亡还是有没有目标,我们只要知道队友是否同时选择的同一目标。这样,我们把"多少队友选择了给出的目标"变量状态设为 0,1,2 三种状态,0 表示没有队友选择目标,1 表示有一个队友选择了目标,2 表示有 2 个或 2 个以上的了队友选择了目标。

最后只剩下"胜利或失败"变量的状态了,由上面的变量说明我们知道"胜利或失败"变量只有两种状态,0 表示胜利,1 表示失败。

知道了所有变量的状态,相当于我们知道了这些变量的维数空间,这样我们在最初变量的初始化过程中,就可按变量的状态指定变量大小。

public class TargetSelection {

//分别设定各变量的维数空间大小

private int[][][][][][] data = new int[4][4][5][5][3][2];

为了更新贝叶斯网络我们要知道如何判断选择的目标是好的还是坏的。其实判断标准很简单:如果选择的目标在我们之前死去,这个选择就是好的;如果我们在目标这前死去,这个选择就是不好的。

贝叶斯公式与目标选择实现

贝叶斯网络是一种概率网络,它是基于概率推理的图形化网络,而贝叶斯公式则

是这个概率网络的基础。让我们先来看一看贝叶斯基本公式,设、是两个

事件,且,则贝叶斯公式如下:

目标变量有两种状态,一种表示打赢了当前选择的目标,另一种表示失败。所以我们不需要存储其他所有变量的概率,只要在网络更新时存储下面三个整数就能得出选择的最高概率:

我们给出一个变量参数 (s)所用的时间数;在这个配置下赢得(nwin)战斗的时间数,我们失败的时间数(nlost)。这样我们就可求得胜利的概率是(nwin)/s,失败的概率是 (nlost)/s.

从上面贝叶斯公式的定义我们推理得到 (nwin)/s+(nlost)/s=1

==>(nwin+nlost)/s=1==>nwin+nlost=s,这意味着我们不需要存储特定的变量参数 s,只要存储每个设置的胜利和失败数,这样赢的概率就是(nwin)/s=(nwin)/ (nwin+nlost)。

//根据给出的参数求胜利的概率

public double getScore (int a1, int a2, int a3, int a4, int a5) { return (((double) data[a1][a2][a3][a4][a5][0]) /

(double) (data[a1][a2][a3][a4][a5][0] +

data[a1][a2][a3][a4][a5][1]));

}

更新网络

最后一步我们要做的就是更新贝叶斯网络。这是在 robocode 平台运行时执行的。输出变量是机器人可能胜利而选择的 Target。当选择一个目标,机器人本身关于敌人和状态信息将被保存直到敌人或自身死亡,贝叶斯网络因此能被更

新。从上面的贝叶斯网络原理每时刻一个正的示例将会产生,而且可能的选择目标变量增加。

//在机器人死亡事件中更新贝叶斯网络

public void robotDead (String rb) {

private static TargetSelection ts = null;

if (robot.getName ().equals (rb) || rb.equals (valgt.getName ())) { ts.learn (myenergy, valgt.getEnergy (), afstand, aafstand,

antalPaaHam, robot.getName ().equals (rb));

ts.save ();

}

}

//根据给出的参数加权选择目标

public void learn (double a1, double a2, double a3, double a4, int a5, boolean won) {

data[getEnergyIndex (a1)][getEnergyIndex (a2)][getDistanceIndex (a3)]

[getDistanceIndex (a4)][a5][won ? 0 : 1]++;

}

神经网络Java公共包(Neural Networks Management Library)

神经网络具有以下特性:具有很强的容错性,这是因为信息是分布存贮于网络内的神经元中;并行处理方法,人工神经元网络在结构上是并行的,而且网络的各个单元可以同时进行类似的处理过程,使得计算快速;自学习、自组织、自适应性,神经元之间的连接多种多样,各元之间联接强度具有一定可塑性,使得神经网络可以处理不确定或不知道的系统;可以充分逼近任意复杂的非线性关系;具有很强的信息综合能力,能同时处理定量和定性的信息,能很好的协调多种输入信息关系,适用于处理复杂非线性和不确定对象。

这些特性很容易让我们把神经网络封装为一公共应用包以隐藏神经网络内在特性,而使用者只要调用这些公共包就可完成神经网络算法的实现。NNLibrary 就是这样的一种 Java 包。

NNLibrary结构与定义

NNLibrary类库名又名 nrlibj,它能帮助我们更好的定义和管理一个简单的人工神经网络。神经网络其实就是用不同方法计算各个连接节点的体系结构。所以本神经网络包用通用的节点计算方法定义了一个通用的框架。在本包设计中把神经网络建立在各层之上,这样只要我们想,我们可以建立任意多的层。每一层都是以一个从 0 开始的累加数字来表示,所有的这些数字都按一定的顺序排列。包中一部分神经网络函数是正向函数,能计算 0 层到最后一个层这样的顺序排列的层内的每一节点。另一部分函数是反向传播误差函数,能处理节点反向传播误差值。

虽然本包允许定义一个再循环的连接。但是由于神经网络是一个前馈循环,在循环中每层只能计算一次。要想再次使用连接,我们必须重新开始循环,如前馈函数 frwNNet():它能关联一个缓冲到层中。这个缓冲是另一个层,当在这层计算节点时,它会把一个输出值推入到此层的输入变量中。这样缓冲层就可使用这个

值。如果此层的顺序数小于整个缓冲的层,将在下一个循环计算这些推入的值,缓冲在此时将作为一个内存存在层中。如果缓冲小于或大于缓冲层对象中定义的节点数,这个函数还能计算同一层的横向连接关系。

这个公共包不仅能定义同一层中不同的连接,一层中不同的节点群的连接,而且能定义 N 到 N 的连接或 1 到 1 的连接,或者定义一个二维层。

NN 应用示例

本例我们将用 NN 库实现异或(XOR)函数的进化。XOR 函数如下表有每个对应的点都有两个输入值和一个输出值。

0 0 -> 0 ;1 0 -> 1;0 1 -> 1;1 1 -> 0

为了方便操作,我们在这只计算带有两个输入节点,两个隐藏节点和一个输出节点的神经网络。

import nrlib50.*; //引入神经网络公共包

import java.io.*;

import https://www.360docs.net/doc/348107585.html,ng.*;

import java.util.*;

/*

类Tlex由一个main主函数和evoClicle,newPop两个子函数组成。

本程序进化100个异或神经网络,每个神经网络根据输入、隐藏、输出分为三层:第一层两个节点,第二层两个节点,第三层一个节点

*/

public class T1ex {

static String train[]= // 初始化XOR 表结构

{"0 0 0", "1 0 1", "0 1 1", "1 1 0"};

//网络群体数组描述

static String PopNNdescr[]=

{"net=1,100", //定义100个网络点

//定义各层的层数、节点以及类名称

"layer=0 tnode=2 nname=NodeLin",

"layer=1 tnode=2 nname=NodeSigm",

"layer=2 tnode=1 nname=NodeSigm",

"linktype=all fromlayer=0 tolayer=1", //连接第一层和隐藏层

"linktype=all fromlayer=1 tolayer=2"}; //连接隐藏层和最后一层

static NrPop pop; //实例化网络群

static int gn=300; // 定义进化后代为300

static int pn; // 定义神经网络群缓冲器

static int nfathers;

public static void main(String[] args) {

int g; //后代计数器

NrPop.setSeed(0); //给每个种子设置随机后代

//创建种群,这里也可用简单的方法pop= new NrPop(100,2,2,1,false)

pop= new NrPop(PopNNdescr);

pn=pop.PopSize();

nfathers=(int)(pn*0.1); //定义父比例为10%

pop.fitInit(); //创建一个适应度数组

//循环处理下一代

for (g=1;g<=gn;g++) {

evoCicle(train); //群体循环处理函数

pop.fitRankingMin(); //把适合度数组按最小平方差排序

newPop(); //通过复制和变异产生下一代

pop.nrPopSave("NnetXorTrained.nnt");//保存训练后的种群

try {System.in.read();} catch (IOException e){}

}

/**********************群体循环处理

*****************************************/

static void evoCicle(String train[]) {

int i;

float fitnet;

NNet net;

for (i=1;i<=pn;i++) {

net=pop.getNNet(i);

fitnet=net.testNNet(train); //测试网络并输入调整误差到适合度中

pop.fitSet(i,fitnet); //输入适合度到数组当中

}

}

/***********产生新一代*******************/

static void newPop() {

int i;

NNet netfrom,netto;

//把后代中的适合度按顺序排列

for (i=nfathers+1;i<=pn;i++) {

netfrom=pop.fitGetNetAtPos(NrPop.riab(1,nfathers)); //产生随机父代

netto=pop.fitGetNetAtPos(i); //产生子代 netfrom.copyWNNet(netto); //复制父代到子代

netto.wgtmutNNet((float)0.05,false); //高斯变异值为0.05 }

}}

应用神经网络的 Robocode 例子机器人分析

在 Robocode 的仓库中(Robcode仓库),来自世界各地的 Robocode 发明和创造了很多有意思的机器人例子,其中就不缺神经网络的应用机器人例子。比如:Albert 的 ScruchiPu 和TheBrainPi机器人。PEZ 的OrcaM机器人,Synnalagama 的NeuralPremier和MiniNeural机器人,Krabb 的Fe4r机器人,WCSV 的Engineer机器人,这些都或多或少利用了神经网络的相关知道设计自己的机器人,而且这些机器人都比较短小但威力却很强大。

大家可以直接点击机器人链接下载这些机器人,在测试中你会发现这些机器人大部分都是在瞄准攻击系统中使用了神经网络。也由此我们更可以看出瞄准攻击的特性是完全适合神经网络的应用的。

PEZ 的 OrcaM 机器人,Albert 的 ScruchiPu 和 TheBrainPi 机器人,Synnalagama 的 NeuralPremier 都利用了神经网络公共包 nrlibj。下面我们以Albert 的开源神经网络机器人 ScruchiPu 为例来看看这些机器人是如何利用公共神经网络包 nrlibj?如何在瞄准攻击系统中用上神经网络的?注意此代码省略了很多与神经网络无关的定义,完整代码请直接点机器人链接下载。

import apv.nrlibj.NNet;

/** ScruchiPu - by Albert **/

public class ScruchiPu extends AdvancedRobot {

//定义各层的层数、节点以及类名称,这里共定义了四层

static String NNdescr[]=

{"layer=0 tnode=80 nname=NodeLin", //第一层 80个节点

"layer=1 tnode=10 nname=NodeSigm", //二层10个节点

"layer=2 tnode=5 nname=NodeSigm", //三层5个节点

"layer=3 tnode=2 nname=NodeSigm", //四层2个节点

"linktype=all fromlayer=0 tolayer=1", //连接第一层和第二层

"linktype=all fromlayer=1 tolayer=2",

"linktype=all fromlayer=2 tolayer=3"};

…//神经网络学习过程

public void learn(NNet network, int n) {

float[] input = buildInput(n-1);

float[] output = buildOutput(n-1);

if (input != null && output !=null) {

network.ebplearnNNet(input,output); }

}

//瞄准系统设置

public double aim(NNet network) {

double x = getX() + Math.sin(targetBearing)*eGetDistance;

double y = getY() + Math.cos(targetBearing)*eGetDistance;

double ah = lastHeading;

int time = 0;

int match = n;

float[] output = new float[2];

double vel = 0;

//在子弹到达敌人未来位置之前调整攻击角度

while ((time * (20.0 - 3.0 * power)) <

Point2D.distance(getX(),getY(),x,y))

{

float[] input = buildInput(n+time);

//利用前馈函数设置输入、输出值

if (input != null) network.frwNNet(input,output);

else { output[0] = 0; output[1] = 0; }

vel = Math.max(-8,Math.min(8,(output[0]-0.5)*VOUT_SF));

if (vel - ev[n+time] > 2) vel = ev[n+time] + 2;

if (ev[n+time] - vel > 2) vel = ev[n+time] - 2;

x+=Math.sin(ah)*vel; //调整x值

x = Math.max(18,Math.min(getBattleFieldWidth()-18,x));

y+=Math.cos(ah)*vel; //调整y值

y = Math.max(18,Math.min(getBattleFieldHeight()-18,y)); ev[n+time+1] = vel;

double hed =

Math.max(-(0.17453293-0.01308997*Math.abs(vel)),

Math.min(0.17453293-0.01308997*Math.abs(vel),

(output[1]-0.5)*HOUT_SF));

ah += hed;

eh[n+time+1] = hed;

time++;

}

return Math.atan2(x-getX(),y-getY()); //返回调整后的攻击角度

}

//构造输出N+1的输入N

public float[] buildInput(int n) {

if (n else { float[] input = new float[embed*2]; for (int i=0; i input[2*i] = (float) (ev[n-i*delay]/VIN_SF); input[2*i+1] = (float) (eh[n-i*delay]/HIN_SF); } return input; } } Synnalagama 更在这个公式神经网络包 nrlibj 上设计一个简化版的神经网络包 Neuralib 用于自己的小型神经网络机器人 MiniNeural。Neuralib 由两个类组成:NeuralNetwork,NeuronLayer。 package synnalagma.test.neuralib; /* @author Synnalagma */ public class NeuralNetwork implements java.io.Serializable { private NeuronLayer[] layers; //设置新层 //创建一个神经网络对象,初始化各层 public NeuralNetwork(int[] network) { layers = new NeuronLayer[network.length - 1]; for(int i = 0; i < https://www.360docs.net/doc/348107585.html,yers.length; i++) { layers[i] = new NeuronLayer(network[i], network[i + 1]); } } //从输入值得到输出 public double[] forwardPass(double[] input) { for(int i = 0; i < https://www.360docs.net/doc/348107585.html,yers.length; i++) { input = layers[i].getOutput(input); } return input; } //以 public void train(double[] input, double[] output) { input = this.forwardPass(input); for(int i = 0; i < input.length; i++) { input[i] = (output[i] - input[i]) * input[i] * (1 - input[i]); } for(int i = https://www.360docs.net/doc/348107585.html,yers.length - 1; i > -1; i--) { input = layers[i].propagate(input); }}} 处理各层节点及输入、输出 package synnalagma.test.neuralib; public class NeuronLayer implements java.io.Serializable { //transient private double learningRate = 0.3, momentum=0.3; private int in; //输入层的大小 private int out; //输出层大小 private transient double[] output; //输出层缓冲器 private transient double[] input; //输入层缓冲器 private double[][] weight; //加权二维数组 private transient double[][] lastWeightChange; //改变后的加权数组 public NeuronLayer(int in, int out) { this.in = in; this.out = out; this.input = new double[in]; output = new double[out]; https://www.360docs.net/doc/348107585.html,stWeightChange = new double[in + 1][out]; weight = new double[in + 1][out]; for(int i = 0; i <= in; i++) { for(int o = 0; o < out; o++) { weight[i][o] = Math.random() - 0.5; } } } //得到层的输出 public double[] getOutput(double[] inp) { //直接复制反向传播数据 System.arraycopy(inp, 0, this.input, 0, in); for(int o = 0; o < out; o++) { this.output[o] = 0; //加权计算输出 for(int i = 0; i <= in; i++) { output[o] += (weight[i][o] * ((i == in) ? 1 : input[i])); } output[o] = 1.0 / (1.0 + Math.exp(-output[o])); //神经网络公式计算 } return (double[])output.clone() } //反向传播方法,error为误差变量 public double[] propagate(double[] error) { double[] deltaE = new double[out], delta= new double[in]; //改变加权数 for(int o = 0; o < out; o++) { deltaE[o] = error[o] * (output[o] * (1 - output[o])); for(int i = 0; i <= in; i++) { weight[i][o]+=(https://www.360docs.net/doc/348107585.html,stWeightChange[i][o]*0.3) weight[i][o]+= (https://www.360docs.net/doc/348107585.html,stWeightChange[i][o] = 0.3 * deltaE[o] * ((i == in) ? 1 : input[i])) //检查误差偏离 } } //利用delta训练法则计算误差 for(int i = 0; i < in; i++) { for(int o = 0; o < out; o++) { delta[i] += (deltaE[o] * weight[i][o]); } } } AI-CODE体系结构和编程接口 在本人前两篇强化学习和遗传算法学习坦克机器人的文章中提及到了AI-CODE, 收到很多读者来信,特别是一些非 Java 程序员,很想有一个类似于 Robocode 的工具在 C,C++ 等语言下学习相关的人工智能知识。在此基础上,下文给出了AI-CODE 的一体系结构以及它多语言编程接口实现原理,以方便大家更多的了解这个工具和程序的移植。以移植本文的 Java 智能机器人代码到 AI-CODE 平台上。由于 AI-CODE 是国内的产品,所以中文文档支持很好,如想了解更多,大家可以到(https://www.360docs.net/doc/348107585.html,)上查看相关的文章。 AI-CODE 是集虚拟机器人运行平台、机器人程序图形编辑器、机器人程序代码编辑器于一体的软件系统。下面是它的体系结构。 AI-CODE内部框架 在 AI-CODE 中,机器人程序作为一个单独的程序运行,机器人程序与 AIRobot 运行平台之间通过 socket 建立连接,数据以 XML 的形式在 AIRobot 运行平台和机器人程序之间传输。从理论上说,只要能够建立 socket 连接,解析 XML 数据的编程语言,就可以用来编写机器人程序。 在机器人的一个运行周期中,首先是 AIRobot 将比赛信息发送给机器人,这些信息包括所有机器人的状态(如坐标,运动速度)、当前所发生的事件(各种Action 处理函数)、比赛场地的大小等。机器人程序接收到这些信息后,经过对这些数据的分析和处理,就可以依据分析的结果来控制机器人运动。在下达机器人控制命令后,机器人程序将把这些命令发送给 AIRobot,AIRobot 将根据这些命令来更新比赛信息,控制比赛的过程。整个比赛的过程就是连续的由这样的运行周期组成。 机器人程序是一个独立运行的应用程序,这个程序实际上是由两部分代码组成的,一部分是适配器代码,另一部分是用户代码。用户代码的主要功能就是控制机器人的运动,这也是编程的焦点。适配器代码对用户来说是透明的,它向用户隐藏了机器人程序和 AIRobot 交互的细节,并对用户代码呈现一个简单的编程接口,这部分代码有以下的几个重要的功能: 通过 socket 和 AIROBOT 建立连接。 接收AIRobot 发送过来的比赛信息,并对其进行解析:将XML 形式的数据转换为用户代码容易使用的形式,如Java,C++ 中的对象。 ?调度用户代码的运行:根据当前的Action,触发用户代码的Action 处理函数。 ?对用户代码设置的机器人控制命令加以编码:将命令转换为XML 形式,并将其发送给AIRobot。 用户代码必须和适配器代码连接在一起,才能生成一个完整的应用程序。拿 C++ 机器人程序来说,适配器代码以".lib"的形式存放在 c/lib 下,系统为不同的编译器提供了相应的版本,在创建机器人程序的时候,就要和这些 .lib 进行连接。 数据传输 数据以 XML 的形式(UTF-8编码)在 AIRobot 运行平台和机器人程序之间传输,这个过程是通过对 socket 进行读写来完成的。实际上 XML 数据就是一种有着特殊格式的字符串,在 AIRobot 和机器人之间的数据传输就是通过 socket 传输字符串数据。在一般情况下,socket 都会提供读写字节的操作,字符串数据可以通过字节数组的形式在 socket 上传输。下面将介绍 AIRobot 和机器人在传输数据时的约定。 在接收字符串的时候: 1.读入字符串的长度。这个长度描述了字符串数据所占的字节数。这个长度占用两个字节,通过 socket 提供的读字节操作读出这两个字节,假设第一个字节为a,第二个字节为 b,那么这个长度的计算公式为 length=(((a & 0xff) << 8) | (b & 0xff))。注意,这个长度只是描述了字符串的长度,它并不属于字符串的内容。 2.读入字符串数据。根据字符串的长度 length,从 socket 中读入 length 字节的数据,这些数据就是我们真正需要的XML数据。这个过程用伪代码实现就像是这样: /* 从socket中读入一个字符串 */ String readString(Socket socket){ byte a = socket.readByte(); //读入第一个字节 byte b = socket.readByte(); //读入第二个字节 int length = (((a & 0xff) << 8) | (b & 0xff)); //计算字符串长度 byte[] strbuff = new byte[length]; //创建用于存放字符串数据的缓存socket.readBytes(strbuff, length); //将字符串数据读入缓存中(length个字节) return new String(strbuff); //将缓存中的内容作为一个字符串返回 } 在发送字符串的时候: 1.写入字符串的长度。这个长度占用两个字节,假设字符串的长度为 length,那么要写入的第一个字节 a=(byte)(0xff & (length >> 8)),第二个字节 b=(byte)(0xff & length)。 2.写入字符串数据。将字符串作为字节数组写入 socket。 这个过程用伪代码实现就像是这样: /* 将一个字符串string写入socket */ void readString(Socket socket, String string){ int length = string.length(); //字符串的长度 byte a = (byte)(0xff & (length >> 8)); //计算要写入的第一个字节 byte b = (byte)(0xff & length); //计算要写入的第二个字节 socket.writeByte(a); //写入长度的第一个字节 socket.writeByte(b); //写入长度的第二个字节 byte[] strbuff = string.toBytes(); //将字符串转换为字节数组 socket.writeBytes(strbuff, length); //写入字符串数据(length个字节)} 从上面的细节中我们可以看到,读写字符串的操作是相对的。对于这两个操作,不同的语言有不同的实现,具体细节和语言提供的 socket 和字符串实现有关。在 C++ 机器人适配器代码中,commons/NetTransporter.hpp 中定义的类NetTransporter 实现了这两个操作(readString,writeString),大家可以作为参考。 通过以上的分析我们可以看到,适配器代码对 Robot 隐藏了机器人程序和AIROBOT 交互的细节,并以抽象类的形式对其呈现一个简单的编程接口。在对机器人编程的过程中,用户只需实现自己的 Action 处理函数就够了。 贝叶斯网络 一.简介 贝叶斯网络又称信度网络,是Bayes方法的扩展,目前不确定知识表达和推理领域最有效的理论模型之一。从1988年由Pearl提出后,已知成为近几年来研究的热点.。一个贝叶斯网络是一个有向无环图(Directed Acyclic Graph,DAG),由代表变量节点及连接这些节点有向边构成。节点代表随机变量,节点间的有向边代表了节点间的互相关系(由父节点指向其后代节点),用条件概率进行表达关系强度,没有父节点的用先验概率进行信息表达。节点变量可以是任何问题的抽象,如:测试值,观测现象,意见征询等。适用于表达和分析不确定性和概率性的事件,应用于有条件地依赖多种控制因素的决策,可以从不完全、不精确或不确定的知识或信息中做出推理。 二. 贝叶斯网络建造 贝叶斯网络的建造是一个复杂的任务,需要知识工程师和领域专家的参与。在实际中可能是反复交叉进行而不断完善的。面向设备故障诊断应用的贝叶斯网络的建造所需要的信息来自多种渠道,如设备手册,生产过程,测试过程,维修资料以及专家经验等。首先将设备故障分为各个相互独立且完全包含的类别(各故障类别至少应该具有可以区分的界限),然后对各个故障类别分别建造贝叶斯网络模型,需要注意的是诊断模型只在发生故障时启动,因此无需对设备正常状态建模。通常设备故障由一个或几个原因造成的,这些原因又可能由一个或几个更低层次的原因造成。建立起网络的节点关系后,还需要进行概率估计。具体方法是假设在某故障原 因出现的情况下,估计该故障原因的各个节点的条件概率,这种局部化概率估计的方法可以大大提高效率。 三. 贝叶斯网络有如下特性 1. 贝叶斯网络本身是一种不定性因果关联模型。贝叶斯网络与其他决策模型不同,它本身是将多元知识图解可视化的一种概率知识表达与推理模型,更为贴切地蕴含了网络节点变量之间的因果关系及条件相关关系。 2. 贝叶斯网络具有强大的不确定性问题处理能力。贝叶斯网络用条件概率表达各个信息要素之间的相关关系,能在有限的,不完整的,不确定的信息条件下进行学习和推理。 3. 贝叶斯网络能有效地进行多源信息表达与融合。贝叶斯网络可将故障诊断与维修决策相关的各种信息纳入网络结构中,按节点的方式统一进行处理,能有效地按信息的相关关系进行融合。 目前对于贝叶斯网络推理研究中提出了多种近似推理算法,主要分为两大类:基于仿真方法和基于搜索的方法。在故障诊断领域里就我们水电仿真而言,往往故障概率很小,所以一般采用搜索推理算法较适合。就一个实例而言,首先要分析使用那种算法模型: a.)如果该实例节点信度网络是简单的有向图结构,它的节点数目少的情况下,采用贝叶斯网络的精确推理,它包含多树传播算法,团树传播算法,图约减算法,针对实例事件进行选择恰当的算法; b.)如果是该实例所画出节点图形结构复杂且节点数目多,我们可采用近似推理算法去研究,具体实施起来最好能把复杂庞大的网络进行化简,然后在与精确推理相结合来考虑。 Computer Science and Application 计算机科学与应用, 2020, 10(3), 493-504 Published Online March 2020 in Hans. https://www.360docs.net/doc/348107585.html,/journal/csa https://https://www.360docs.net/doc/348107585.html,/10.12677/csa.2020.103052 The Bibliometric Analysis of Current Studies and Developing Trends on Bayesian Network Research Zhongzheng Xiao1, Nurbol2, Hongyang Liu3 1College of Information Science and Engineering, Xinjiang University, Urumqi Xinjiang 2Network Center, Xinjiang University, Urumqi Xinjiang 3Xichang Satellite Launch Center, Xichang Sichuan Received: Feb. 26th, 2020; accepted: Mar. 12th, 2020; published: Mar. 19th, 2020 Abstract In this paper, 2,930 literatures related to Bayesian network in the recent 10 years in the web of science were taken as the research object. Based on the literature metrological content analysis method, the focus, development rules of research context, existing commonalities and differences, and research status at home and abroad were systematically reviewed. The study found that, as of now, especially in the prevalence of neural networks, Bayesian networks can be deepened and have great potential because of their strong mathematical interpretability. The analysis results are helpful to provide reference for the research status and progress of scholars in the field of Bayesian network research in China. Keywords Bayesian Network, Map Analysis, Citespace, Research Context 贝叶斯网络研究现状与发展趋势的文献计量 分析 肖中正1,努尔布力2,刘宏阳3 1新疆大学信息科学与工程学院,新疆乌鲁木齐 2新疆大学网络中心,新疆乌鲁木齐 3西昌卫星发射中心,四川西昌 收稿日期:2020年2月26日;录用日期:2020年3月12日;发布日期:2020年3月19日 1.选题:本课题国内外研究现状述评,提出选题的背景及意义。 2.目标与内容: 本课题研究拟完成的研究目标和主要研究内容,研究内容要对?拟解决的问题进行具体化。3、研究思路与方法:本课题研究的技术路线、方法和计划。4.预期价值:本课题理论创新程度和实践应用价值。(课题设计论证限3000字以内) 一直以来如何有效的提高学生的学习效率和教师的教学效率不断的得到大量的研究,近二十年以来,随着计算机信息技术和互联网应用的飞速发展,在教育心理学中正在发生着一场革命,应用建构主义的学习理论(Slavin, 1994)来指导改革教学成为一大趋势。建构主义学习理论从“学习的含义”(即关于“什么是学习”)与“学习的方法”(即关于“如何进行学习”)这两个角度说明学习的影响因素及提高学习效率的方法,建构主义学习理论认为学习是在一定的基础知识之上,在一定的情境即社会文化背景下,借助其他人的帮助即通过人际间的协作活动而实现的意义建构过程。“情境”、“协作”、“会话”和“意义建构”是学习环境中的四大要素或四大属性。所谓“情境”即是学习的综合环境;“协作”: 指学习中与他人的沟通与合作;“会话”:学习小组成员之间通过会话商讨如何完成规定的学习任务的计划;“意义建构”:建构事物的性质、规律以及事物之间的内在联系,是整个学习过程的最终目标。建构主义的学生观、教师观和知识观和以往的学习理论有了很大的变化,应用建构主义学习理论来提高教学效率正成为当前的研究热点,但目前的研究多从学习的方法论和学习技术本身入手,考虑学生的具体群体的学习特点较少,不能很好的有的放矢,在分析学生的学习影响因素时多直接用常规的数理统计理论进行分析与讨论,而实际上影响学生的学习因素是相当复杂与繁多的,而且学习因素之间W能存在相互的因果关系,而这种因果关系有时往往不知道,因素之间的影响到底多大,定量的关系不明确,甚至可能有很多隐藏的因素在起作用,发现学习的各种影响因素及其因果关系与比重,以及它们的变化分布规律对我们找出主要因素从而正确指导教学以及设计调查问卷摸查学生的学习基础与学习特点对教师的教学设计和提高教学效率具有重要意义,目前对此的研究还比较少。 贝叶斯网络又称信度网络,是Bayes方法的扩展,是目前不确定知识表达和推理领域最有效的理论模型之一。自1988年由Pearl提出后,己知成为近几年来研究的热点一般的贝叶斯网络结构是一个有向无环图(Directed Acyclic Graph,DAG),如图1所示,由代表变量节点及连接这些节点有向边构成。节点代表随机变量,节点间的有向边代表了节点间的互相关系(由父节点指向其后代节点),用条件概率进行表达关系强度,没有父节点的用先验概率进行信息表达, 节点变量可以是任何问题的抽象(如知识表达),适用于表达和分析不确定性和概率性的事件,可以从不完全、不精确或不确定的知识或信息中做出推理。贝叶斯网络本身是一种不确定性因果关联模型,贝叶斯网络与其他决策模型不同,它本身是将多元知识图解可视化为一种概率知识表近与推理模型,更为贴切地蕴含了网络节点,变量之间的因果关系及条件相关关系,如果节点表达为学习因素, 摘要: 本文主要介绍了贝叶斯网的基本概念以及重要性抽样方法的基本理论和概率推理, 重点介绍了两种重要的抽样方法, 即逻辑抽样方法和似然加权法, 并且比较了它们的优缺点 关键词: 贝叶斯网 抽样法 无偏估计 1.引言 英国学者T.贝叶斯1763年在《论有关机遇问题的求解》中提出一种归纳推理的理论, 后被一些统计学者发展为一种系统的统计推断方法, 称为贝叶斯方法.采用这种方法作统计推断所得的全部结果, 构成贝叶斯统计的内容.认为贝叶斯方法是唯一合理的统计推断方法的统计学者, 组成数理统计学中的贝叶斯学派, 其形成可追溯到 20世纪 30 年代.到50~60年代, 已发展为一个有影响的学派.Zhang 和Poole 首先提出了变量消元法, 其原理自关于不定序动态规划的研究(Bertele and Brioschi,1972).相近的工作包括D`Ambrosio (1991)、Shachter (1994)、Shenoy (1992)等人的研究.近期关于变量消元法的研究可参见有关文献【1】由于变量消元法不考虑步骤共享, 故引进了团树传播法, 如Hugin 方法.在实际应用中, 网络节点往往是众多的, 精确推理算法是不适用的, 因而近似推理有了进一步的发展. 重要性抽样法(Rubinstein, 1981)是蒙特尔洛积分中降低方差的一种手段, Henrion (1988)提出了逻辑抽样, 它是最简单也是最先被用于贝叶斯网近似推理的重要性抽样算法. Fung 和Chang (1989)、Shachter 和Peot (1989)同时提出了似然加权算法. Shachter 和Peot (1989)还提出了自重要性抽样和启发式重要性抽样算法. Fung 和Favero (1994)提出了逆序抽样(backward sam-pling ), 它也是重要性抽样的一个特例. Cheng 和Druzdzel (2000)提出了自适应重要性抽样算法, 同时也给出了重要性抽样算法的通用框架, 这就是各种抽样方法的发展状况. 本文就近似推理阐述了两种重要的抽样方法即逻辑抽样方法和似然加权法, 并比较了它们的优缺点. 2. 基本概念 2.1 贝叶斯网络的基本概念 贝叶斯网络是一种概率网络, 用来表示变量之间的依赖关系, 是带有概率分布标注的有向无环图, 能够图形化地表示一组变量间的联合概率分布函数. 贝叶斯网络模型结构由随机变量(可以是离散或连续)集组成的网络节点, 具有因果关系的网络节点对的有向边集合和用条件概率分布表示节点之间的影响等组成.其中节点表示了随机变量, 是对过程、事件、状态等实体的某些特征的描述; 边则表示变量间的概率依赖关系.起因的假设和结果的数据均用节点表示, 各变量之间的因果关系由节点之间的有向边表示, 一个变量影响到另一个变量的程度用数字编码形式描述.因此贝叶斯网络可以将现实世界的各种状态或变量画成各种比例, 进行建模. 2.2重要性抽样法基本理论 设()f X 是一组变量X 在其定义域n X R Ω?上的可积函数.考虑积分 ()()X I f X d X Ω= ? (2.2.1) 贝叶斯网络 2007-12-27 15:13 贝叶斯网络 贝叶斯网络亦称信念网络(Belief Network),于1985 年由Judea Pearl 首先提出。它是一种模拟人类推理过程中因果关系的不确定性处理模型,其网络拓朴结构是一个有向无环图(DAG)。它的节点用随机变量或命题来标识,认为有直接关系的命题或变量则用弧来连接。例如,假设结点E 直接影响到结点H,即E→H,则建立结点E 到结点H 的有向弧(E,H),权值(即连接强度)用条件概率P(H/E)来表示,如图所示: 一般来说,有 n 个命题 x1,x2,,xn 之间相互关系的一般知识可用联合概率分布来描述。但是,这样处理使得问题过于复杂。Pearl 认为人类在推理过程中,知识并不是以联合概率分布形表现的,而是以变量之间的相关性和条件相关性表现的,即可以用条件概率表示。如 例如,对如图所示的 6 个节点的贝叶斯网络,有 一旦命题之间的相关性由有向弧表示,条件概率由弧的权值来表示,则命题之间静态结构关系的有关知识就表示出来了。当获取某个新的证据事实时,要对每个命题的可能取值加以综合考查,进而对每个结点定义一个信任度,记作 Bel(x)。可规定 Bel(x) = P(x=xi / D) 来表示当前所具有的所有事实和证据 D 条件下,命题 x 取值为 xi 的可信任程度,然后再基于 Bel 计算的证据和事实下各命题 的可信任程度。 团队作战目标选择 在 Robocode 中,特别在团队作战中。战场上同时存在很多机器人,在你附近的机器人有可能是队友,也有可能是敌人。如何从这些复杂的信息中选择目标机器人,是团队作战的一大问题,当然我们可以人工做一些简单的判断,但是战场的信息是变化的,人工假定的条件并不是都能成立,所以让机器人能自我选择,自我推理出最优目标才是可行之首。而贝叶斯网络在处理概率问题上面有很大的优势。首先,贝叶斯网络在联合概率方面有一个紧凑的表示法,这样比较容易根据一些事例搜索到可能的目标。另一方面,目标选择很容易通过贝叶斯网络建立起模型,而这种模型能依据每个输入变量直接影响到目标选择。 贝叶斯网络是一个具有概率分布的有向弧段(DAG)。它是由节点和有向弧段组成的。节点代表事件或变量,弧段代表节点之间的因果关系或概率关系,而弧段是有向的,不构成回路。下图所示为一个简单的贝叶斯网络模型。它有 5 个节 点和 5 个弧段组成。图中没有输入的 A1 节 点称为根节点,一段弧的起始节点称为其末节点的母节点,而后者称为前者的子节点。 简单的贝叶斯网络模型 贝叶斯网络能够利用简明的图形方式定性地表示事件之间复杂的因果关系或概率关系,在给定某些先验信息后,还可以定量地表示这些关系。网络的拓扑结构通常是根据具体的研究对象和问题来确定的。目前贝叶斯网络的研究热点之一就是如何通过学习自动确定和优化网络的拓扑结构。 变量 由上面贝叶斯网络模型要想得到理想的目标机器人,我们就必须知道需要哪些输入变量。如果想得到最好的结果,就要求我们在 Robocode 中每一个可知的数据块都要模拟为变量。但是如果这样做,在贝叶斯网络结束计算时,我们会得到一个很庞大的完整概率表,而维护如此庞大的概率表将会花费我们很多的系统资源和计算时间。所以在开始之前我们必须要选择最重要的变量输入。这样从比赛中得到的关于敌人的一些有用信息有可能不会出现在贝叶斯网络之内,比如速 贝叶斯网络建造 贝叶斯网络的建造是一个复杂的任务,需要知识工程师和领域专家的参与。在实际中可能是反复交叉进行而不断完善的。面向设备故障诊断应用的贝叶斯网络的建造所需要的信息来自多种渠道,如设备手册,生产过程,测试过程,维修资料以及专家经验等。首先将设备故障分为各个相互独立且完全包含的类别(各故障类别至少应该具有可以区分的界限),然后对各个故障类别分别建造贝叶斯网络模型,需要注意的是诊断模型只在发生故障时启动,因此无需对设备正常状态建模。通常设备故障由一个或几个原因造成的,这些原因又可能由一个或几个更低层次的原因造成。建立起网络的节点关系后,还需要进行概率估计。具体方法是假设在某故障原因出现的情况下,估计该故障原因的各个节点的条件概率,这种局部化概率估计的方法可以大大提高效率。 贝叶斯网络训练 使用贝叶斯网络必须知道各个状态之间相关的概率。得到这些参数的过程叫做训练。和训练马尔可夫模型一样,训练贝叶斯网络要用一些已知的数据。比如在训练上面的网络,需要知道一些心血管疾病和吸烟、家族病史等有关的情况。相比马尔可夫链,贝叶斯网络的训练比较复杂,从理论上讲,它是一个NP-complete 问题,也就是说,对于现在的计算机是不可计算的。但是,对于某些应用,这个训练过程可以简化,并在计算上实现。 贝叶斯网络具有如下特性: 1。贝叶斯网络本身是一种不定性因果关联模型。贝叶斯网络与其他决策模型不同,它本身是将多元知识图解可视化的一种概率知识表达与推理模型,更为贴切地蕴含了网络节点变量之间的因果关系及条件相关关系。 2。贝叶斯网络具有强大的不确定性问题处理能力。贝叶斯网络用条件概率表达各个信息要素之间的相关关系,能在有限的,不完整的,不确定的信息条件下进行学习和推理。 3。贝叶斯网络能有效地进行多源信息表达与融合。贝叶斯网络可将故障诊断与维修决策相关的各种信息纳入网络结构中,按节点的方式统一进行处理,能有效地按信息的相关关系进行融合。 目前对于贝叶斯网络推理研究中提出了多种近似推理算法,主要分为两大类:基于仿真方法和基于搜索的方法。在故障诊断领域里就我们水电仿真而言,往往故障概率很小,所以一般采用搜索推理算法较适合。就一个实例而言,首先要分析使用那种算法模型: a.)如果该实例节点信度网络是简单的有向图结构,它的节点数目少的情况下,采用贝叶斯网络的精确推理,它包含多树传播算法,团树传播算法,图约减算法,针对实例事件进行选择恰当的算法; b.)如果是该实例所画出节点图形结构复杂且节点数目多,我们可采用近似推理算法去研究,具体实施起来最好能把复杂庞大的网络进行化简,然后在与精确推理相结合来考虑。 在日常生活中,人们往往进行常识推理,而这种推理通常是不准确的。例如,你看见一个头发潮湿的人走进来,你可能会认为外面下雨了,那你也许错了;如果你在公园里看到一男一女带着一个小孩,你可能会认为他们是一家人,你可能也犯了错误。在工程中,我们也同样需要进行科学合理的推理。但是,工程实际中的问题一般都比较复杂,而且存在着许多不确定性因素。这就给准确推理带来了很大的困难。很早以前,不确定性推理就是人工智能的一个重要研究领域。尽管许多人工智能领域的研究人员引入其它非概率原理,但是他们也认为在常识推理的基础上构建和使用概率方法也是可能的。为了提高推理的准确性,人们引入了概率理论。最早由Judea Pearl于1988年提出的贝叶斯网络(Bayesian Network)实质上就是一种基于概率的不确定性推理网络。它是用来表示变量集合连接概率的图形模型,提供了一种表示因果信息的方法。当时主要用于处理人工智能中的不确定性信息。随后它逐步成为了处理不确定性信息技术的主流,并且在计算机智能科学、工业控制、医疗诊断等领域的许多智能化系统中得到了重要的应用。 贝叶斯理论是处理不确定性信息的重要工具。作为一种基于概率的不确定性推理方法,贝叶斯网络在处理不确定信息的智能化系统中已得到了重要的应用,已成功地用于 收稿日期:2004-01-23。 项目来源:国家自然科学基金资助项目(60175022)。 第29卷第4期2004年4月武汉大学学报#信息科学版 Geomatics and Information Science of Wuhan U niversity V ol.29No.4Apr.2004 文章编号:1671-8860(2004)04-0315-04文献标识码:A 贝叶斯网络结构学习及其应用研究 黄解军1 万幼川1 潘和平 1 (1 武汉大学遥感信息工程学院,武汉市珞喻路129号,430079) 摘 要:阐述了贝叶斯网络结构学习的内容与方法,提出一种基于条件独立性(CI)测试的启发式算法。从完全潜在图出发,融入专家知识和先验常识,有效地减少网络结构的搜索空间,通过变量之间的CI 测试,将全连接无向图修剪成最优的潜在图,近似于有向无环图的无向版。通过汽车故障诊断实例,验证了该算法的可行性与有效性。 关键词:贝叶斯网络;结构学习;条件独立性;概率推理;图论中图法分类号:T P18;T P311 贝叶斯网络学习是贝叶斯网络的重要研究内容,也是贝叶斯网络构建中的关键环节,大体分为结构学习和参数学习两个部分。由于网络结构的空间分布随着变量的数目和每个变量的状态数量呈指数级增长,因此,结构学习是一个NP 难题。为了克服在构建网络结构中计算和搜索的复杂性,许多学者进行了大量的探索性工作[1~5]。至今虽然出现了许多成熟的学习算法,但由于网络结构空间的不连续性、结构搜索和参数学习的复杂性、数据的不完备性等特点,每种算法都存在一定的局限性。本文提出了一种新算法,不仅可以有效地减少网络结构的搜索空间,提高结构学习的效率,而且可避免收敛到次优网络模型的问题。 1 贝叶斯网络结构学习的基本理论 1.1 贝叶斯网络结构学习的内容 贝叶斯网络又称为信念网络、概率网络或因果网络[6] 。它主要由两部分构成:1有向无环图(directed acyclic graph,DAG),即网络结构,包括节点集和节点之间的有向边,每个节点代表一个变量,有向边代表变量之间的依赖关系;o反映变量之间关联性的局部概率分布集,即概率参数,通常称为条件概率表(conditional probability table,CPT),概率值表示变量之间的关联强度或置信度。贝叶斯网络结构是对变量之间的关系描 述,在具体问题领域,内部的变量关系形成相对稳定的结构和状态。这种结构的固有属性确保了结构学习的可行性,也为结构学习提供了基本思路。贝叶斯网络结构学习是一个网络优化的过程,其目标是寻找一种最简约的网络结构来表达数据集中变量之间的关系。对于一个给定问题,学习贝叶斯网络结构首先要定义变量及其构成,确定变量所有可能存在的状态或权植。同时,要考虑先验知识的融合、评估函数的选择和不完备数据的影响等因素。 1.2 贝叶斯网络结构学习的方法 近10年来,贝叶斯网络的学习理论和应用取得了较大的进展。目前,贝叶斯网络结构学习的方法通常分为两大类:1基于搜索与评分的方法,运用评分函数对网络模型进行评价。通常是给定一个初始结构(或空结构),逐步增加或删减连接边,改进网络模型,从而搜索和选择出一个与样本数据拟合得最好的结构。根据不同的评分准则,学习算法可分为基于贝叶斯方法的算法[3,7]、基于最大熵的算法[8]和基于最小描述长度的算法[1,2]。o基于依赖关系分析的方法,节点之间依赖关系的判断通过条件独立性(CI )测试来实现,文献[9,10]描述的算法属于该类算法。前者在DAG 复杂的情况下,学习效率更高,但不能得到一个最优的模型;后者在数据集的概率分布与DAG 同构的条件下,通常获得近似最优的模型[11], Promedas—贝叶斯网络在医学诊断中的应用1. 综述 现代的医学诊断是一个非常复杂的过程,要求具备患者准确的资料,以及对医学著作深刻的理解,还有多年的临床经验。这样的情况尤其适用在内科诊断中,因为它涵盖了一个巨大范围的诊断门类。而且也因此使得内科诊断成为了一个需要专攻的学科。 诊断是一个过程。通过这个过程,医生为病人的症状寻找拥有最佳解释的病因。这个研究的过程是一个连续的过程,即病人的症状会指示医生对其进行一些初步的检查。基于这些初步检查的结果,一个关于可能的病因的试探性的假设形成了。这个过程可能会在若干个循环中推进,直到病人被以充分的确定性来做了诊断,而且其症状的病因也被建立起来。 诊断过程的一个很重要的部分是标准化诊断的形式。这里有若干的规则来限制:依据病人的症状以及检验的结果,什么样的检查应该被执行,它们的顺序应该是什么样的。这些规则形成了一个决策树,其节点是诊断的中间过程;依据当前诊断的结果,其枝干指向额外的检查。这些规则是由每个国家的一个医学专家委员会制定的。 在平时遇到的大部分诊断里,上面提到的指南已经足以准确的指导我们做出正确的诊断。对于这种“一般”的情形,一个“决策支持系统”是没有必要的。在10%~20%的案例中,进行诊断的过程是很困难的。因为对于正确的诊断结果的不确定性,以及对下一步进行什么检查的不确定性,不同的医生在不同的诊断过程中做出的决策是不一样的,而且缺乏“推理”。在这些案例中,通常一个专攻此类疾病的专家或者详细描述此类疾病的著作将会被咨询。对于这种困难的情形,基于计算机的决策支持系统可以作为一个可供选择的信息来源。而且,这样一个由计算机提供帮助的决策支持系统在指出其他一些原来可能被忽略的疾病方面是有帮助的。它可能就此导致一个被提高的,更加理性的诊断过程,并且更见高效和廉价。 算法杂货铺——分类算法之贝叶斯网络(Bayesian networks) 2010-09-18 22:50 by EricZhang(T2噬菌体), 2561 visits, 网摘, 收藏, 编辑 2.1、摘要 在上一篇文章中我们讨论了朴素贝叶斯分类。朴素贝叶斯分类有一个限制条件,就是特征属性必须有条件独立或基本独立(实际上在现实应用中几乎不可能做到完全独立)。当这个条件成立时,朴素贝叶斯分类法的准确率是最高的,但不幸的是,现实中各个特征属性间往往并不条件独立,而是具有较强的相关性,这样就限制了朴素贝叶斯分类的能力。这一篇文章中,我们接着上一篇文章的例子,讨论贝叶斯分类中更高级、应用范围更广的一种算法——贝叶斯网络(又称贝叶斯信念网络或信念网络)。 2.2、重新考虑上一篇的例子 上一篇文章我们使用朴素贝叶斯分类实现了SNS社区中不真实账号的检测。在那个解决方案中,我做了如下假设: i、真实账号比非真实账号平均具有更大的日志密度、各大的好友密度以及更多的使用真实头像。 ii、日志密度、好友密度和是否使用真实头像在账号真实性给定的条件下是独立的。 但是,上述第二条假设很可能并不成立。一般来说,好友密度除了与账号是否真实有关,还与是否有真实头像有关,因为真实的头像会吸引更多人加其为好友。因此,我们为了获取更准确的分类,可以将假设修改如下: i、真实账号比非真实账号平均具有更大的日志密度、各大的好友密度以及更多的使用真实头像。 ii、日志密度与好友密度、日志密度与是否使用真实头像在账号真实性给定的条件下是独立的。 iii、使用真实头像的用户比使用非真实头像的用户平均有更大的好友密度。 黄友平 构建一个指定领域的贝叶斯网络包括三个任务: ①标识影响该领域的变量及其它们的可能值; ②标识变量间的依赖关系,并以图形化的方式表示出来; ③学习变量间的分布参数,获得局部概率分布表。 实际上建立一个贝叶斯网络往往是上述三个过程迭代地、反复地交互过程。 一般情况下,有三种不同的方式来构造贝叶斯网:①由领域专家确定贝叶 斯网的变量(有时也成为影响因子)节点,然后通过专家的知识来确定贝叶斯网络的结构,并指定它的分布参数。这种方式构造的贝叶斯网完全在专家的指导下进行,由于人类获得知识的有限性,导致构建的网络与实践中积累下的数据具有很大的偏差;②由领域专家确定贝叶斯网络的节点,通过大量的训练数据,来学习贝叶斯网的结构和参数。这种方式完全是一种数据驱动的方法,具有很强的适应性。而且随着人工智能、数据挖掘和机器学习的不断发展,使得这种方法成为可能。如何从数据中学习贝叶斯网的结构和参数,已经成为贝叶斯网络研究的热点。③由领域专家确定贝叶斯网络的节点,通过专家的知识来指定网络的结构,而通过机器学习的方法从数据中学习网络的参数。这种方式实际上是前两种方式的折中,当领域中变量之间的关系较明显的情况下,这种方法能大大提高学习的效率。 在由领域专家确定贝叶斯网络的节点后,构造贝叶斯 网的主要任务就是学习它的结构和参数。 为使贝叶斯网作为知识模型是可用的, 在学习过程中致力于寻找一种最简单的网络结构是非常必要的,这种简单的结构模型称之为稀疏网络,它含有最少可能的参数及最少可能的依赖关系。 Bayesian 网是联合概率分布的简化表示形式,可以计算变量空间的任意概 率值。当变量数目很大时,运用联合概率分布进行计算通常是不可行的,概率数目是变量数目的指数幂,计算量难以承受。Bayesian 网利用独立因果影响关系解决了这个难题。Bayesian 网中三种独立关系:条件独立、上下文独立及因果影响独立。三种独立关系旨在把联合概率分布分解成更小的因式,从而达到节省存储空间、简化知识获取和领域建模过程、降低推理过程中计算复杂性的目的,因此可以说独立关系是Bayesian 网的灵魂。 贝叶斯网络结构的方法分成两类: 基于评分的方法(Based on scoring)和 基于条件独立性的方法(Based on Conditional independence)。 。基于评分的方法把贝叶斯网络看成是含有属性之 基于贝叶斯网络 的大坝病害诊断研究 徐耀张利民贾金生 中国水利水电科学研究院 中国大坝协会 1香港科技大学 研究背景 截止2007年,全国病险水库座占所有水库数目有37000座,占所有水库数目(85000)的43%。(Chen 2007) 病险水库安全水库 上述病险水库大坝一般为三类坝,抗御洪水标准低,或工程有严重安全隐患不能按设计正常运行或工程有严重安全隐患,不能按设计正常运行。需要解决两个问题 需要解决两个问题: 诊断病害,查找原因;提出合适的除险加固措施2 提出合适的除险加固措施。 大坝病害 坝体-基础结构的病害: 渗流病害 渗流病害; 结构病害(变形、稳定等); … 辅助结构的病害: 1)多样性;2)相关性。 溢洪道病害; 涵管病害; … 大坝病害多样性及相关性的特征要求我们对病险大3 坝进行系统全局的病害诊断。 贝叶斯网络 贝叶斯网络定义为一个由若干变量(节点)构成的有其中变量(节点)之间的关系强度用向无环图,其中变量(节点)之间的关系强度用条件概率表达。(Pearl 1988) A 因果关系图 B + ?P(A) & P(B); P(C|A)P(C|B)P(C|A B)概率表 1 2 C ?P(C|A), P(C|B), P(C|A, B).?节点A,B,C代表变量; ?箭头1,2代表因果关系;?定量评价各个原因可能性;敏感性分析找出重要因子;应用 4 ? A,B称为父节点,C称为子节点. ?敏感性分析找出重要因子; ? 动态分析更新结果. 研究目标 建立一个基于贝叶斯网络的病险大坝病建立个基于贝叶斯网络的病险大坝病害诊断系统: 基于数据库的大坝病害的群体性诊断 基于数据库的大坝病害的群体性诊断;某一特定大坝病害的个体化诊断。 某特定大坝病害的个体化诊断。 5 Matlab贝叶斯网络建模 1 FullBNT简介 基于Matlab的贝叶斯网络工具箱BNT是kevin p.murphy基于matlab语言开发的关于贝叶斯网络学习的开源软件包,提供了许多贝叶斯网络学习的底层基础函数库,支持多种类型的节点(概率分布)、精确推理和近似推理、参数学习及结构学习、静态模型和动态模型。 1.1贝叶斯网络表示 BNT中使用矩阵方式表示贝叶斯网络,即若节点i到j有一条弧,则对应矩阵中 值为1,否则为0。 1.2结构学习算法函数 BNT中提供了较为丰富的结构学习函数,都有: 1. 学习树扩展贝叶斯网络结构的 算法 . 2. 数据完整条件下学习一般贝叶斯网络结构学习算法 表1-1 数据完整条件下贝叶斯结构算法 算法名称调用函数 K2算法learn_struct_k2() 贪婪搜索GS(greedy search)算法earn_struct_gs() 3. 缺失数据条件下学习一般贝叶斯网络结构学习算法 表1-2 缺失数据条件下贝叶斯结构算法 1.3参数学习算法函数 1. BNT中也提供了丰富的参数学习函数,都有: 2. 完整数据时,学习参数的方法主要有两种:最大似然估计learn_params()和贝叶斯方法bayes_update_params(); 3. 数据缺失时,如果已知网络拓扑结构,用EM算法来计算参数, learn_params_em ()。 1.4推理机制及推理引擎 为了提高运算速度,使各种推理算法能够有效应用,BNT工具箱采用了引擎 机制,不同的引擎根据不同的算法来完成模型转换、细化和求解。这个推理过程如下: BNT中提供了多种推理引擎,都有: 摘要 常用的数据挖掘方法有很多,贝叶斯网络方法在数据挖掘中的应用是当前研究的热点问题,具有广阔的应用前景。数据挖掘的主要任务就是对数据进行分析处理,从而获得其中隐含的、实现未知的而又有用的知识。他的最终目的就是发现隐藏在数据内部的规律和数据之间的特征,从而服务于管理和决策。贝叶斯网络作为在上个世纪末提出的一种崭新的数据处理工具,在进行不确定性推理和知识表示等方面已经表现出来它的独到之处,特别是当它与统计方法结合使用时,显示出许多关于数据处理优势。 本文致力于贝叶斯网络在数据挖掘中的应用研究,首先介绍了贝叶斯网络相关理论,贝叶斯网络的学习是数据挖掘中非常重要的一个环节,本文比较详细的讨论了网络图结构问题,为利用贝叶斯网络解决实际问题,建立样本数据结构和依赖关系奠定了基础。其次介绍了数据挖掘的相关问题以及主流的数据挖掘算法,并分析了各类算法的优缺点。针对目前还没有一种完整的在数据挖掘中构建贝叶斯网络的算法步骤,本文探讨性的提出了一种启发式的在数据挖掘中利用样本数据构建贝叶斯网络的算法思想。最后进行了实验分析,利用本文提出的算法,建立了大学生考研模型和农户信用等级评定模型,进行了较为详细的实验,并分别与决策树方法和传统的信用评分方法进行了比较,实验结果表明文本提出的算法设计简单、方法实用、应用有效,与其他算法相比还有精度比较高的特点,同时也表现出了该算法在数据挖掘方面的优势,利于实际中的管理、分析、预测和决策等。 贝叶斯网络的相关理论 本章对贝叶斯网络的相关理论进行了系统的论述与分析,并用一个简单的疾病诊断模型对贝叶斯网络的定义以及网络构成进行了介绍。结合信息论的有关知识,讨论了贝叶斯网络中重要的条件独立研究,并学习和研究了贝叶斯网络在完备数据和不完备数据两种情况下的结构学习和参数学习方法。结构学习是利用训练样本集,尽可能的结合先验知识,确定贝叶斯网络的拓扑结构;参数学习是在给定的网络结构的情况下,确定贝叶斯网络中各变量的条件概率表。其中结构学习是贝叶斯网络学习的核心,有效的结构学习方法是构建最优贝叶斯网络结构的前提。 预备知识 贝叶斯网络是一种关于变量集合中概率性联系的图解模型,接近于概率和统计,它的理论依据是概率统计,并以图论的形式来表达和描述数据实例中的关联和因果关系。 条件概率:条件概率是概率论中一个重要而实用的概念。所考虑的是事件A已经发生的条件下事件B发生的概率。 定义:设A、B是两个事件,且P(A)>0,称: 为在事件A发生的条件下事件B发生的概率。 显然条件概率符合概率定义中的三个条件,即:贝叶斯网络

贝叶斯网络研究现状与发展趋势的文献计量分析

1选题:本课题国内外研究现状述评,提出选题的背景及意义.doc

基于贝叶斯网络的各种抽样方法比较

贝叶斯网络

贝叶斯网络的建造训练和特性

贝叶斯网络结构学习及其应用研究_黄解军

Promedas—贝叶斯网络在医学诊断中的应用

算法杂货铺——分类算法之贝叶斯网络(Bayesian networks)

贝叶斯网络研究

基于贝叶斯网络

贝叶斯网络Matlab

贝叶斯网络