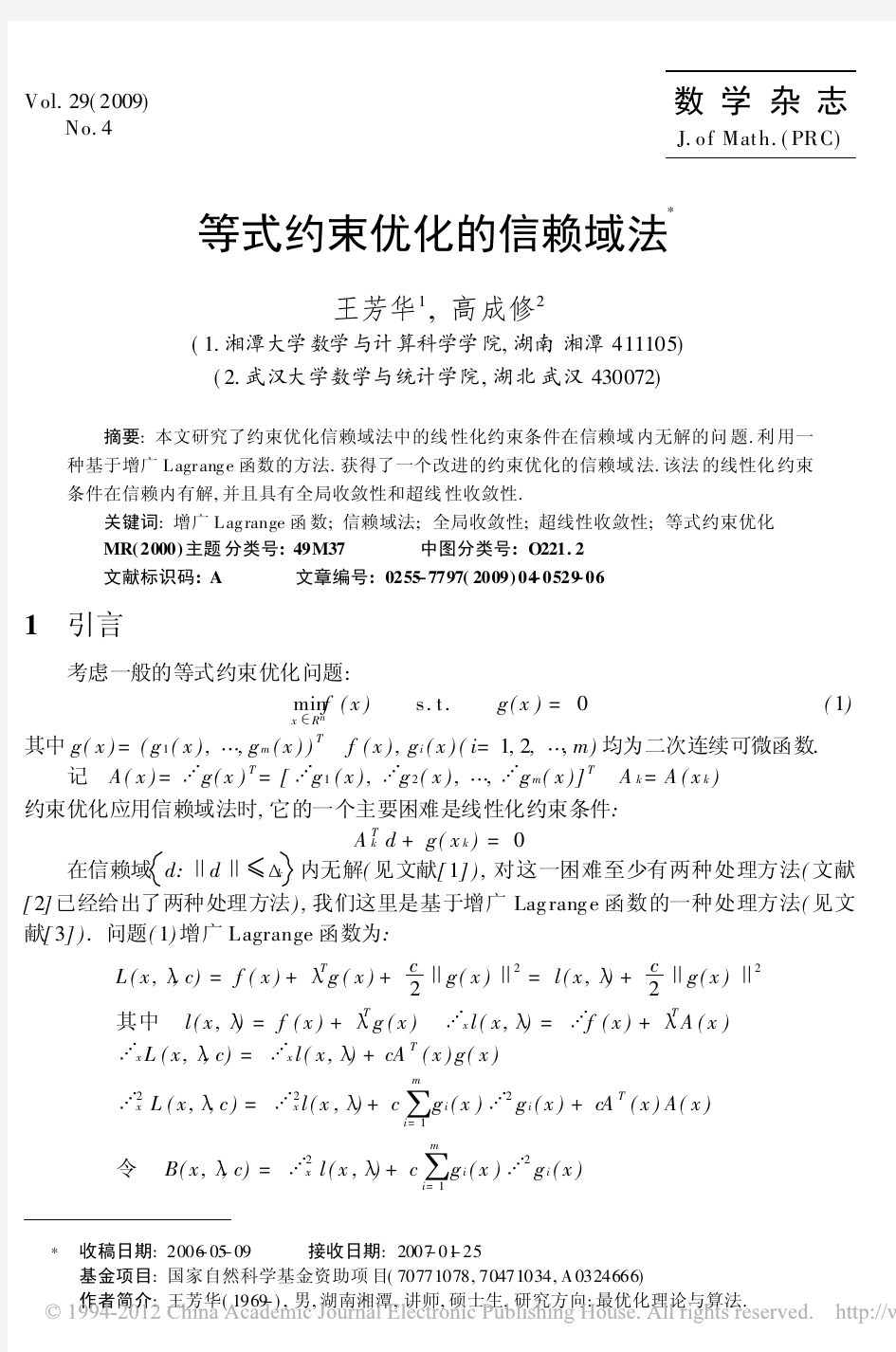

等式约束优化的信赖域法

最优化方法——信赖域法

信赖域法 董文峰,03,R数学08-1班伊广旭,03,R数学08-1班李超,04,R数学08-1班 一、算法理论

信赖域方法与线搜索技术一样, 也是优化算法中的一种保证全局收敛的重要技术. 它们的功能都是在优化算法中求出每次迭代的位移, 从而确定新的迭代点.所不同的是: 线搜索技术是先产生位移方向(亦称为搜索方向), 然后确定位移的长度(亦称为搜索步长)。而信赖域技术则是直接确定位移, 产生新的迭代点。 信赖域方法的基本思想是:首先给定一个所谓的“信赖域半径”作为位移长度的上界,并以当前迭代点为中心以此“上界”为半径确定一个称之为“信赖域”的闭球区域。然后,通过求解这个区域内的“信赖域子问题”(目标函数的二次近似模型) 的最优点来确定“候选位移”。若候选位移能使目标函数值有充分的下降量, 则接受该候选位移作为新的位移,并保持或扩大信赖域半径, 继续新的迭代。否则, 说明二次模型与目标函数的近似度不够理想,需要缩小信赖域半径,再通过求解新的信赖域内的子问题得到新的候选位移。如此重复下去,直到满足迭代终止条件。 信赖域方法解决无约束线性规划 f(x)R x ∈min 的基本算法结构。设k x 是第k 次迭代点,记)f(x f k k =,)f(x g k k ?=,k B 是Hesse 阵)f(x k 2?的第k 次近似,则第k 次迭代步的信赖域子问题具有如下形式: ,2 1g (d)min T k d B d d q k T k += k d t s ?≤.. 其中k ?是信赖域半径,?是任一种向量范数,通常取2-范数或∞-范数。 定义k f ?为f 在第k 步的实际下降量: ),d f(x f Δf k k k k +=- 定义k q ?对应的预测下降量: ()().-0k k k k d q q q =? 定义他们的比值为: k k k q f r ??= 一般的,我们有0>?k q 。因此,若0 拉格朗日乘子法 约束优化问题的标准形式为: min (),..()0,1,2,...,()0,1,2,...,n i j f x x R s t g x i m h x j l ∈≤=== ,,:n i j f g h R R →其中 约束优化算法的基本思想是:通过引入效用函数的方法将约束优化问题转换为无约束问题,再利用优化迭代过程不断地更新效用函数,以使得算法收敛。 1. 罚函数法 罚函数法(内点法)的主思想是:在可行域的边界上筑起一道很高的“围墙”,当迭代点靠近边界时,目标函数陡然增大,以示惩罚,阻止迭代点穿越边界,这样就可以将最优解“挡”在可行域之内了。 它只适用于不等式约束: min (),..0,1,2,...,n i f x x R s t g i m ∈≤= 它的可行域为: {|()0,1,2,...,}n i D x R g x i m =∈≤= 对上述约束问题,其其可行域的内点可行集0D ≠?的情况下,引入效用函数: min (,)()()B x r f x rB x =+%、 其中11()()m i i B x g x ==-∑%或1 ()|ln(())|m i i B x g x ==-∑% 算法的具体步骤如下: 给定控制误差0ε>,惩罚因子的缩小系数01c <<。 步骤1:令1k =,选定初始点(0)0x D ∈,给定10r >(一般取10)。 步骤2:以()k x 为初始点,求解无约束 min (,)()()k B x r f x r B x =+% 其中11()()m i i B x g x ==-∑%或1 ()|ln(())|m i i B x g x ==-∑%,得最优解()()k k x x r = 步骤3:若()()k k r B x ε<%,则()k x 为其近似最优解,停;否则,令,1k k r cr k k ==+, 转步骤2. 等式约束优化问题的极值条件 求解等式约束优化问题 )(m i n x f ..t s ()0=x h k ()m k ,,2,1???= 需要导出极值存在的条件,对这一问题有两种处理方法:消元法和拉格朗日乘子法(升维法) 一、消元法(降维法) 1.对于二元函数 ),(min 21x x f ..t s ()0,21=x x h , 根据等式约束条件,将一个变量1x 表示成另一个变量2x 的函数关系()21x x ?=,然后将这一函数关系代入到目标函数()21,x x f 中消去1x 变成一元函数()2x F 2.对于n 维情况 ()n x x x f ,,,min 21???..t s ()0,,,21=???n k x x x h ),,2,1(l k ???= 由l 个约束方程将n 个变量中的前l 个变量用其余的l n -个变量表示: ()n l l x x x x ,,,2111???=++? ()n l l x x x x ,,,2122???=++? ... ()n l l l l x x x x ,,,21???=++? 将这些函数关系代入到目标函数中,得到()n l l x x x F ,,,21???++ 二、拉格朗日乘子法(升维法) 设T n x x x x ),,,(21???=,目标函数是()x f ,约束条件()0=x h k ),,2,1(l k ???=的l 个等式约束方程。为了求出()x f 的可能极值点T n x x x x ),,,(**2*1*???=,引入拉格朗日乘子k λ),,2,1(l k ???=,并构成一个新的目标函数 ()()x h x f x F l k k k ∑=+=1),(λλ 把()λ,x F 作为新的无约束条件的目标函数来求解它的极值点,满足约束条件 ()0=x h k ),,2,1(l k ???=的原目标函数()x f 的极值点。 ()λ,x F 具有极值的必要条件 ),,2,1(0n i x F i ???==?? ,),,2,1(0l k F k ???==??λ可得n l + 信赖域法示例浅析 摘要:本文介绍了非单调信赖域算法的基本知识,包括非单调信赖域算法的理论、算法框图及数值运算实例,数值结果表明该算法在求解高维非线性规划问题时比一般算法更有效。 关键词:信赖域法信赖半径Hesse阵Bk 引言 信赖域方法是求解非线性规划问题的常用方法之一,因其具有良好的可靠性和强健的收敛性备受非线性优化领域专家们的关注[1],信赖域方法与线搜索技术一样,也是优化算法中的一种保证全局收敛的重要技术。它们的功能都是在优化算法中求出每次迭代的位移,从而确定新的迭代点。漂亮的收敛性和有效的计算性确定了信赖域算法是一类重要和实用的方法[2]。因此研究约束优化问题的信赖域算法具有重要的意义。 1、算法的基本理论 与线搜索技术相比不同的是:线搜索技术是先产生位移方向(亦称为搜索方向),然后确定位移的长度(亦称为搜索步长)。而信赖域技术则是直接确定位移,产生新的迭代点。信赖域方法的基本思想是:首先给定一个所谓的“信赖域半径”作为位移长度的上界,并以当前迭代点为中心以此“上界”为半径确定一个称之为“信赖域”的闭球区域。然后,通过求解这个区域内的“信赖域子问题”(目标函数的二次近似模型)的最优点来确定“候选位移”。若候选位移能使目标函数值有充分的下降量,则接受该候选位移作为新的位移,并保持或扩大信赖域半径,继续新的迭代。否则,说明二次模型与目标函数的近似度不够理想,需要缩小信赖域半径,再通过求解新的信赖域内的子问题得到新的候选位移。如此重复下去,直到满足迭代终止条件。 2、信赖域方法解决无约束线性规划的基本算法结构 设■是第■次迭代点,记是Hesse阵■的第■次近似,则第■次迭代步的信赖域子问题具有如下形式: 其中■是信赖域半径,■是任一种向量范数,通常取2-范数或∞-范数。定义■为■在第■步的实际下降量: 定义■对应的预测下降量: 定义他们的比值为:。一般的,我们有■。因此,若■,则■,■不能作为下一个迭代点,需要缩小信赖半径重新求解问题。若■比较接近于1,说明二次模型与目标函数在信赖与范围内有很好的相似,此时■可以作为新的迭代点,同时 信赖域方法 信赖域方法在当前搜索点附近具有一个区域,其中关于局部极小化的二次模型 被"信赖"为正确的,并且步骤被选择留在该区域内. 在搜索的过程中,区域大小根据模型和实际函数计算的符合程度被修改. 非常典型地,信赖域采取的是一个满足的椭圆. 是一个对角缩放(通常采用近似 Hessian 的对角),而是信赖域半径,它在每个步骤被更新. 当基于二次模型的步骤本身位于信赖域之内的时候,那么就认为函数值在变小,因而采用这一步骤. 因此,正如线搜索方法中一样,步控制不会干涉算法在二次模型表现良好的极小值附近的收敛效果. 当基于二次模型的步骤位于信赖域之外时,则采用一个只到边界位置的步骤,以使得该步骤成为二次模型在信赖域边界处的近似极小化步骤. 一旦一个步骤被选择,该函数就在新的点被计算,而实际函数值与通过二次模型预测所得到的值互相对照. 真正计算的是实际与预测减少量的比率. 如果接近1,那么该二次模型是一个相当不错的预测器,该区域的大小可以扩大. 另一方面,如果太小,则该区域的大小就要被降低. 当低于某一阈值时,该步骤被拒绝并重新计算. 您可以使用方法选项"AcceptableStepRatio"->控制这一阈值. 通常情况下,是相当小的,以避免走向极小值的步骤也被拒绝. 然而,如果在一个点获取二次模型相当昂贵(例如,计算Hessian 需要花费相对较长的时间),一个较大值的将降低Hessian 计算的次数,但是它可能增加函数计算的次数. 要开始信赖域算法,需要确定一个初始半径. 默认情况下,Mathematica使用基于受比较宽松的相对步长限制的模型(1) 的步骤的大小. 然而,在某些情况下,这可能使您离开您原来感兴趣的区域,所以您可以使用选项指定一个初始半径 . 该选项在它的名字中包含Scaled,因为信赖域半径使用了对角缩放,所以这不是一个绝对的步长. 这里加载一个包含一些功用函数的程序包. In[1]:= 这里显示在搜索一个与Rosenbrock函数类似的函数的局部极小值的过程中,所采用的步骤和计算,用的是了利用信赖域步控制的牛顿法. 关于无约束最优化问题的信赖域解法 一、引言 无约束优化问题是实际工程中最常见的问题之一。这类问题虽然形式比较简单,但是对于某些大规模的或者非线性很强的问题,求解它们仍然是有相当难度的。 无约束问题的算法大致分成两类:一类在计算过程中要用到目标函数的导数,另一类则只要求目标函数值。本文中所讲述的信赖域法,与牛顿法、最速下降法、共轭梯度法一样,同属于第一类方法。 二、信赖域法的主要内容 2.1 信赖域法的基本思想 虽然信赖域法与最速下降法等同属于一大类,但是在基本思想上还是有所不同。其他几种方法的基本策略是:给定点x(k)后,定义搜索方向d(k),再从x(k)出发沿d(k)作一维搜索,信赖域法则不然,下面重点阐述一下其基本思想:首先给定一个所谓的“信赖域半径”作为位移长度的上界,并以当前迭代点为中心以此“上界”为半径确定一个称之为“信赖域”的闭球区域。然后,通过求解这个区域内的“信赖域子问题”(目标函数的二次近似模型) 的最优点来确定“候选位移”。若候选位移能使目标函数值有充分的下降量, 则接受该候选位移作为新的位移,并保持或扩大信赖域半径, 继续新的迭代。否则, 说明二次模型与目标函数的近似度不够理想,需要缩小信赖域半径,再通过求解新的信赖域内的子问题得到新的候选位移。如此重复下去,直到满足迭代终止条件。 2.2 信赖域法的数学分析 三、 运用信赖域法求解具体问题 考虑无约束问题 432 1122min () 45f x x x x x =++-+ 取初点(1)00x ?? =????,信赖域半径r 1=1,取μ=0.25,η=0.75.用信赖域法求解过 程: 1) 将初值代入目标函数求得函数值f(x (1))=5,目标函数的梯度 重庆科技学院学生实验报告 附录function [x,minf] = minGeneralPF(f,x0,h,c1,p,var,eps) format long; if nargin == 6 eps = 1.0e-4; end k = 0; FE = 0; for i=1:length(h) FE = FE + (h(i))^2; end x1 = transpose(x0); x2 = inf; while 1 M = c1*p; FF = M*FE; SumF = f + FF; [x2,minf] = minNT(SumF,transpose(x1),var); if norm(x2 - x1)<=eps x = x2; break; else c1 = M; x1 = x2; end end minf = subs(f,var,x); format short; %牛顿法求解无约束最优化问题 function [x,minf] = minNT(f,x0,var,eps) format long; if nargin == 3 eps = 1.0e-6; end tol = 1; x0 = transpose(x0); gradf = jacobian(f,var); jacf = jacobian(gradf,var); while tol>eps v = subs(gradf,var,x0); tol = norm(v); pv = subs(jacf,var,x0); p = -inv(pv)*transpose(v); p = double(p); x1 = x0 + p; x0 = x1; end x = x1; minf = subs(f,var,x); format short; >> syms x y; >> minGeneralPF(x^2+y^2,[1,1],y^2-1,1000,10,[x,y],0.0001) ans = 1.0000 fmincon函数优化问题 fmincon解决的优化模型如下: min F(X) subject to: A*X <= B (线性不等式约束) Aeq*X = Beq (线性等式约束) C(X) <= 0 (非线性不等式约束) Ceq(X) = 0 (非线性等式约束) LB <= X <= UB (参数x的取值范围) x = fmincon(fun,x0,A,b,Aeq,beq,lb,ub,nonlcon,options) fmincon是求解目标fun最小值的内部函数 x0是初值 A b线性不等式约束 Aeq beq线性等式约束 lb下边界 ub上边界 nonlcon非线性约束条件 options其他参数,对初学者没有必须,直接使用默认的即可 优化工具箱提供fmincon函数用于对有约束优化问题进行求解,其语法格式如下:x=fmincon(fun,x0,A,b) x=fmincon(fun,x0,A,b,Aeq,beq) x=fmincon(fun,x0,A,b,Aeq,beq,lb,ub) x=fmincon(fun,x0,A,b,Aeq,beq,lb,ub,nonlcon) x=fmincon(fun,x0,A,b,Aeq,beq,lb,ub,nonlcon,options) x=fmincon(fun,x0,A,b,Aeq,beq,lb,ub,nonlcon,options,P1,P2,...) [x,fval]=fmincon(...) [x,fval,exitflag]=fmincon(...) [x,fval,exitflag,output]=fmincon(...) 非线性优化中的信赖域方法及其应用 摘要 信赖域方法是非线性优化的一类重要的数值计算方法它在近二十年来受到了非线性优化研究界非常的重视。特别是最近几年,一直是非线性优化的研究热点。目前,信赖域方法已经和传统的线收索方法并列为非线性规划的两类主要数值方法。 关键词:信赖域法非线性优化约束条件 引言 非线性最优化是20世纪50年代发展起来的,它讨论非线性决策问题的最佳选择之特性,构造寻求最佳解的计算方法,研究这些计算方法的理论性质及实际计算表现。随着电子计算机的发展和应用,非线性最优化理论和方法有了很大发展。目前,它已成为运筹学的一个重要分支,并且在自然科学,工程技术,经济管理,系统工程,特别是“优化设计”等诸多领域得到广泛的应用,成为一门十分活跃的学科。 非线性优化的传统方法几乎都是线搜索类型的方法,即每次迭代时产生一搜索方向,然后在搜索方向上进行精确的或不精确的一维搜索,以得到下一个迭代点。信赖域方法是一类很新的方法,它和线搜索法并列为目前求解非线性规划的两类主要的数值方法。信赖域方法思想新颖,算法可靠,具有很强的收敛性,它不仅能很快地解决良态问题 ,而且也能有效地求解病态(ill-conditioned)的优化问题。因而对信赖域方法的研究是近20年来非线性规划领域的一个重要的研究方向,是当今寻求如何构造新的优化计算方法的主要途径。 信赖域方法的研究起源于Powell 1970 年的工作,他提出了一个求解无约束优化问题的算法,该算法在每次迭代时强制性地要求新的迭代点与当前的迭代点之间的距离不超过某一控制量。引入控制步长是因为传统的线搜索方法常常由于步长过大而导致算法失败,特别是当问题是病态时尤为如此。控制步长实质上等价于在以当前迭代点为中心的一个邻域内对一个近似于原问题的简单模型求极值。这种技巧可理解为只在一个邻域内对近似模型信赖,所以此邻域被称为信赖域(trust region)。利用这一技巧的方法也就被称为信赖域法。信赖域的大小通过迭代逐步调节。一般来说,如果在当前迭代模型较好地逼近原问题,则信赖域可扩大,否则信赖域应缩小。后来,人们发现信赖域方法的基本技巧在一定意义下等价于十分著名的求解非线性最小二乘问题的Levenberg - 2Marquadt方法。 一、算法理论 信赖域方法与线搜索技术一样,也是优化算法中的一种保证全局收敛的重要技术。它们的功能都是在优化算法中求出每次迭代的位移,从而确定新的迭代点.所不同的是: 线搜索技术是先产生位移方向(亦称为搜索方向),然后确定位移的长度(亦称为搜索步长)。而信赖域技术则是直接确定位移,产生新的迭代点。 2012-2013(1)专业课程实践论文 信赖域法 董文峰,03,R数学08-1班 伊广旭,03,R数学08-1班 李超,04,R数学08-1班 一、算法理论 信赖域方法与线搜索技术一样, 也是优化算法中的一种保证全局收敛的重要技术. 它们的功能都是在优化算法中求出每次迭代的位移, 从而确定新的迭代点.所不同的是: 线搜索技术是先产生位移方向(亦称为搜索方向), 然后确定位移的长度(亦称为搜索步长)。而信赖域技术则是直接确定位移, 产生新的迭代点。 信赖域方法的基本思想是:首先给定一个所谓的“信赖域半径”作为位移长度的上界,并以当前迭代点为中心以此“上界”为半径确定一个称之为“信赖域”的闭球区域。然后,通过求解这个区域内的“信赖域子问题”(目标函数的二次近似模型) 的最优点来确定“候选位移”。若候选位移能使目标函数值有充分的下降量, 则接受该候选位移作为新的位移,并保持或扩大信赖域半径, 继续新的迭代。否则, 说明二次模型与目标函数的近似度不够理想,需要缩小信赖域半径,再通过求解新的信赖域内的子问题得到新的候选位移。如此重复下去,直到满足迭代终止条件。 信赖域方法解决无约束线性规划 f(x)R x ∈min 的基本算法结构。设k x 是第k 次迭代点,记)f(x f k k =,)f(x g k k ?=,k B 是Hesse 阵)f(x k 2?的第k 次近似,则第k 次迭代步的信赖域子问题具有如下形式: ,2 1g (d)min T k d B d d q k T k += k d t s ?≤. . 其中k ?是信赖域半径,?是任一种向量范数,通常取2-范数或∞-范数。 定义k f ?为f 在第k 步的实际下降量: ),d f(x f Δf k k k k +=- 定义k q ?对应的预测下降量: ()().-0k k k k d q q q =? 定义他们的比值为: k k k q f r ??= 一般的,我们有0>?k q 。因此,若0 分数: ___________ 任课教师签字:___________ 课程作业 学年学期:2017——2018学年第二学期 课程名称:优化理论 作业名称:作业四 学生姓名: 学号: 提交时间: 一、问题重述 形如下式的寻优问题称为无约束最优化问题,这类问题的最优解称为约束最优解。 min f(x).. (x)0,i 1,...p h (x)0,j 1,...q 0,0i j s t g p q ??≤=?? ==? ?>>? 约束优化问题的最优性条件是,在满足灯饰和不等式约束条件下,其目标函数值最小的点所必须满足的条件。 约束优化设计问题求解方式有两种,间接法和直接法。直接法是在满足不等式约束的可行设计区域内直接搜索问题的最优解和最小值,常用的方法有随机方向法、复合形法。间接法是将优化问题转化为一系列无约束优化问题来求解,常用的方法有内惩罚函数法、外惩罚函数法以及混合惩罚函数法。 本次作业以为例,介绍无约束最优化问题的寻优方法。 二、算法原理 复合形法是求解约束非线性寻优问题的一种重要的直接方法。 复合形法的核心在于可行域内构造的不断逼近最优点的复合形。每次迭代,计算各顶点的目标函数值,找到目标函数值最大的顶点(称最坏点),然后按相应的原则求出目标函数可行的下降点,以此代替最坏点,构成新的复合形。复合形每改变一次,各个顶点就向最优点移动一步,直至满足终止条件,找到最优点。 复合形法的顶点数K 通常取12n K n +≤≤,其中n 表示搜索环境的维度。初始图形的顶点是由设计者确定或者随机产生的,但一定要保证在可行域内。如果随机产生的初始点没有在可行域内,可以通过以下步骤将其调入可行域内。 (1)计算在可行域内点的初始点集中心X (s); (2)将可行域外的点向X (s)靠拢,每次前进间距的一半,直至进入可行域内。 复合行法的终止条件可以有以下几种形式,满足终止条件后,可将最后复合形的好点及其函数值作为最优解输出。 (1)各顶点与好点函数值之差的均方根小于误差限; (2)各顶点与好点的函数之差平和小于误差限; (3)各顶点与好点函数值差的绝对值之和小于误差限。 Chin.Quart.J.of Math. 2009,24(3):469—474 Feasible SQP Descent Method for Inequality Constrained Optimization Problems and Its Convergence ZHANG He-ping1,YE Liu-qing2 (1.Department of Mathematics,Luohe Vocational Technology College,Luohe462000,China;2.Depart-ment of Mathematics,Jiaozuo Teachers College,Jiaozuo454002,China) Abstract:In this paper,the new SQP feasible descent algorithm for nonlinear constrained optimization problems presented,and under weaker conditions of relative,we proofed the new method still possesses global convergence and its strong convergence.The numerical results illustrate that the new methods are valid. Key words:nonlinearly constrained optimization;SQP;the generalized projection;line search;global convergence;strong convergence. 2000MR Subject Classi?cation:90C30,49M37 CLC number:O221.2Document code:A Article ID:1002–0462(2009)03–0469–06 §1.Introduction and Preparation Concept Nonlinear inequality constrained optimization problems (P)min f0(x); s.t.f j(x)≤0,j∈I={1,2,···,m} During the research of method for nonlinear inequality constrained optimization,Due to the rapid convergence-type methods(such as sequential quadratic programming,sequential quadratic programming,Jane recorded as SQP)can calculate the solution to meet the optimization in the shortest possible time and with less the amount of calculation under a certain accuracy solution, Received date:2009-03-10 Foundation item:Supported by the NNSF of China(10231060);Supported by the Soft Science Foundation of Henan Province(082400430820) Biographies:ZHANG He-ping(1965-),male,native of Hebi,Henan,an associate professor of Luohe Vo-cational Technology College,M.S.D.,engages in nonlinear programming;YE Liu-qing(1965-),male,native of Runan,Henan,a professor of Jiaozuo Teachers College,M.S.D.,engages in nonlinear programming.约束优化算法拉格朗日乘子法

约束优化问题的极值条件

信赖域法示例浅析

信赖域方法

关于无约束最优化问题的信赖域解法

等式约束极值问题-外点罚函数法

Matlab的fmincon函数(非线性等式不等式约束优化问题求解)

信赖域方法概论

最优化方法——信赖域法

有约束优化问题

不等式约束最优化问题的可行SQP下降算法及其收敛性_英文_